플레이데이터 수업

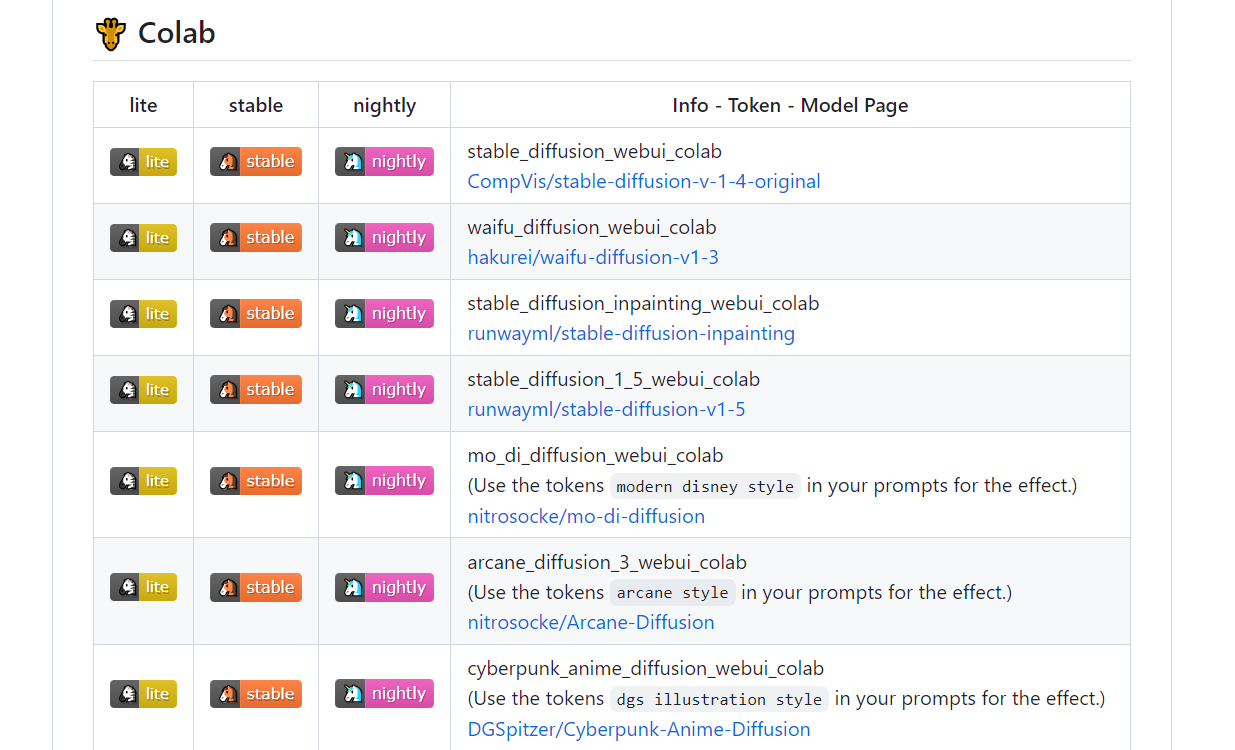

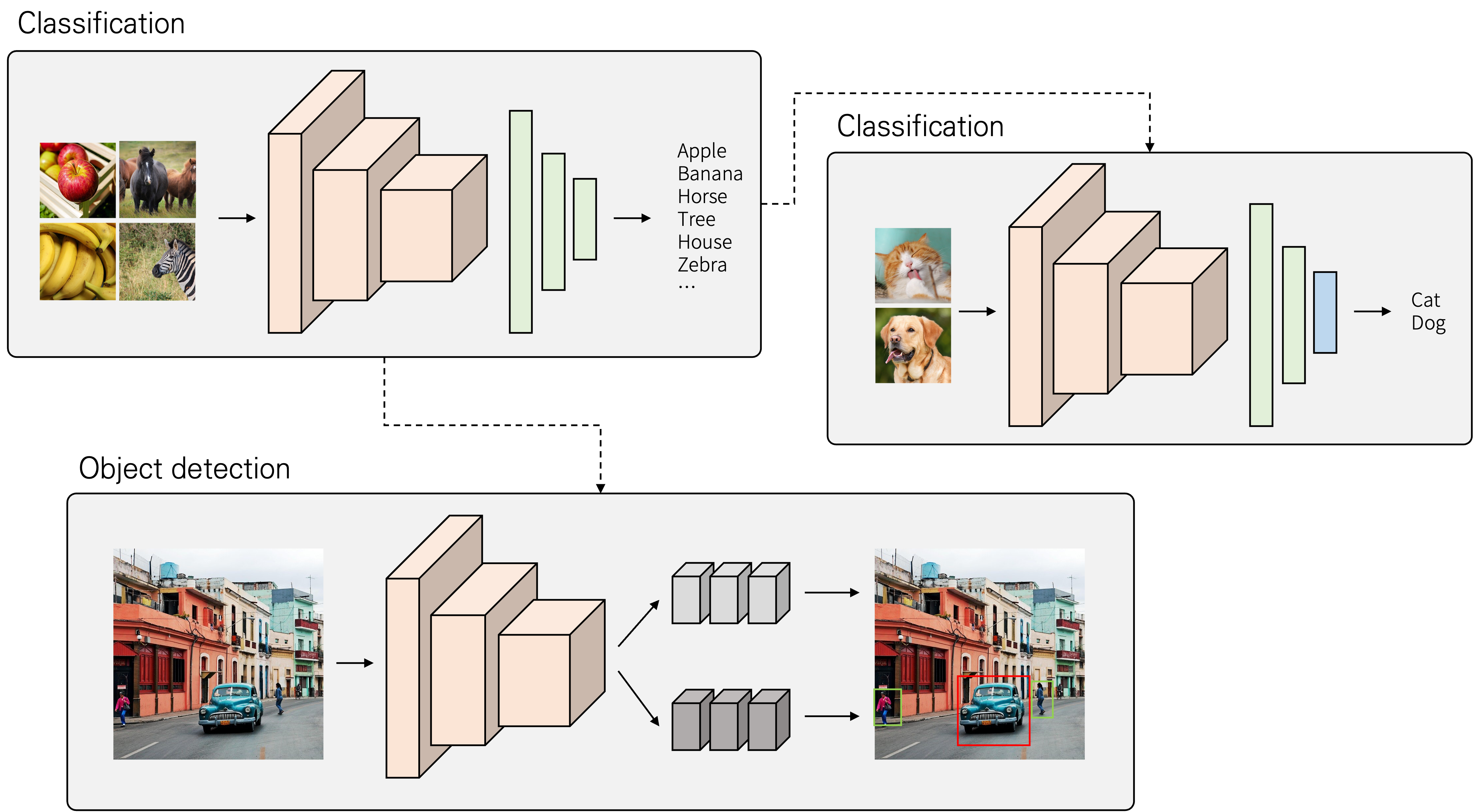

1.[플레이데이터] 4월 17일 오전 수업(stable diffusion, basic CNN Model)

stable diffusion basic CNN Model

2.[플레이데이터] 4월 18일 수업(Google Colab에서 전이학습_CNN.ipynb 실행)

Google Colab 파일 가져오기 기존 딥러닝 모델 활용하기 훈련 데이터 읽기 테스트 데이터 읽기 모델 설계 모델 검증 Dropout 적용하기 전이학습 model3 실행 model 서비스

3.[플레이데이터] 4월 19일 오전 수업(전이 학습 개념, 월-화 수업 복습 및 실습)

python안에는 가상환경(conda, Virtualenv 등이 있고 여기서 Requirement.txt안에 입력한 환경대로 설치해줌) 여기서 하위 종속 패키지는 100개 이상 존재 Model Service -> MSDjangorestframeworkPOST -> De

4.[플레이데이터] 4월 24일 오전 수업 -1(파이썬 클래스)

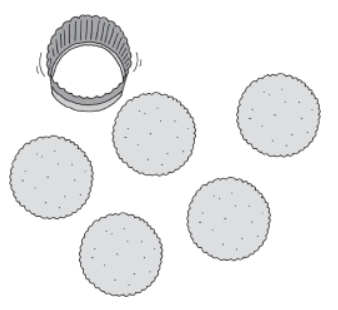

클래스를 가장 잘 설명해주는 그림 과자 틀 -> 클래스과자 틀로 만든 과자 -> 객체 클래스(class)란 똑같은 무엇인가를 계속해서 만들어 낼 수 있는 설계 도면(과자 틀)이고, 객체(object)란 클래스로 만든 피조물(과자 틀로 만든 과자)를 뜻함.여기서 클래스로

5.[플레이데이터] 4월 24일 오전 수업 -2(데코레이터, 프로퍼티, 언더스코어, 정적 메서드, 클래스 상속)

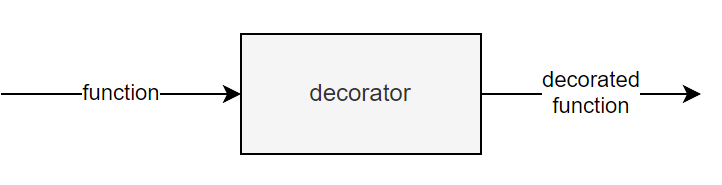

데코레이터란 장식한다는 의미. 어떤 함수가 있을 때 해당 함수를 직접 수정하지 않고 함수에 기능을 추가하고자 할 때 데코레이터를 사용함. 기존 함수를 입력 받아서 기능이 추가된 새로운 함수 객체로 만들어주는 역할 = 데코레이터위의 예제와 같이 이미 선언된 데코레이터 함

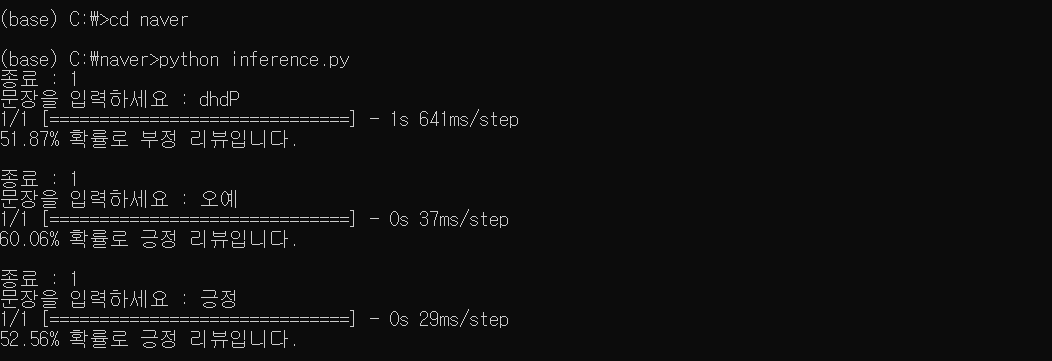

6.[플레이데이터] 5월 22일 수업(airflow 설치, 한글 형태소 분석)

(오전 수업은 혼자공부하는머신러닝 책의 RNN내용이었음. 나중에 혼공머신러닝 따로 정리해서 공부하기 !)pip install konlpy형태소 분석을 위한 파이썬 기본 내장 패키지 다운로드from konlpy.tag import Mecab, Komoran패키지로부터 형

7.[플레이데이터] 5월 23일 수업(LSTM & GRU 셀, airflow 맛보기)

버퍼 오버플로우: 컴퓨터가 처리 가능한 용량을 넘어서 컴퓨터가 바보가 됨 순환신경망의 그레디언트 소실문제 발생 -> LSTM 구조 : 결과값에서 그레디언트 값이 점점 줄어드는 문제를 방지하고자 함 단기기억을 오래 기억하기 위해 고안 (Long Short-Term

8.[플레이데이터] Apache 에어플로우(Airflow)

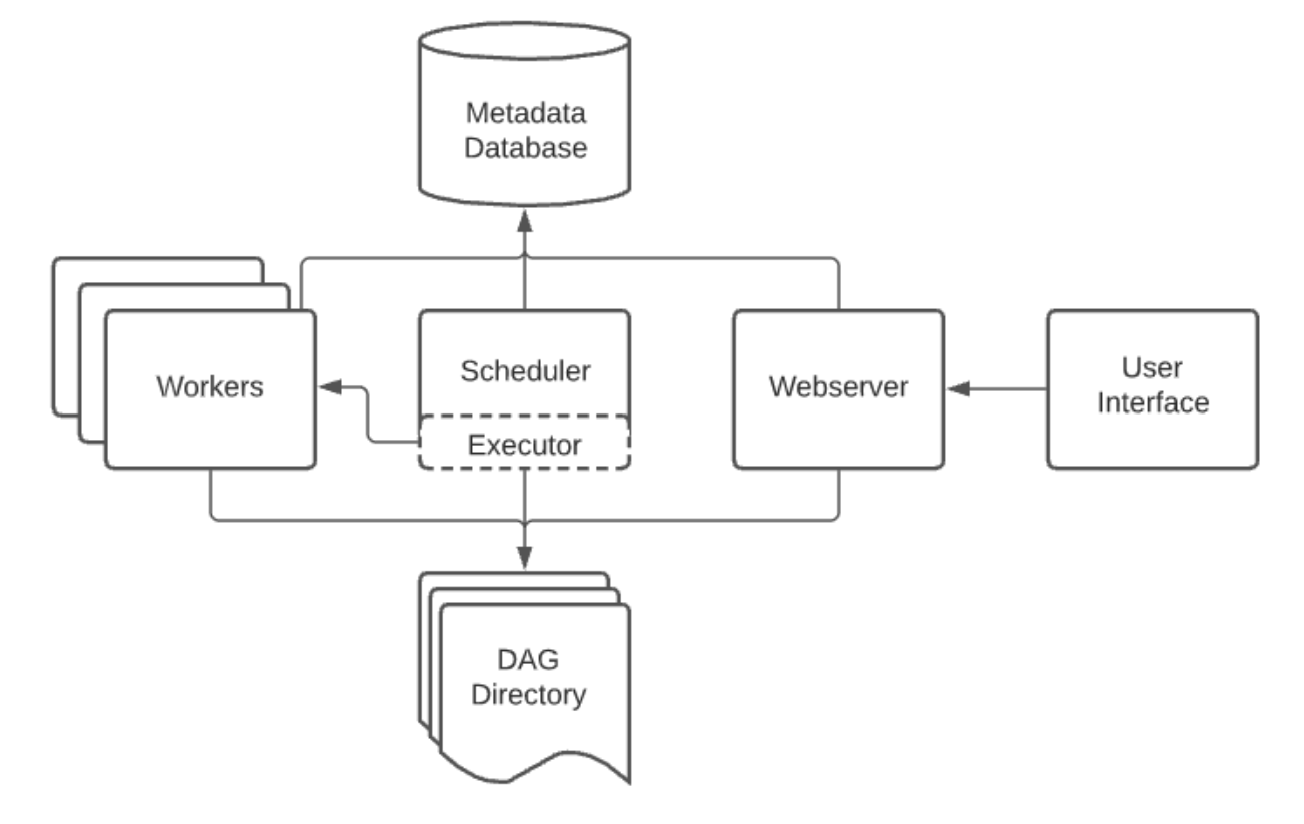

airflow란 AirBnB에서 만든 workflow management tool여기서 workflow는 일련의 작업의 흐름을 의미함예를 들어 ETL 같은 경우, 데이터를 Extractaction(추출) -> Transformation(변환) -> Loading(로드)

9.[플레이데이터] 5월 24일 수업(docker/docker compose에서 airflow 실행하기)

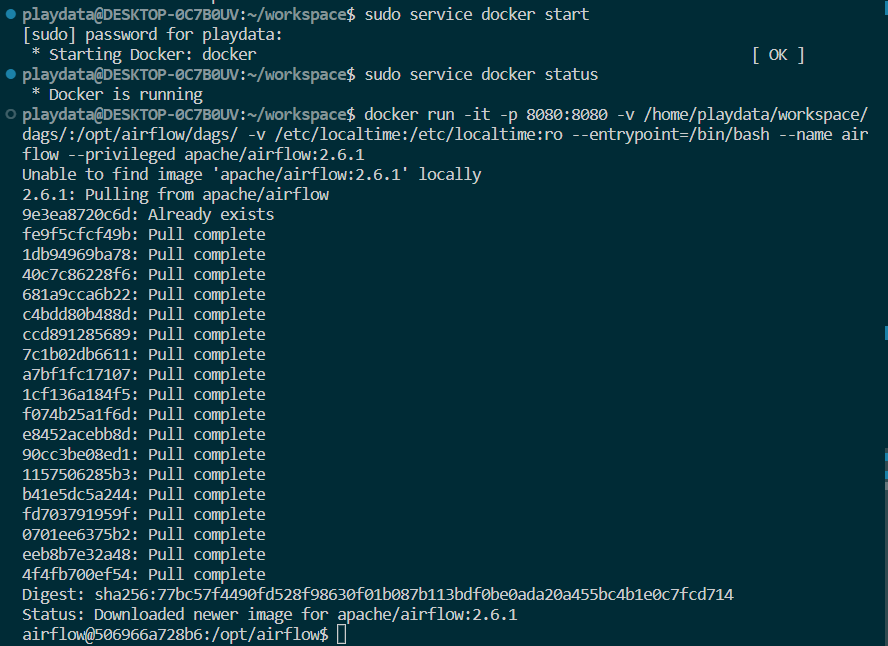

docker startsudo service docker startdocker에서 airflow 설치 및 실행(run)docker run -it -p 8080:8080 -v /home/username/workspace/dags/:/opt/airflow/dags/ -v

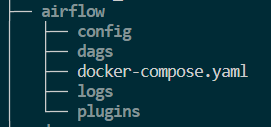

10.[플레이데이터] Docker Compose로 Airflow 개발환경 세팅하기

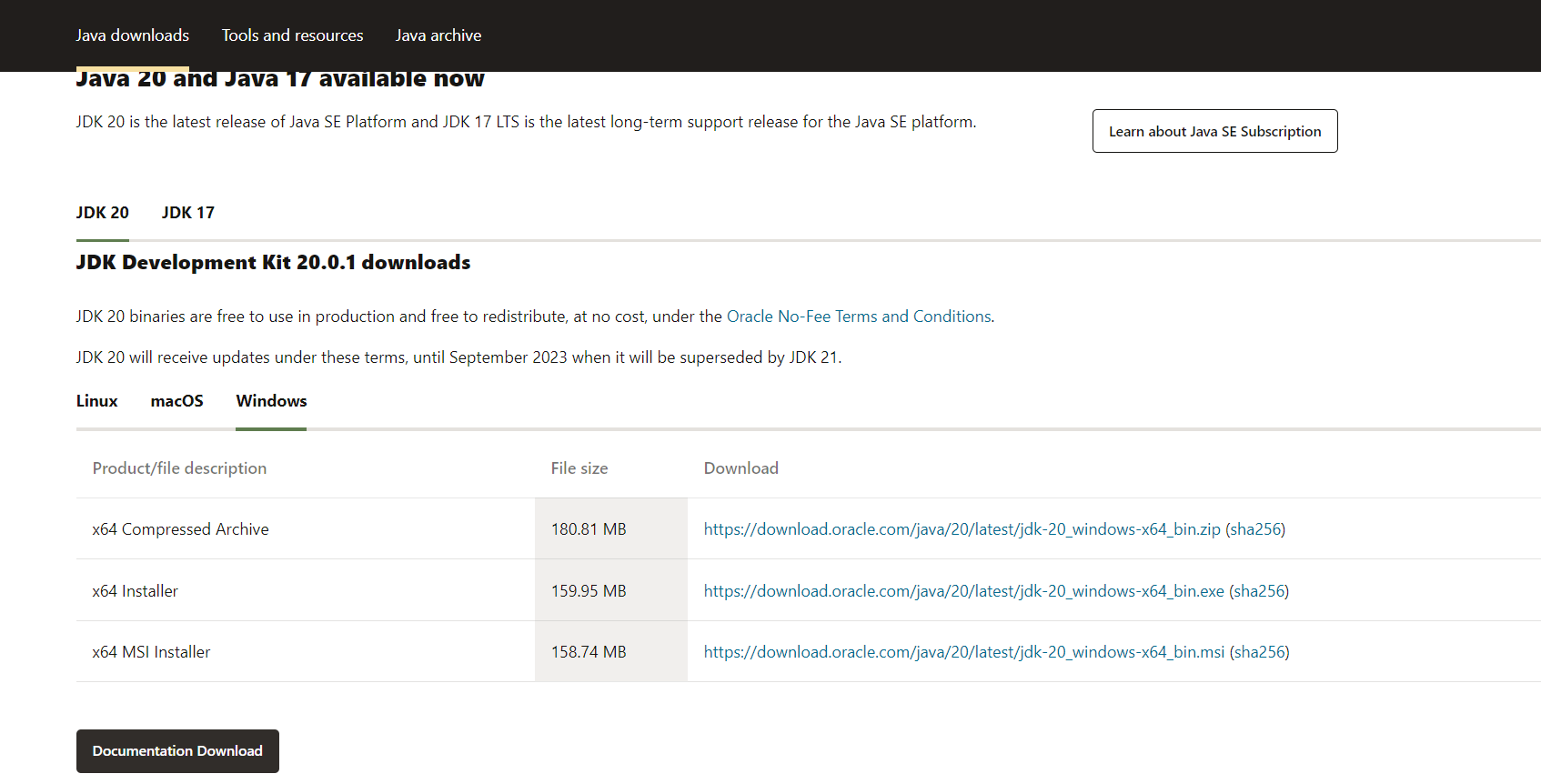

이를 위해 필요한 S/WDockerDocker ComposeLinuxLinux와 Docker를 이용하여 Local에 airflow를 구축할 예정이므로, window 사용자의 경우 Linux와 Docker를 설치해주어야 한다. 나의 경우 이미 설치된 vscode의 wsl

11.[플레이데이터] 5월 25일 수업

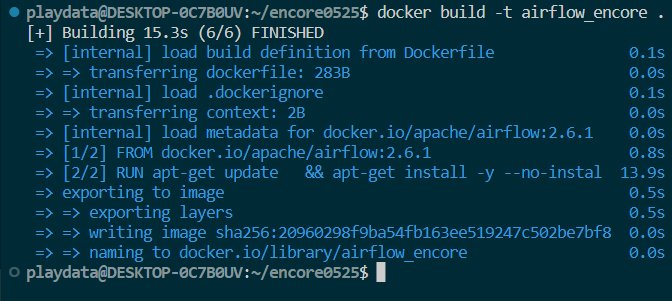

dockerfile안에 들어갈 내용(vim Dockerfile 만들고 안에 입력)이 Dockerfile은 Apache Airflow 2.6.1 버전을 기반으로(이미지를 가져옴), root 사용자로 패키지를 설치한 후, Vim을 추가로 설치함그런 다음 더 이상 필요하지

12.[플레이데이터] 6월 7일 오전 수업

SSO: 통합 인증(=Single Sign-On), 모든 서비스에 접근할 수 있는 SSO ID가 바로 루트 계정AWS Quick Start -> Mac, Ubuntu 등 지원가능한 운영체제 나옴 인스턴스 유형 -> 선택가능한 사양 목록 나옴(시간 당 금액 포함)IAM

13.[플레이데이터] 추천 시스템(MF)

6월 7일 수업 이어서 진행 추천 시스템이란 사용자의 과거 행동 데이터나 다른 데이터를 바탕으로 사용자에게 필요한 정보나 제품을 골라서 제시해 주는 시스템집단의 크기를 극단적으로 줄이면 각 집단이 한 사람이 되고, 이렇게 각 사용자별로 맞춤형 추천과 서비스를 제공하는

14.[플레이데이터] 6월 9일 수업(AWS, Hadoop)

하둡 하둡이란? 하둡은 범용 하드웨어ㄹ 구축된 컴퓨터 클러스터의 아주 방대한 데이터 세트를 분산해 저장하고 처리하는 오픈 소스 소프트웨어 플랫폼 핵심 기능은 장애 허용(fault tolenrance) 확장성을 높이기 위해 장애를 당연히 발생 가능한 일로 간주

15.[플레이데이터] 6월 12일 수업(Hadoop 서버 생성)

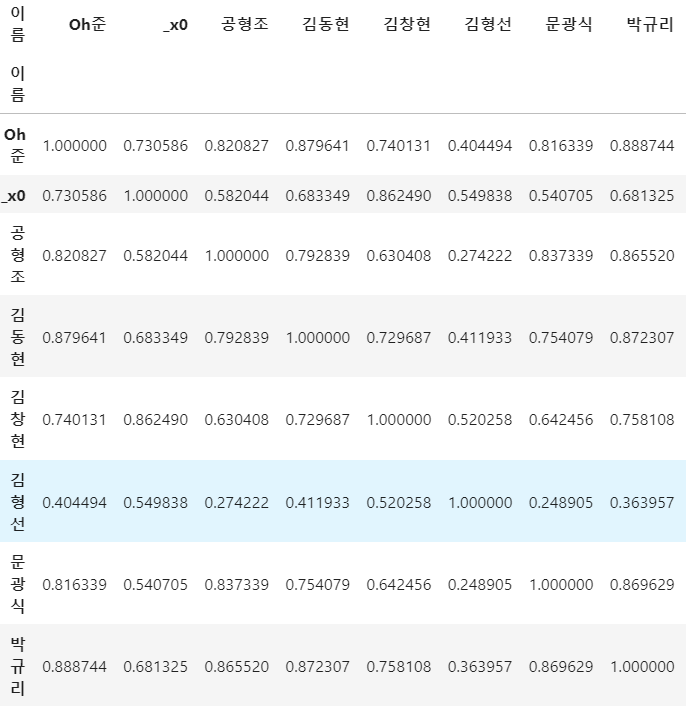

추천을 위한 다양한 알고리즘 분류를 하면 메모리 기반과 모델 기반으로 나눠짐메모리 기반 알고리즘이란 추천을 위한 데이터를 모두 메모리에 가지고 있으면서 추천이 필요할 때마다 이 데이터를 사용해서 계산을 해 추천하는 방식 CF는 대표적인 메모리 기반 알고리즘 모델 기반

16.[플레이데이터] 6월 13일 수업(ECS-VPC 구축)

vpc - vpc - vpc 생성 vpc 생성을 하려면 root 계정 사용자가 권한을 줘야함 사용자 -> AmazonRoute53ResolverFullAccess + AmazonRoute53FullAccess + AmazonVPCFullAccess오케스트레이션?여러개의

17.[플레이데이터] 6월 14일 수업(ECS 구축-cloud9 사용하기)

cloud9을 사용하려면 루트 계정 사용자가 권한을 줘야함 route53fullaccess + route53resolverfullaccess + cloud9user 이거 현재 vpc를 구축하면서 부여한 권한은 다음과 같음여기서 IAMReadOnlyAccess는 IAM

18.[플레이데이터] 6월 15일 수업(Hadoop)

환경파일들 확인저장소 지정 \-cd ~/hadoop/etc/hadoop에서 vim workers 입력 시vim 화면에 datanode1, datanode2, datanode3 입력하고 :wq = datanode는 실제 데이터가 저장되는 곳 파일 복사(scp 사용법)s

19.[플레이데이터] 6월 19일 수업(Hadoop-Hive)

ec2 -> 보안그룹 -> 인바운드 규칙 편집(=보안규칙, 이 보안규칙은 방화벽과 같은 역할)모든 TCP -> 소스 유형은 내 IP(나와 같은 IP만 접속가능하게끔) 근데 이때 내 IP가 스타벅스 wifi처럼 공유 IP이면 해킹의 위험이 있음. 꼭 개인 IP로 할 것

20.[플레이데이터] 6월 21일 수업(Hadoop-Hive-Spark)

자바 코딩으로 집계하는게 아니라 sql쿼리를 만들면 집계를 해주는 hive를 사용Hive를 통해 따로 데이터베이스를 만들지도 않았는데 데이터를 집계가능하게 해줌su hadoop강사님이 올려주신 S3 data를 다운로드 wget https://mydatahive

21.[플레이데이터] 6월 22일 수업(Hadoop-Spark)

데이터 다운로드 cd ~wget https://mydatahive.s3.ap-northeast-2.amazonaws.com/mnm_dataset.csvhdfs dfs 별명 붙이기 vim ~/.bashrcalias hd="hdfs dfs" 추가source ~/.