global mapper

1.Global mapper

RGBD 카메라를 장착한 로봇을 이용해 처음 방문하는 환경을 탐색하면서 글로벌 맵을 구축하는 과정은 로봇공학과 컴퓨터 비전 분야에서 중요한 연구 주제 중 하나입니다. 글로벌 맵을 구축하는 데 있어서 다양한 데이터 표현 방식(Representation)이 사용될 수 있으

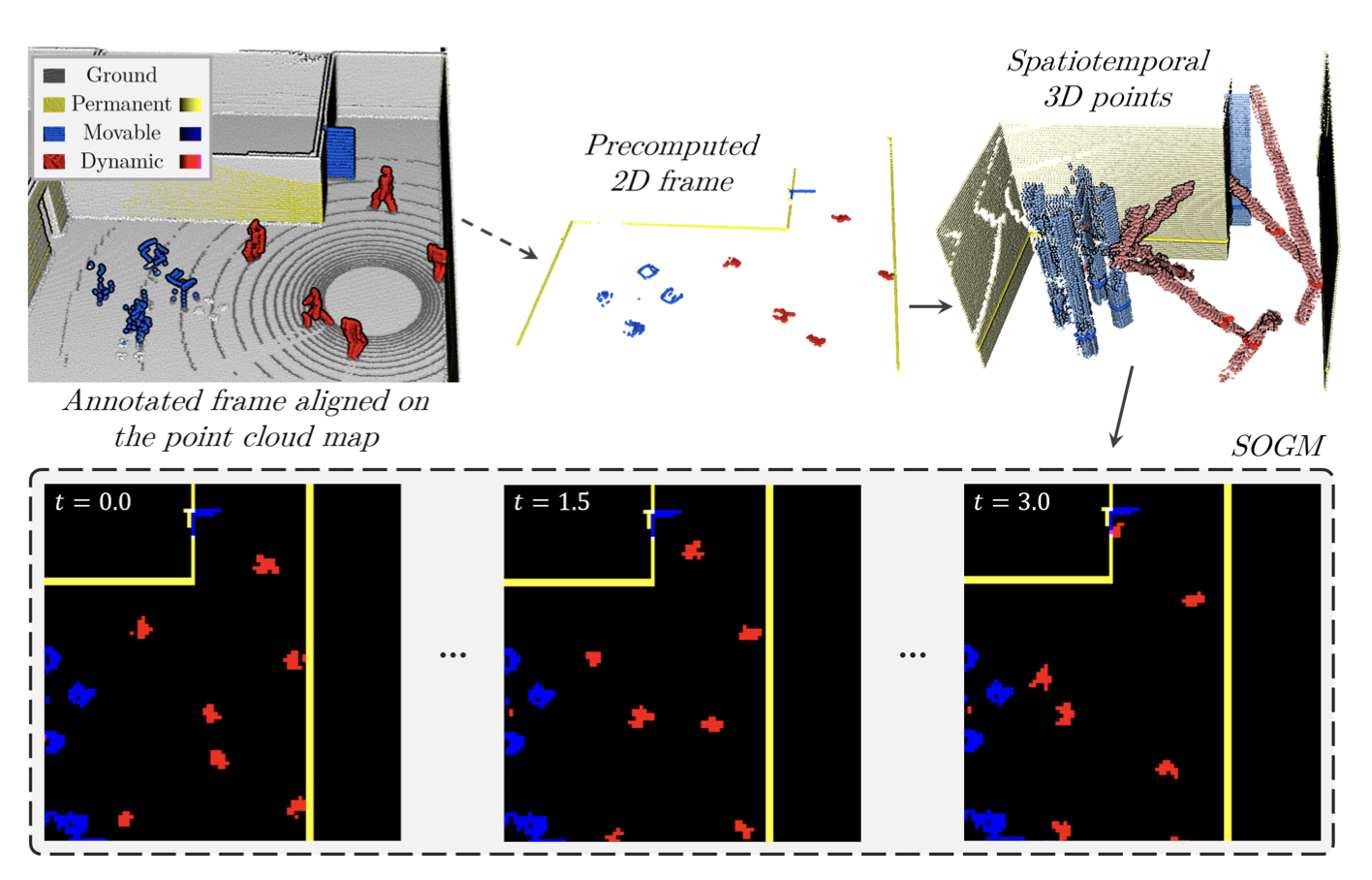

2.Learning Spatiotemporal Occupancy Grid Maps for Lifelong Navigation in Dynamic Scenes

Spatiotemporal Occupancy Grid Maps (SOGM)를 생성/예측/사용 하는 새로운 방법을 제시자동 생성 과정을 통해 이전 항해 데이터로부터 SOGM의 ground truth을 만들어냅니다. 우리의 전 논문은, lidar points를, 그들의 d

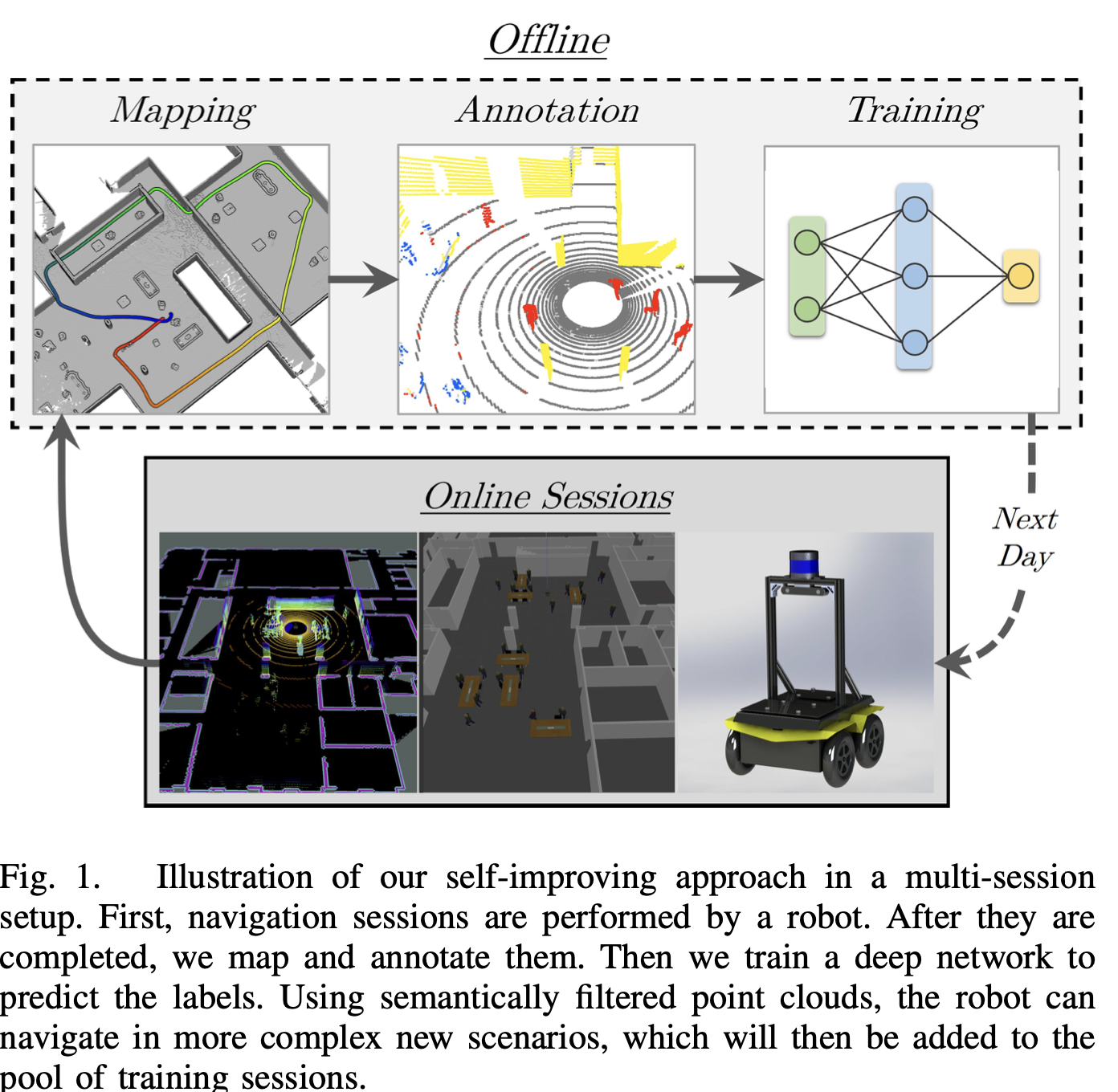

3.Self-Supervised Learning of Lidar Segmentation for Autonomous Indoor Navigation

PointRay를 이용하여, initial map에서 movables를 지웁니다.우리는 RANSAC를 이용하여, ground and permanent points를 얻고, buffer cloud 가 mapping됩니다.ground 나 permanant 둘 다 아닌 po

4.자료조사

SLAM(Simultaneous Localization and Mapping)은 로봇이 알려지지 않은 환경에서 자신의 위치를 추정하고, 동시에 그 환경의 지도를 생성하는 과정SLAM은 이동체가 환경을 탐색하는 동안 지속적으로 센서 데이터를 수집하고 처리하여, 위치와 지

5.[SLAM] key frame 선택

RGB 이미지는 로봇의 pose와 매칭되어 별도로 저장할 수도 있다. (point cloud의 채널에 반영하는 것이 아닌)이때, 아래와 같은 기법들을 통해, 저장되는 양을 줄여서 저장할 수 있다.핵심적인 특징이나 변화가 큰 지점만을 선택적으로 저장SIFT(Scale-I

6.SIFT(Scale-Invariant Feature Transform) / ORB(Oriented FAST and Rotated BRIEF)

SIFT와 ORB는 이미지에서 특징점(예: 모서리, 물체의 윤곽 등)을 찾아내는 데 사용되는 알고리즘이러한 특징점들은 이미지를 인식하고, 다른 이미지와 비교하는 데 중요한 역할다양한 스케일에서의 특징점 찾기: SIFT는 이미지를 여러 스케일(즉, 크기)로 변환하면서 각

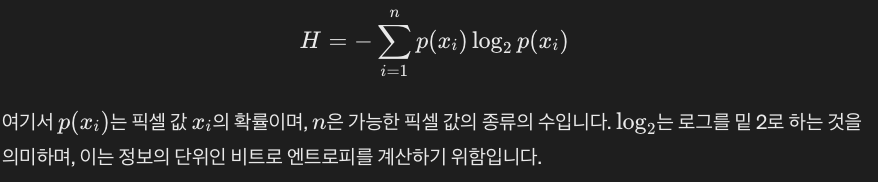

7.Entropy-based Selection / Mutual Information / Optical Flow

엔트로피 기반 선택(Entropy-based Selection)은 이미지의 정보량을 기반으로 중요한 키 프레임을 선택하는 방법이 방식은 이미지 내의 정보의 다양성과 복잡성을 측정하기 위해 엔트로피라는 개념을 사용엔트로피는 정보 이론에서 유래한 개념으로, 시스템의 무질서

8.map matching

RGBD 데이터 정제: RGBD 카메라로부터 수집된 데이터에서 노이즈를 제거하고, 깊이 정보를 정확하게 보정이는 보통 필터링 알고리즘(예: 메디안 필터, 가우시안 필터)을 사용하여 수행특징점 추출 및 매칭: RGB 이미지에서 SIFT, ORB 또는 다른 특징점 검출 알

9.ICP(Iterative Closest Point)

ICP(Iterative Closest Point) 알고리즘은 두 포인트 클라우드 또는 데이터 세트 간의 정합성을 최대화하기 위해 사용되는 알고리즘이 방식은 주로 3D 모델링에서 사용되지만, 2D 데이터 세트, 특히 로봇 위치 추정 및 지도 생성과 같은 분야에서 예측된

10.ICP(Iterative Closest Point) VS AMCL (Adaptive Monte Carlo Localization)

ICP는 데이터 사이의 정밀한 정렬이 필요한 상황에서 강점AMCL은 글로벌 위치 추정과 동적 환경에 더 적합ICP 알고리즘은 주로 센서로부터 얻은 3D 포인트 클라우드나 2D 레이저 스캔 데이터 사이의 정밀한 정렬을 찾는 데 사용이는 로봇이나 다른 장치로부터 수집된 연

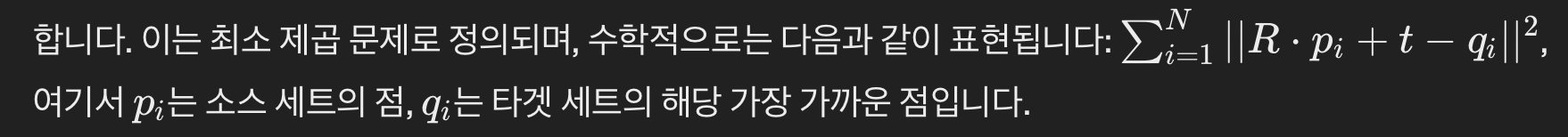

11.Kimera

from SLAM to Spatial Perception with 3D Dynamic Scene Graphs(a) 3D 동적 장면 그래프(DSG): 밀집된 3D 모델(예: metric-semantic mesh) -> 추상화 -> 더 높은 수준의 공간 개념(예: 객체,

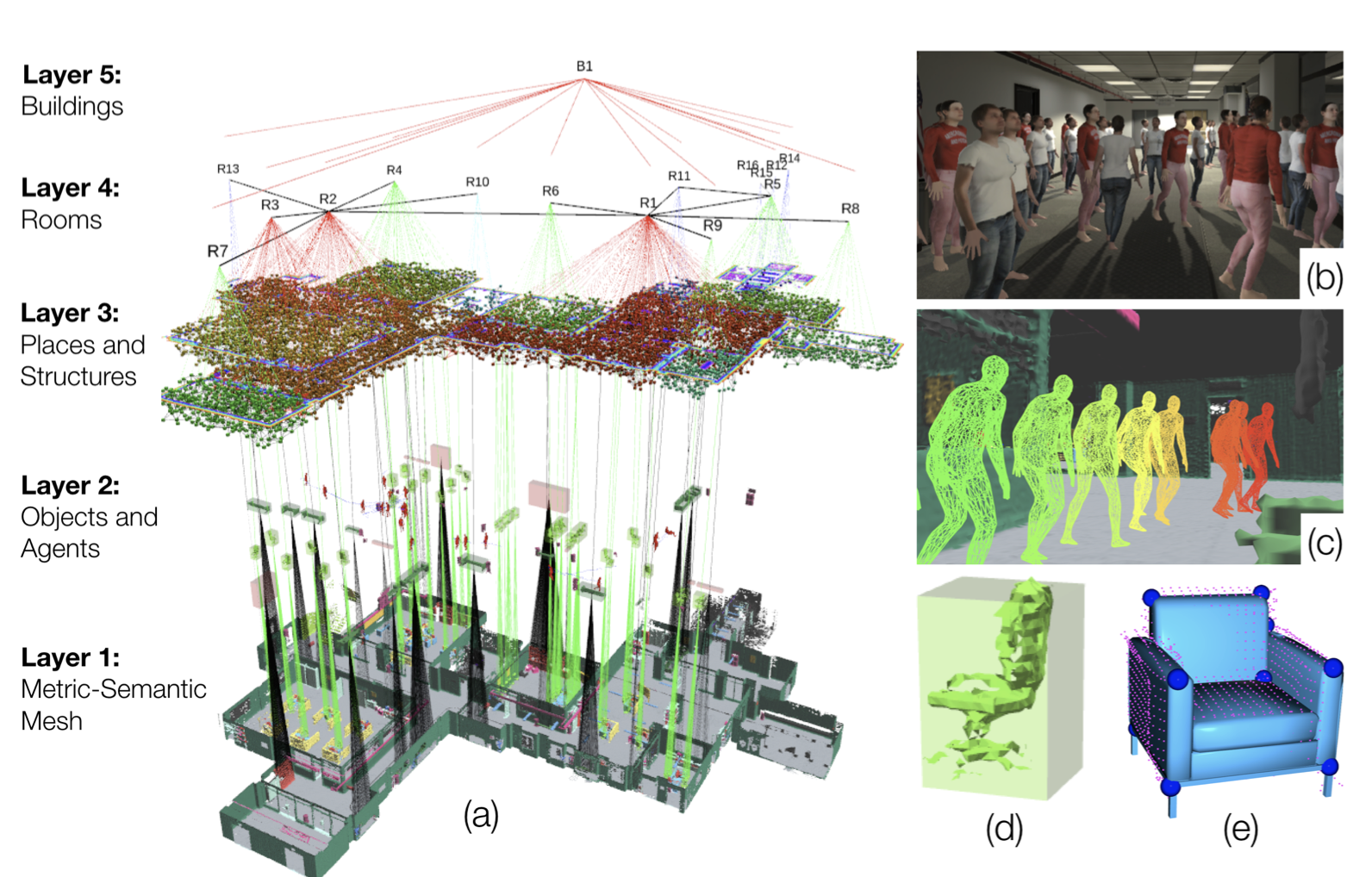

12.[code] Visual Language Maps for Robot Navigation

VLMaps를 구축하기 위해, 우리는 Matterport3D 데이터셋과 함께 Habitat 시뮬레이터에서 10개의 장면에 걸쳐 10개의 RGB-D 비디오 시퀀스를 수동으로 수집RGB-D 비디오를 생성하기 위한 스크립트와 포즈 메타 데이터를 제공다음 몇 단계를 따라 데이

13.Hydra

Hydra: A Real-time Spatial Perception System for 3D Scene Graph Construction and Optimization https://arxiv.org/pdf/2201.13360 https://github.com/MIT-SPARK/Hydra 리뷰 1. 특징 3D semantic 지도를 생성하는 것 뿐만 아...

14.[code] Hydra

Room category classification networks from our most recent paper.https://github.com/MIT-SPARK/Hydra-GNN21년 논문인데, 25회 인용Python bindings around Hyd

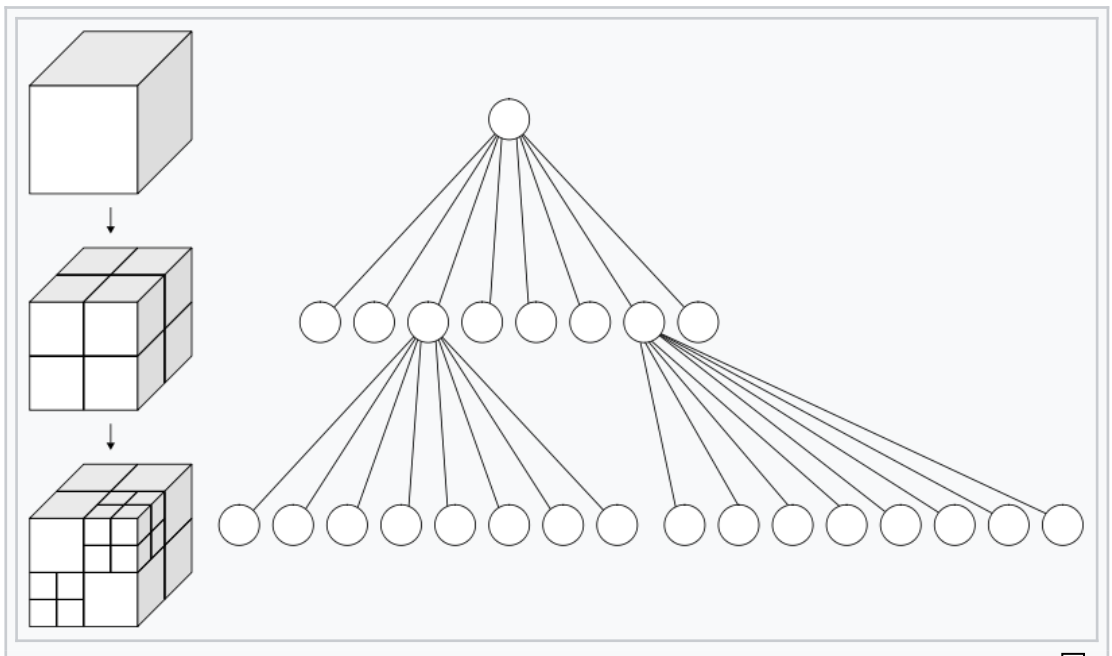

15.DBoW2

DBoW는 이미지 기반의 장소인식을 위해서 장소 이미지를 Bag of word vector의 형태로 변화시키는 라이브러리Bag of word vector는 장소 이미지 사이에 유사성을 비교하기 위해서, 각 이미지의 vector사이에 거리(유사도)를 비교Visual SL

16.Foundations of spatial perception for robotics: Hierarchical representations and real-time systems

17.ConceptFusion: Open-set Multimodal 3D Mapping

https://concept-fusion.github.io https://github.com/concept-fusion/concept-fusion https://concept-fusion.github.io/assets/pdf/2023-ConceptFusion.pdf 0. Abstract semantic concepts을 3D 맵과 통합하는 대부분의 기존 ...

18.Semantic Mapping 어떤 래포를 돌려볼래?

RGBD camera로 3D mapping하는 래포지토리 분석 및 돌려보기3D reconstruction pipeline으로, 30을 따랐음.PointFusion 알고리즘http://reality.cs.ucl.ac.uk/projects/kinect/keller

19.Visual Language Maps for Robot Navigation

우리는 로봇이 복잡한 지시에 따라 길을 찾을 수 있도록 돕는 새로운 방법, VLMaps를 개발 3D 물리적 세계의 재구성과 사전 학습된 시각-언어 특징을 직접 융합하는 공간 맵 표현인 VLMaps이 방법은 인터넷에서 많이 사용되는 이미지와 언어를 결합한 기술을 이용해,

20.[code] ConceptGraphs: Open-Vocabulary 3D Scene Graphs for Perception and Planning

코드베이스가 상당히 리팩토링되어 ali-dev 브랜치에 있음실시간, 간소화된 재구현이 제공되며, iPhone에서 RGB-D 비디오를 지원하고 Rerun.io를 사용한 더 나은 시각화를 제공또한 시작하기 위한 비디오 튜토리얼도 제공됩니다. 꼭 확인해보세요!Jackal 로

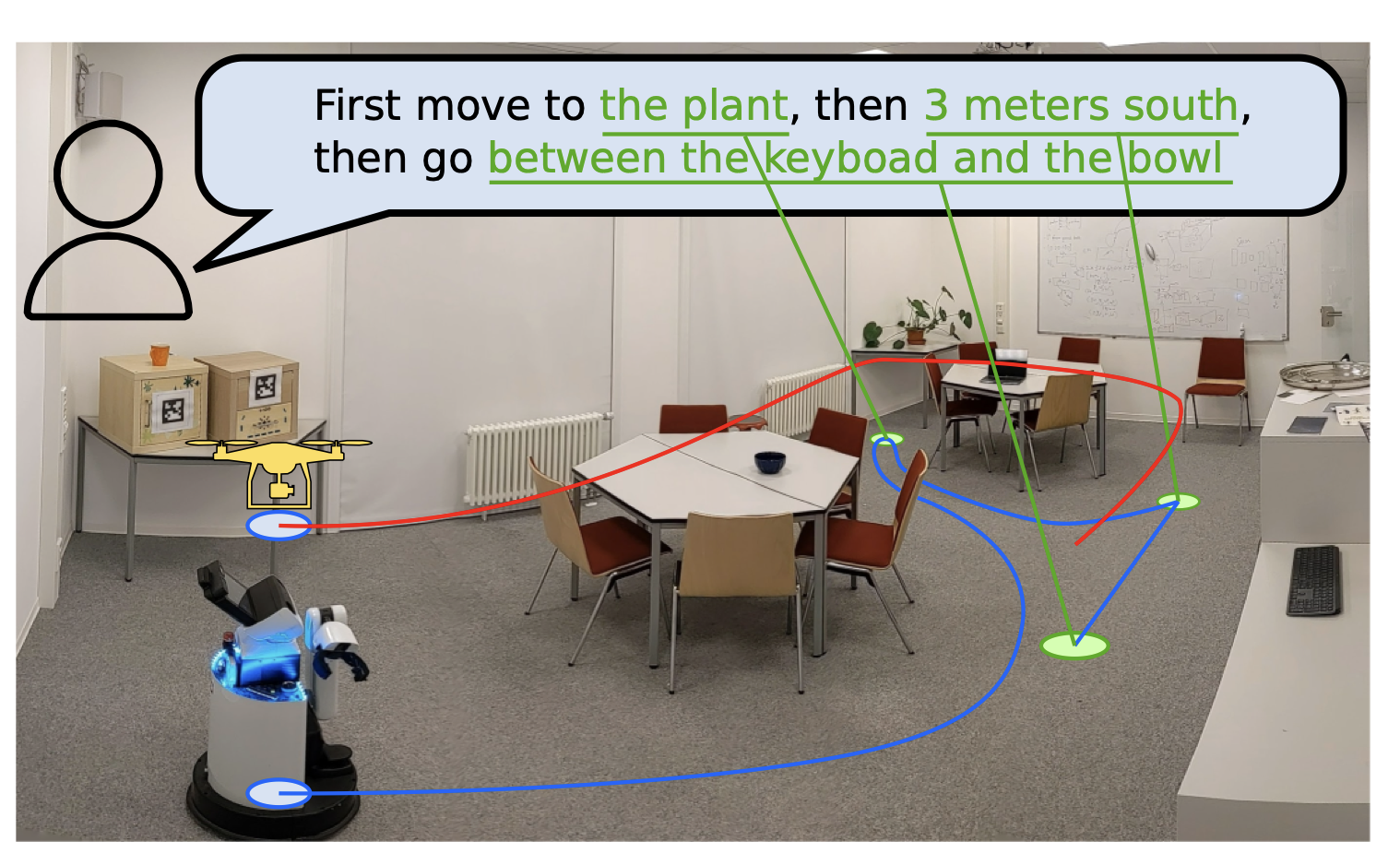

21.Replica dataset

https://github.com/facebookresearch/Replica-DatasetReplica 데이터셋은 다양한 실내 공간의 고품질 재구성 데이터셋각 재구성은 아래를 포함합니다. 깨끗한 dense geometry, 고해상도 및 high dynamic

22.GRAD SLAM

ICPSLAM 클래스는 RGB-D 이미지 시퀀스를 사용하여 SLAM을 수행하는 PyTorch 기반 모듈이 클래스는 RGB-D 이미지 시퀀스를 입력으로 받아서, 포인트 클라우드(Point Cloud)와 카메라의 Pose를 생성입력 파라미터odom: 사용하려는 오도메트리

23.ICPSLAM

1. 전반적 설명 1.1. ICPSLAM 클래스 설명 ICPSLAM 클래스는 RGB-D 이미지 시퀀스를 사용하여 SLAM을 수행하는 PyTorch 기반 모듈 이 클래스는 RGB-D 이미지 시퀀스를 입력으로 받아서, 포인트 클라우드(Point Cloud)와 카메라의

24.PointFusion (ICPSLAM)

1. PointFusion 논문 리뷰 http://reality.cs.ucl.ac.uk/projects/kinect/keller13realtime.pdf 2013, 489회 인용 1.1. abstract Real-time or online 3D reconstructi

25.from gradslam.structures.rgbdimages import RGBDImages

RGB-D 이미지 데이터를 처리하고 관리하는 객체로, 여러 시퀀스의 RGB 이미지, 깊이 맵, 카메라 내부 매개변수(내부 행렬), 및 (선택적으로) 포즈(외부 행렬)를 포함이 클래스는 다양한 입력 형식을 처리하고, 다양한 속성 및 메서드를 통해 데이터를 다룰 수 있도록

26.env_vars.bash.template

env_vars.bash.template 파일: 환경 변수를 설정하기 위한 템플릿 파일환경 변수 설정:이 파일은 프로젝트에서 필요한 환경 변수들을 미리 정의해 두기 위해 사용예를 들어, 데이터베이스 연결 정보, API 키, 비밀 키 등 민감한 정보를 환경 변수로 설정할

27.from gradslam.structures.pointclouds import Pointclouds

Pointclouds 클래스는 3D 포인트 클라우드를 효율적으로 관리하고 조작하기 위한 클래스Pointclouds 클래스는 포인트 클라우드 데이터를 두 가지 형태로 저장할 수 있습니다:리스트 형태: 각 포인트 클라우드를 (N_b, 3) 형식의 텐서 리스트로 저장여기서

28.from conceptgraph.dataset.datasets_common import get_dataset

GradSLAMDataset 클래스는 PyTorch의 Dataset 클래스를 상속받아, RGB-D 이미지와 관련된 데이터를 로드하고 전처리하는 역할이 클래스는 특정 설정에 따라 데이터셋을 준비하여, SLAM(동시적 위치추정 및 지도 작성) 작업에 사용됩니다. RGB-D

29.run_slam_rgb.py

https://velog.io/@jk01019/from-conceptgraph.dataset.datasetscommon-import-getdatasetRGBD data loadpose loadcamera 매개변수 관리 (intrinsic 위주인듯)

30.ICPOdometryProvider

ICPOdometryProvider 클래스는 Iterative Closest Point (ICP) 알고리즘을 사용하여 두 포인트클라우드(Pointclouds) 객체 간의 상대적인 변환을 계산하는 역할이 클래스는 특히 point-to-plane 오류 메트릭을 사용하여 포

31.GradICPOdometryProvider

이 클래스 GradICPOdometryProvider는 두 점 클라우드(Pointclouds) 사이의 상대적인 변환(강체 변환(회전 및 이동))을 계산하는 방법으로, GradICP (Gradient-based Iterative Closest Point) 알고리즘을 사용

32.generate_gsa_results.py

1. generategsaresults.py 1.1. 개요 SAM을 돌린 mask 결과의 bounding box를 가지고, CLIP에 넣어서 feature 뽑음 사진 1장 당 소요 시간 vit_b 기준: 2.74초 걸림 질문: batch로 처리할 순 없으려

33.rerun_realtime_mapping.py

위 코드는 "Grounded SAM" 감지 결과를 3D로 모델링하고, SLAM(동시 위치 추정 및 지도 작성) 파이프라인에 통합하는 작업을 수행이 스크립트는 주로 3D 객체 감지, 추적 및 맵핑 작업을 수행하며, 환경 설정 및 초기화:hydra.main 데코레이터를 사

34.효율적인 SLAM의 representation과 inference 방법

https://www.cv-learn.com/20230214-rosen-2021/http://www.cv-learn.com/20230215-rosen-2021/“SLAM은 local observation을 모아 global model을 만드는 것이다“

35.[code] voxblox

테스트

36.cfslam_pipeline_batch.py

다음 명령어는 위의 image segmentation 결과를 사용하여 object-based 3D map of the scene를 생성합니다.save_objects_all_frames=True를 사용하여, 매 프레임마다 매핑 결과를 저장할 수 있습니다. 이렇게 저장된

37.build_scenegraph_cfslam.py

openai 패키지가 설치되어 있고 APIKEY가 설정되어 있는지 확인하세요. GPT-3.5는 이 작업에서 일관되지 않은 결과를 자주 생성하므로, GPT-4를 사용하는 것을 권장또한 원본 LLaVa 레포에서 다음 줄을 다음과 같이 변경해야 할 수도 있습니다.그런 다음