밑바닥 딥러닝

1.밑바닥 딥러닝

책밑바닥부터 시작하는 딥러닝 - 예스24 강의 영상\[딥러닝I] 15강. 역전파를 통한 학습 구현

2.퍼셉트론

신경망(딥러닝)의 기원이 되는 알고리즘다수의 신호를 입력으로 받아 하나의 신호를 출력뉴런에서 보내온 신호의 총합이 정해진 한계를 넘어설 때만 1을 출력그 한계는 임계값이라고 하며, θ 기호(theta; 세타)로 나타냄퍼셉트론은 복수의 입력 신호에 각각 고유한 가중치를

3.신경망

여러 개의 퍼셉트론이 연결된 구조로 구성되어 있는 것을 신경망이라고 함 활성화 함수 입력 신호의 총합을 출력 신호로 변환하는 함수 a = 입력 총합 h() = 활성화 함수 y = 출력값 시그모이드 함수 x의 값이 커질수록 1보다 아주 작은값만큼의 큰 값이 분모의 값

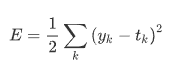

4.신경망 학습

기계 학습 - 모아진 데이터로부터 규칙을 찾아내는 역할은 ‘기계’가 담당 / 이미지를 벡터로 변환할 때 사용하는 특징은 여전히 ‘사람’이 담당신경망 - 이미지를 있는 그대로 학습 > 종단간(end-to-end) 기계 학습일반적으로 오차제곱합과 교차 엔트로피 오차를 사용

5.신경망 학습2

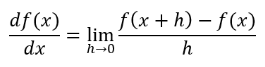

미분 - 특정 순간의 변화량좌변은 f(x)의 x에 대한 미분을 나타내는 기호 → x의 ‘작은 변화’가 함수 f(x)를 얼마나 변화시키느냐를 의미이때 시간의 작은 변화, 즉 시간을 뜻하는 h를 한없이 0에 가깝게 한다는 의미로 lim로 나타냄위 함수는 문제가 없어 보이나

6.신경망 학습3

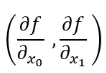

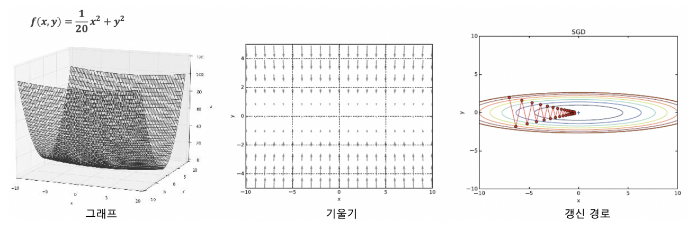

함수 f를 x0과 x1에 대해 동시에 편미분을 계산하면 아래와 같다. 이처럼 모든 변수의 편미분을 벡터로 정리한 것을 기울기(gradient)라고 함기울기 결과에 마이너스를 붙인 벡터위 그림을 통해 아래의 내용을 알 수 있음기울기는 함수의 '가장 낮은 장소(최솟값)'을

7.오차역전파법

앞에 나온 수치 미분은 단순하고 구현도 쉽지만 계산 시간이 오래걸리는 것이 단점매개변수의 기울기를 효율적으로 계산하는 오차역전파법 일단, 경사하강법은 계산이 어려운 함수의 극값의 근삿값을 1차 미분계수를 이용해 찾아가는 방법이다. 이런 방법이 왜 필요할까? 예를 한번

8.오차역전파법2

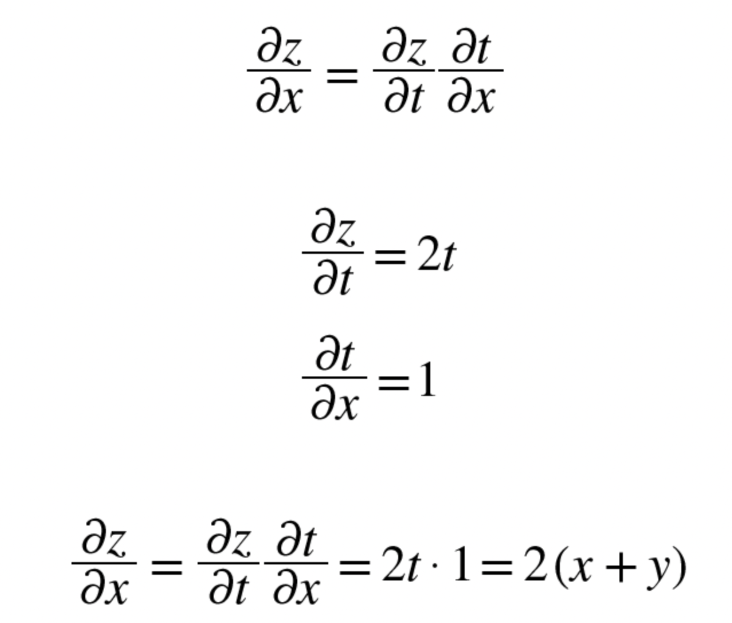

여러 함수로 구성된 함수예를 들어 z = (x + y)^2은z = t^2t = x + y두 개의 식으로 구성됨‘'' 합성 함수의 미분은 합성 함수를 구성하는 각 함수의 미분의 곱으로 나타낼 수 있다 ’''이것이 연쇄 법칙의 원리'dz/dx'는 'x에 대한 z의 미분값'

9.오차역전파법3

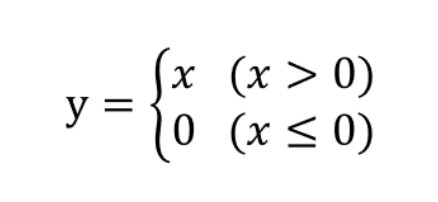

계산 그래프를 신경망에 적용하기Relu 함수 수식Relu 함수 미분x가 0보다 크면 역전파는 상류의 값을 그대로 하류로 흘림x가 0 이하면 역전파는 하류로 신호를 보내지 않음 (0을 보냄)Relu 계층의 계산 그래프시그모이드 함수exp 노드는 y=exp(x) 계산을 수

10.오차역전파법4

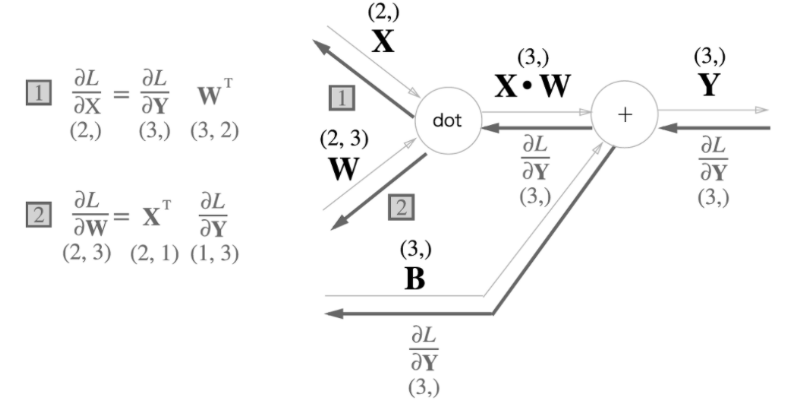

딥러닝에서 Affine 계층은 순전파시 행렬 곱을 수행하는 계층을 의미affine 계층에서의 순전파/역전파 계산 그래프Affine 계층에서 행렬 곱에 대한 역전파는 순전파시 입력 신호를 서로 바꾸어 곱셈입력 신호가 전달되는 과정소프트맥스와 크로스엔트로피를 함께 사용하는

11.학습 관련 기술들

매개변수의 기울기를 구하고 기울어진 방향으로 매개변수 값을 갱신하는 일을 반복하여 최적의 값을 찾는 것단순하고 구현하기 쉽지만 문제에 따라 비효율적일 수 있음위 그림에서 y축 방향은 가파른데 x축 방향은 완만최솟값이 되는 장소는 (0,0)이지만, 기울기 대부분은 그곳을