다중 선형 회귀(Multiple Linear Regression)

- 기존 선형회귀는 X, Y가 하나씩 존재했지만, 다중 선형회귀는 여러개의 특성을 이용하여 종속변수를 예측한다.

- 속성(feature) : 입력변수

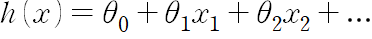

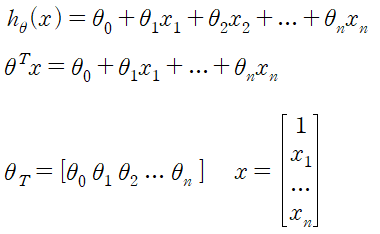

다중 선형 회귀 가설함수

- 입력 변수가 여러개인 일차식

→ 선형대수학의 벡터를 이용하여 가설함수를 표현

다중 선형 회귀 경사하강법

- 다중 선형 회귀에서는 입력변수가 여러개이기 때문에 theta의 값을 모두 업데이트 해주면 된다.

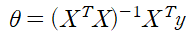

정규 방정식

- 손실함수의 기울기 = 0 이 되는 지점을 방정식으로 표현

- 정규방정식을 이용하여 계산하면 손실함수의 기울기가 0이 되는 theta값을 구할 수 있다.

경사 하강법 vs 정규 방정식

- 보통 입력변수가 많을 때는 경사하강법, 적을 때는 정규방적식을 사용한다.

Convex 함수

- 아래로 볼록한 함수(ex. a>0인 이차함수)

- convex 함수에서는 항상 경사 하강법, 정규 방정식을 이용해서 최소점을 구할 수 있지만 non-convex 함수에서는 구한 극소점이 최소점이라고 확신할 수 없다.

- global minimum에 도달하지 못하고 local minimum에 빠질 수 있다.

- 선형 회귀 손실 함수로 사용하는 MSE는 항상 convex 함수이다.

본 포스트는 코드잇 강의를 공부하며 정리한 내용입니다! 자세한 설명은 "코드잇 머신러닝 강의를 참고해주세요!