boostcamp10week

1.BERT 언어모델

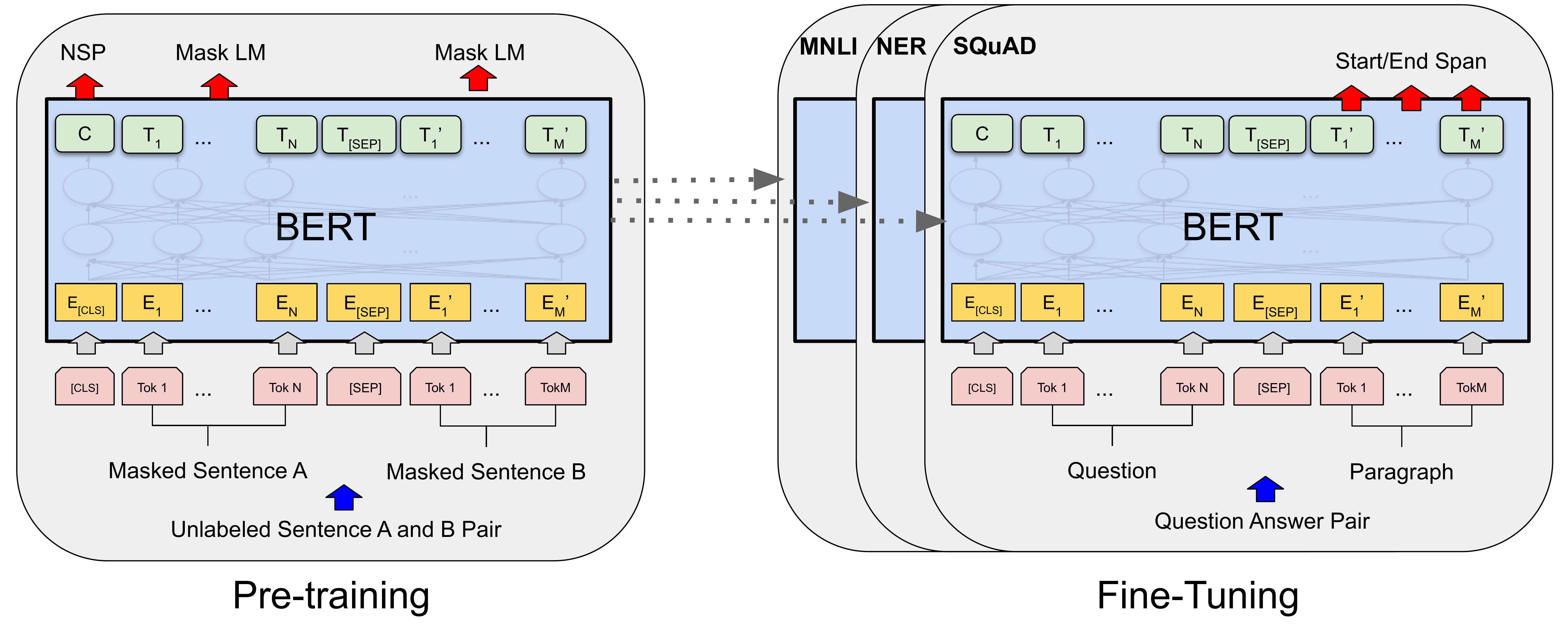

BERT(Bidirectional Encoder Representations from Transformers)는 구글에서 2018년에 발표한 언어 모델로, Transformer 아키텍처를 기반으로 하고 양방향(bidirectional) 학습을 사용하여 이전의 모델보다

2023년 5월 11일

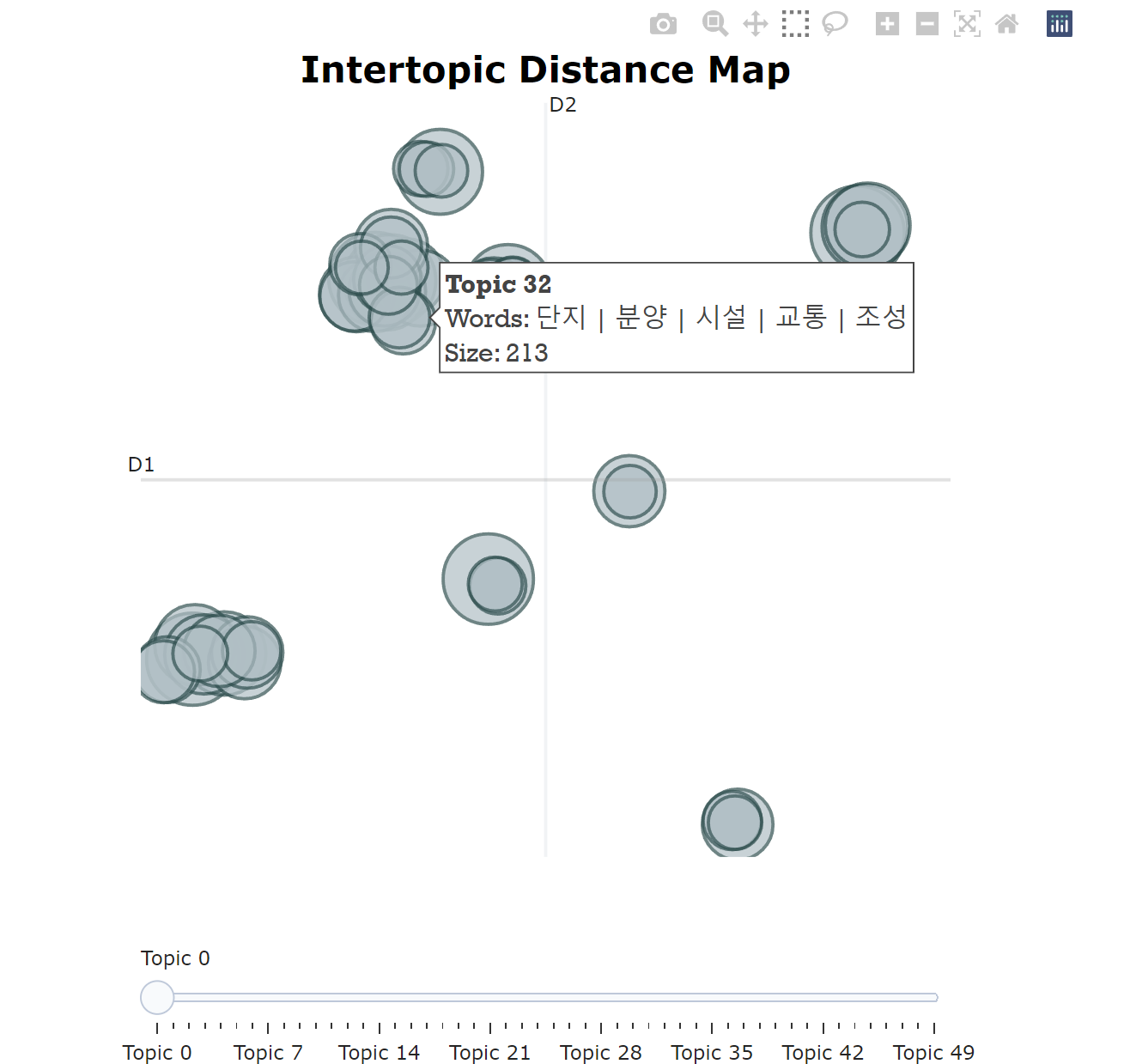

2.KLUE 데이터셋

한국어 자연어 벤치마크(Korean Language Understanding Evaluation,KLUE)KLUE 링크 https://klue-benchmark.com/문장분류관계 추출문장 유사도자연어 추론개채명 인식품사 태깅질의 응답목적형 대화의존 구문 분석

2023년 5월 12일

3.BERT 단일 문장 분류 Task

BERT 문장 분류 Task 감정 분석 주제 라벨링 언어 감지 의도 분류

2023년 5월 13일