Pytorch로 Transformer 구현해보기

1.Pytorch로 Transformer 구현해보기 (1/3)

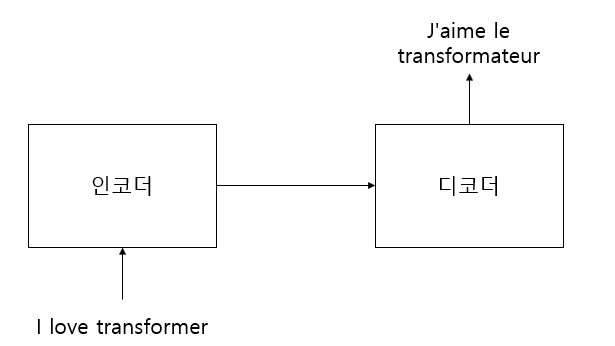

트랜스포머는 자연어처리에서 자주 사용하는 딥러닝 아키텍처 중 하나다. 트랜스포머가 나온 이후로는 RNN과 LSTM를 사용한 태스크는 트랜스포머로 많이 대체되었다. 또한 BERT, GPT, T5 등과 같은 자연어 처리 모델에 트랜스포머 아키텍처가 적용됐다.트랜스포머는 인

2022년 3월 29일

2.Pytorch로 Transformer 구현해보기 (2/3)

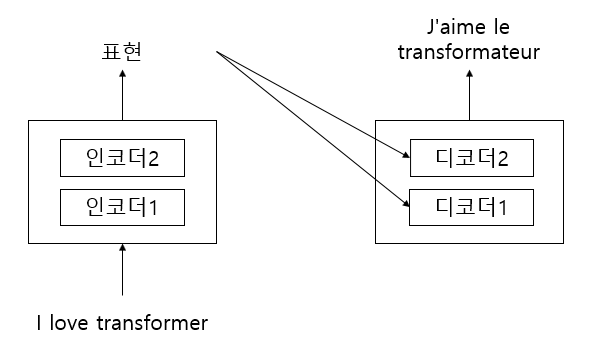

앞선 글에서 인코더는 N개를 누적하여 쌓을 수 있다는 것을 확인했다. 디코더도 인코더와 동일하게 쌓을 수 있다. N = 2로 예를 들면 인코더가 2개 디코더가 2개로 이루어진 트랜스포머 모델이 만들어진다.디코더에서는 시간 스텝 t = 1이면 디코더의 입력값은 문장의 시

2022년 3월 31일

3.Pytorch로 Transformer 구현해보기 (3/3)

트랜스포머의 구조는 N개의 인코더와 디코더가 쌓여있고 입력 문장(소스 문장)을 입력하면 인코더에서 해당 문장에 대한 표현을 학습시키고, 그 결과값을 디코더에 보내면 디코더에서 타깃 문장을 생성한다.디코더는 vocab에 대한 확률 분포를 예측하고 확률이 가장 큰 단어를

2022년 4월 1일