1. 의사결정나무 (Tree Decision) 이어서

(1) desc:

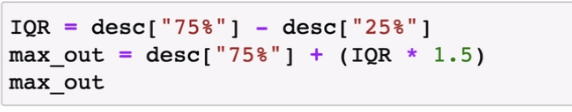

(2) quantile: 25%와 75% 값을 가져와서 활용

2. Ensemble methods

저성능 분류기들을 결함시키는 방법이다. 과반수 투표를 진행한다. 배깅(분산 감소시키기), 부스팅(편향 사용), 스태킹(stacked generation) 등의 접근법이 있다.

3. Bagging

(1) 정의: Bootstrapping(표본추출) + Aggregating(집계)

(2) original datat > bootstrap > aggregating > bagging의 순서이다.

(3) "비상관화": 표본 추출 후 서로 다른 데이터셋을 훈련시킨다.

(4) Baser learner(기초 분류기)들을 집계.

4. Random Forest

(1) n_jobs: 사용할 코어 수 지정 (-1은 전체 사용을 의미)

(2) plot_tree를 그리는 것이 불가능하다.

(3) 트리구조 + 매개변수를 동시에 학습 가능하다.

(4) 결정트리보다 노이즈에 강함. 여러 트리의 평균이기 때문.

(5) 포레스트 크키 = 트리 개수 = T

(6) 최대 허용 깊이 = 최대 몇 개의 노드(test)를 거칠 지 설정 = D

(7) 변수의 중요도를 확인할 것: 가장 중요한 파라미터는 n_boot

5. 보스턴 집값 데이터셋 삭제

(1) B라는 피처가 인종차별적 요소를 담고 있음

(2) 사이킷런 라이브러리에서 제외된 바 있음