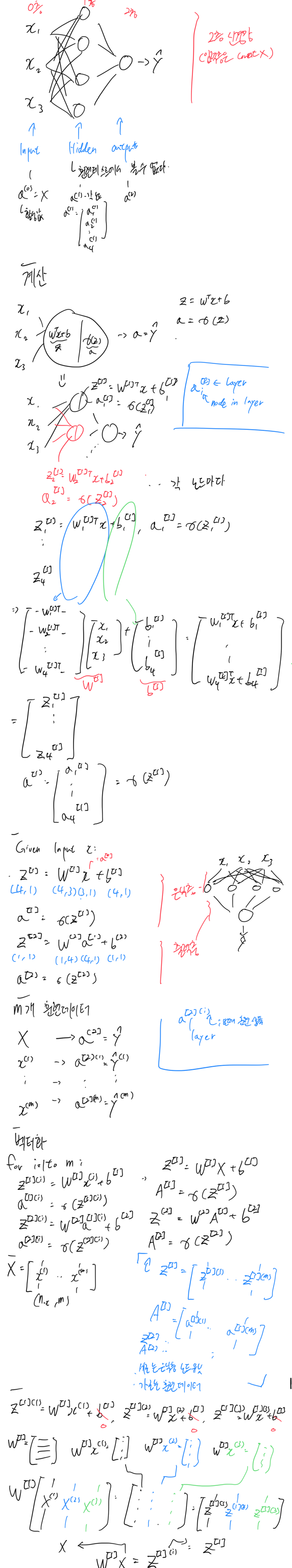

- 신경망 네트워크

이전에 배운 로지스틱 하나의 노드가 중복되어 신경망을 구성

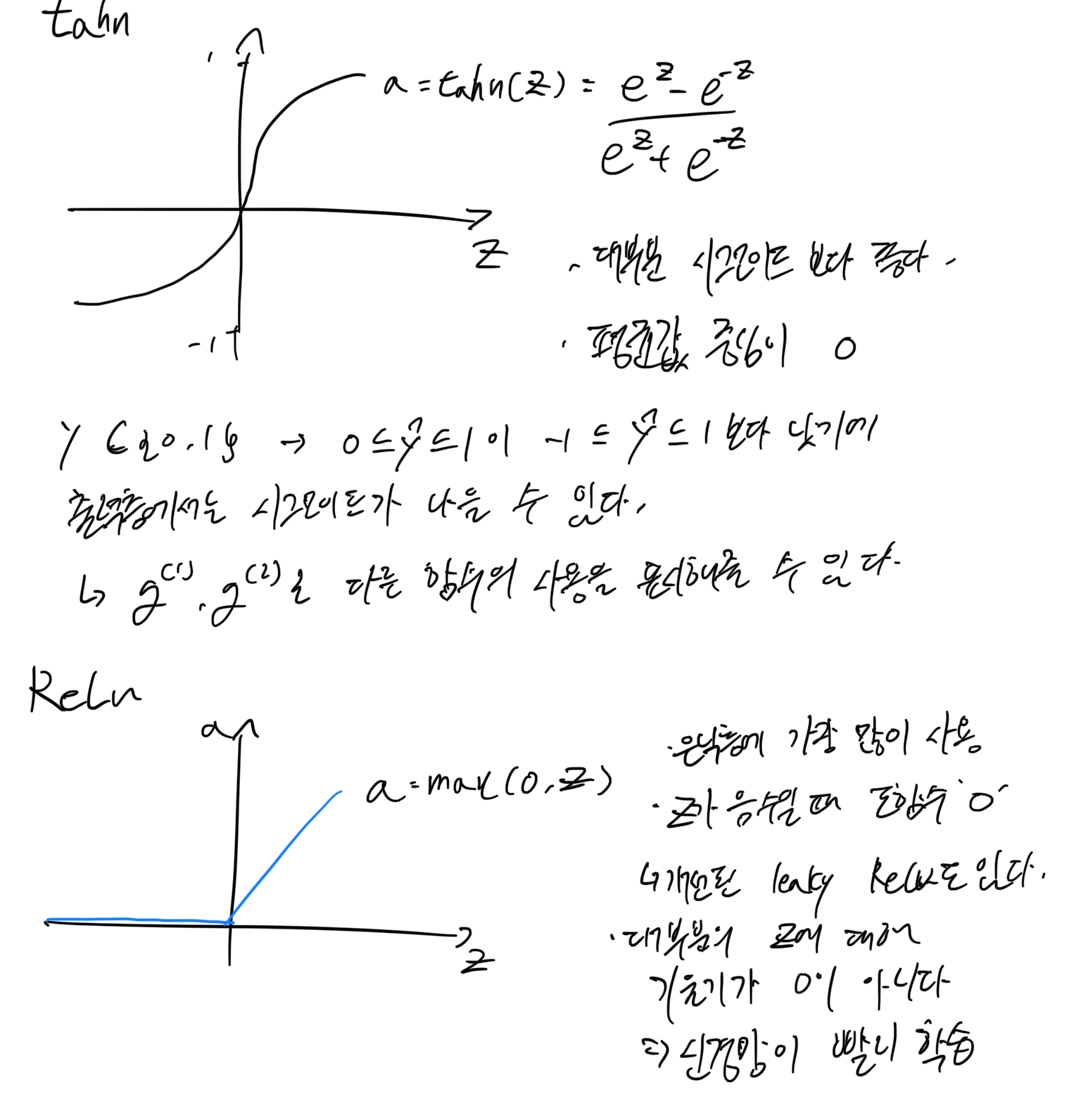

- 활성화 함수

여태까지 시그모이드 함수를 사용했지만 실제로

은닉층과 출력층에서 어떤 활성화 함수를 쓸 지 선택해야한다.

신경망이 비선형 활성함수를 필요로 하는 이유

-

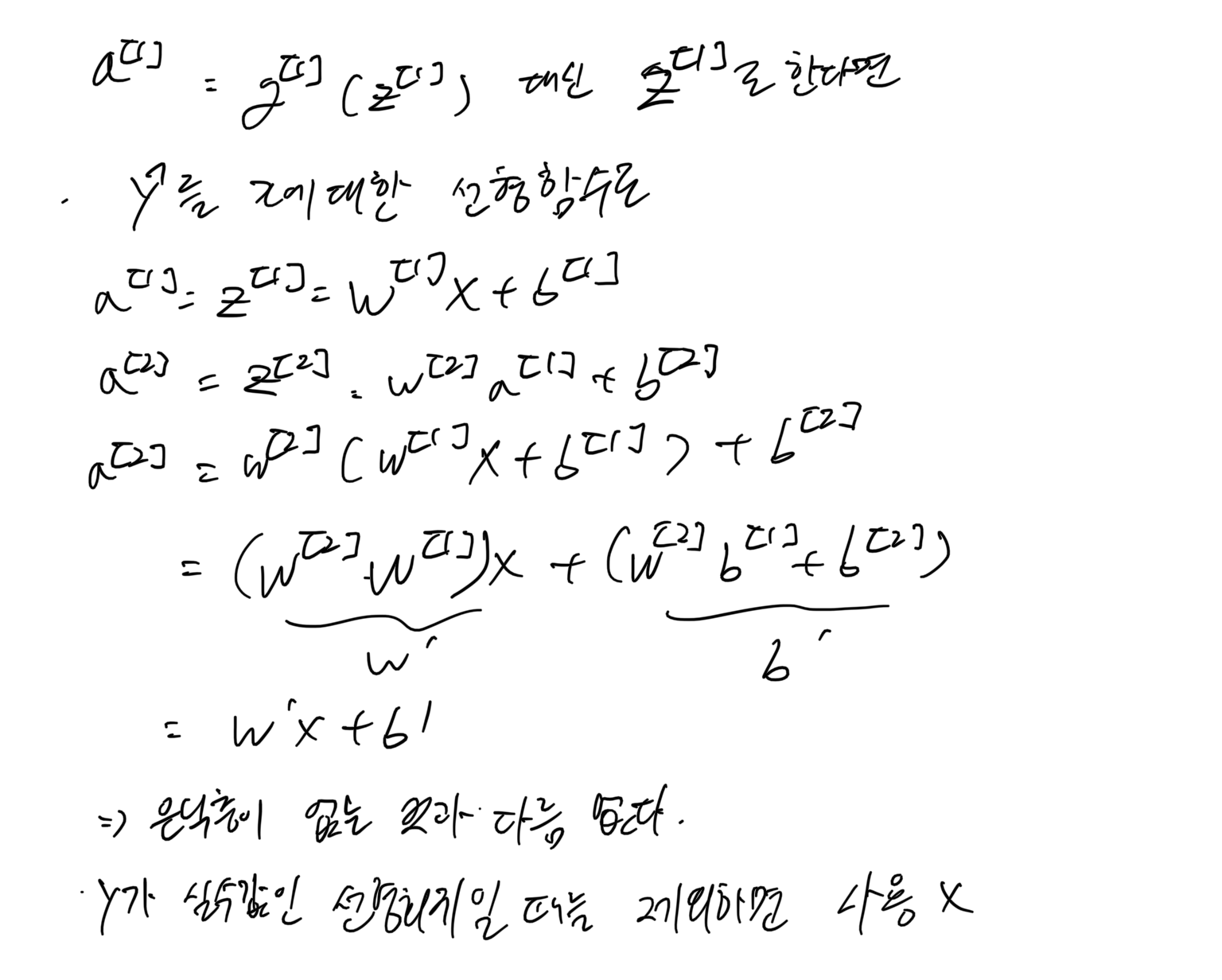

역전파

-

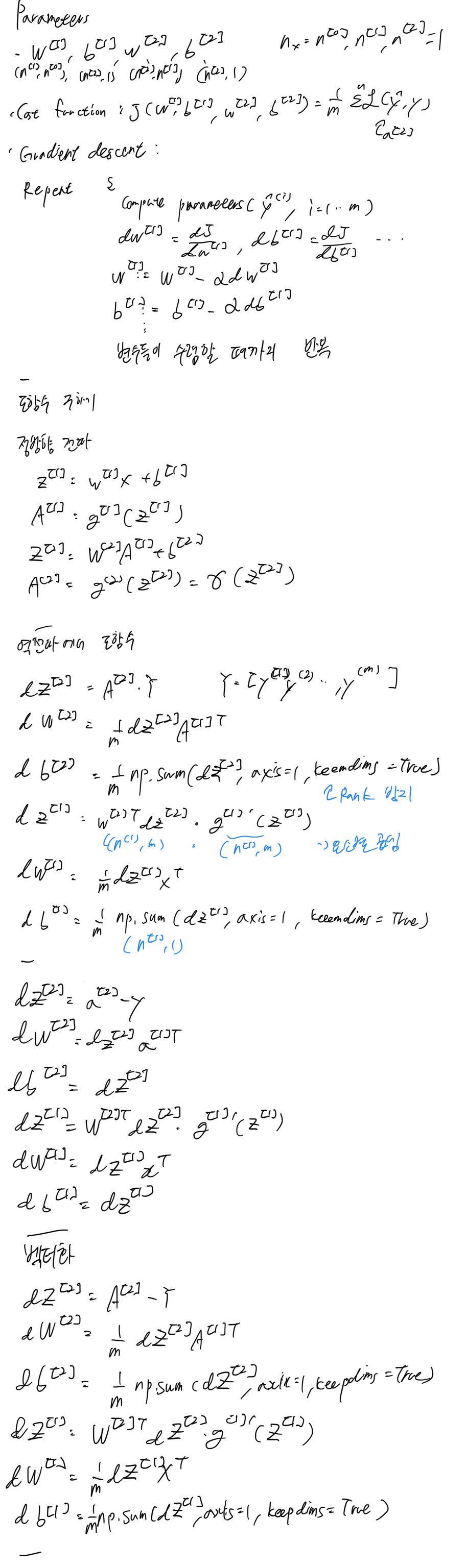

랜덤 초기화

신경망에서 w 의 초기값을 0으로 설정한 후 경사 하강법을 적용할 경우 올바르게 작동하지 않습니다.

- dw 를 계산했을 때 모든 층이 같은 값을 가지게 되기 때문

- np.random.rand()를 이용해 0이 아닌 랜덤한 값을 부여해줘야 합니다.