03-1. K-최근접 이웃 회귀

회귀 문제

- 정의: 데이터를 특정 수치로 예측하는 문제

- 예: 집값 예측, 키·몸무게 예측 등

- 분류 문제와 달리 타깃값이 연속적인 실수값

K-최근접 이웃 회귀

-

가장 가까운 k개의 이웃 샘플의 타깃값 평균을 예측값으로 사용

-

모델 클래스:

KNeighborsRegressor(사이킷런 제공) -

성능 측정: 결정계수(R²)

- 1에 가까울수록 예측력이 좋음

- 0에 가까우면 성능 낮음

- 공식:

R² = 1 - (예측 오차 제곱합 / 타깃 편차 제곱합)

과대적합 vs 과소적합

- 과대적합(overfitting): 훈련 성능은 좋고, 테스트 성능은 낮음

- 과소적합(underfitting): 훈련과 테스트 모두 성능이 낮음

사용 함수

train_test_split(): 데이터 분할mean_absolute_error(): 평균 절댓값 오차 계산reshape(): 배열 형태 변환

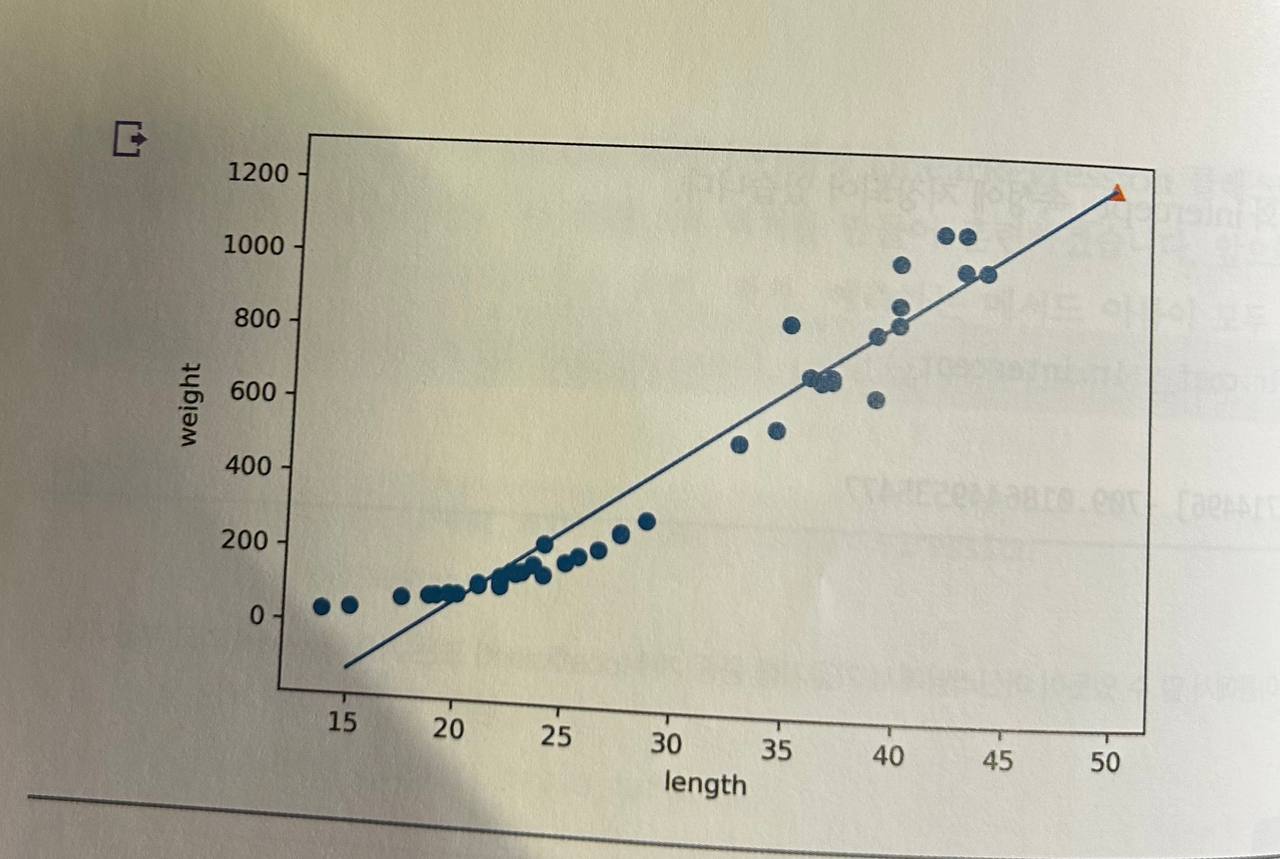

03-2. 선형 회귀

선형 회귀

- 특성과 타깃 간의 관계를 가장 잘 표현하는 **직선 방정식(선형 함수)**을 찾음

- 예:

y = a * x + b형태

개념

- 모델 파라미터: 학습 과정에서 찾은 계수(weight), 절편(bias)

coef_: 가중치 (기울기)intercept_: 절편

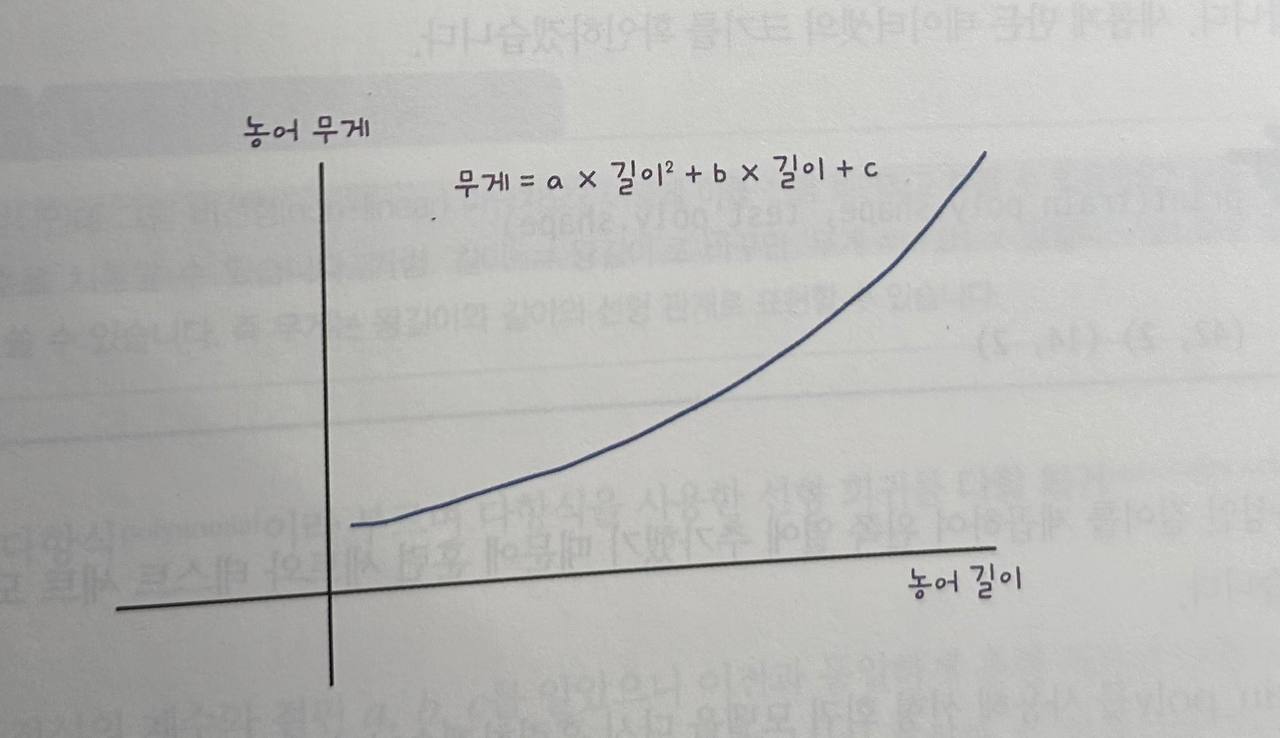

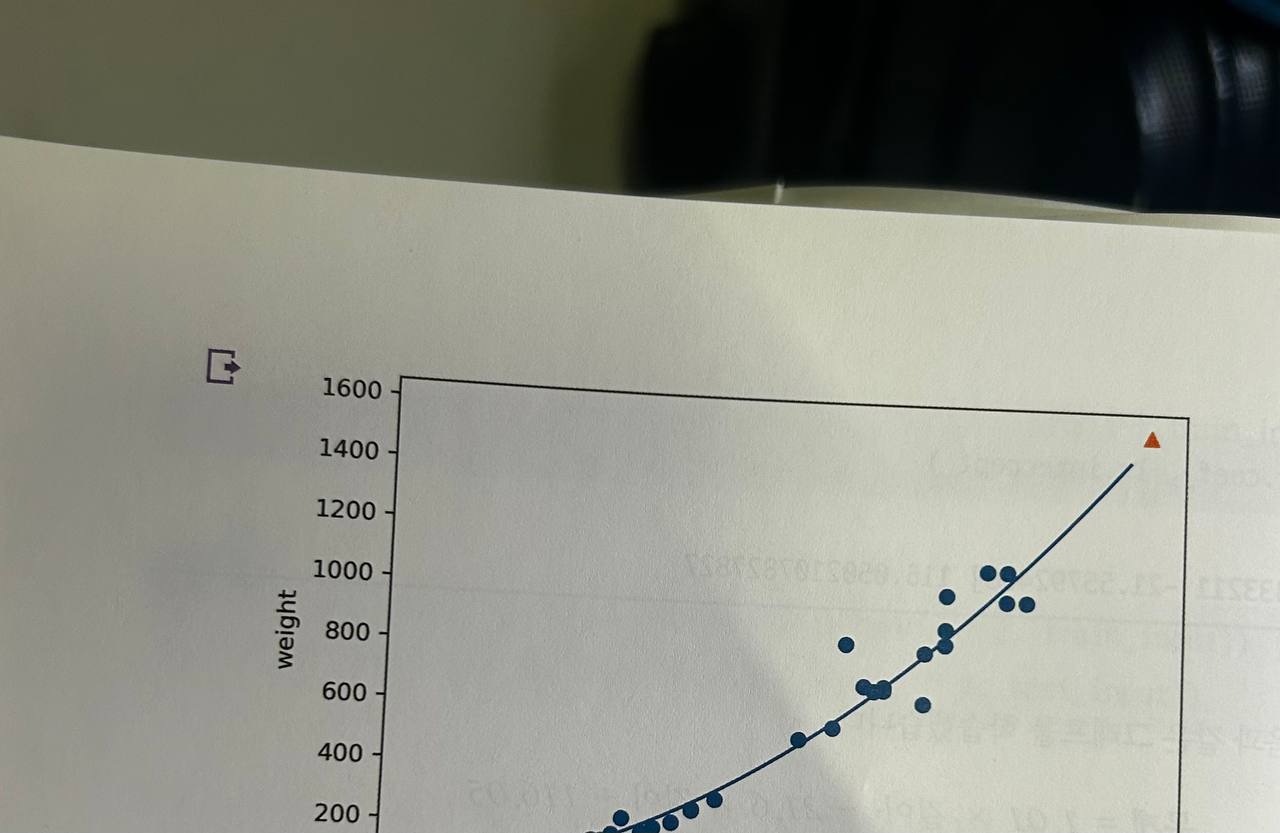

다항 회귀

- 선형 회귀의 확장

- 특성을 다항식으로 확장해 복잡한 관계를 모델링

03-3. 특성 공학과 규제

다중 회귀

- 하나의 타깃을 여러 개의 특성(feature)로 예측하는 회귀

특성 공학

-

원래의 특성들을 조합해 새로운 특성 생성

-

함수:

PolynomialFeatures(사이킷런)degree: 다항식 최고 차수 지정include_bias=False로 절편 항 제거 가능

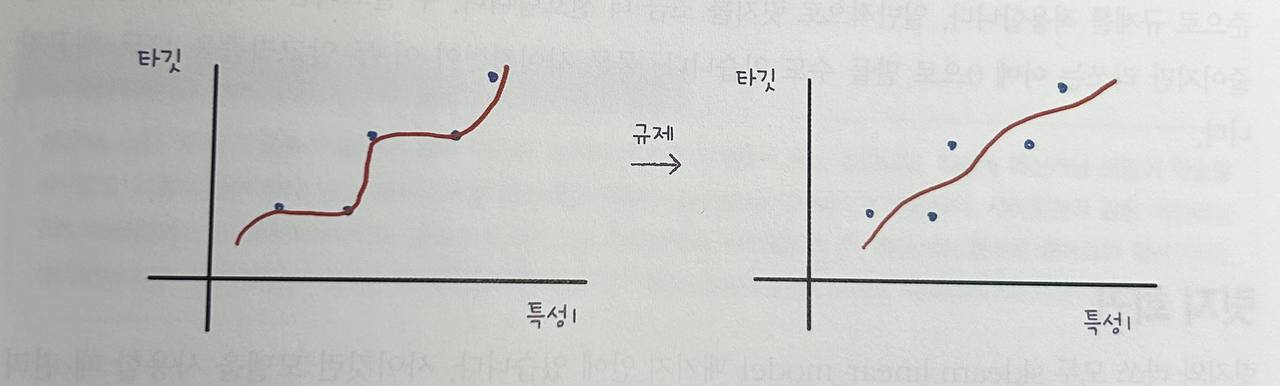

릿지(Ridge) 회귀

- 선형 회귀 + 규제 항 추가

- 계수를 작게 만들어 과대적합 방지

- 하이퍼파라미터:

alpha(규제 강도) - 모델 클래스:

Ridge - 규제가 있는 회귀 알고리즘인 릿지 회귀 모델을 훈련 (alpha 매개변수로 규제의 강도를 조절)

라쏘(Lasso) 회귀

- 계수를 0으로 만들어 불필요한 특성 제거 가능

- 변수 선택(Feature Selection)에 유리

- 모델 클래스:

Lasso - 하이퍼파라미터:

alpha,max_iter

용어 정리

- 하이퍼파라미터: 모델이 직접 학습하지 않고 사용자가 지정하는 파라미터

- 규제(Regularization): 모델이 훈련 데이터에 과도하게 적합하지 않도록 제한하는 기법

데이터 다루기

-

read_csv(): CSV 파일을 읽어 판다스 데이터프레임으로 불러옴sep: 구분자 지정 (기본값은 콤마)