공공API 활용하여 DW 구축 및 BI 대시보드 만들기

1.혼자하는 프로젝트- 1

데이터 파이프라인을 만들어 보고 싶다고 생각해서 뭘 할까 생각하다가...어려운건 어짜피 못하니까 쉽다고 생각한것 중에서 그나마 가장 할만한게 공공 API를 이용해서 데이터를 매일 받아오고 저장하고 대시보드에 보여준다? 정도만 생각하고 시작했다.

2.계획(?) 잡기

대강 어떻게 작동되는 걸 만들까 고민했다.물론 회사에서 어떻게 하는지 알면 좋겠지만... 취준생이니까 최대한 구글링 해서 해보자!이런 생각으로 내가 만약 데엔이면 데싸에게 어떻게 줄까?를 고민해봄따릉이 정보를 가져와서 분석 결과를 볼 수 있게 만들기하루에 한번 결과를

3.따릉이 데이터 저장

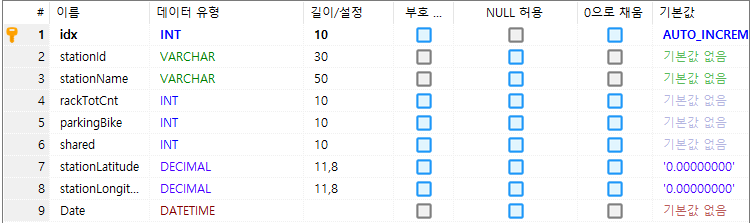

공공API에서 데이터를 받아서 SQL에 넣어주는 작업을 진행중이다...먼저 API를 사용하려고 사용 신청을 했다.현재로써는 python말고는 사용할줄 몰라서 python으로 코드를 작성일단은 이렇게 했는데 추후에 바뀔수도 있음넘어오는 데이터는 다 넣어주었다.코드가 무진

4.따릉이 데이터 저장 - bulk 사용

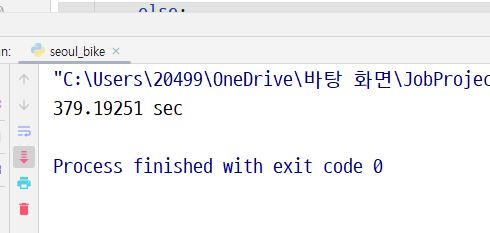

하루 데이터가 68928건이라 한줄 한줄 넣으니까 너무 오래 걸려서 bulk방식(?)으로 넣어보았다.딕셔너리에 모든 데이터를 담고 데이터프레임으로 만들어서 쿼리를 날렸다.bulk 미사용bulk 사용시간 차이가 엄청나게 많이 났다.

5.날씨 데이터 저장

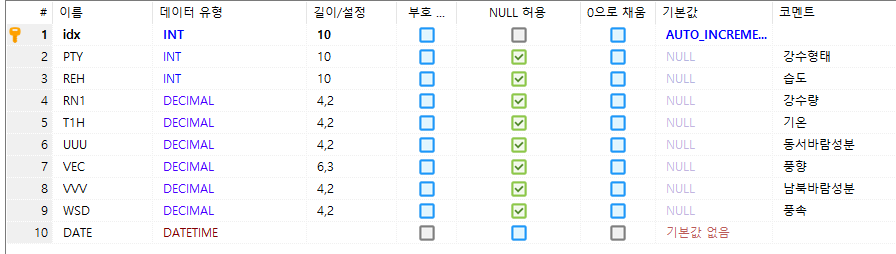

공공데이터를 이용해서 저장했다.중요api 실행 시 현재 시간 -1일 까지만 조회가 가능했다... 7일치를 모으려면 일주일 동안 매일 데이터를 저장해야함...(이런데서 airflow 이런걸 쓰나...?)내일은... 공휴일데이터(?) 가져와야지...이걸 사용했다.단기예보앞

6.공휴일 데이터 저장

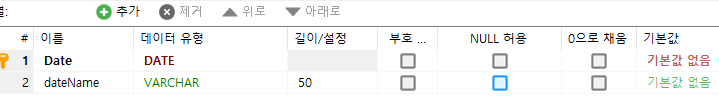

해당 달에 공휴일이 있는지 확인해야 한다.API를 검색해보니 이게있었다!날짜를 pk로 설정하고, 해당하는 공휴일의 이름을 저장솔직히 한줄 받고 넣고 해도 되는데 그냥 dataframe을 만들어서 넣는걸 연습했다.앞에서 한거랑 똑같음다음은... sql이랑 태블로 연결해봐

7.태블로 고민...

태블로랑 연결하려고 public을 설치했다.하지만!!!! public 버전은 mysql과 연결하는 기능이 없다... 돈 주고 사서 써야 하는데...학생 버전은 1년 무료이다. 하지만 내가 이미 졸업을 했다...귀찮아도 동생한테 부탁해서 받아야겠다... 아니면 다른 BI

8.태블로 공부중...

태블로 사용이 처음이라... 데이터 베이스 연결은 했는데 그 다음에 어떻게 하는지 몰라서 유튜브 강의 보면서 공부중이다...그날 공부하는걸 여기다가 올려야지

9.계획 수정...

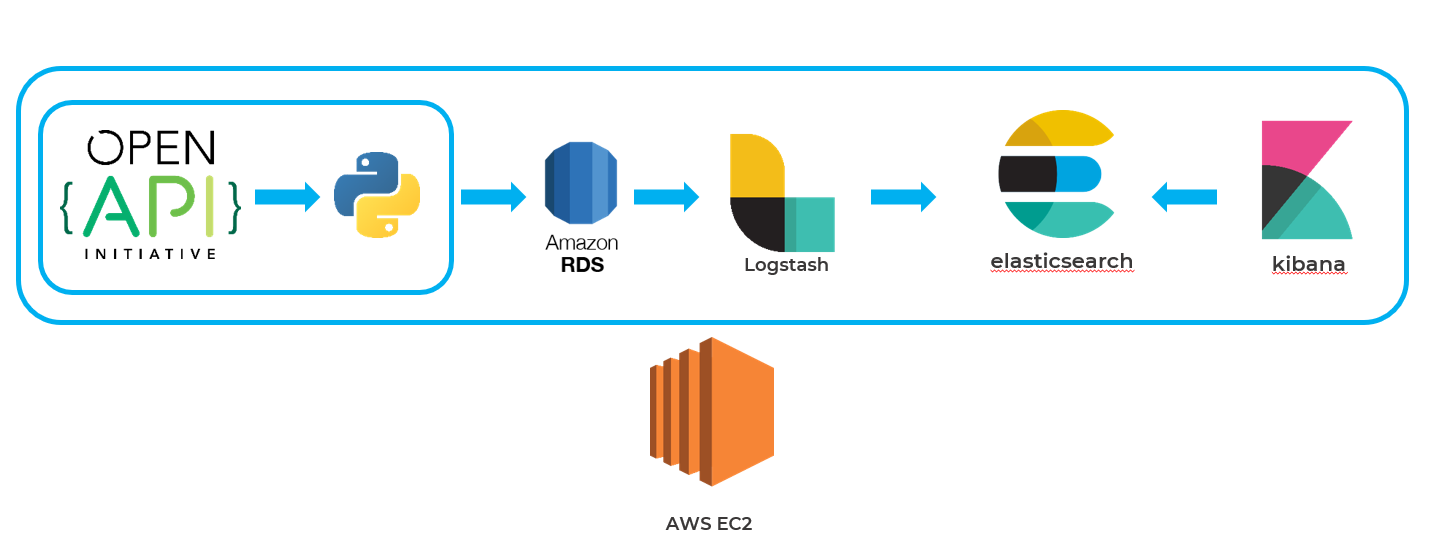

bi툴을 이용해서 보여주는건 좋지만... 키바나를 이용해서 하는거로 노선을 변경하려고 한다.이유는 조금 더 엔지니어링에 가깝다고 생각이 들어서...elk!

10.elk 계획

먼저 계획부터 잡고 시작하려고 한다.aws ec2의 ubuntu 사용aws rdb 이용.(mysql)ubuntu에 원래 짜놓았던 python코드를 옮겨 동작하는지 확인DB 적재 확인ubuntu에 elk설치...이런 순서로 해보려고 한다.화이팅!!

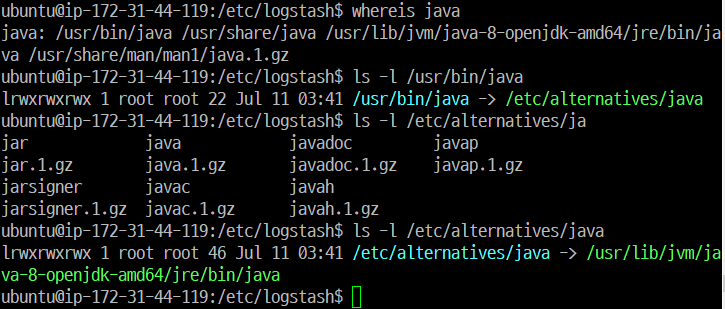

11.ec2에 logstash 설치하기

거의 일주일? 동안 삽질을 했다... 정말 쉬운 건데 너무 어려운 길로 돌아간 느낌...미리 보안그룹을 만들었다.이름이랑 설명에 logstash라고 적어놓으면 나중에 구별하기 쉽다.처음에는 ssh연결을 위해서 ssh연결만 허용한다.ubuntu 20.04 사용30GB할당

12.logstash에서 RDS연결하기

이번에는 logstash에서 mysql에 있는 데이터를 받아오는걸 하려고 합니다.

13.ec2에 elasticsearch 설치하기

저번처럼 elasticsearch라는 이름을 가진 보안그룹을 생성한다.인바운드 - ssh, 9200포트아웃바운드 - 9200포트마찬가지로 ubuntu 20.04로 설정 후 생성저는 데비안 패키지로 설치했습니다.1\. wget -qO - https://artif

14.logstash에서 elasticsearch로 mysql 데이터 보내기

weather

15.sql insert 코드 수정

처음에 작성했던 SQL insert 코드를 한 시간에 한 번 insert 하도록 변경 및 코드를 조금 다듬었다.

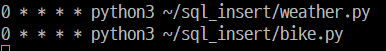

16.crontab 설정

원래는 에어플로우를 이용해서 해보려고 했는데...apache airflow webserver가 구동되다가 멈추는 현상이 계속 발생해서 일단은 crontab으로 대체했다.1시간에 한 번 받아오면 되기 때문에0 \* \* \* \* python3 ~/sql_insert/w

17.완료 및 문제점...

이번 프로젝트를 완료하긴 했다...하지만 완벽하다고 생각하지 않았기 때문에 만났던 문제점들을 적어보려고 한다.메모리 문제ec2 프리티어를 이용해서 진행했기 때문에 메모리가 1기가가 주어졌다.처음에는 그냥 구동하면 자꾸 중간에 멈추고 점유율이 90퍼센트가 넘어가서 이유를