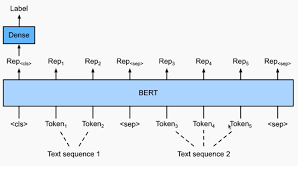

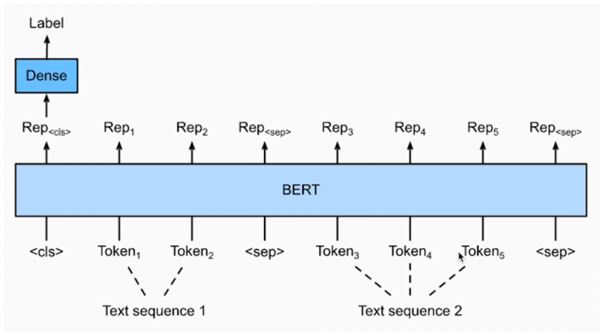

BERT 두 문장 관계 문류 Task

주어진 2개의 문장을 [SEP]토큰을 기준으로 입력으로 넣어 최종으로 나온 [CLS] 토큰으로 두 문장의 관계를 분류하는 Task이다.

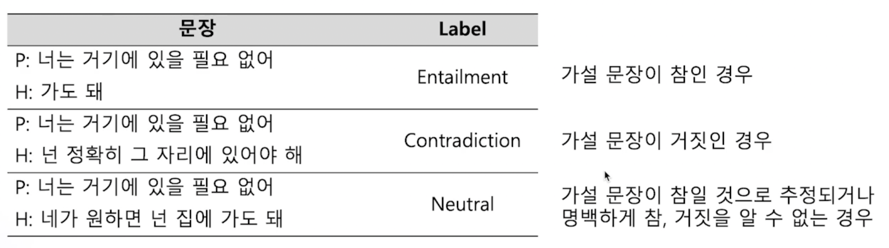

Natural Language Inference (NLI)

- 언어모델이 자연어의 맥락을 이해할 수 있는지 검증하는 task

- 전체문장(Premise)과 가설문장(Hypothesis)을 Entailment(함의), Contradiction(모순), Neutral(중립) 으로 분류 한다.

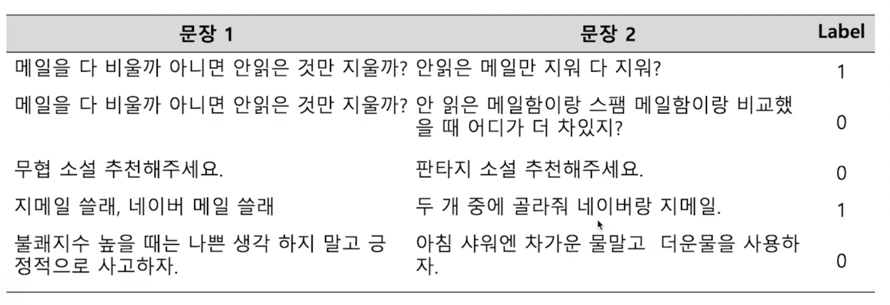

Semantic text pair

- 두 문장의 의미가 서로 같은 문장인지 검증하는 task

- 위 예시로는 label 1 0으로 이진 분류로 의미 같은지 다른지 분류하는 문제

두 문장 관계 분류 모델 학습 Permalink

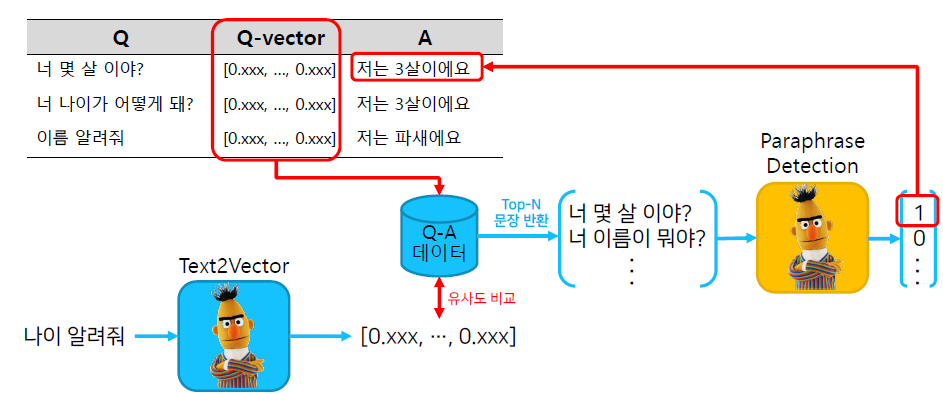

- BERT를 이용해 Text를 Vecotor로 변환시키고 이를 Query vector랑 비교해서 Top-N개의 문장을 반환 시킨다.

이때 이진 분류 모델을 한번 통과시켜 진짜 유사하고 높은 순위의 답변을 내놓고 만약 다르면 모두 0일 경우 이해할수없는 답변이라고 내놓으면 오히려 이상한 답변을 하지 않는다.

회고

태민아 정신차리자 제발 블로그 글좀 써 공부해