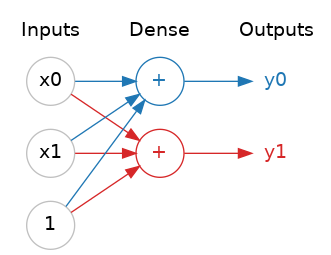

Layers

- 신경망은 layer로 뉴런을 구성

- Unit을 모으면 layer가 생성됨

- 신경망의 각 층은 dense layer를 통해서, 더 복잡한 방식으로 input을 transformation한다.

The Activation Function

-

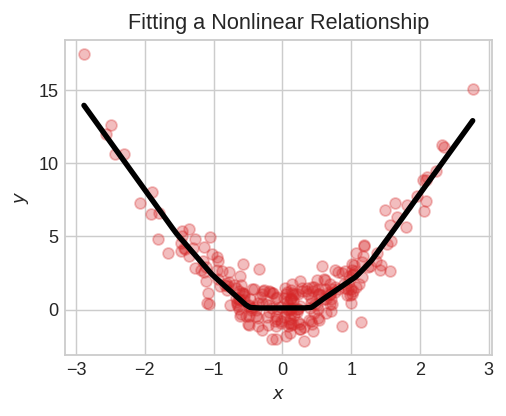

활성화 함수가 없는 경우, 뉴런 네트워크는 선형 관계(linear relationship)만 학습할 수 있다

-

곡선(curves)를 학습하기 위해서는 활성화 함수(activate function)을 사용해야 한다

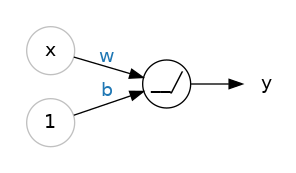

- 활성화함수는 출력(output)에 적용하는 함수

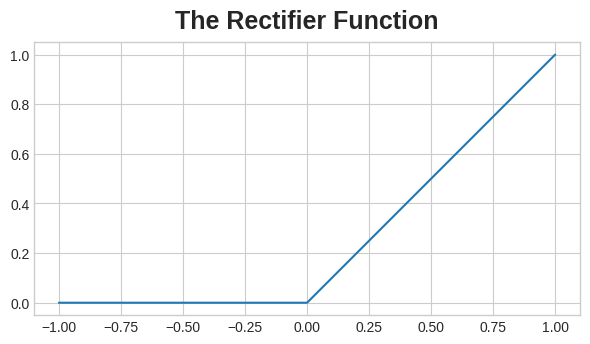

- 아래 그림은 ReLU 함수에 대한 이미지

- ReLU는 max(0,x) 범위로 데이터 출력을 가공

- max(0, w * x + b)

(ReLU Unit의 모습)

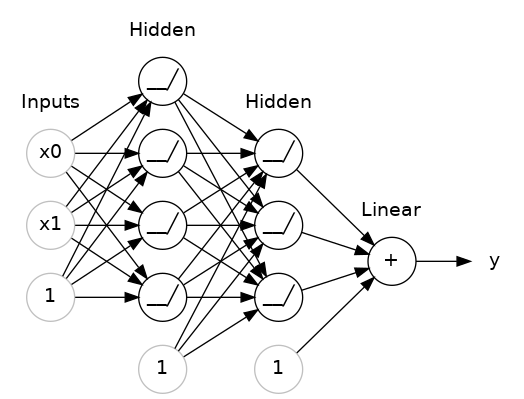

Stacking Dense Layers

- dense layer를 쌓는 것은 "fully - connected " network를 생성

📌 Fully connected network

: 한 층의 모든 뉴런이 다음층 뉴런과 연결된 상태

- output 전 layer를 hidden layer라고 함

Keras에서의 Sequential Model 만들기

from tensorflow import keras

from tensorflow.keras import layers

model = keras.Sequential([

# the hidden ReLU layers

layers.Dense(units=4, activation='relu', input_shape=[2]),

layers.Dense(units=3, activation='relu'),

# the linear output layer

layers.Dense(units=1),

])