Transfer learning

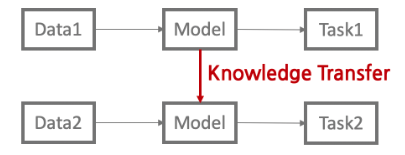

Transfer learning이란 기존의 task에 맞게 이미 학습된(pre-trained)의 모델을 활용하여 다른 Task를 푸는 방법론이다.

주로 Image문제를 풀기위해 학습한 CNN네트워크를 활용하여 이미지 분류 혹은 다른 문제를 푼다.

개념은 이러하고, 이를 얼마나 Transfer하고 얼마나 learning할지에 따라 세부 방법론은 달라진다.

- 파인튜닝(fine-tuning) : 다운스트림 태스크 데이터 전체를 사용합니다. 다운스트림 데이터에 맞게 모델 전체를 업데이트합니다.

- 프롬프트 튜닝(prompt tuning) : 다운스트림 태스크 데이터 전체를 사용합니다. 다운스트림 데이터에 맞게 모델 일부만 업데이트합니다.

- 인컨텍스트 러닝(in-context learning) : 다운스트림 태스크 데이터의 일부만 사용합니다. 모델을 업데이트하지 않습니다.

in-context learning

- 제로샷러닝(zero-shot learning) : 다운스트림 태스크 데이터를 전혀 사용하지 않습니다. 모델이 바로 다운스트림 태스크를 수행합니다.

- 원샷러닝(one-shot learning) : 다운스트림 태스크 데이터를 1 건만 사용합니다. 모델은 1건의 데이터가 어떻게 수행되는지 참고한 뒤 다운스트림 태스크를 수행합니다.

- 퓨샷러닝(few-shot learning) : 다운스트림 태스크 데이터를 몇 건만 사용합니다. 모델은 몇 건의 데이터가 어떻게 수행되는지 참고한 뒤 바로 다운스트림 태스크를 수행합니다.