SENet

- 기존 방법론들과 다르게

channel relationship에 주목한 논문Squeeze-and-Excitation(SE) block을 사용SE block을 사용하여 기존의SOTA모델들도 개선할 수 있음을 보여줌- channel간

non-linear dependency를 제공함으로써 network의representational power를 강화한다고 함

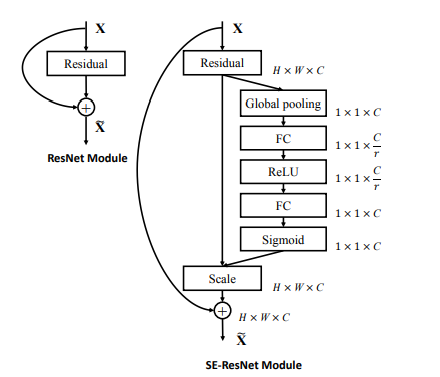

SE block

Squeeze와Excitation으로 나누어 짐- 초기 layer에서는

class상관없이low-level representations를 얻어냄- 후반 layer에서는

class-specific하게 반응함- 기존 SOTA모델구조에 약간의 연산량만으로 추가 가능

- Attention and Gating 구조에서

higher-level abstraction을 추출

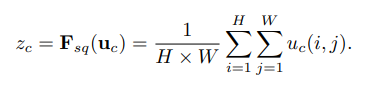

Squeeze

- 어떠한 연산을 통과한 U에서

global average pooling을 통해z를 추출함globa spatial information을channel descriptor에 추출하는 과정

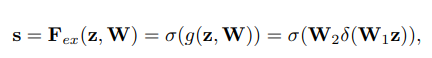

Excitation

- Squeeze에서 얻은

z(Cx1)에 가중치(W1( x C)를 곱하고ReLU연산 후 다시 가중치(W2(Cx),sigmoid연산을 진행해 (Cx1)차원의 s를 구함

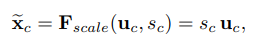

- 앞에서 구한 s와 기존의 output인 u를 곱하여 새로운 x를 얻음

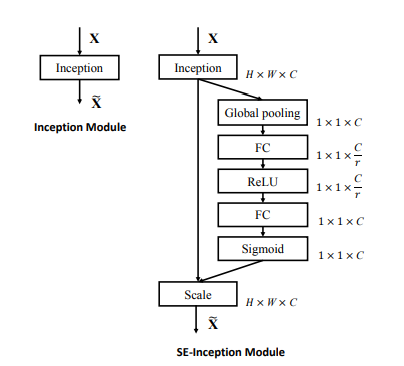

다른 모델

SE-Inception Module

SE-ResNet Module