Machine Learning/Deep Learning

1.신경망 모델 Hyper Parameter 및 Callbacks 함수 정리

: model에서 사용자가 직접 설정해 주는 값: 모델이 학습을 시작하면 학습이 완료될 때까지 사람이 할 수 있는게 없기 때문에, 학습되는 과정 사이에 학습률을 변화시키거나 val_loss가 개선되지 않으면 학습을 멈추게 하는 등의 작업을 지정하는 함수들Early St

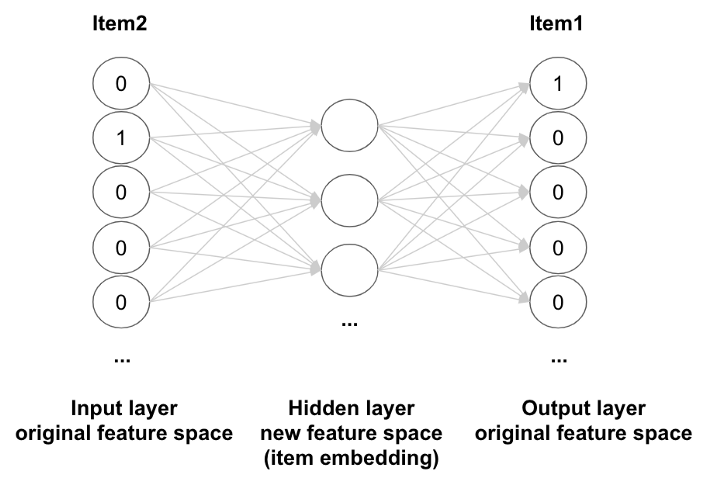

2.[Recommendation System in Practice] 콘텐츠 기반 필터링, 협업 필터링, Cold start problem

Recommendation System in Practice Recommendation System in Practice 정리 본 글은 Recommendation System in Practice 를 공부하고 정리한 글입니다. < 세 가지의 주요 시스템과 실용적 관점

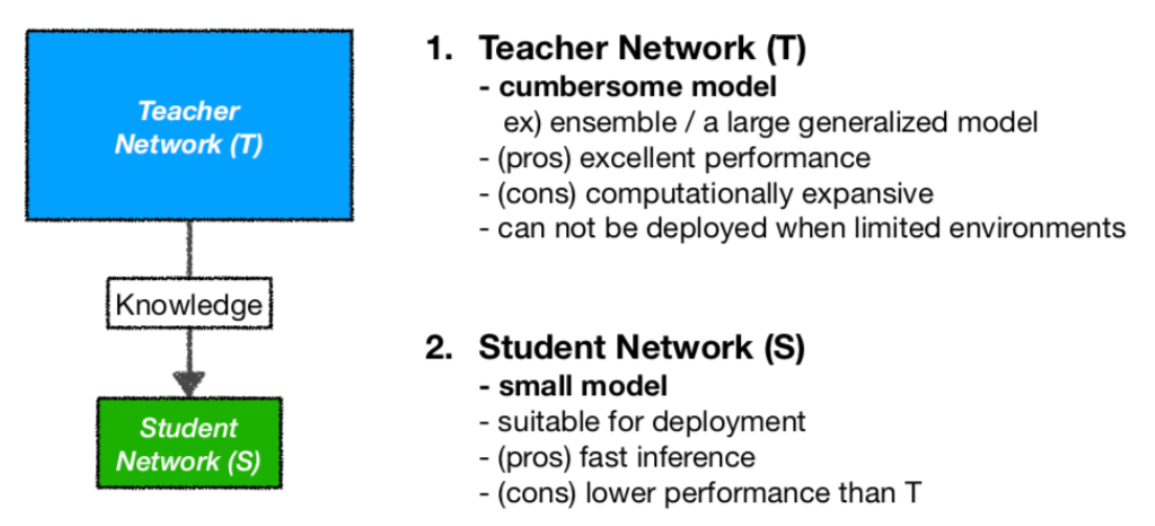

3.[모델 경량화 기법] Knowledge Distillation

Knowledge Distillation 추가 조사 1. Knowledge Distillation 개요 다수의 큰 네트워크들인 전문가(Experts, Teacher) 모델에서 출력은 일반적으로 특정 레이블에 대한 하나의 확률값 만을 나타내지만, 이를 확률값들의 분

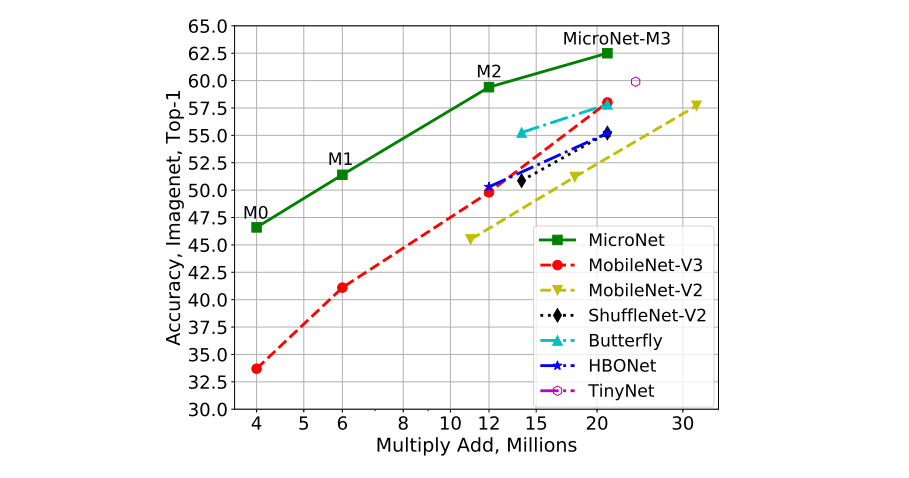

4.AI 모델 경량화 툴 적용 기법 조사 및 On-device Object Detector SOTA Model 비교

1. TensorRT 적용 경량화 기법 2. Pytorch 모델 경량화 툴 3. Knowledge Distillation 추가 조사 4. Edge 컴퓨팅 환경을 위한 AI 모델 최적화 및 경량화 기술개발최종보고서

5.Define-by-Run

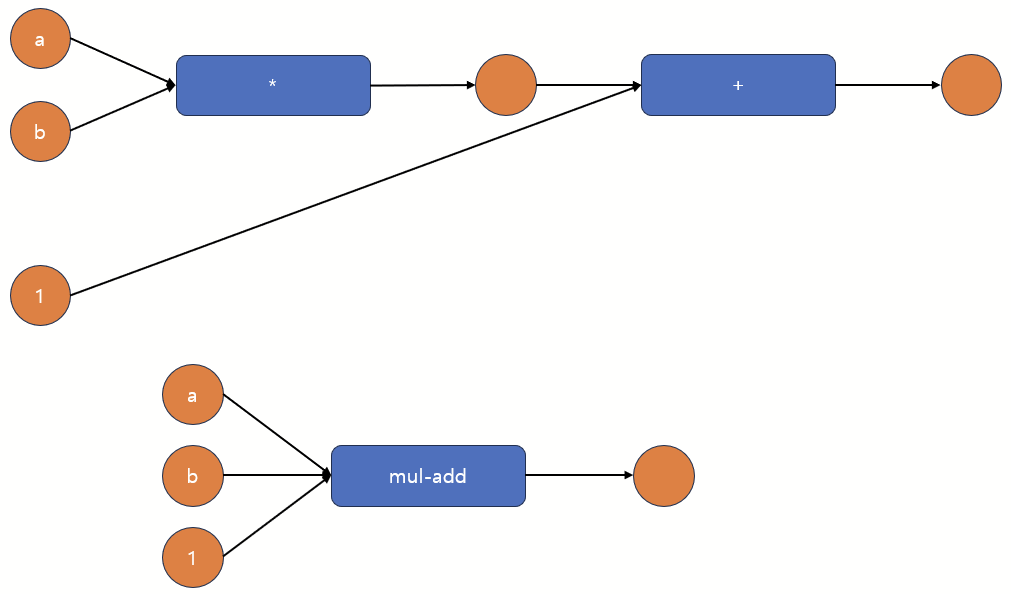

딥러닝 프레임워크는 동작 방식에 따라 크게 두가지로 나눌 수 있음 정적 계산 그래프 (Define-and-Run) 동적 계산 그래프 (Defien-by-Run) Define-and-Run 계산 그래프를 정의한 다음 데이터를 흘려보내는 식 ⏳ 계산 그래프 정의 →

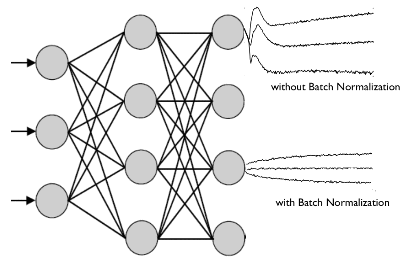

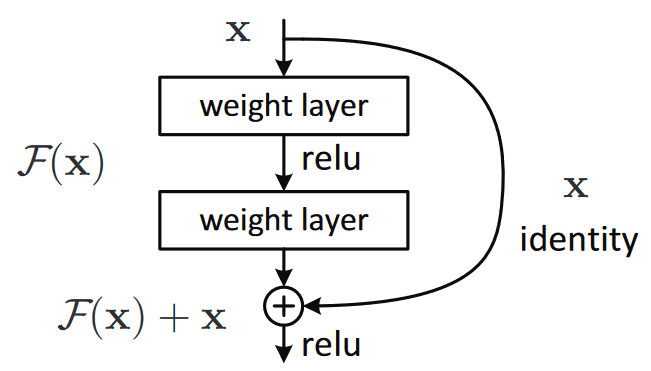

6.Skip-Connection

Deep Neural Network에서 고질적인 문제 중 하나가 Vanishing Gradient이다. 이 문제를 해결하기 위해서 batch normalization도 하고, weight initialization에도 신경을 쓰는 것이다. Vanishing Gradie

7.YAML과 Hydra를 이용한 config 관리

딥러닝이나 머신러닝 프로젝트를 하다 보면, 모델의 config 파일을 통해 학습에 필요한 다양한 설정을 정의하게 됩니다. 이러한 설정 파일을 만들 때 가장 많이 사용하는 포맷이 YAML입니다. 또한, 설정 파일을 효율적으로 관리하고, 다양한 실험 환경을 지원하기 위해