💡 Optimizer(옵티마이저)란?

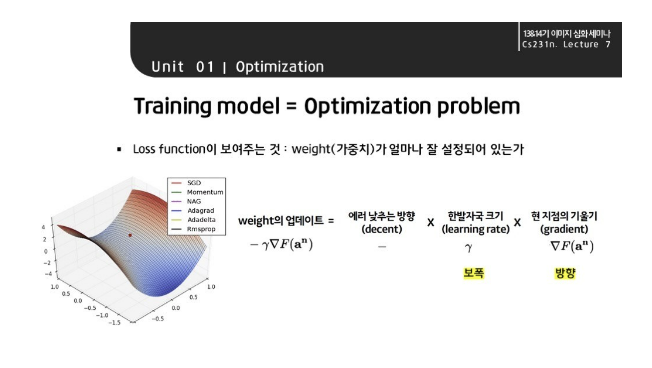

손실 함수에 손실 점수에 따라 가중치를 조절해주는 역할을 한다.

손실 함수를 줄여나가면서 학습하는 방법은 어떤 옵티마이저를 사용하는 지에 따라 달라진다.

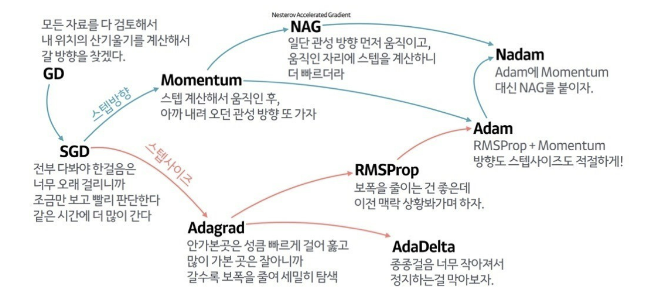

✔️ 종류

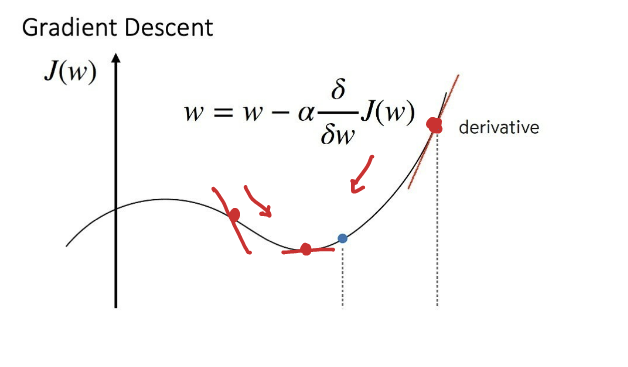

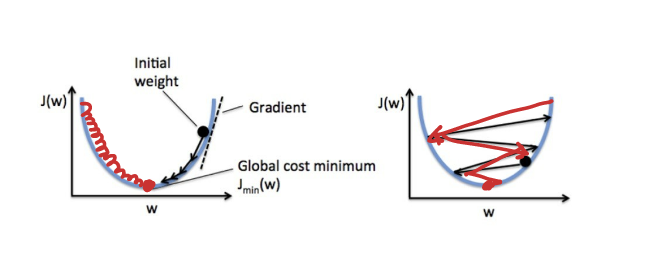

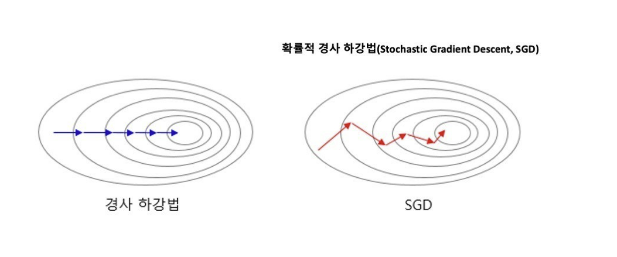

- 경사하강법(Graient Descent) : 기울기가 0에 가까워지는 점을 찾는다.

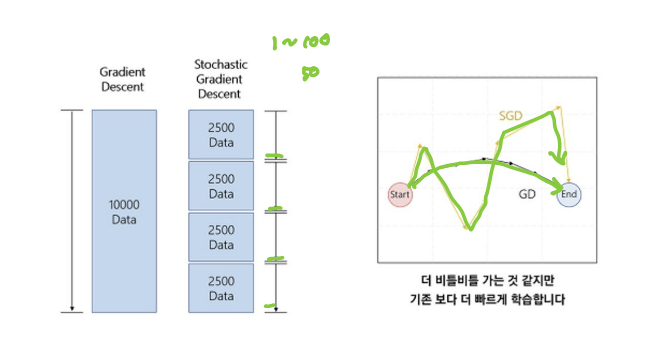

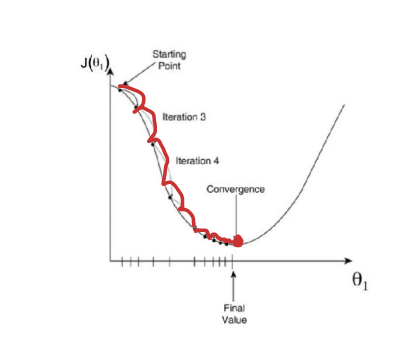

- SGD : 구간을 끊으면서 점프해서 접근하는 방식이다.

- 모멘텀(Momentum) : 로컬 미니멈에 갇혀있다. 물리 엔진인 것 처럼? 공을 넣어 튀어 나오는 것처럼 글로벌 미니멈을 찾는다.

- 그 외 옵티마이저들

RMSProp와 AdaDelta가 가장 많이 사용된다.

모델을 학습시킬 때 옵티마이저는 최적의 가중치를 찾아주는 것이 중요하다.