CS231n 4강

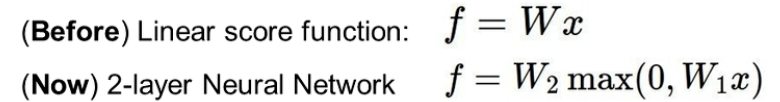

우리는 이때동안 layer가 하나짜리인 linear function에 대해서 공부해왔다.

이제는 레이어가 여러개로 구성된 NN에 대해서 공부할 것이다.

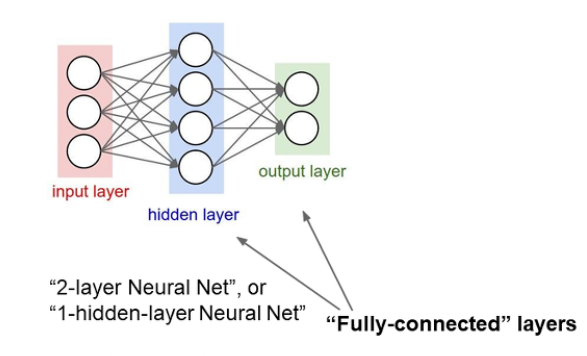

그림을 보면, 중간에 히든 레이어가 추가된 것을 볼 수 있다.

이전의 CIFAR-10 분류기가 1 class - 1 classfier 였다면 이제는 1 class - multi classfier 이다. 즉, 히든 노드가 100개면 서로 다른 100개의 분류기를 가지고 있다는 뜻이다. 이전에 모든 이미지들을 merge하여 말머리가 2개로 보이거나, 빨간색만 차로 구분한다거나 등등 그런 문제들을 해결할 수 있다.

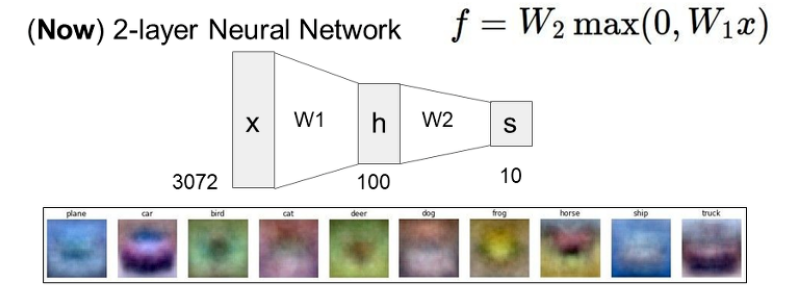

뇌속의 뉴런 : input이 들어오면 axon을 거쳐서 다른 뉴런으로 들어간다.

NN: input이 들어오면 가중치 W를 곱한 후 활성화함수를 거쳐서 output으로 나간다.

뇌속의 뉴런과 비슷해서 Neural Networks 라고 부른다.

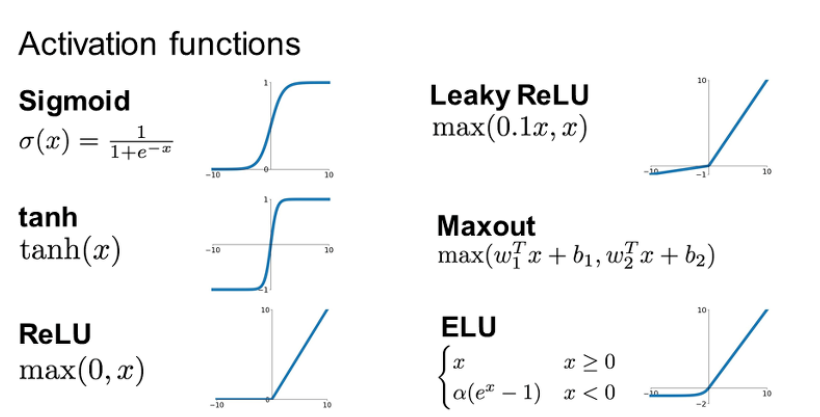

sigmoid, tanh, ReLU 등등 다양한 activation fuction이 있다.

이 중 ReLU를 일반적으로 많이 쓴다.

layer에 대해서 모든 node가 연결되어있는 것을 볼 수 있다.

이를 fully connected라고 부르며 줄임말로 fc라고도 불린다.

그런데 레이어가 3개로 보이는데 왜 2개의 레이어 NN이라고 말할까??

레이어 개수를 셀 때는 input layer를 제외하고 개수를 세어서 3개의 레이어처럼 보여도 2개의 레이어 NN이라고 표현한다.

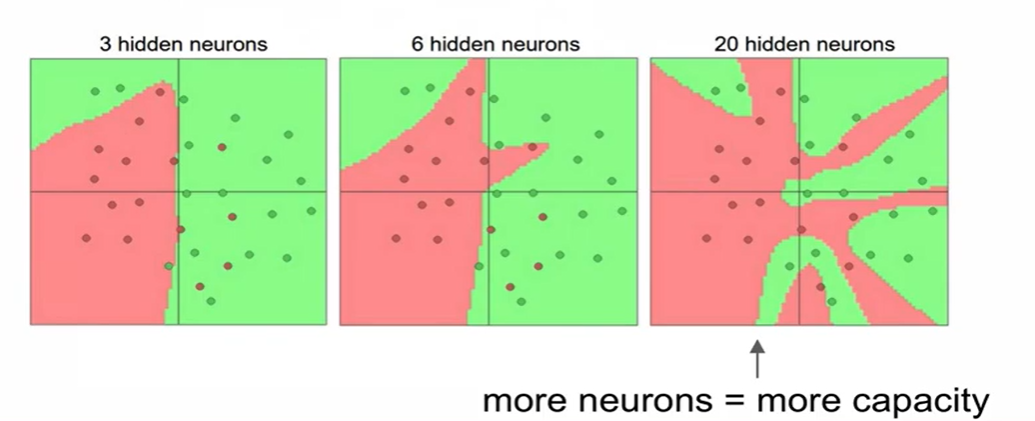

레이어가 많을수록 잘 구분하는 것을 볼 수있다.

끝!