KETOD: Knowledge-Enriched Task-Oriented Dialogue

NAACL 2022

분야 및 배경지식

- Task-oriented Dialogue (TOD; 태스크 지향 대화)

- 시스템이 사용자의 의도나 목표를 수집해 특정한 태스크를 완수하고자 함

- 일반적으로 답변이 간결하고 정형화

- 대화 상태 추적(dialogue state tracking), 행동 예측, 답변 생성 등의 구성요소 필요

- 관련 데이터셋: DSTC challenge series, MultiWOZ, SGD

- Chit-chat (일상적 대화)

- 최근 지식에 기반한(knowledge-grounded) 일상적 대화 연구가 활발

- 외부의 지식을 이용해 환각(hallucination; 그럴듯한 거짓말)을 줄이고 대화를 풍성하게 하고자 함

- 관련 데이터셋: Topical-Chat, WOW dataset

문제점

- 기존의 대화(dialogue) 시스템 연구들은 태스크 지향 대화(task-oriented) 혹은 일상적 대화(chit-chat)를 별개의 도메인으로 연구

- 하지만 더 나은 대화 시스템을 위해서는 둘 모두를 지원할 수 있어야 함

해결책

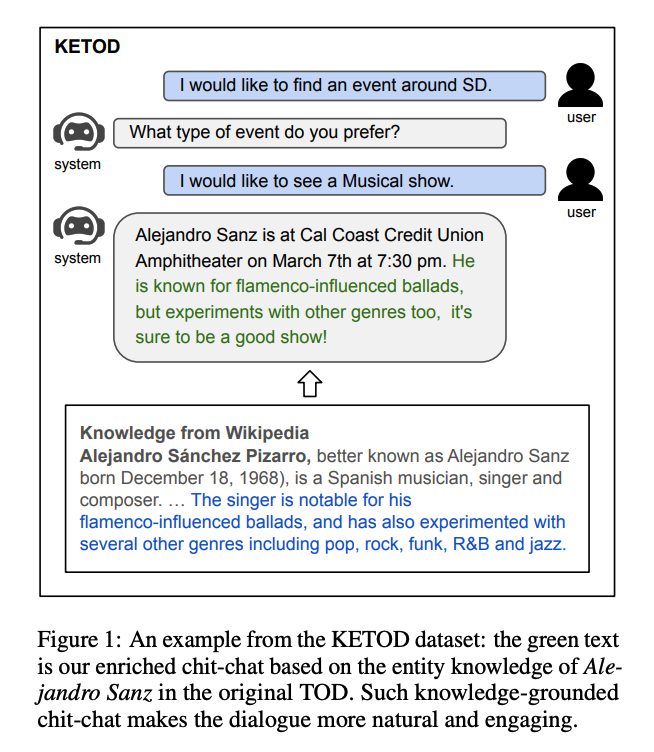

KETOD (Knowledge-Enriched Task-Oriented Dailgoue) dataset

- 기존의 TOD 데이터셋에 기반해 이와 관련된 엔티티(개체; Entity) 기반 지식을 이용한 일상적 대화 추가

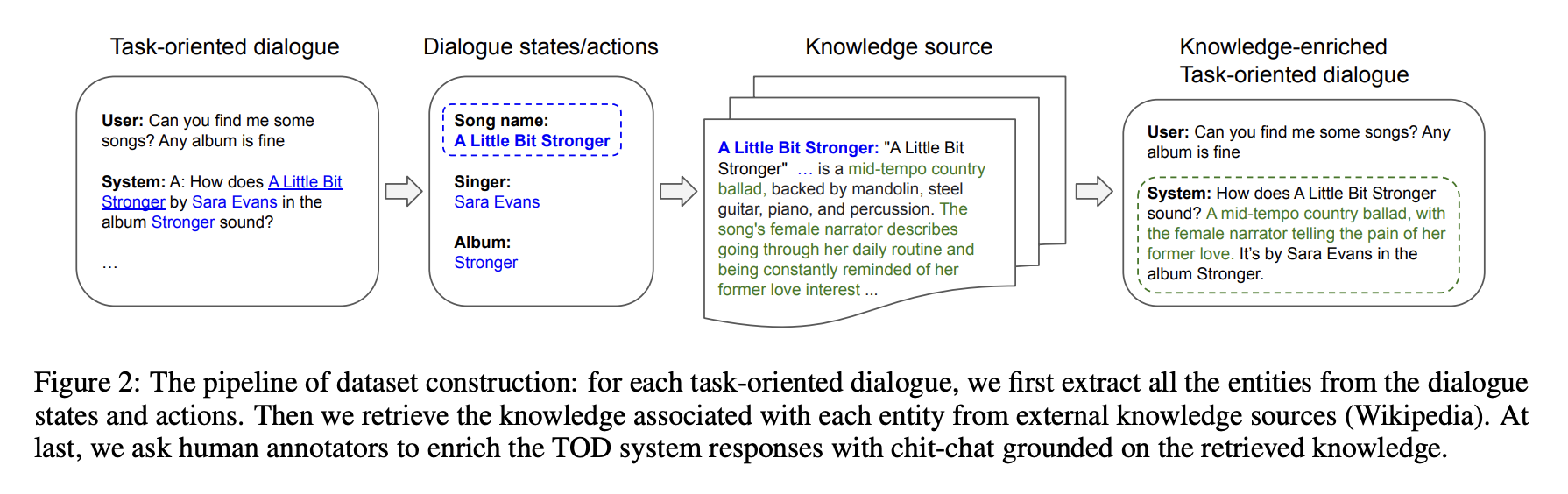

- TOD 데이터 준비

- 기존의 SGD 데이터셋 활용

- 대화 상태(state)와 행동(action)으로부터 개체 추출

- 지식 검색(retrieval)

- 도메인명과 개체명을 쿼리로 삼아 위키피디아에서 검색

- DrQA retriever 활용

- 답변 확장(enrichment)

- 사람으로 하여금 대화 문맥과 검색된 지식을 바탕으로 기존의 TOD에서 시스템의 답변을 풍성하게 만들게 함

- 구체적으로는 몇 번에 걸쳐서, 몇 번째의 답변을 풍성하게 할 것인지 결정하고, 관련된 지식 일부를 선택하고, 답변을 재작성하도록 함

- engagingness(매력있음), interestingness(흥미로움), knowledge(지식), humanness(사람다움)과 같은 지표를 높일 수 있는 데이터셋

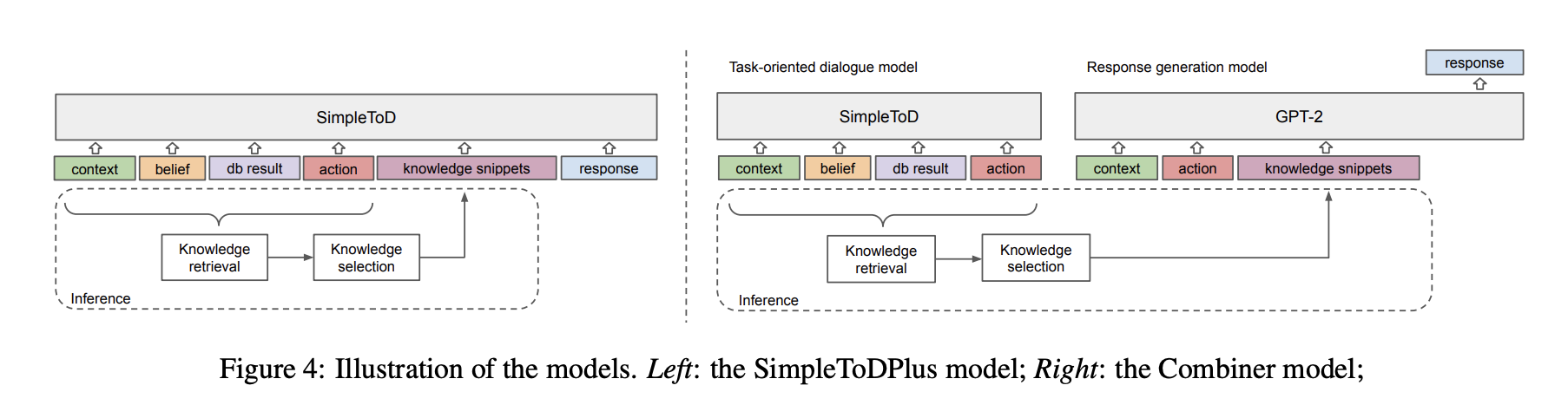

SimpleToDPlus & Combinder models

- 모델 프레임워크

- 대화 문맥을 바탕으로, belief state와 action을 생성

- 개체를 추출해 지식을 검색

- 대화 문맥을 바탕으로, 지식 선택 모델을 활용해 관련 지식을 선택

- 지식 선택 모델로 BERT classifier를 학습

- 지식을 활용해 풍성화된 답변을 생성

- SimpleToDPlus

- end-to-end 모델

- 단일 모델이 belief state, aciton, resposne를 연속적으로 생성

- end-to-end 모델

- Combinder

- 파이프라인 모델

- SimpleToD가 belief state, action을 생성

- GPT-2가 response를 생성

- 파이프라인 모델

평가

- 평가지표

- belief state: joint goal accuracy, average goal accuracy

- actions: act-slot F1

- response: BLEU-4 scores

- 전반적으로 SimpleToDPlus가 TOD 성능을 유지함과 동시에 더 나은 답변 생성 능력을 보여줌

- Combiner

- 답변 생성이 별도로 이루어지기 때문에 지식을 추가한(knowledge enrichment) 답변의 사실성(factfulness)에서 더 좋은 성능을 보임

- 하지만 pipeline의 성격 상 오류가 연속적으로 전파(error cascade)될 수 있기 때문에 전반적인 일관성(consistency)이 낮아짐

한계

- 지식 선택에 변동성(variance)이 있기 때문에 지식 선택 전략을 잘 만들어야 하며, 언제 지식을 추가한 chit-chat을 추가하는 지가 중요함을 ablation에서 보였으나 이에 대한 구체적인 전략 제시가 부족

의의

- TOD와 chit-chat을 성공적으로 결합하여 더욱 현실적으로 유용한 대화 시스템을 구축하고자 함