1. 선형 회귀(Linear Regression)

한 개 이상의 독립 변수 x와 y의 선형 관계를 모델링

1) 단순 선형 회귀 분석(Simple Linear Regression Analysis)

y = wx + b- w: 가중치(weight), 직선의 기울기

- b: 편향(bias), 절편

2) 다중 선형 회귀 분석(Multiple Linear Regression Analysis)

y = w_1x_1 + w_2x_2 + ... w_nx_n + b2. 가설(Hypothesis) 세우기

- 가설: x와 y의 관계를 유추하기 위해서 수학적으로 식을 세우는 것

(선형 회귀에서는 적절한 w와 b를 찾아내야 함)

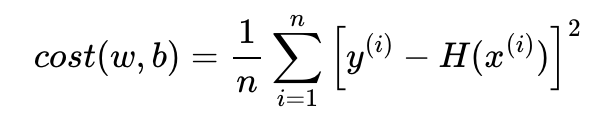

3. 비용 함수(Cost function): 평균 제곱 오차(MSE)

머신 러닝: w와 b를 찾기 위해서 실제값과 가설로부터 얻은 예측값의 오차를 계산하는 식을 세우고, 이 식의 값을 최소화하는 최적의 w와 b를 찾아냄

- 목적 함수(Objective function) or 비용 함수(Cost function) or 손실 함수(Loss function): 실제값과 예측값에 대한 오차에 대한 식 (오차 최소화)

- 평균 제곱 오차(Mean Squared Error, MSE): 회귀 문제의 대표적인 비용 함수

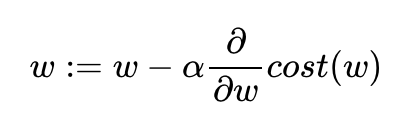

4. 옵티마이저(Optimizer): 경사하강법(Gradient Descent)

- 옵티마이저(Optimizer) or 최적화 알고리즘: 비용 함수를 최소화하는 매개 변수인 w와 b를 찾기 위한 알고리즘 (머신 러닝에서 훈련 또는 학습이라고 부름)

- 경사 하강법(Gradient Descent): 가장 기본적인 옵티마이저 알고리즘

비용 함수(Cost function)를 미분하여 현재 w에서의 접선의 기울기를 구하고, 접선의 기울기가 낮은 방향으로 w의 값을 변경하고 다시 미분하고 이 과정을 접선의 기울기가 0인 곳을 향해 w의 값을 변경하는 작업을 반복

- a: 학습률(learning rate), w의 값을 변경할 때 얼마나 크게 변경할지를 결정하며 0과 1사이의 값을 가지도록 함