SLAM

1.RGBD SLAM 기초 개념

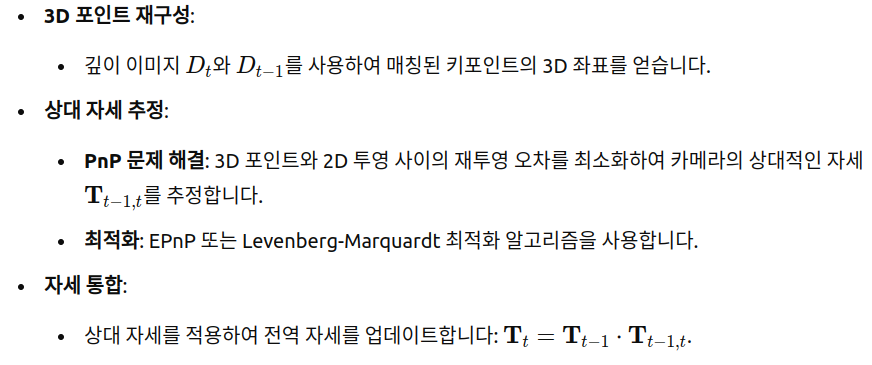

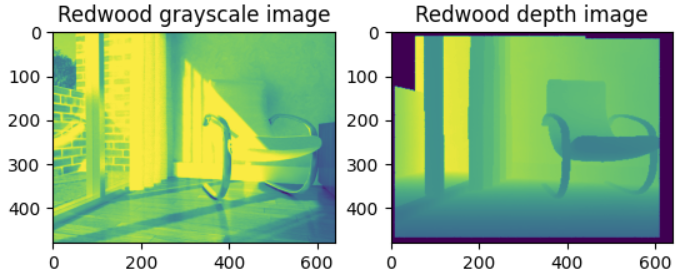

RGB-D 오도메트리: 오도메트리는 로봇이나 카메라의 움직임을 추적하는 방법RGB-D 오도메트리는 RGB(컬러) 이미지와 깊이(Depth) 정보를 모두 활용해 카메라의 움직임을 추적하는 것직접 RGB-D 오도메트리는 이미지의 모든 픽셀을 사용하여 추적하는 방식피처 기반

2.[open3d / reconstruction system] 5. Dense RGBD SLAM

1. Dense RGB-D SLAM 빠른 볼륨 기반 재구성 백엔드로 구동되는 이 시스템은 프레임-투-모델 추적을 사용하는 밀집형 RGB-D SLAM 시스템을 제공 해당 예제는 커맨드 라인 버전인 examples/python/treconstructionsystem/den

3.[open3d / reconstruction system (Tensor)] Overview

이 튜토리얼은 Open3D 텐서 인터페이스와 Open3D 해시 맵 백엔드(https://www.open3d.org/docs/0.14.1/tutorial/core/hashmap.html)를 사용하여 볼륨 기반의 RGB-D 재구성과 밀집형 RGB-D SLAM을 구

4.[open3d / reconstruction system (Tensor)] 1. Voxel Block Grid

복셀 블록 그리드는 3D 장면을 나타내기 위한 전역적으로 희소하고, 지역적으로 밀집된 데이터 구조입니다. 3D 공간에서 2D 객체의 표면은 일반적으로 작은 부분만 차지하기 때문에 전역적으로 희소하지만, 연속적인 표면을 나타내기 위해 지역적으로는 밀집되어 있습니다.이러한

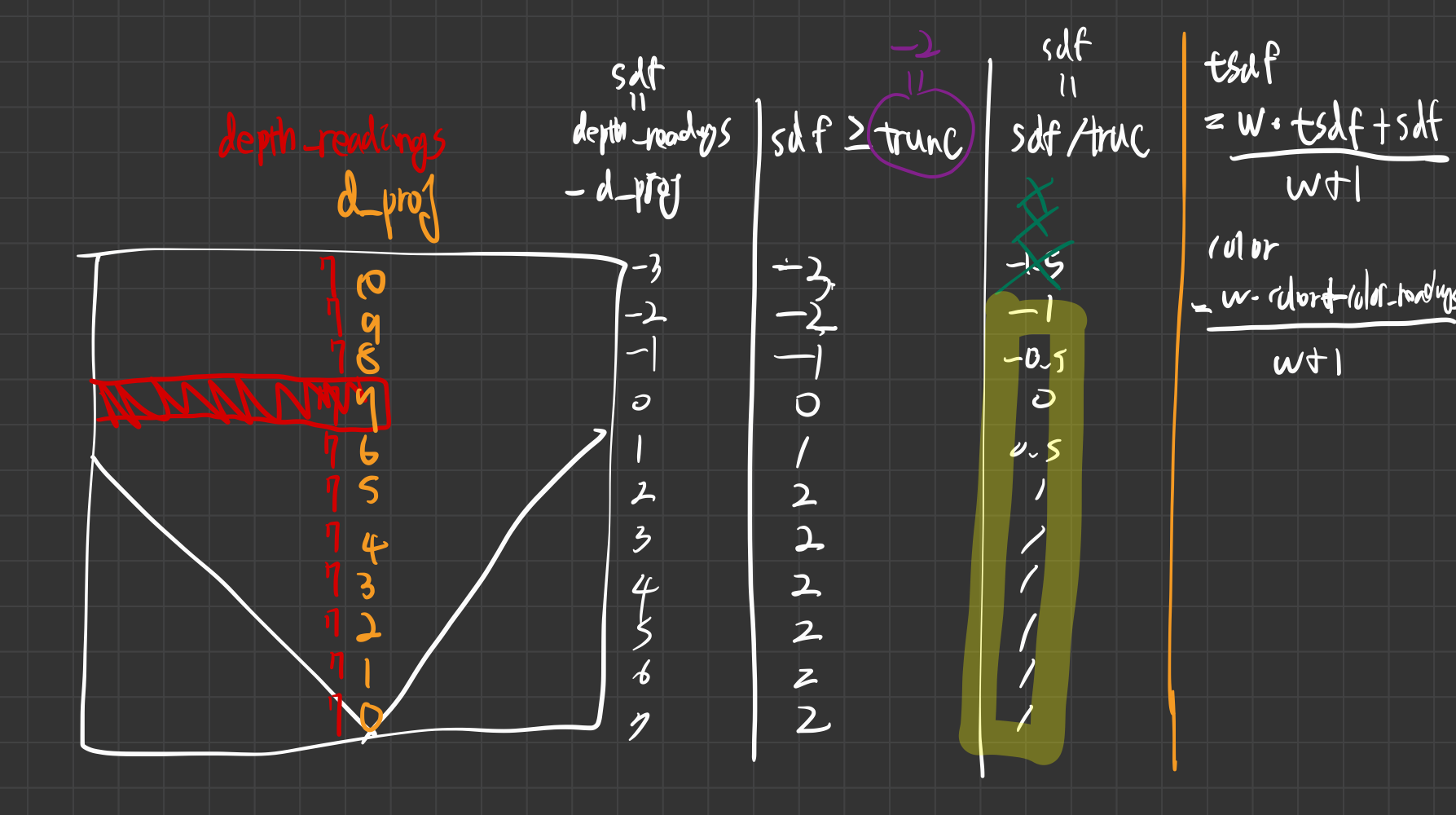

5.[open 3d] Capture your own dataset

RealSense 카메라가 있다면, sensors/realsense_recorder.py를 사용하여 RGB-D 프레임을 쉽게 캡처할 수 있습니다.이 튜토리얼은 사용 환경에 유효한 RealSense Python 패키지와 OpenCV Python 패키지가 설치되어 있다고

6.[open3d / reconstruction system (Tensor)] 3. Customized Integration

추가 속성(예: 시맨틱 레이블)을 포함하는 새로운 RGB-D 볼륨 재구성 알고리즘을 합리적인 성능을 유지하면서 프로토타이핑할 수 있습니다. 예제는 examples/python/t_reconstruction_system/integrate_custom.py에서 확인할 수

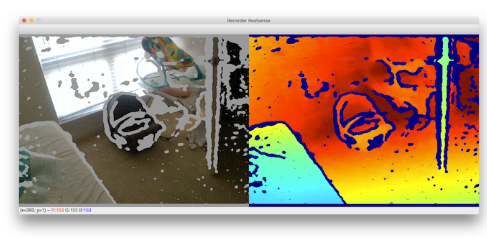

7.[open3d / reconstruction system (Tensor)] 2. TSDF Integration

TSDF(Truncated Signed Distance Function) 통합은 밀집형 볼륨 장면 재구성의 핵심입니다. 이 과정은 Kinect나 RealSense와 같은 RGB-D 센서로부터 상대적으로 노이즈가 많은 깊이 이미지를 받아서, 알려진 카메라 자세를 기반으로

8.[open3d / reconstruction system (Tensor)] 4. Ray Casting in a Voxel Block Grid

https://www.open3d.org/docs/release/tutorial/t_reconstruction_system/ray_casting.html이것은 삼각형 메쉬를 위한 레이캐스팅이 아닙니다. 해당 사용 사례에 대해서는 https://www.

9.[open3D] RGBD images

Open3D는 이미지 처리를 위한 데이터 구조를 가지고 있으며, 이를 활용해 이미지 읽기, 쓰기, 필터링 및 시각화를 수행할 수 있습니다. Open3D 이미지(Image)는 바로 numpy 배열로 변환할 수 있습니다.RGBDImage는 두 개의 이미지로 구성됩니다: R

10.[open3d / reconstruction system (Tensor)] default config

설명: 이 설정 파일의 이름을 지정합니다. 주로 설정 파일을 식별하는 데 사용되며, 시스템 동작에는 영향을 미치지 않습니다.값: Default reconstruction system config설명: 한 번에 처리할 재구성 조각(fragment)의 크기를 지정합니다.

11.[ICP] point-to-plane VS intensity

"포인트-투-플레인 매칭(Point-to-Plane)"과 "영상 강도(Intensity) 매칭"은 3D 포인트 클라우드나 RGB-D 이미지에서 카메라의 움직임을 추정하기 위한 두 가지 대표적인 접근법입니다. 이 두 방법은 각각 장단점이 있으며, 상황에 따라 더 적합한

12.TEASER++

https://arxiv.org/pdf/2001.07715https://github.com/MIT-SPARK/TEASER-plusplusTEASER (Truncated Least Squares Estimation And SEmidefinite Rela