부스트코스 강의 딥러닝 기초 다지기 중 '딥러닝 기본 용어 설명, Historical Review, 뉴럴 네트워크 - MLP'을 정리한 내용이다.

딥러닝 기본 용어 설명

-

딥러닝을 공부함에 필요한 3가지 능력: 구현 실력, 수학 기본(선형대수, 확률), 다양한 논문 알기

-

딥러닝의 주요 요소: Data, model, loss, algorithm

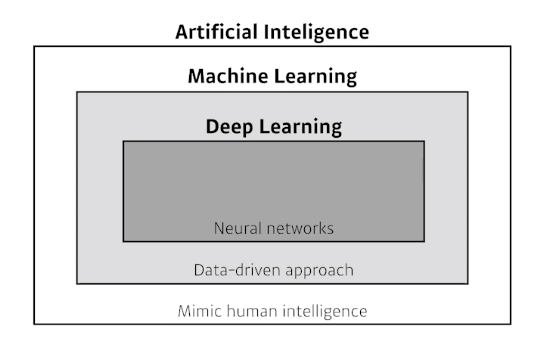

- Artificial intelligence: 인간의 지능을 모방

- Machine Learning: 데이터를 통해 학습하여 알고리즘 모델을 만드는 것

- Deep Learning: 기계학습에서 Neural Network를 활용하는 세부적인 분야

Historical Review

- 2012 - AlexNet: 딥러닝이 실질적 성능을 발휘함

- 2013 - DQN: 알파고 알고리즘

- 2014 - Encoder / Deocder: NMT문제를 풀기 위함, 단어의 연속이 주어졌을 때 번역해줌

- 2014 - Adam: 대표적 optimizer, 일반적으로 성능이 잘 나옴

- 2015 - GAN: 이미지를 만들 때 유용한 모델, 네트워크가 generator와 distributor 두 개를 만들어 학습을 시키는 것

- 2015 - ResNet: 딥러닝이 딥러닝이 가능해짐, 네트워크를 깊게 쌓아도 성능이 좋게 만들어준 모델

- 2017 - Transformer: 'Attention is All You Need' 논문, 다른 기존의 방법론들(RNN 등)을 대체함

- 2018 - BERT: NLP 모델에 활용, fine-tuning 이용

- 2019 - Big Language Models (GPT-3: BERT의 끝판왕, fine-tuning 이용, 매우 많은 parameter로 이루어져있음

- 2020 - Self Supervised Learning: SimCLR, 학습 데이터가 한정되었을 때, label을 모르는 다른 데이터를 학습에 같이 활용함

뉴럴 네트워크 - MLP

-

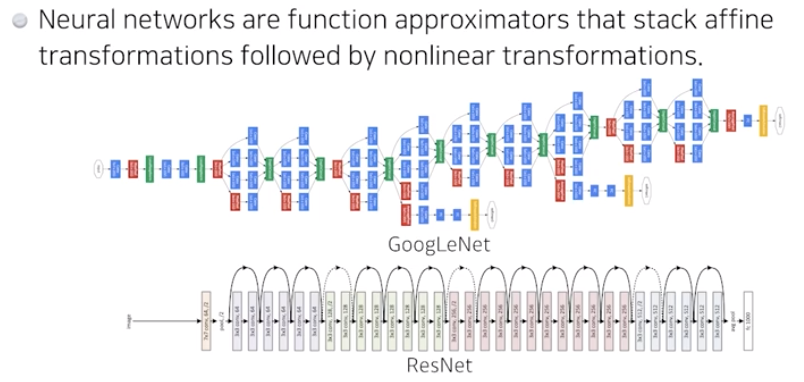

Neural networks: 뇌 신경망을 모방하는 컴퓨팅 시스템, 함수를 모방하는 function approximator

-

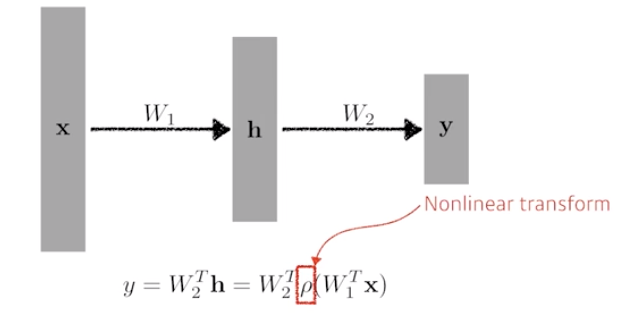

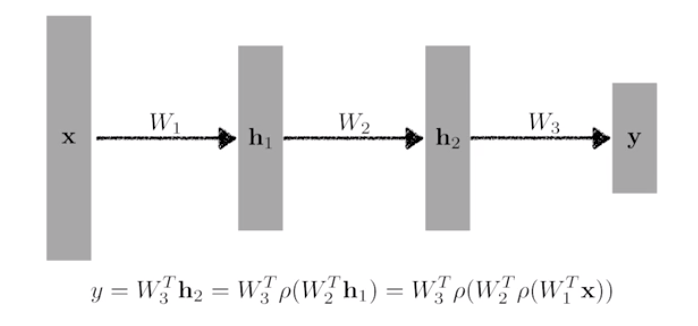

linear neural network에서 가중치를 적용한 값을 nonlinear transform해주고, 다시 그 값을 가중치를 적용한 값을 nonlinear transform해주는 과정을 반복하여 더 많은 표현력을 갖게 해줌

-

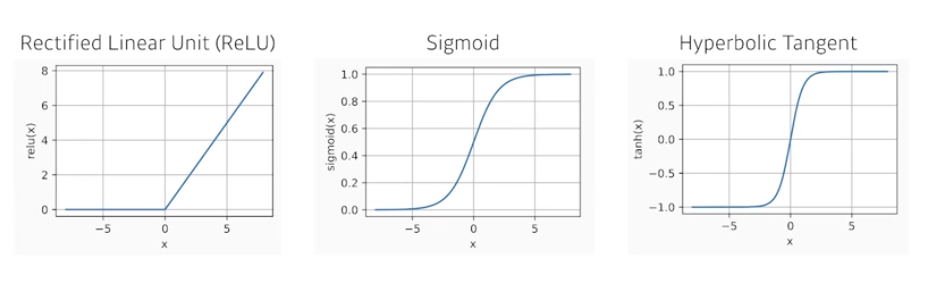

nonlinear transform을 해주는 여러 acitvation function

-

Multi-Layer Perceptron: hidden layer가 있는 nerual network

-

loss function: 어떤 성질을 가지고 있고 왜 내가 원하는 결과를 얻어낼 수 있는지 설명할 수 있어야 함

- ex) 분류 문제는 보통 원핫 인코딩 형태로 주어지는데, 이럴 땐 다른 값들 대비 한 값이 높기만 하면 됨을 수학적으로 표현할 수 있는 cross entropy가 적합함

- ex) 확률적인 값을 내고 싶을 때 MLE 같은 probablistic loss function을 활용함