by 한양대 최준원 교수님

자율주행 자동차 인지 기술(기초)

[자율주행 자동차의 센서 구성]

- 카메라 센서

빛을 전기적 신호로 변환하여 주변에 대한 정보를 2차원 배열 형태로 제공하는 자율주행 센서 - 레이더(RADAR) 센서

전자기파인 RF 신호를 송출하고 목표물에 반사하는 수신파를 분석하여 물체의 거리, 각도, 속도 등의 정보를 얻어냄 - 라이다(LiDAR) 센서

고출력의 펄스레이저를 송출하여 물체에서 반사되어 오는 시간차를 분석하여 3차원 공간을 스캐닝함

자율주행차 센서의 종류

자율주행차 센서=사람의 감각 기관!

대표 센서 : 카메라, 라이다(LiDAR), 레이더(RADAR), 초음파센서 등

- Field of View(FoV, 센서를 통해 주변 정보 수집이 가능한 영역 혹은 각도)의 제한

주변 정보(360도, 전방 200m)를 얻기 위해 다중 센서 사용(여러개)

자율주행차 센서의 장단점

-

카메라 센서

-가장 익숙한 센서, 사진 찍을때 사용

-빛을 전기적 신호로 변환하여 주변의 정보를 2차원 배열 형태로 제공

-현재 운전자 보조 시스템에서 가장 많이 사용

[장점]

CCD 또는 CMOS 센서 사용 -> 해상도가 높음

주변 환경에 대한 색상, 형태 정보 제공

상대적으로 저렴한 가격

[단점]

날씨, 밝기 변화에 민감, 밤에 성능 저하

정확한 거리, 속도 정보를 제공하지 못함

높은 해상도 -> 센서 신호 처리시 계산량 많음 -

레이더 센서

전통적으로 군사용으로 많이 사용, 현재는 자율주행에 많이 사용

전자기파(RF) 신호 송출, 목표물에 반사된 수신파 분석 -> 물체에 대한 정보 얻음

[장점]

환경 변화에 강함(날씨, 밝기 변화에 강함)

거리 측정 정확도가 높음

상대적으로 저렴한 가격

[단점]

횡방향(가로) 물체 위치 측정 정보가 정확하지 않음

주변의 장애물로 인해 반사되는 신호(클러터, Clutter) 때문에 높은 오탐률(잘못 탐지) 발생 -

라이다 센서

고출력 펄스 레이저 주기적 송출 -> 물체에서 반사되어 오는 신호의 시간차 분석 -> 3차원 공간 스캐닝

포인트 클라우드의 형태로 표현됨

기계적 회전 스캐닝 방식이 대부분, 그러나 내구성 문제 -> Mems, 솔리드 스테이트 방식 등 새로운 구조의 라이다 개발 중

[장점]

거리, 각도 측정 정확도가 높음

날씨, 습도, 밝기 등의 환경 변화에 강함

[단점]

상대적으로 비싼 가격

습기가 있을 경우 수신 신호의 세기가 약해짐(비, 안개 등)

[자율주행 인지 기술 개념]

- 동적 객체의 검출 및 추적

센서 신호를 분석하여 다수의 주변 동적 객체를 검출하고, 매 시점마다 얻은 검출 결과를 시간적으로 연결하여 추적 - 동적 객체의 거동 예측

동적 객체의 시간적인 움직임을 분석하여 미래의 움직임 추정 - 정적 객체의 검출, 인식

정적 환경 객체의 위치와 종류를 식별

자율주행차의 인지 기술

- 자율주행을 위해 센서로부터 얻은 신호를 분석하여 차량 주변의 환경에 대한 정보를 얻는 과정

- 자율주행 구성 요소 중 가장 앞단에 존재

- 주변 환경에 관련된 정보를 받아들이는 부분

- 높은 정확도가 요구됨

- 자율주행에서의 주변 환경 요소

[동적 환경 객체]

시간에 따라서 그 위치와 상태가 계속 변화할 수 있는 객체

예>타 차량, 보행자, 사이클리스트, 바이크 등

[정적 환경 객체]

위치가 잘 변하지 않는 객체

예>차선, 건널목, 횡단보도, 신호등, 교통표지판, 과속방지턱, 중앙분리대 등

인지 기술에서 해야 할 일

-

동적 객체의 검출 및 추적

동적 환경 객체가 어디에 있고, 어떻게 움직이고 있는가?

-동적 객체의 검출 : 센서 신호를 분석하여 주변 동적 객체의 위치와 종류 판별(차량이 있는가? 보행자가 있는가?), 센서 신호가 입력된 시점에서 주어진 센서 데이터 안에 어떤 동적 객체가 포함되었는지 검출

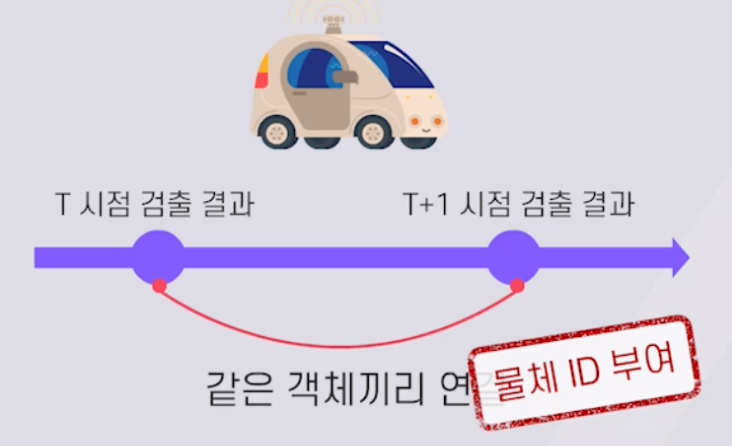

-동적 객체의 추적 : 매 시점마다 얻은 검출 결과를 시간적으로 연결하여 추적, T시점 검출 결과와 T+1시점 검출 결과에서의 같은 객체끼리 연결하는 Association 작업을 해야함, 물체 ID 부여, 객체의 출현 및 퇴장 결정 -

동적 객체의 거동 예측

타 차량, 보행자 등의 동적 객체가 미래에 어떻게 행동할 것인가?

동적 객체의 시간적인 움직임을 분석하여 미래의 움직임 추정

자율주행의 판단 및 계획을 위해 중요한 정보 제공! -

정적 환경 객체 검출, 인식

도로위의 표지판, 신호등, 횡단보도 등을 검출

정적 환경 객체의 위치와 종류가 무엇인가?

-도로 구조 및 환경을 이해하여 안전한 주행을 가능하게 함

-교통 정보를 추출하여 교통상황에 맞는 주행을 가능하게 함(예>제한 속도, 신호등, 횡단보도 등)

-지도 기반 측위에 필요한 정보를 제공함

[인지 기술의 발전방향]

- 인지의 강인성과 정확도 향상

-다양한 환경 변화에 강인한 인지 정확도 달성

-교통상황, 도로상황과 같은 문맥적 정보 이해 - 동적 객체의 다양한 행동 분석 및 환경 변화 적응

-주변 동적 객체의 다양한 행동패턴과 의도를 분석, 예측

-새로운 객체와 변화하는 환경에 적응 - 인지기능의 통합설계 및 실시간 하드웨어 구현

-검출/추적/예측의 인지 기능의 통합 설계 및 최적화

-통합 인지 기능의 실시간 하드웨어 구현

자율주행차 인지기술의 어려움

- 근거리 환경 인지에 대해 100%에 가까운 정확도 요구

- 인지 오작동 발생 시 -> 전체 자율주행 기능 무력화, 사고 발생 가능

- 자율주행차 사고 : 대부분 인지가 정확하게 작동하지 못해 발생 -> 높은 정확도 요구됨

- 다양한 운전 상황(악천후, 조도 변화, 시간대의 변화 등), 다양한 변화에 강인한 성능 요구됨

- 예측하기 힘든 매우 다양한 주행 환경, 상황(공사중, 앞에 사고가 발생함)

- 인지에 활용되는 주행 및 교통 환경 등의 문맥적인 의미 파악의 기술적 어려움

- 주변 타 차량이나 보행자의 다양한 행동 패턴 -> 예측이 어려움

- 새로운 객체들이 계속 생겨나고 교통 환경도 시간에 따라 변화해 감

- 여러 인지 기능을 동시에 수행할수있는 하드웨어 필요(통합 알고리즘 설계, 하드웨어 연산시간 단축 필요)

인지 기술의 도전적 과제

- 다양한 환경 변화 및 주행 환경에서 강인함과 신뢰성 필요

- 주행 및 교통 환경 등의 문맥적인 의미를 파악 및 활용하여 인지기능의 정확도 향상

- 다양한 동적 객체들의 행동 패턴 이해 및 분석

- 새롭게 변화하는 환경에 적응 및 변화

- 동적 환경 객체 검출, 추적, 예측 기능의 통합적인 시스템 설계 및 최적화 필요

- 종합적인 인지 소프트웨어 스택을 실시간으로 처리하기 위한 알고리즘, 하드웨어 구조 개발 필요

[인지를 위한 AI 기술]

인지를 위한 AI 기술 개요

- AI 기술(인공지능 기술)

사람이 갖고 있는 기술을 기계로 구현하기 위한 기술 - 머신러닝

데이터를 통해 학습하는 방식으로 지능을 구현하는 기술 - 딥러닝

-머신러닝 기술을 하기 위해 필요한 모델 중 하나

-사람의 뉴런을 모사하는 신경망 구조를 가지고 있음

인지를 위한 AI 기술의 필요성

- 인지 기술을 위한 AI 기술의 필요성

-엔지니어가 직접 데이터를 설명하는 모델 설계

-실제 환경에서 얻은 데이터의 통계적인 분포와 구조가 복잡

인지를 위한 AI 기술의 적용 과정

- 대규모 센서 데이터 취득

- 라벨링 과정

- 클라우드 서버, 컴퓨팅 환경에서 딥러닝 모델 훈련 수행

- 학습된 신경망의 연결 정보를 차량에 탑재

- 자율주행차에서 수집된 센서 데이터를 기반으로 차량에 장착된 컴퓨팅 하드웨어를 이용해 인지 기능 수행

[인지를 위한 딥러닝 기술 개요]

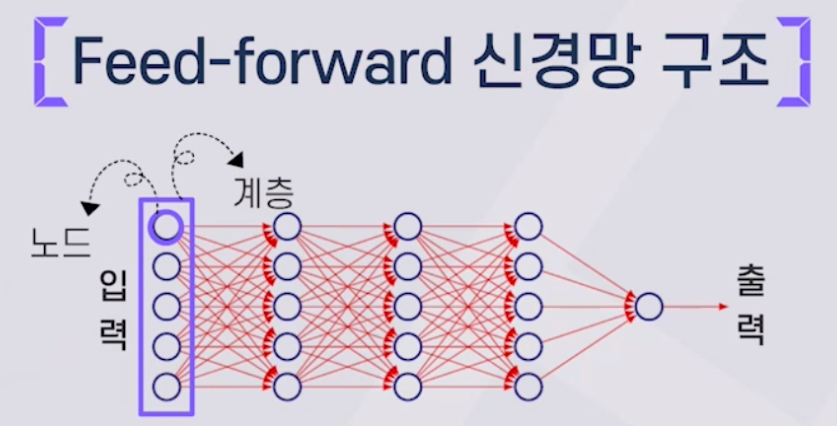

딥러닝 모델의 신경망 구조

- 딥러닝 : 센서 데이터를 입력받아 원하는 결과를 출력

(예>카메라 영상을 딥러닝 모델에 입력하면 보행자 검출 결과 출력) - Feed-forward 신경망 구조

(수많은 노드들의 집합)

여러 개의 계층을 순차적으로 통과

딥러닝의 학습 과정

- 트레이닝 : 수많은 학습 데이터를 보여주면서 주어진 데이터에 대해 정답을 맞추도록 신경망의 연결 여부를 결정해주는 과정(주로 서버에서 일어남)

실제 주행 시 새로운 데이터를 얼마나 잘 인지하는가 여부가 중요!(일반화 성능) - 인퍼런스 : 트레이닝이 끝나면 자율주행차에 탑재하여 실제 인지 기능 수행

인지를 위한 딥러닝 기술

- Convolutional Neural Network(CNN)

-카메라 영상을 입력으로 하여 원하는 결과를 얻어냄

-2차원 배열 데이터를 처리하기에 유리한 구조

-카메라 영상 기반으로 동적 객체와 정적 객체 검출 - Recurrent Neural Network(RNN)

-시간적으로 순차적으로 들어오는 데이터를 입력으로 하여 원하는 출력을 얻어냄

-음성 인식, 자연어 처리, 시계열 데이터 처리

-자율주행차에서의 인지에서는 주변 동적 객체의 과거 경로로부터 미래 경로 예측

-특히 Long Short Term Memory(LSTM)모델이 유명함, 가장 자주 사용됨

[딥러닝 기반 인지시스템 사례]

테슬라와 구글 웨이모의 자율주행차 인지 기술

-

테슬라의 자율주행 기술 사례

-오토파일럿 -> FSD(Full Self Driving)

-오토파일럿:차량이나 보행자만 검출, FSD:신호등 및 정지선까지 인식

-라이다를 사용하지 않고 카메라와 레이더만으로 자율주행을 하는 기술

-서라운드 카메라 8대(360도 커버), 전방 레이터 1대, 초음파 센서 12대(주변의 환경 정보 취득)

-무선통신을 통한 지속적인 소프트웨어 업데이트(성능 개선)

-인지에 딥러닝을 적용하기 위한 컴퓨팅 하드웨어 직접 설계

-대규모로 자율주행을 상용화하고 있는 유일한 회사 -

구글 웨이모의 자율주행 기술 사례

-라이다를 적극적으로 활용하는 자율주행 기술(상당히 의존, 라이다 센서 직접 설계), 카메라와 레이더는 라이다를 보조

-무인택시 등의 서비스에 사용

-Level 4 자율주행 지향

-2018년 미국 아리조나 피닉스에 무인택시 웨이모 One 서비스 출범

-자율주행 회사 중 가장 많은 자율주행 테스트 마일리지 및 시뮬레이션 시간

-레이더 + 라이다 -> 최대 500m 거리까지 물체 검출

자율주행차 인지 오류로 인한 사고 사례

- 자율주행의 인지 기능이 오작동할 경우 치명적인 사고로 이어질 수 있음을 보여주는 사례

- 2016년 5월 테슬라의 자율주행차 사고

-테슬라 모델 S가 오토파일럿 기능을 켠 상태로 흰색 트레일러와 충돌, 운전자 사망, 흰 트레일러 트럭을 하늘로 잘못 인식(인지 기능이 중요하다는 걸 보여주는 사례) - 2018년 3월 우버의 자율주행차 사고

-자율주행 시험 운행 중이던 우버 차량이 자전거를 끌고 무단횡단하던 40대 여성과 충돌, 여성 사망, 여성을 미확인 물체로 분류(인지 기능이 중요하다는 걸 보여주는 사례)

[카메라 센서 개요]

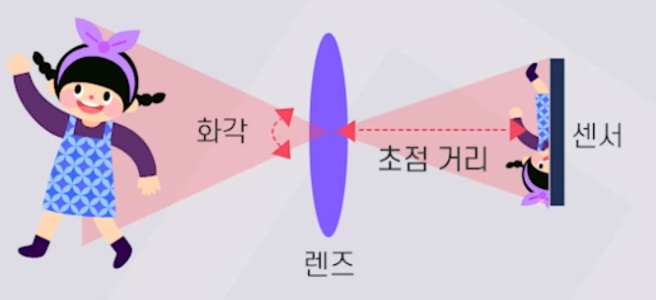

카메라 센서 원리

- 카메라 렌즈를 통해 들어온 빛을 전기적인 신호로 변환(2차원 배열 형태)해서 주변에 대한 정보 제공

- CCD(Charged Coupled Device)나 CMOS(Complementary Metal-Oxide-Semiconductor) 이미지 센서에 영상 투사

- 카메라 구성 : 렌즈, 몸체, 조절 장치(조리개, 셔터)

- 카메라 센서 원리

-초점거리 : 렌즈의 중심에서부터 필름에 영상이 맺히는 사이의 거리

-화각 : 화면을 구성하는 각도

렌즈의 초점거리가 짧으면 화각이 넓어짐(광각렌즈) / 렌즈의 초점거리가 길면 화각은 좁아짐

화각 좁음------------------------------------------------------------------------------------화각 넓음

초점거리 넓음-----------------------------------------------------------------------------초점거리 좁음

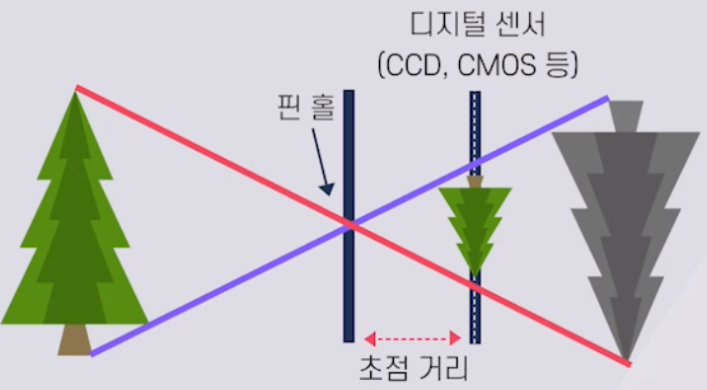

카메라 구조

- 핀홀 카메라 : 핀홀, 즉 작은 구멍을 통해서 빛을 받아들임

-기본적인 카메라 구조

-일반적으로 사용되지는 않지만 카메라 구조를 이해하기에 적합

--> 초점 거리에 따라 물체 크기 변화

- 렌즈 카메라 : 렌즈의 빛의 굴절 특성 이용

-핀홀 카메라의 이론을 그대로 사용 가능(예>초점 거리에 따른 물체 크기)

-렌즈에 의한 왜곡 보정 필요

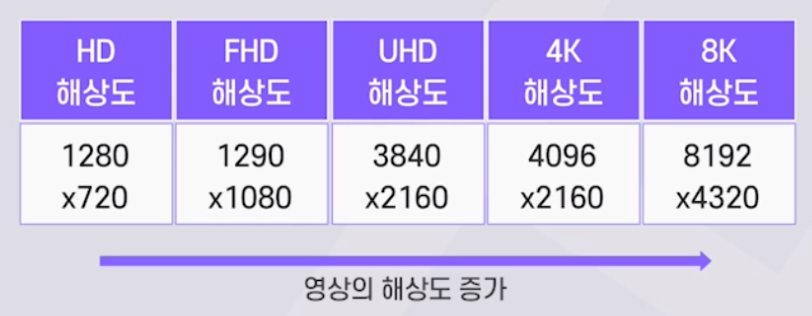

영상의 표현 방법

- 카메라 영상을 x축, y축의 2차원 배열로 표현

- 해상도 : 배열의 크기

- 픽셀 : 배열의 원소

- 시간적인 프레임을 표현하기 위해 비디오 데이터 사용

- 프레임 비율(Frame Rate) : 1초동안 보여주는 영상 프레임 수(영화의 프레임 비율은 보통 24fps 이상-초당 24개의 프레임 보여줌)

- 영상의 색상 표현 : 적색(R), 녹색(G), 청색(B) 조합하여 표현(RGB 영상)

-일반적으로 각 생상의 밝기를 8비트(0~255)로 표현(예>흰색:R255,G255,B255, 검은색:R0,G0,B0)

-그 외 색상 표현 방법 : YIQ, CMY, HIS 등

[카메라 캘리브레이션(보정) 기술]

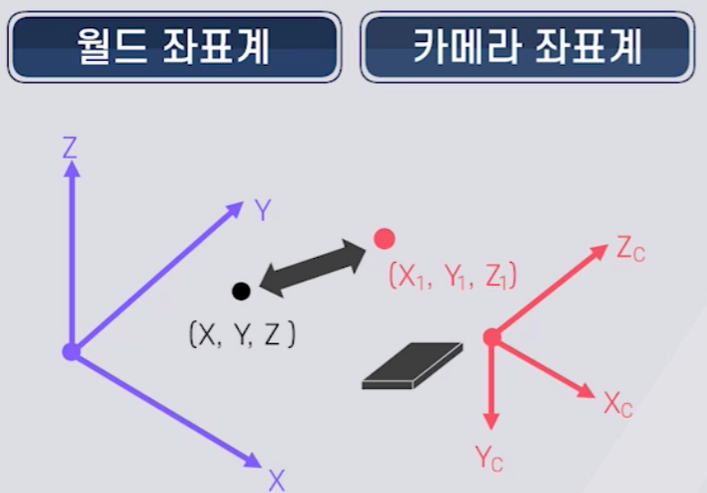

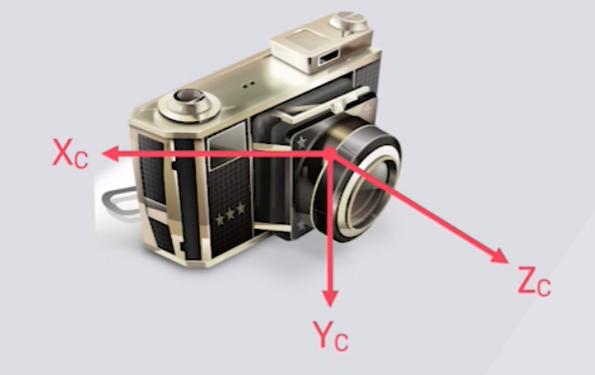

카메라 좌표계

-

카메라에서 물체를 표현하는 좌표계

-

3차원 공간에서 빛이 물체에 반사되어 들어오는 정보를 2차원 평면에 투영하여 영상을 생성함

-

월드 좌표계(실제 공간, 3차원), 카메라 좌표계

-

카메라 좌표계

-카메라에서 물체를 표현하는 좌표계

-월드 좌표계의 한 점이 카메라 좌표계의 한 점으로 변환될 수 있음

-x축, y축, z축 이렇게 표현함

카메라 내부 파라미터

- 카메라 영상 좌표계와 3차원 월드 좌표계 변환을 위한 카메라 내부의 기계적인 셋팅에 관련된 파라미터

- 초점거리, 주점, 비대칭 계수

- 초점거리 : 렌즈의 중심과 이미지 센서(CMOS 또는 CCD)와의 거리, 픽셀 단위로 표현

- 주점 : 렌즈의 중심에서 이미지 센서에 수직으로 내린 점의 영상 좌표, 픽셀 단위로 표현

- 비대칭 계수 : 이미지 센서의 Cell Array의 Y축이 기울어진 정도

카메라 캘리브레이션

- 카메라 영상 좌표계와 3차원 월드 좌표계 사이의 변환 행렬을 알아내는 과정

- 카메라 좌표계의 변환을 알기 위해 카메라의 내부 파라미터 값을 알아내고 카메라 렌즈에 의해 생긴 왜곡을 보정하는 과정

- 반복적인 패턴이 있는 체커보드를 카메라로 촬영 -> 영상에서 체커보드의 코너점들을 검출 -> 결과를 이용하여 카메라의 내부 파라미터값 계산

- 자율주행차가 월드 좌표계에서의 물체 상태나 환경을 카메라 영상을 이용하여 이해하기 위해서는 카메라 캘리브레이션이 수행되어야 함

[카메라 기반 물체 검출/추적 기술]

카메라 기반 물체 검출 기술

- 카메라 영상을 입력으로 받아서 물체의 위치와 종류를 알아내는 기술

- 카메라 영상에 Convolutional Neural Network(CNN)를 적용하여 물체의 특징을 추출한 후 이를 이용하여 물체를 검출함

- 딥러닝 기반 물체 검출 방법 : 1단계 방법과 2단계 방법으로 나누어짐

-1단계 : 간단한 구조로 인해 계산시간이 빠름(YOLO, SSD, RetinaNet)

-2단계 : 검출 정확도가 더 높음(Faster RCNN, Mask RCNN)

딥러닝 기반 물체 검출 기술

- CNN 딥러닝 모델을 이용하여 물체에 대한 특징값 추출

- 1단계 검출 기법과 2단계 검출 기법으로 구분

카메라 기반 물체 추적 기술

- 같은 물체에 대한 검출 결과를 시간적으로 연결하고 연결된 물체에 대해 물체 ID 부여

- 각 비디오 프레임에서 얻어진 물체 검출 결과를 이요하여 시간에 따라 움직이는 물체를 추적하는 기술

- 움직이는 물체를 추적하기 위해서는 현재 비디오 프레임과 이전 비디오 프레임에서 얻어진 물체 검출 결과 중 같은 물체끼리 연결해주는 과정 필요

- 같은 물체로 판명되면 해당 물체에 대한 ID 번호 부여

- 새로 등장하거나 퇴장하는 물체에 대해 관리

[카메라 기반 영역 분할 기술]

-

자율주행차의 검출 대상

-차량, 보행자와 같이 몸체가 있는 물체

-차선, 도로와 같이 몸체의 형태가 분명하지 않는 객체 -

Semantic 영역 분할 기술

-카메라 영상에서 같은 종류에 해당하는 영역을 분할하고 그 영역의 종류를 분류하는 방법 -

차선, 도로 영역 검출

-카메라 영상에서 차선, 도로에 해당하는 영역을 픽셀별로 라벨링 해놓은 학습 데이터를 이용하여 딥러닝 모델을 트레이닝

카메라 기반 영역 분할 기술 개요

- Semantic 영역 분할 기술 : 컴퓨터 비전 기술 중에 카메라 영상에서 같은 종류에 해당하는 영역을 분할하고 그 영역의 종류를 분류하는 방법

- Semantic 영역 분할 기술을 이용하면 차선, 도로, 횡단보도, 과속방지턱 등 검출 가능

카메라 기반 차선, 도로 영역 검출

- Semantic 영역 분할 기법 : 카메라 영상의 각 픽셀이 어떤 카테고리에 속하는지 분류

- 다양한 주행 카메라 영상에 대해 각 픽셀별로 라벨링을 해 놓은 학습 데이터를 사용하여 딥러닝 모델을 트레이닝

- 자율주행차가 차선을 준수하고 안전한 주행도로로 다닐 수 있도록 유용한 정보 제공

- 지도 기반 자기 차량 위치 측위에 사용

[레이더 센서 종류 및 작동 원리]

레이더 센서 종류

- 사용 주파수 대역에 따라 24GHz(근거리용 레이더, SRR, Short Range 레이더) 와 77GHz 레이더(원거리용 레이더, LRR, Long Range 레이더)로 구분

- 신호 송신 방식에 따라 펄스 레이더, 연속파 레이더로 구분

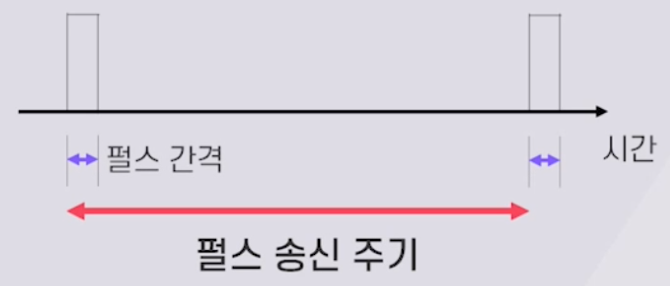

- 펄스 레이더

-짧은 펄스 신호를 송신(1ns이내의 짧은 펄스 신호를 주기적으로 송신)

-송수신 신호 간의 전파지연시간을 측정하여 상대 차량과의 거리 추정

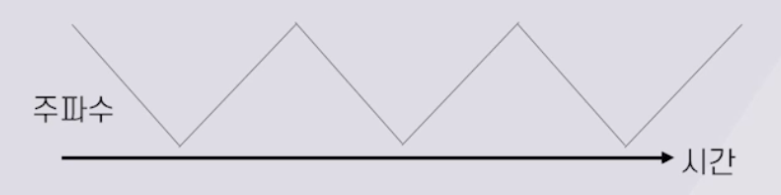

-근거리 차량용 레이더에 사용 - FMCW 레이더(주파수 변조 연속파 레이더)

-주파수가 선형적으로 변하는 연속파 신호 송신

-시간에 따라 주파수가 변화하는 연속파 신호를 휴지시간 없이 지속적으로 송신

-송신 신호와 수신 신호를 곱하여 비트 신호를 추출하여 목표와의 거리 및 상대 속도 측정

-중장거리 차량용 레이더에 사용 - FSK 레이더

-디지털 변조에 이용되는 FSK 방식 이용

-자율주행에는 아직 많이 사용되고 있지는 않음

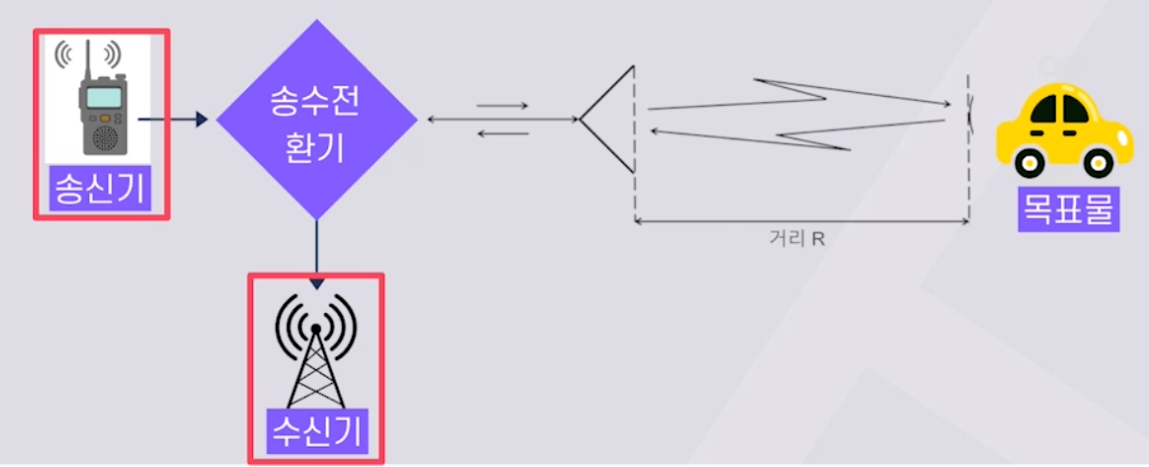

레이더 센서 작동원리

-

펄스 레이더

-주기적으로 펄스를 반송파에 실어 물체가 예상되는 방향으로 송신 -> 수신됐을 때의 지연시간 계산 -> 상대거리 예측

-펄스의 간격이 짧을수록 좋은(높은) 거리분해능

-하나의 안테나를 사용하므로 송수전환기(송수신격리기)를 통해 송신 신호와 수신 신호를 분리하여 처리

-다음 펄스의 송신이 일어나기 전에 반사 펄스가 들어오도록 함

-수신된 시간과 전력으로부터 거리 계산 수행

-

FMCW 레이더

-시간에 따라 주파수가 선형적으로 변함 -> 연속된 신호를 생성해서 보냄 -> 목표물로부터 반사되는 신호 수집

-송신 신호와 수신 신호를 곱하여(디처핑 방법) 송신 신호, 수신 신호 주파수의 합과 차로 구성된 신호

-비트주파수 성분(송신 신호와 수신 신호의 주파수의 차) : 물체 검출에 필요한 정보 제공

-비트 주파수 성분 사용 -> 비트 신호의 스펙트럼 분석 -> 물체의 거리와 속도 계산

-송수신 안테나가 분리되어 있음(송신 안테나/수신 안테나)

-비트 신호의 주파수 대역폭 < 수신 신호의 주파수 대역폭 --> 샘플링하기 위한 하드웨어 비용 절감

[레이더 신호 특성]

- 레이더 신호 특성

-주로 24GHz와 77GHz 대역을 사용

-물체와 관계없는 장애물에 의한 클러터 방해 신호 존재 - 레이더 신호를 이용한 물체 검출

-수신된 레이더 신호의 주파수 분석 수행

-CFAR 검출 방법을 적용하여 일관된 오탐률을 유지 - 배열 안테나를 이용한 각도 측정

-수신된 신호의 위상 차이를 이용하여 수신 신호의 각도 추정

-안테나 원소의 수가 늘어날수록 각도 해상도 향상

레이더 센서 신호

- 군사용으로 많이 사용(적기 검출, 탐지), 휴대폰에도 많이 사용(전자기파)

- 자율주행차를 위한 레이더 센서로는 주로 24GHz와 77GHz 대역을 사용

- 대역폭이 넓을수록 거리 측정 정확도가 높음(77GHz가 더 정확-유럽이나 미국에서는 주로 77GHz 사용 예정)

- 전자기파의 장점 : 날씨, 밝기, 시야 가림 등 환경 변화에 강한 특성을 보임

- 77GHz 대역의 장점

-파장 길이가 3.98mm로 안테나 모듈 크기를 작게 만들 수 있음-자율주행에서 선호

-지향성이 더 좋고, 인체에 미치는 영향도 적음 - 클러터 문제

-주변 장애물에 의해 반사되어 오는 방해 신호를 클러터라고 함

-물체가 없는 위치에 신호가 검출되어 오탐률을 높임

-실제 물체와 클러터를 구별할 수 있는 고성능 신호처리 알고리즘 필요

레이더 신호를 이용한 물체 검출

- 레이더 신호의 주파수 분석

-수신신호에 고속 푸리에 변환(FFT) 기법 적용 -> 시간에 따른 주파수의 변화 분석 -> 물체 검출

-주파수 성분에 배경 잡음과 클러터 등의 간섭 신호들이 존재

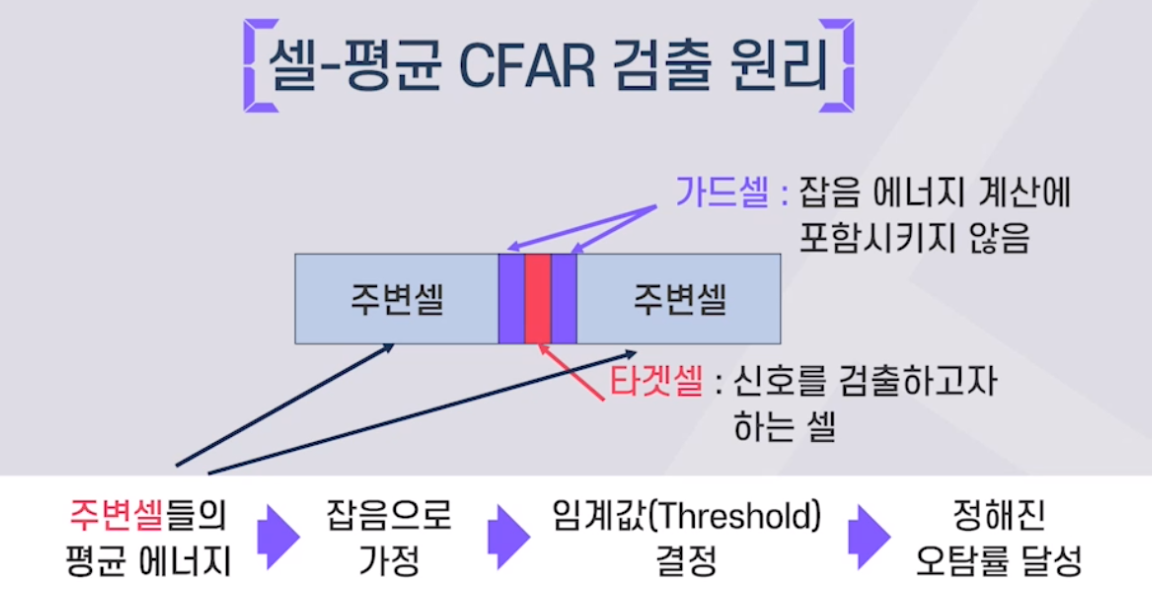

-> CFAR(Constant False Alarm Rate) 방법을 적용(간섭 신호 하에서도 일관된 오탐률을 유지하는 기술) - 배열 안테나를 이용한 각도 측정

-횡방향 각도 측정을 위해 배열 안테나를 사용(하나 이상의 안테나 원소로 구성)

-신호가 수신되면 안테나들이 수신 신호를 받고, 위상 차이를 이용하여 수신 신호의 각도 추정을 함

-안테나 원소의 개수가 많을수록 각도 측정값 해상도 높아짐(정확도 상승, 비용 증가)

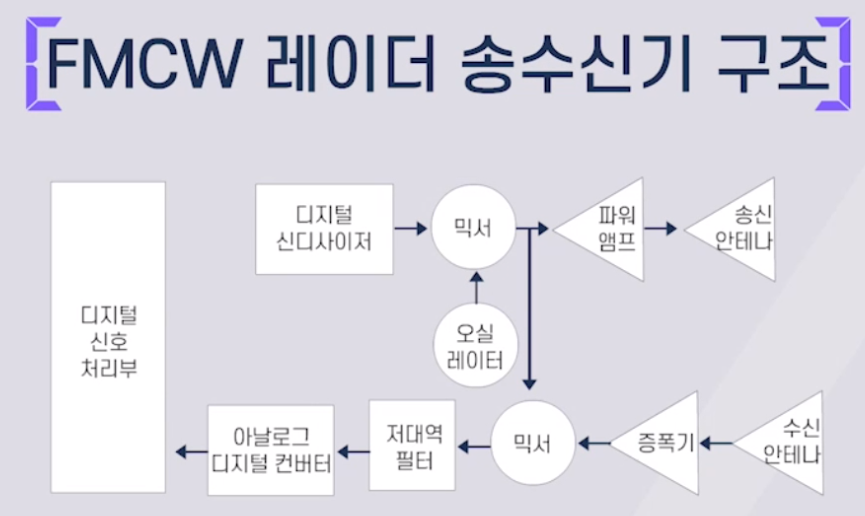

[레이더 송수신기 구성]

- 디처핑 과정

-송신 신호와 수신 신호를 곱한 후 저대역 필터를 통과

-주파수의 차에 해당하는 비트신호 생성 - 고속 푸리에 변환

-비트 신호를 디지털 신호로 변환한 후 고속 푸리에 변환 적용

-비트 신호의 주파수 성분 분석 - CFAR 검출

-주파수 성분을 임계값(Threshold)과 비교하여 물체 검출

-임계값(Threshold)을 주변 잡음에 따라 적응적으로 조절

레이더 송수신기 구조

1. 디지털 신디사이저에서 발생한 FMCW 송신 신호를, 오실레이터에서 생성된 반송파에 실어, 안테나를 통해 송신

2. 이렇게 송신된 신호는 반사가 되어 시간적으로 지연된 반사 신호가 수신 안테나를 통해 수신됨

3. 송신 신호와 수신 신호를 곱하여 저대역 필터 통과(비트 주파수 성분 생성)

4. 비트 주파수 성분을 아날로그 디지털 컨버터를 사용하여 디지털 신호로 변환

5. 고속 푸리에 변환을 이용하여 주파수 성분을 추출하고, 디지털 신호 처리부에서 처리하여 상대거리와 속도 측정

레이더 신호처리 기술

- 믹서

-송신 신호와 수신 신호를 곱함(두 신호의 주파수의 합과 차를 주파수로 갖는 신호 발생)

-우리는 두 주파수의 차를 갖는 주파수를 원하기 때문에 두 주파수의 합을 갖는 주파수를 제거하기 위해 저대역 필터를 통과하게 됨(고주파를 걸러내고 저주파만을 통과시킴-합성분은 걸러내고 차성분(비트 주파수 성분)만을 통과시킴) - 아날로그 디지털 컨버터(ADC)

-아날로그 신호가 디지털 신호로 변환됨(디지털 신호처리 알고리즘 적용)

-출력된 디지털 신호는 디지털 신호처리 프로세서나 마이크로프로세서에 의해 처리됨 - 고속 푸리에 변환(Fast Fourier Transform)

-고속 푸리에 변환을 적용하여 시간에 따라 변화하는 주파수 성분 분석, 임계값(Threshold)과 비교하여 물체 검출 - CFAR(Constant False Alarm Rate) 검출기

-오탐률을 일정하게 하는 검출기

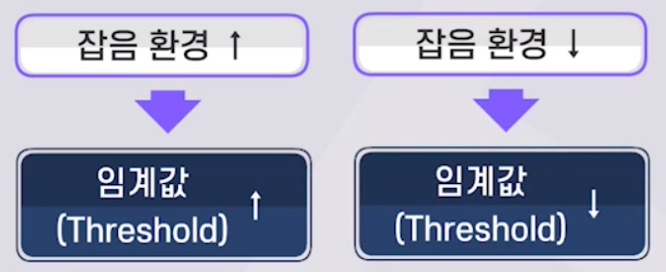

-잡음 혹은 방해 신호가 있는 환경에서 오탐률을 일정하게 하기 위해서는 시간-주파수 성분의 에너지를 임계값(Threshold)과 비교 -> 잡음 환경에 따라 임계값(Threshold)을 적응적으로 조절하여 정해진 오탐률 유지!

[레이더 기반 물체 검출 기술]

- 송신 신호 웨이브폼

-펄스 레이더 송신 신호 파형

-FMCW 레이더 송신 신호 주파수의 파형 - 셀-평균 CFAR 검출기

-잡음의 세기를 주변 셀에서의 신호 에너지의 평균을 취하여 계산 - 배열 안테나를 이용한 방향 측정

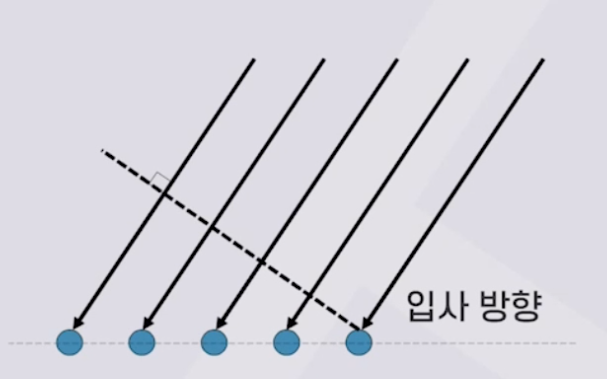

-위상 차이를 분석하여 신호의 입사 방향 측정

레이더 기반 물체 검출 기술 개요

- 송신 신호 웨이브 폼

- 펄스 레이더 송신 신호 파형

-작은 펄스 간격, 주기적으로 펄스 송신

-펄스가 반사되어 돌아오는 지연시간을 계산하여 물체 검출

- FMCW 레이더 송신 신호 주파수의 파형

-주파수가 선형적으로 톱니모양으로 변함

-송신신호X수신신호 -> 비트 주파수 성분 분석하여 물체 검출

-

타겟 물체 검출 과정

-수신신호가 들어오면 윈도우를 씌우게 됨

-윈도우를 시간축으로 움직이면서 주파수 성분 변환 수행 -> 시간-주파수 영역의 신호 영상을 얻음 -> 거리-도플러 영역으로 환산

-거리-도플러 영역에서의 하나의 셀 = 차량에서 물체까지의 거리와 상대 속도

-각 셀에서의 신호의 세기를 임계값(Threshold)과 비교, 검출 여부 판단

->수신 신호 에너지의 크기가 임계값(Threshold)보다 크면 검출,

->수신 신호 에너지의 크기가 임계값(Trheshold)보다 작으면 검출X

-

임계값(Threshold)의 결정

-임계값이 작게 되면 너무 쉽게 물체를 검출하게 되어 물체가 아닌 경우에도 물체라고 검출하는 오류 확률이 높아짐

-임계값이 크게 되면 물체가 있는 경우에도 놓치는 오류 확률이 높아짐

-정해진 오탐률을 달성하기 위해 적절한 임계값을 결정해야 함

-주변 잡음, 클러터 등 방해 신호의 크기에 따라 임계값은 영향을 받는다(주변 환경, 시간에 따라 달라짐)

-Threshold 결정 방법 : CFAR 검출기(임계값을 환경에 따라 조절) -

CFAR 검출기의 원리

-각 셀에서의 신호 세기를 임계값(Threshold)과 비교 -> 물체 검출

-주변 잡음, 방해 신호의 에너지 추정 방법 -> 거리-도플러 도메인에서 알고자 하는 셀 주변의 신호 세기 파악 -> 신호의 세기를 잡음의 에너지로 가정 -> 임계값(Threshold) 결정 -

셀-평균 CFAR 검출기

-CFAR 검출기 중 가장 많이 사용

-잡음의 세기를 주변셀에서의 신호 에너지의 평균을 취하여 계산

-

횡방향의 각도 검출

-Phased Array 라고 불리는 배열 안테나 사용

-도달각 추정 기술 : 배열 안테나의 각 요소에 들어오는 신호의 지연시간이 다름 -> 수신 신호의 위상차이 발생 -> 위상 차이를 분석하여 신호의 입사 방향 측정

[라이다 센서 종류 및 개요]

- 라이다 센서의 특성

-고출력 펄스 레이저를 사용하기 때문에 정확한 거리 측정이 가능

-높은 센서의 가격이 장벽 - 회전형 라이다

-센서를 직접 기계적으로 회전하여 360도 전방위 환경 정보 획득

-가격이 높고 내구성이 약한 단점 - 고정형 라이다

-환경 정보를 획득하고자 하는 각도에 설치하여 운용

-가격이 저렴하나 화각이 제한되는 단점이 있음

라이다 센서 개요

- 라이다 센서

1.직진성이 강한 고출력 펄스 레이저 송신

2.수신 시 지연시간 분석

3.물체 탐지와 거리 측정 수행 - 장점

1.레이저의 직진성을 이용하여 먼 거리의 물체도 정확히 감지 가능

2.위치 측정의 정확도가 높음 - 단점

- 높은 센서의 가격 -> 상용화를 위해 저렴한 제품 개발이 주요 화두

라이다 센서 종류

- 회전형 라이다

-센서를 직접 기계적으로 회전하여 넓은 각도의 환경 정보 취득

-장점 : 360도의 전방위 환경 데이터 획득

-단점 : 구성이 복잡함(고속 회전 수행), 센서 가격이 높음, 내구성이 약함

-채널 수 : 수직으로 동시에 송신하는 레이저 빔의 수(4채널, 16채널, 32채널, 64채널, 128채널)

-채널 수가 높아지면 해상도가 높아짐, 그러나 가격도 높아짐 - 고정형 라이다

-환경 정보를 획득하고자 하는 각도에 설치하여 운용

-장점 : 구성이 비교적 단순하여 가격이 저렴

-단점 : 화각 한계가 존재하므로 물체가 화각을 넘어가면 탐지 불가능

라이다의 구현 방식

- 기계식

-가장 많이 사용하는 방법

-기계적인 모터를 사용하여 주변 영역을 스캐닝

-내구성이 떨어짐, 가격 높음 -> 최근 다양한 방식의 라이다 개발 - MEMS

-MEMS 기술 이용하여 작은 반사 거울을 제어하여 주변 영역 스캐닝 - 플래시

-단일 레이저 빔을 광 시야각으로 확장하여 송신 -> 반사되는 레이저 빔을 다중 배열 수신 소자를 통하여 수신 -> 물체 검출 - FMCW

-레이더에 사용되는 FMCW 신호 분석 원리를 적용

-거리뿐만 아니라 속도 측정도 가능

[라이다 센서 특성 및 데이터]

- 라이다 센서

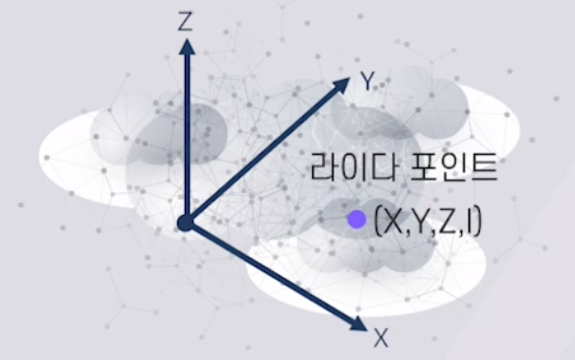

라이다에서 발사한 레이저가 물체에 반사되어 돌아오는 지연시간으로부터 물체까지의 거리 측정 - 라이다 데이터 표현 방식

신호가 반사되어 돌아온 물체 위치를 3차원 좌표 (X,Y,Z)와 세기 I로 구성된 4차원 데이터 (X,Y,Z,I)로 표현 - 포인트 클라우드 데이터

라이다 포인트의 집합

라이다 센서 특성

- 물체에 레이저를 발사하여 물체에 반사되어 돌아올때 전파지연시간으로 물체까지의 거리 측정

- 카메라 센서에 비해 거리 측정의 정확도가 매우 높은 편

- 기존에는 905nm 파장 사용 : 습도의 영향(날씨) -> 수신 파워 감소 되는 현상

- 이를 해결하기 위해 최근에는 1550nm 파장 개발 중

- 라이다 단점

-반사체의 반사율이 낮을 경우 반사되어 들어오는 신호 성분 약화 -> 검출 가능한 거리가 줄어듦

(각 물체의 반사율에 따라 검출 가능 거리가 달라짐) - 라이다 해상도의 결정 요소

-가로 방향으로 얼마만큼의 포인트를 얻어내는가?

-수직적으로 몇개의 채널을 사용하는가?

-회전형 : 4채널, 128채널 비교해보면, 해상도 차이 큼(128채널 더 좋음) -> 인지 성능 차이(but 가격 비쌈) - 데이터의 희소성

점으로 표현되는 데이터 : 멀리 있는 물체의 경우 반사되는 레이저의 수가 적음 -> 라이다 포인트 데이터의 분포가 희소해짐 -> 먼 물체에 대한 검출 성능 저하 야기

이러한 데이터의 희소성은 높은 해상도를 가진 카메라와 라이다 센서를 융합함으로써 극복 가능!

라이다 데이터 표현 방식

- 신호가 반사되어 돌아온 물체 위치를 3차원 좌표 (X,Y,Z)와 세기 I로 구성된 4차원 데이터 (X,Y,Z,I)로 표현

- 한번 또는 여러번 시야각 FoV(Field of view) 영역을 스캐닝 -> 레이저 반사 신호에 해당하는 포인트들의 집합(포인트 클라우드) 생성

- 포인트 클라우드 데이터

-3차원 공간에서의 점들의 집합

-정해진 순서 없이 포인트 처리

-채널 수, 회전 속도 등에 의해 해상도 결정 - 스캐닝하는 동안에도 차는 이동하기 때문에, 차의 속도 정보 등을 이용해서 이동량만큼의 라이다 보정 작업 필요

- 라이다를 동시에 여러개 장착하는 경우에는 라이다들이 서로 간섭을 일으킬 수 있기 때문에, 스캐닝의 주기와 동기화를 꼭 맞춰주어야 함

[라이다 기반 물체 검출 기술]

- 라이다 기반 물체 검출 기술

라이다 센서 데이터를 분석하여 물체의 위치와 종류 추정 - 3차원 영역의 물체 검출

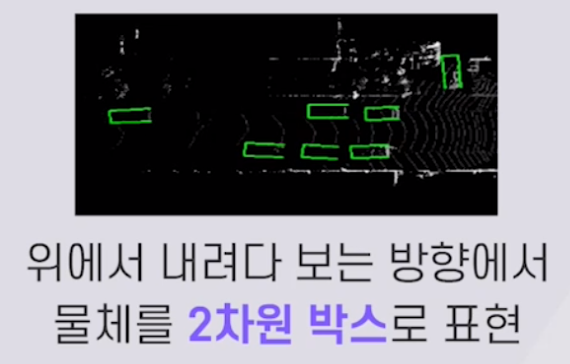

3차원 영역에 물체를 포함하는 3차원 박스로 물체의 위치 표현 - 조감도 영역의 물체 검출

주변을 위에서 내려다보는 방향에서 물체를 2차원 박스로 표현

라이다 기반 물체 검출 기술 개요

- 라이다 기반 물체 검출 기술 : 라이다 센서 데이터를 분석하여 물체의 위치와 종류 추정

- 라이다 포인트 클라우드 데이터

-N개의 포인트들의 집합으로 구성

-분석하여 주변 동적 객체 검출!

(예> 전방에 차가 있는 경우 -> 그 영역에 반사된 라이다 포인트들이 3차원 형태에 대한 정보 제공)

- 딥러닝 기반 검출 기술의 적용 : 카메라 센서 + 라이다 센서

라이다 기반 물체 검출 기술 분류

- 검출 결과 표현 방법에 따른 분류

- 3차원 영역의 물체 검출

-카메라 사용시 3차원 물체 검출 결과를 얻기 쉽지 않음, but 라이다 센서를 사용하게 되면 거리와 형태 정보를 제공받아 3차원 물체 검출이 가능(정확도 꽤 높은편)

-라이다 해상도 높을수록 -> 좋은 정보 얻음 -> 검출 성능 더 좋아짐

- 조감도 영역의 물체 검출(Bird's eye view)

-카메라 사용시 물체의 크기가 거리에 따라 다르게 다르게 보임, but 조감도 영역에서는 물체의 크기가 비슷하게 보임 -> 검출이 쉬움

-카메라 사용시 물체의 박스가 다 세워져 있음, but 조감도 영역에서는 조감 물체의 회전 각도도 추정해야 함

-주변 동적 객체에 대한 필수 정보 제공

- 라이다 데이터 전처리 방식에 따른 분류

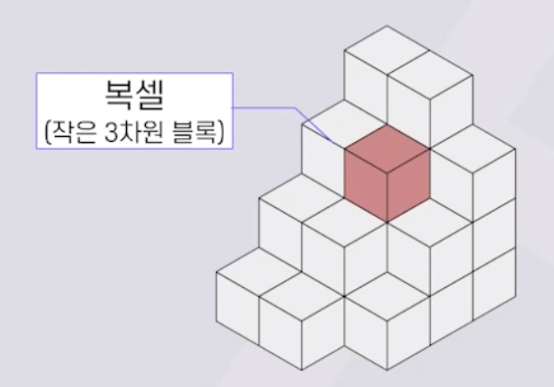

- 복셀 기반 라이다 처리

-라이다 포인트 클라우드는 3차원 영역에 분포된 무수히 많은 점으로 표현되는데, 이 점들을 한번에 처리하기에는 계산량이 너무 많음 -> 주변의 3차원 영역을 복셀(작은 3차원 블록)로 나누게 됨

-각 복셀 안에 있는 라이다 포인트 클라우드 처리 -> 물체에 대한 정보 추출

-전체 1% 미만에 해당하는 복셀들만 포인트가 차 있음, 대부분은 비어있음

-> 희소한 포인트 분포를 해결하기 위해 효율적인 계산 방식 필요

- 라이다 포인트 클라우드를 직접 처리

-포인트넷(딥러닝 방법) 적용 -> 포인트 클라우드에서 정보 추출

-포인트 수가 많은 경우 계산량을 줄이기 위한 방법 필요

[라이다 기반 물체 추적 기술]

- 라이다 기반 물체 추적 기술

라이다 센서를 통해 얻은 검출 결과들을 시간적으로 연결하고 연결된 검출 결과에 대해 물체ID를 부여하는 작업 - 라이다 기반 물체 추적 기술 동향

최근 딥러닝 기술이 물체 검출 기술뿐만 아니라 물체 추적에도 적용되는 추세 - 물체 검출, 추적의 통합 설계

물체 검출, 추적을 통합적으로 설계하여 보다 좋은 인지 성능 달성 가능

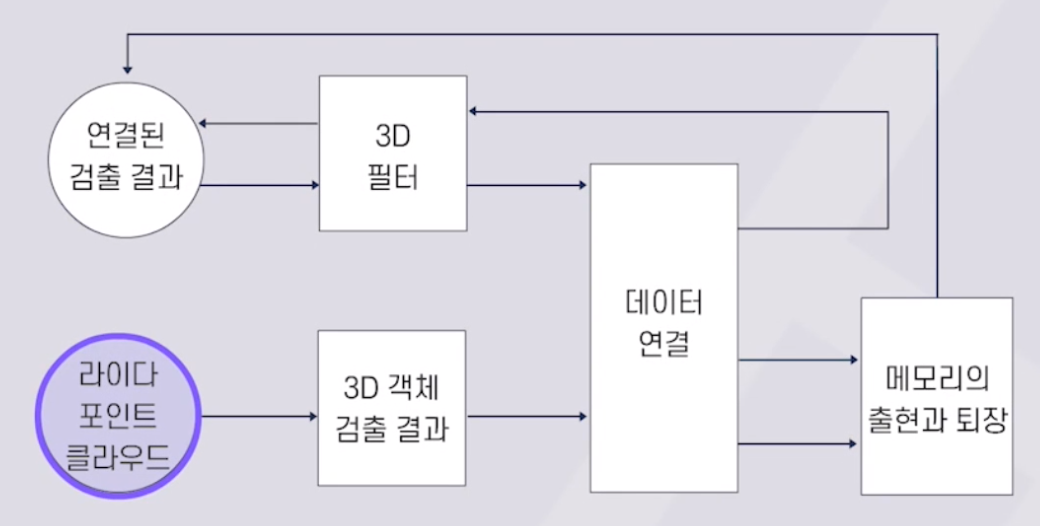

라이다 기반 물체 추적 기술 개요

- 3차원 객체 검출 결과 출력 -> 연결 -> 객체 움직임 추적

- 동적 객체들의 트랙을 관리하는 것이 물체 추적 기술의 핵심(트랙 : 각 물체들이 현재 시간까지 움직여 온 경로) -> 동적 객체들이 어떻게 움직이고 있는지 추적

물체 추적의 과정

- 3D 객체 검출 결과 : 포인트 클라우드 데이터를 이용하여 물체 검출 결과 도출

- 데이터 연결 : 현재 관리하고 있는 물체들의 트랙과 검출 결과를 연결

- 메모리의 출현과 퇴장 : 새로 출현하거나 퇴장하는 물체에 대해 결정하는 로직을 설계해야함

- 3D 필터 : 연결된 검출 결과를 물체들의 트랙에 추가한 후 필터링

->> 위의 과정을 계속 반복하면서 움직임 추적

라이다 기반 물체 추적 기술 동향

- 딥러닝 기반 물체 추적

- 연결

-딥러닝에서 추출된 특징값을 사용해 트랙과 물체의 유사도 측정

-트랙과 검출 결과들의 관계를 파악하기 위한 그래프 구조의 최신 딥러닝 구조 사용되고 있음 - 필터링

-LSTM, RNN 등의 딥러닝 모델 사용

-기존에는 칼만필터를 사용했는데, 딥러닝 모델을 사용하니 더 좋은 성능을 내는 것을 확인

물체 검출과 물체 추적의 통합 설계

- 지금까지는 서로 따로 발전해 옴, 통합적인 설계에 대한 기술 개발은 미비했음

- 최근 딥러닝 기술이 사용되면서, 물체 검출 기술 향상, 추출된 특징값들을 활용하여 추적 기술의 성능을 개선하는 데에 사용

- 최근에는 추적 기술에도 딥러닝이 적용되면서, 통합적인 설계 가능해짐

- 추적 기술에 시간적인 상관도를 활용하면서 검출 기술 성능 향상에 사용 가능함

- 서로 통합적으로 최적화하는 인지 기술에 대한 연구 개발 필요

[복합센서 적용 기술]

- 센서

측정 대상물로부터 외부 물리적 신호들의 정보(빛, 소리, 화학물질, 온도 등)를 측정하여 기계가 이해할 수 잇는 신호로 변환하는 소자 또는 장치 - 자율주행차에 장착되는 대표 센서

카메라, 레이더, 라이다 센서

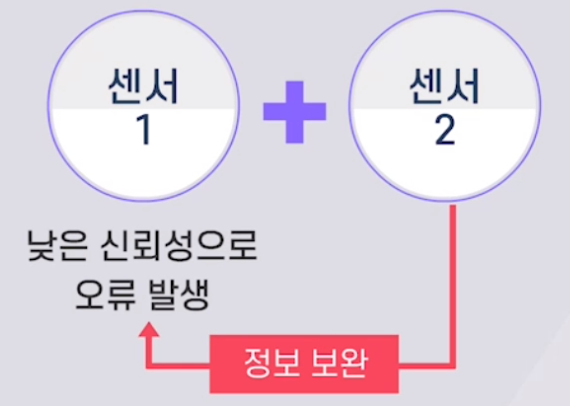

자율주행에서는 높은 신뢰성, 환경 변화에 대한 강인성이 중요!(환경변화가 심하기 때문)

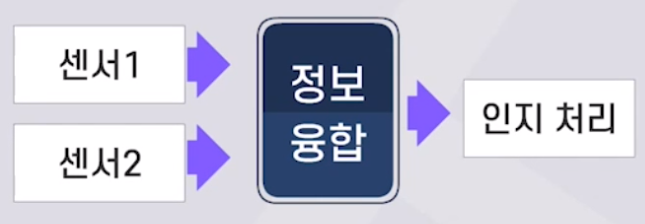

-한가지만 사용하게 되면 환경변화에 약할것임 - 센서융합 기술

하나 이상의 복합 센서를 사용하여 주변 정보를 취득하고 이를 융합하여 인지 수행

복합센서 적용 기술 개요

- 카메라 센서

-단점 : 날씨, 조도 변화 등에 약함, 거리 측정 정확도가 높지 않음

-장점 : 해상도가 높음, 색상, 형태 등의 정보 취득 가능 - 레이더 센서

-단점 : 클러터 등으로 인한 오탐률이 높음, 횡방향 측정 정확도가 낮음

-장점 : 날씨, 조도 변화 등에 강함 - 라이다 센서

-단점 : 가격이 높음, 습도에 약함

-장점 : 거리 측정 정확도가 높음, 고가 라이다의 경우 해상도도 높은 편, 조도 변화에 대한 영향은 없음 장점을 이용하고 단점을 보완하기 위한 복합 센서 융합 기술 필요!

복합 센서 융합 기술

- 라이다를 사용하지 않는 구성(카메라+레이더)

-2, 3단계 자율주행에 적합

-저가 - 라이다를 사용하는 구성

-카메라+라이다

-카메라+레이더+라이다

-4단계 이상 자율주행에 적합

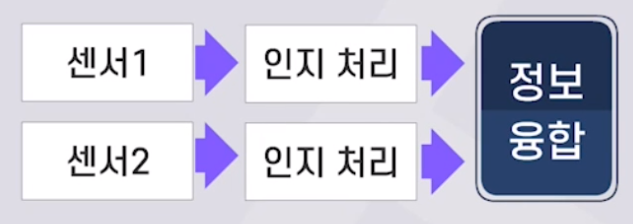

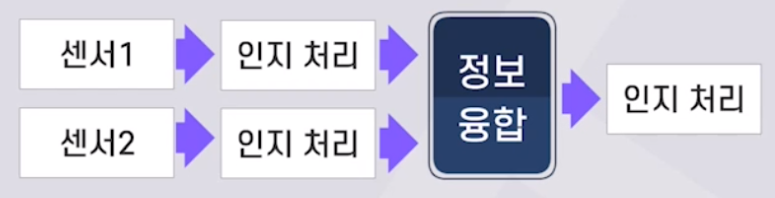

복합센서 융합 전략

-

초기 융합(Early Fusion)

-장점 : 인지 처리를 한번만 수행하면 됨(계산량이 적음)

-단점 : 데이터의 분포가 확연히 다를 경우 융합에 의한 성능 이득이 낮음(예>카메라+라이다 조합)

-

후기 융합(Late Fusion)

-장점 : 최종 단계에서 융합하기 때문에 센서 오작동에 대한 분석 가능(오작동 한 센서 인지 가능, 센서 인지 결과에 대한 신뢰도 파악)

-단점 : 모든 센서 데이터에 대해 인지 처리를 수행해야 함(계산량이 많음)

-

중기 융합(Intermediate Fusion)

-초기융합+후기 융합

-최근 딥러닝 기술이 인지에 적용되면서 중기 융합 전략 선호됨 -> 더 좋은 성능 달성 가능

[센서융합 기술 사례]

카메라, 레이더 센서 융합

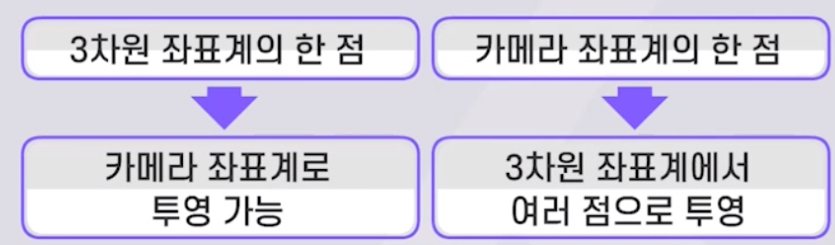

- 카메라, 레이더 캘리브레이션 적용

- 카메라의 데이터 표현은 카메라 좌표계(2차원), 레이더의 데이터 표현은 3차원 좌표계(3차원) -> 데이터를 융합할 수 있는 방법 필요(변환 필요 -> 카메라, 레이더 캘리브레이션 적용, 2차원과 3차원이기 때문에 일대다 관계)

- 연구 개발 진행중

- 전략

- 레이더 검출 결과 또는 중간 단계 결과를 카메라 좌표계로 투영하여 병합

- 카메라 영상 기반 물체 검출 결과 또는 중간 단계 결과를 레이더의 3차원 좌표계로 변환하여 융합

-인공지능 기술을 사용하는 전략 필요

카메라, 라이다 센서 융합

- 카메라, 라이다 캘리브레이션 적용

- 카메라 중심 융합기술과 라이다 중심 융합기술 존재

- 라이다의 해상도에 따라 검출 성능 좌우

- 카메라의 데이터 표현은 카메라 좌표계(2차원), 라이더의 데이터 표현은 3차원 좌표계(3차원) -> 변환 필요!

- 라이다 데이터의 해상도가 높지 않은 경우 카메라가 메인! 라이다의 데이터를 카메라 좌표계로 투영

- 라이다 데이터의 해상도가 높은 경우 라이다가 메인! 카메라의 데이터를 3차원 좌표계로 변환

카메라, 레이더, 라이다 센서융합

- 인지의 높은 신뢰성이 요구되는 레벨4 이상의 자율주행을 위해 필요

- 실시간 센서융합 처리를 위한 알고리즘, 하드웨어 구현 필요(계산량 많기 때문)

[고성능 인지를 위한 하드웨어/소프트웨어/통신 플랫폼]

고성능 인지 요구 사항

- 대용량의 센서 데이터를 고속으로 실시간으로 처리할 수 있는 능력

- 인지를 위한 기능들을 통합적으로 처리하고 결과를 주고받을 수 있는 능력

- 대용량의 데이터를 수집, 저장, 송신할 수 있는 능력

- 고신뢰성, 저전력 요구 사항을 만족할 수 있는 능력

- 하드웨어, 소프트웨어의 오류에 대한 강인성과 오류 검출 능력

- 인지 정보를 주변 차량, 보행자, 인프라와 무선으로 주고 받을 수 있는 능력

고성능 인지를 위한 하드웨어

- 전통적인 자동차에서는 ECU(컴퓨팅 하드웨어 칩셋) 사용 -> 간단한 주행 관련 컴퓨팅 수행, 자율주행을 위한 고성능 컴퓨팅에는 맞지 않음 -> 고성능 컴퓨팅을 수행하기 위한 차량용 반도체 프로세서로의 진화 필요

- 차량용 고속 네트워크 링크 필요

- 실시간으로 전달되는 센서 데이터를 고속으로 처리하기 위한 프로세서 필요

- 뉴럴 네트워크 연산을 수행하기 위한 가속기 및 병렬처리 프로세서 필요

- 오류에 대한 강인성을 확보하기 위한 하드웨어 설계 필요

(예> 듀얼 프로세서 탑재)

고성능 인지를 위한 소프트웨어

- 안드로이드와 같은 오픈 소프트웨어 플랫폼 필요

- AI를 처리할 수 있는 소프트웨어 필요

- 자율주행 개발 프로세스(개발-시뮬레이션-테스트-구현)를 총체적으로 설계 가능한 개발자 소프트웨어 플랫폼 필요

- 설계 소프트웨어 필요(딥러닝 모델 압축-고정소수점 구현-하드웨어 경량화)

고성능 인지를 위한 통신 플랫폼

-

자율주행 통신 플랫폼 : V2X 기술(Vehicle To Everything, 차량이 유무선망을 통해 도로 위의 다양한 요소와 소통하는 기술), OTA 기술(Over the air, 자동차 무선업데이트)

-

통신 플랫폼 사용 시 정보 보안 및 개인정보 보호 기술 중요

-

V2X 기술

-자율주행차, 인프라, 엣지 -> (주행관련 데이터 정보 수집 -> 주변 차량으로 정보 전송)

-차량 또는 보행자와 사이드링크를 통해 인지 정보 공유 -> 가려서 보이지 않는 곳(음영)까지 인지 가능, 군집 주행 가능(군집 주행 : 두 대 이상의 차량이 하나의 대열을 이루어 자동으로 주행하게 되는 시스템)

-인프라와 주변 동적 객체로부터 수신된 주행 관련 정보 + 자율주행 차량 센서로 취득한 정보 -> 협력 인지 수행

-안전한 자율주행을 위해 초저지연(Low latency) 통신 기술 필요 -

OTA 기술

-인지 소프트웨어 기능을 주기적으로 업그레이드

-통신 플랫폼 사용 시 정보보안 및 개인정보 보호 기술 중요

[AI 기반 인지시스템을 위한 지능형 반도체 기술]

그래픽 프로세싱 유닛(GPU)

- 병렬처리에 특화된 범용 프로세서

- 기존에는 그래픽 처리 목적, 최근에는 AI를 위한 반도체

- NVIDIA의 기술력이 가장 앞서 있음

- 자율주행에서는 주로 클라우드 서버에서 학습을 위한 용도로 사용

뉴럴 프로세싱 유닛(NPU)

- 엣지나 디바이스에서 사용하기 위한 저전력, 고속 AI 반도체 칩셋

- 딥러닝에 많이 사용되는 계산을 빠르게 저전력으로 수행하는 가속기 사용

- 예>삼성 엑시노스, 테슬라 FSD 컴퓨터

- 현재 국내외 많은 기업들이 NPU 개발에 뛰어듬

AI 기반 인지를 위한 지능형 반도체 사례

-

테슬라 FSD(Full Self Driving) 컴퓨터

-칩셋과 파워서플라이를 여분으로 2개를 사용 -> 고장이나 오류 발생 시 계산의 신뢰성을 높임

-카메라, 레이더, GPU, 지도, IMU센서, 초음파, 조향각 등 센서 정보를 수신할 수 있는 인터페이스 장착

-많은 전력 소모 시 차량에 부담-40와트 이하의 전력 소모량

-가속기를 장착하여 뉴럴네트워크 연산을 50 테라 초당 명령 수 속도로 수행 가능

-일반적인 전처리, 후처리 등의 범용계산을 위해 GPU와 CPU 장착

-고성능 영상처리 칩과 고성능 인코더 장착 -

구글 TPU(Tensor Processing Unit)

-구글에서 디자인한 가속기 아키텍쳐

-NVIDIA GPU V100보다 연산속도 27배 빠름

-최근 V3버전 : 1024개의 코어 사용, 강력한 병렬 연산 능력

-가격 저렴

-8비트 연산 기반의 딥러닝 모델 설계 지원 -> 빠르게 연산 가능

자율주행을 위한 지능형 반도체 발전 방향

- 하드웨어 플랫폼 + 소프트웨어 플랫폼 -> 자율주행 경쟁력 좌우

- 하드웨어 플랫폼 : 교체가 어려움, 독점 가능 -> 기술 선점 중요

- 자동차 하드웨어의 안전성 중요(ISO26262와 같은 자동차 하드웨어의 기능 안전성에 대한 요구사항을 만족해야 함)

- 딥러닝 기술과 자율주행 시스템이 계속 진화될 것 -> 확장 가능성을 지원하는 하드웨어 플랫폼 필요

[고정밀 지도 기반 자율주행 개요]

고정밀 지도 기반 자율주행의 필요성

- 센서만으로 주변의 정적 주행 환경 및 도로, 교통 환경에 대한 정보를 수집하는 것은 한계가 있음

- 차량 주위의 정적 환경에 대한 정밀한 정보를 제공함으로써 자율주행의 안전성 향상

- 이미 오프라인에서 구축한 후 활용 -> 시스템, 계산량 오버헤드가 적은 편

- 고정밀 지도 : cm 단위의 정확도를 갖는 지도

- 고정밀 지도 기반 자율주행의 장점

- 정확한 정적 환경 정보를 얻을 수 있기 때문에 자율주행 안정성 향상

- 주행, 교통 환경에 대한 빠르고 정확한 판단 가능

- 센서 데이터로부터 도로 정보를 정확히 얻기 위한 인지 기술의 부담을 덜어줌

- 고정밀 지도를 사용하기 위해 요구되는 사항

- 주행 관련 도로 정보들이 표현되어 있어야 함

- 0.2m 이하의 매우 정밀한 정확도 요구됨

- 자율주행차가 고정밀 지도 위에서 자신의 위치를 알아내야 함 -> 맵매칭을 효과적으로 수행하기 위한 환경 정보 포함 필요

- 도로, 주행 환경이 바뀔 때마다 실시간 업데이트 지원 필요 -> 클라우드에서 관리되는 것이 효과적

- 고정밀 지도가 업데이트될때마다 OTA를 이용하여 새로운 지도 정보를 자율주행 차량에 무선 전송

자율주행에서의 고정밀 지도의 활용

- 정밀 자율주행차 측위

-고정밀 지도를 활용하기 위해서 자율주행차의 지도상 위치를 정확히 파악하는 기술

-> 맵매칭(센서 정보와 고정밀 지도 정보를 맵매칭하여 측위) - 주행 경로 생성 및 예측

-차선과 같은 주행정보 이용 -> 차량의 주행 경로 생성

-도로의 곡류, 횡단보도 등의 교통 환경 반영 -> 상황 예측

-신호등, 표지판 등 위치 정보 활용 -> 인지 결과 대체, 인지 정확도 향상에 활용 - LDM 동적 정보 시스템(Local Dynamic Map) 활용

-인프라, 엣지, 자율주행차 등으로부터 얻은 동적 객체들의 위치와 상태를 고정밀 지도 위에 표현

-특정 지역에 주행 상황에 대한 종합적인 정보 표현 -> V2X를 통해 다른 자율주행차들과 공유 -> 원활한 자율주행 가능

-고정밀 지도에 대한 지속적 업데이트 수행 - 센서의 제한된 인식 범위 보완

[고정밀 지도 및 측위기술]

- 센서가 감지해야 하는 정보를 지도 정보를 이용하여 보완!

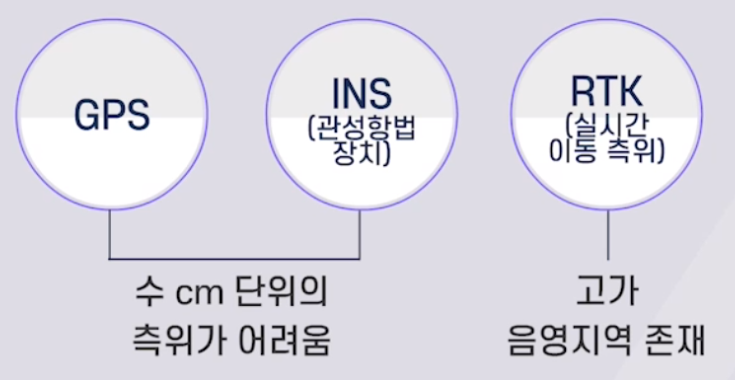

GPS 위성 신호 분석

- GPS 수신기는 대부분 차량에 장착되어 있음

- 전파 수신 상황에 따라 위치 정밀도가 좌우됨

- 위치 오차가 미터 단위이기 때문에 자율주행에 필요한 정확도 얻기 어려움

- 음영지역 존재

RTK(Real time Kinematic) 기술

- 정밀한 위치를 확보한 기준점의 반송파 오차 보정치를 적용하여 수 cm의 정밀도 표현(고정밀 이동측량 기법)

- 장점 : 높은 측위 정확도

- 단점 : 고가의 장비 가격, 음영지역 존재(위성 사용하기 때문)

관성항법 장치

- IMU 등 관성 센서 정보를 활용하여 움직이는 이동 경로를 측정하는 방식

- 단점 : 시간이 지속됨에 따라 오차가 지속적으로 누적되어 증가

고정밀 지도 기반 측위 기술

- SLAM(Simultaneous localization and mapping)-로보틱스 분야

지도 생성 + 측위 수행 동시에 함 -> 활발히 연구되어 옴 - 자율주행에서는 MMS 기술(Mobile Mapping System, 이동식 도면화 시스템)을 이용하여 고정밀 지도를 미리 생성 -> 자율주행차는 주행시 고정밀 지도를 활용하여 측위만을 수행

- 기존 측위 기술의 한계 극복

환경 인식 센서 + 고정밀 지도 필요!

-> 맵매칭 방식!

맵매칭 방식의 측위기술

- 인지 기술을 통해 얻은 주변의 정적 환경 정보를 고정밀 지도에 포함된 환경 정보와 매칭하여 측위 수행

- 고정밀 지도 기반 측위를 위한 두가지 단계(반복)

- Odometry 기술

차량이 과거 위치에서부터 얼마만큼 움직였는지 측정

-시간이 갈수록 오차가 누적된다는 단점 - 맵매칭 기술

Odometry 기술 + 환경,GPS,IMU 센서 정보 -> 맵매칭 -> 고정밀 지도 위에 정확한 위치 측정

- 측위 정확도를 향상시킬 수 있는 기술

- Odometry 정확도 향상 : 주행 시 자율주행 차량의 움직임에 따른 카메라, 라이다 등의 센서 데이터의 변화 분석

- 맵매칭 기술 정확도 향상 : 고정밀 지도에 어떤 환경 정보를 넣을 것인가 결정(예> 도로정보, 랜드마크), 센서로부터 지형에 관한 의미있는 정보 추출하여 맵과의 정보 매칭, 센서데이터와의 정밀한 맵매칭 알고리즘 개발(인공지능 도입)

[MMS 기반 고정밀 지도 구축 기술]

MMS의 개념

MMS(Mobile Mapping System, 이동식 도면화 시스템)

주행 중인 차량에 장착된 다양한 센서를 이용해 세밀한 지형 정보를 획득하여 지도 구축(사진 측량과 비슷)

수집 후에도 차선, 표지판 등을 위성사진 등을 통해 가공하는 후작업 필요 -> 상당한 시간과 비용 필요!

MMS 차량의 구성

- DGPS(Differential Global Positioning System)

2개 이상의 GPS 수신 신호를 이용하여 정밀도가 높은 위치 측정 가능 - IMU(Inertial Measurement Unit)

음영 지역에서도 움직임에 의한 상대 위치 변화 측정이 가능한 관성 센서 장치 - 라이다

MMS 차량 윗부분에 장착되어 1초당 100만여개의 레이저를 발사하여 3차원 공간 스캐닝 - DMI(Distance Measuring Instrument)

바퀴 회전 수 측정을 통해 주행거리 측정 - 관성항법장치 INS(Inertial Navigation System)

자이로스코프를 통해 가속도를 구해 적분 -> 속도 계산 -> 이동거리 계산하는 장치

MMS 기반 고정밀 지도 구축 과정

- 작업 계획 수립

-작업지역 현황분석

-노선계획 수립 - MMS 시스템 구축

-MMS 장비의 성능 및 품질 검사 - 기준점 선점 및 측량

-GPS의 측정정확도가 좋지 않은 경우 -> 기준점의 수신신호 분석 -> 위치 측정 오차 보정(DGPS) - MMS 표준자료 제작

-절대위치 측정 데이터 + 스캐너와 카메라로 취득한 데이터 -> 3차원 포인트 클라우드 데이터를 이용하여 지상영상자료 제작 - 포인트 클라우드 데이터 후처리 및 보정

- 객체 추출 후 품질 검사, 벡터 데이터 상대 정확도 검증

- 편집 및 정리 점검

MMS를 통한 고정밀 지도 기술 현황

- MMS를 통한 고정밀 지도 기술에 대한 연구

- 자율주행 기업은 물론 많은 스타트업 기업들이 참여

- 유명한 글로벌 기업 here

-2010년에 시작하여 서유럽과 북미지역을 이르는 방대한 지도 데이터베이스 보유

-전세계 200여국에 달하는 국가의 지도 데이터 제공

-크라우드 소싱 차량의 센서 데이터를 사용하여 드라이브 경로, 차선 정보 등 수집 - TOMTOM

-네덜란드 회사

-우버 등에 지도 플랫폼 서비스 제공

-5100만km가 넘는 지도 데이터 보유 - Hyundai Mnsoft

-2011년부터 MMS 장비를 도입해 지도 구축

-국내 고속도로와 일반도로의 정밀 지도데이터 구축

[AI 기반 측위 기술]

자율주행을 위한 측위 기술

- 측위를 위한 장비 : GPS, INS(관성항법 장치), RTK(실시간이동측위)

-> 자율주행차에 장착된 카메라, 레이더, 라이다 센서 등의 환경 인지 센서를 이용한 측위 방법 고려

- Odometry 기술 : 차량이 과거 위치에서부터 얼마만큼 움직였는지 측정

- 맵매칭 기술 : 센서 정보 + 고정밀 지도 정보 -> 맵매칭 -> 지도 위에 차량 위치 측정

-> Odometry 정확도 향상과 맵매칭 기술 정확도 향상에 AI 기술을 적용함으로써 측위의 정확도와 신뢰성 향상!

측위를 위한 AI 기술

AI 기반의 카메라, 라이다, 관성항법장치를 활용한 통합 Odometry 기술

-

카메라 Visual Odometry 기술

카메라의 움직임에 의한 영상 프레임 사이의 변활르 분석하여 차량의 이동 위치 추정

카메라 영상에 CNN 적용 -> 차량의 이동 위치를 직접 추정 -> 일관된 Odometry 성능을 얻음 -

라이다 Odometry 기술

라이다 포인트의 시간적인 움직임을 분석하여 Odometry 수행 -

통합 Odometry 기술

관성항법 장치 + 카메라 또는 라이다 센서 데이터 -> Odometry 수행 -

AI 기반의 맵매칭 측위 기술(측위를 위한 맵생성)

- 지형 지도 : 주변 지형의 장면의 형태나 구조를 직접 표현, 깊이 복셀, 점, 메쉬 형태로 표현

- 시맨틱 지도 : 랜드마크 또는 도로 정보들을 지형 지도에 추가하여 만든 형태

- 맵매칭 알고리즘에서의 AI 적용

- 지형 지도 기반 측위 : 카메라 또는 라이다 센서 데이터 - 지형 지도 정보를 비교하여 위치 정보 추정

딥러닝 모델 이용 -> 센서 데이터와 지형 지도로부터 특징값 추출 -> 특징값을 처리하여 위치 정보 추정 - 시멘틱 지도 기반 측위

정적 주행 환경 객체 검출 -> AI 적용 -> 지도에 포함된 랜드마크 정보들과 종합하여 위치 추정