해당 글은 제로베이스데이터스쿨 학습자료를 참고하여 작성되었습니다

3. 분산분석

- 셋 이상의 모집단으로부터 추출한 양적데이터를 비교하는 통계적 분석 방법

분산분석의 이해

3-1. 분산분석의 이해

-

실험계획법(experimental design)

- 모집단의 특성에 대하여 추론하기 위해 특별한 목적성을 가지고 데이터를 수집하기 위한 실험설계

-

반응변수

- 관심의 대상이 되는 변수(종속변수)

-

요인/인자(Factor)

- 실험 환경 또는 조건을 구분하는 변수로 실험에 영향을 주는 변수

-

인자수준

- 인자가 취하는 개별 값(처리:treatment)

분산분석의 기본 가정

1) 각 모집단은 정규 분포를 따른다

2) 각 모집단은 동일한 분산을 갖는다

3) 각 표본은 독립적으로 추출되었다

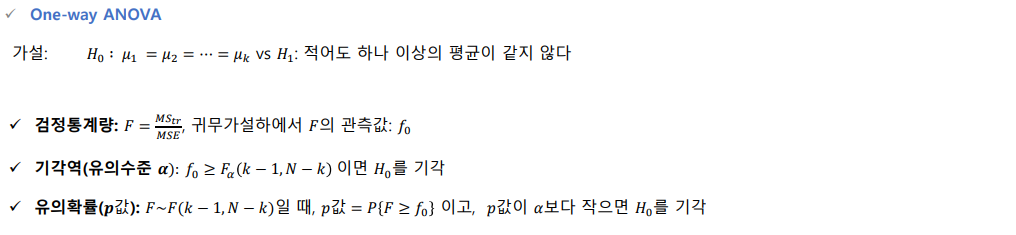

분산분석의 가설과 실험의 가정

가설

- H0: 각 집단의 평균은 동일하다 vs H1: 각 집단의 평균에 차이가 있다

실험의 가정

-

반복의 원리: 실험을 반복해서 실행해야 함

-

랜덤화의 원리: 각 실험의 순서를 무작위로 해야함

-

블록화의 원리: 제어해야 할 변수가 있다면 인자에 영향을 받지 않도록 조건을 묶어서 실험해야 함

분산분석의 종류

일원 분산분석

- 한가지 요인을 기준으로 집단간의 차이를 조사하는 것

이원 분산분석

- 두 가지 요인을 기준으로 집단 간의 차이를 조사하는 것

다원 분산분석

- 세 가지 이상의 요인을 기준으로 집단 간의 차이를 조사하는 것

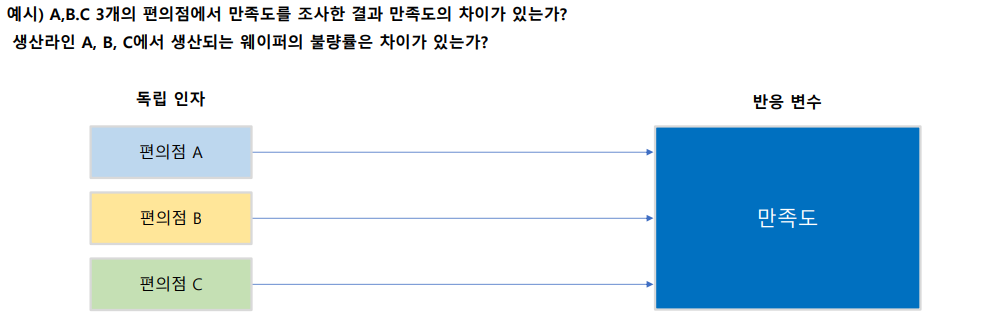

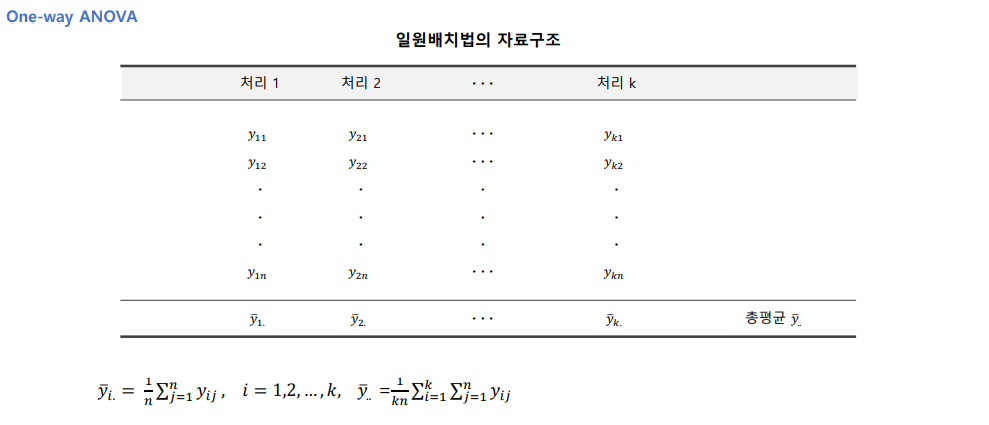

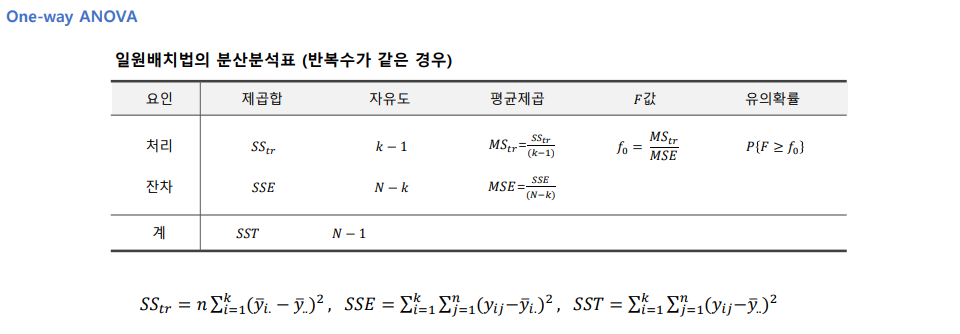

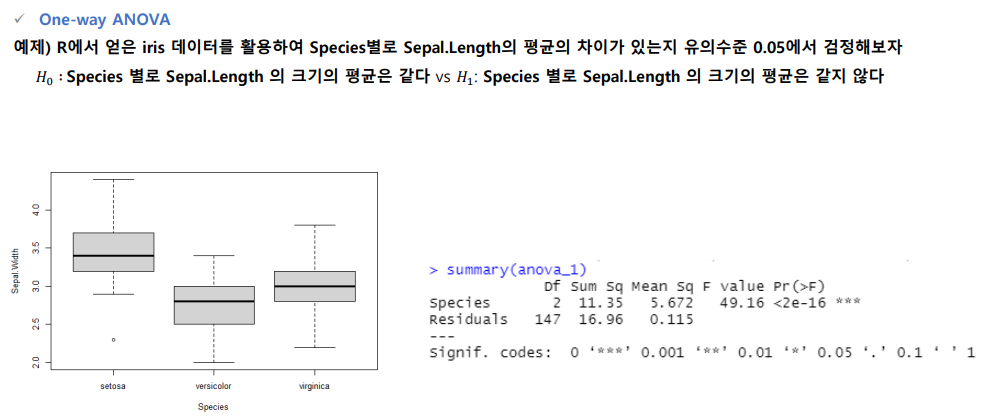

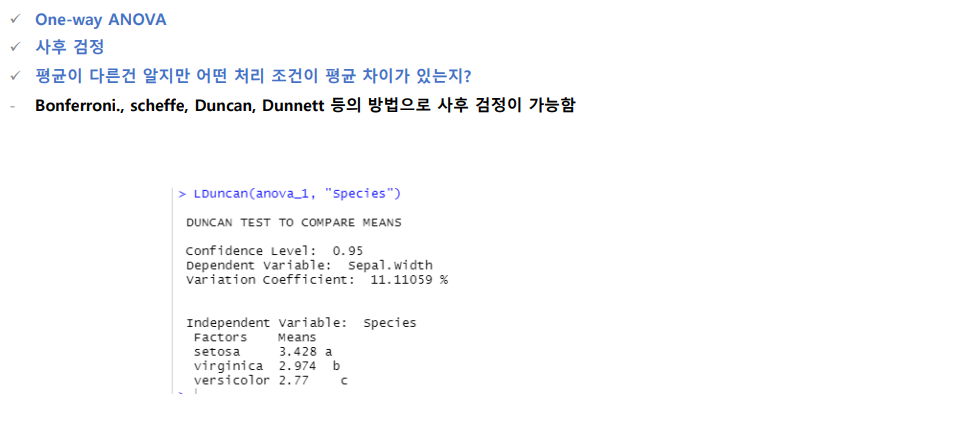

3-2. 일원분산분석(ONE-WAY ANOVA)

-

한 개의 반응변수와 한 개의 독립인자

-

반응 변수 : 연속형 변수만 가능

-

독립 인자 : 이산형 또는 범주형 변수만 가능

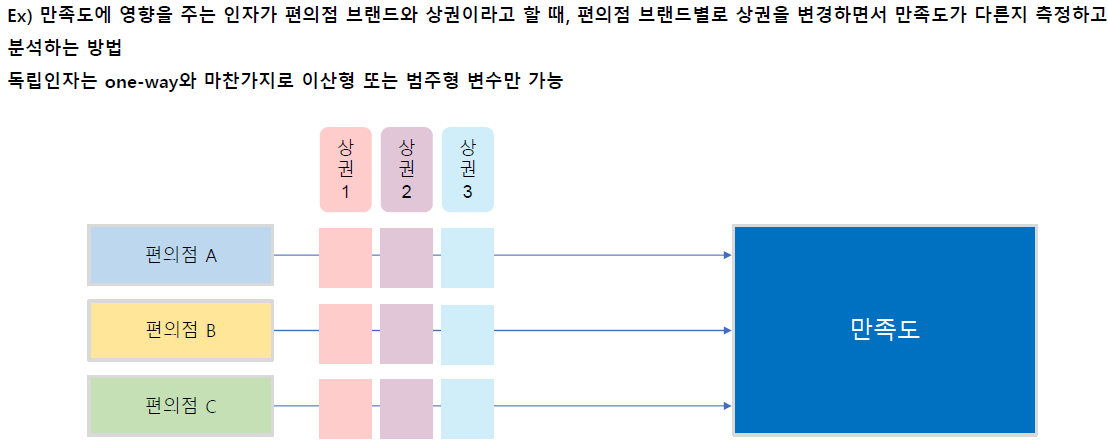

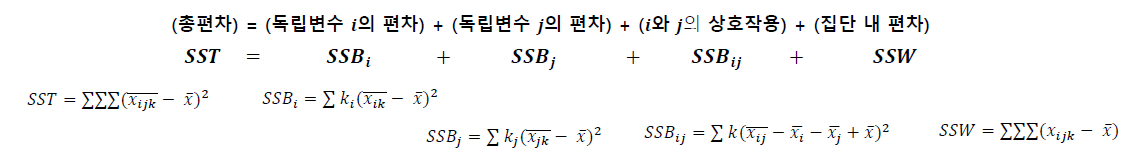

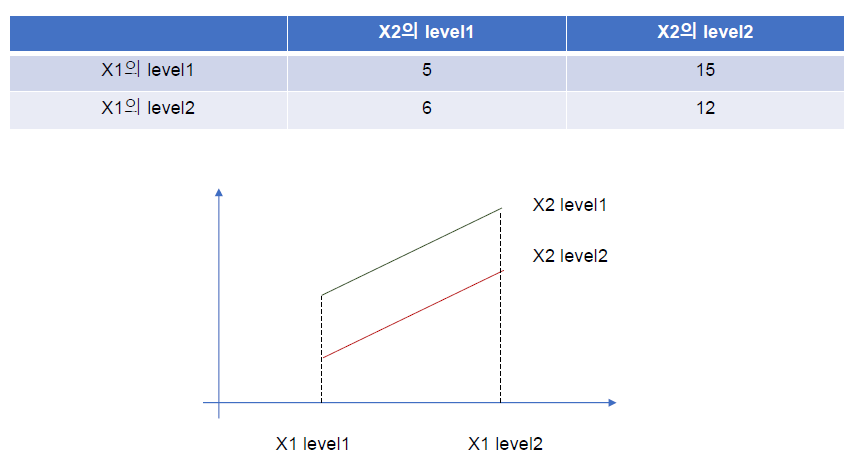

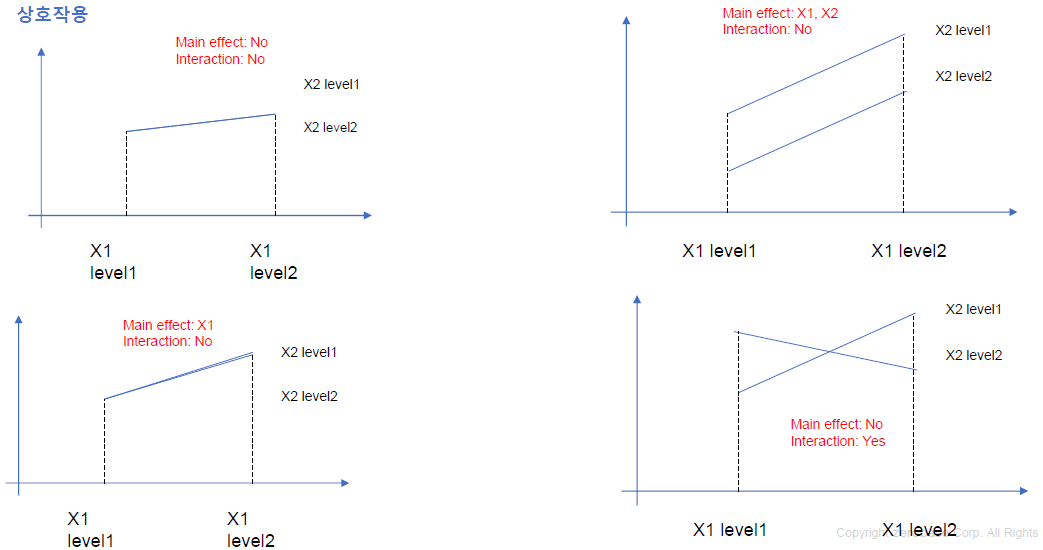

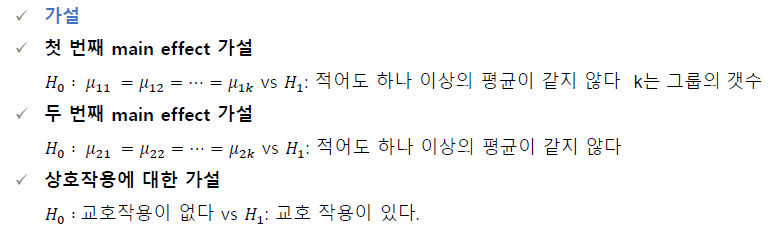

3-3. 이원분산분석(TWO-WAY ANOVA)

-

한 개의 반응 변수와 두 개의 독립 인자로 분석하는 방법

-

상호작용(Interatction effect)

- 한 독립변수의 main effect가 다른 독립변수의 level에 따라서 원래의 선형관계를 비선형관계로 변하는 경우

4. 시계열분석

- 시계열(시간의 흐름에 따라 기록된 것) 자료를 분석하고 여러 변수들간의 인과관계를 분석하는 방법

시계열데이터

- 시간을 기준으로 관측된 데이터로, 보통 일->주->월->분기->년 또는 hour 등 시간의 경과에 따라서 관측한 데이터

- ex) GDP, 주가, 거래액, 매출액, 승인금액 등

- 연속 시계열과 이산 시계열 데이터로 구분됨

연속형 시계열

-

자료가 연속적으로 생성

-

대부분의 데이터 형태가 연속형이나 이산형 정의하여 분석

이산형 시계열

-

일정 시차(간격)를 두고 관측되는 형태의 데이터

-

대부분 이산형 데이터를 분석

시계열 분석의 목적

-

예측

- 금융시장 예측, 수요 예측등 미래의 특정 시점에 대한 관심의 대상(반응변수)을 예측

-

시계열 특성 파악

- 경향(Trend), 주기, 계절성, 변동성(패턴) 등 관측치의 시계열 특성 파악

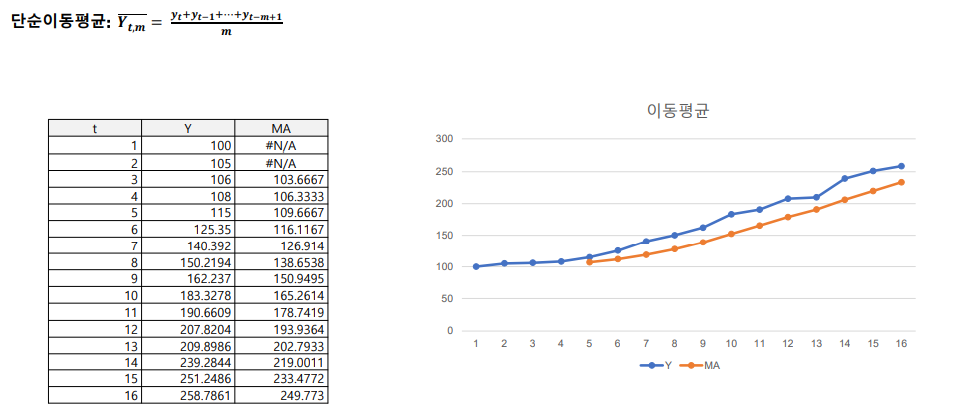

전통적인 시계열 분석 방법

-

이동 평균 모형(moving average)

- 최근 데이터의 평균을 예측치로 사용하는 방법

-

자기 상관 모형(Autocorrelation)

- 변수의 과거 값의 선형 조합을 이용하여 예측하는 방법

-

ARIMA(Autoregressive Integrated Moving Average)

- 관측값과 오차를 사용해서 모형을 만들어서 미래를 예측하는 방법

-

지수평활법

- 현재에 가까운 시점에 가장 많은 가중치 주고 멀어질수록 낮은 가중치를 주어서 미래를 예측하는 방법

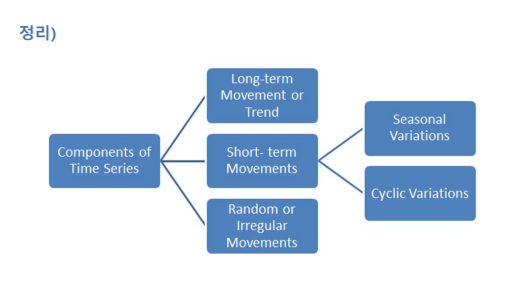

시계열요소

-

경향/추세(trend)

- 시계열 데이터가 장기적으로 증감할 때, 추세가 존재함

-

계절성(seasonality)

- 특정기간(1년마다) 어떤 특정한 때나 1주일마다 특정 요일에 나타나는 것 같은 계절성 요인이 시계열에 영향을 주는 것

- ex) 패션업종, 요일 별 온라인 쇼핑몰 매출

-

주기성(cycle)

- 일정한 주기마다 유사한 변동이 반복되는 현상

- 일정한 주기마다 유사한 변동이 반복되는 현상

-

불규칙요인(Irregular movements)

- 예측하거나 제어할 수 없는 요소

시계열 분석방법

이동평균법

지수평활법

- 모든 관측값을 이용하면서 예측하는 시점에 가까울수록 비중을 두어 최근값이 예측시 더 많은 기여를 하도록 만드는 방법

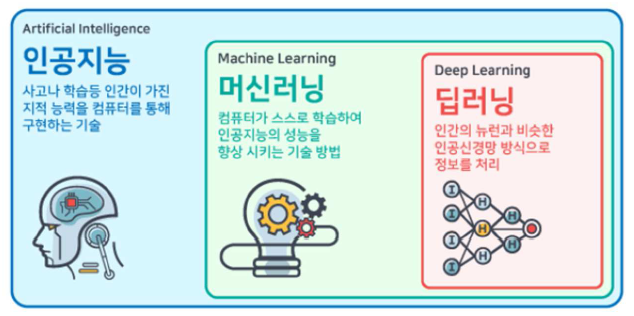

5. 머신러닝 알고리즘

머신 러닝(Machine Learning)

-

인공 지능의 한 분야로, 컴퓨터가 학습할 수 있도록 하는 알고리즘과 기술을 개발하는 분야

-

컴퓨터가 학습 모형을 기반으로 주어진 데이터를 통해 스스로 학습하는 것

머신러닝의 3가지 요소

-

Task

-

Experience

-

Performance

-

Task를 달성하기 위해 경험을 통해 성능을 개선시킴

1) 분석하고자 하는 목표(T)를 정의

2) Experience를 정의하기 위한 데이터를 수집

3) Performance를 향상시키기 위한 Measure를 정의함

ex) 체스

-

E는 많은 체스 게임들의 경험 (체스를 두는 것)

-

T는 체스를 플레이하는 사건

-

P는 다음 경기에서 프로그램이 이길 확률

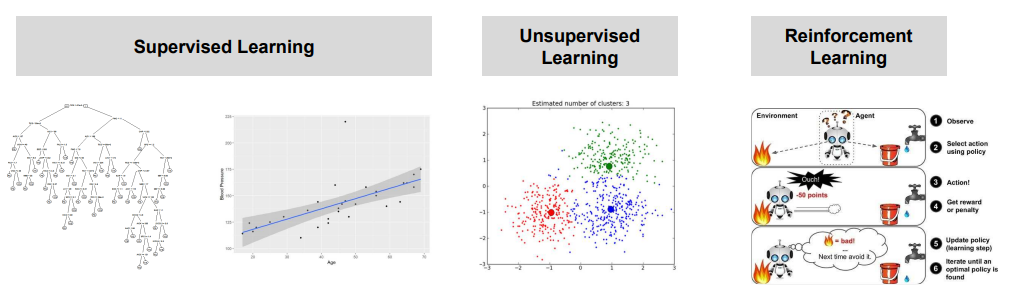

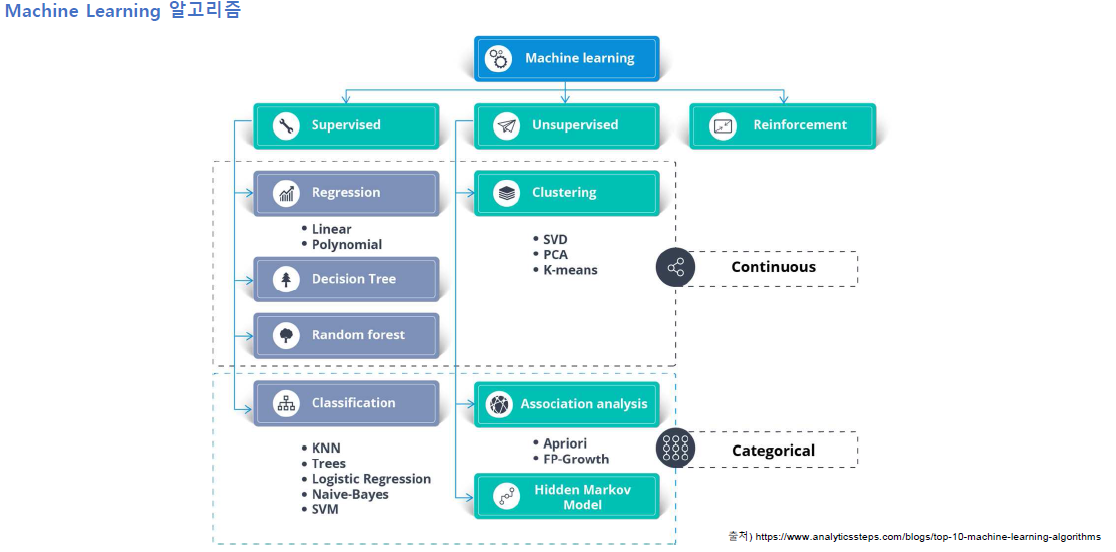

학습방법

지도학습(Supervised Learning)

- Label이 있는 데이터에 대해서 분석하는 방법으로 과거의 데이터로 미래를 예측하는 방법

비지도학습(Unsupervised Learning)

- Label이 없는 데이터에 대해서 분석하는 방법으로 데이터 나누거나 속성별로 분류할 때 사용

강화학습(Reinforcement Learning)

- 보상과 벌을 주어서 학습시키는 방법

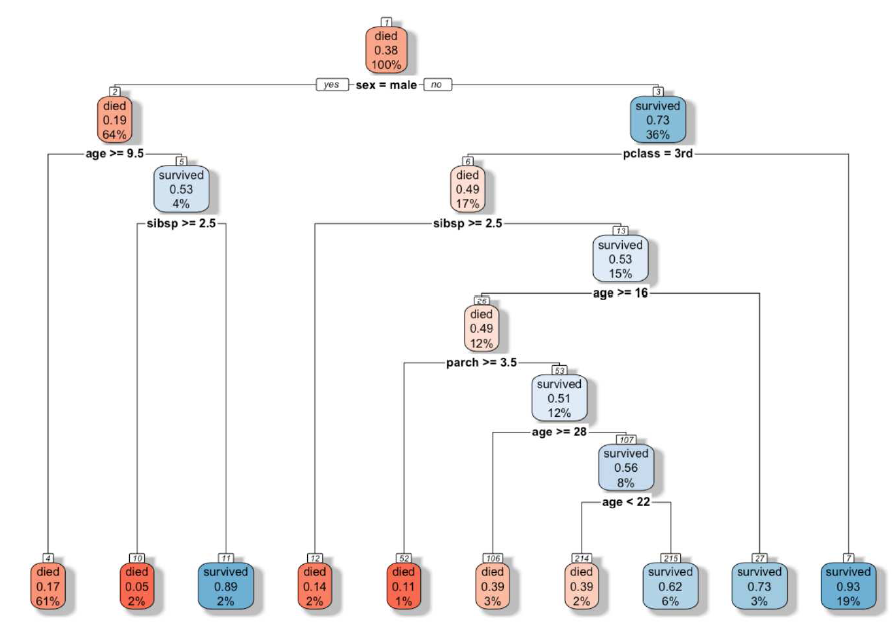

결정트리(Decision Tree)

-

설명변수(X) 간의 관계나 척도에 따라 목표변수(Y)를 예측하거나 분류하는 문제에 활용되는 나무 구조의 모델

-

장점 : 결과 해석이 쉽고 빠름, 선형/비선형에 적용 가능

-

단점: 과도적합의 문제 조심, 분기점에서 오차 발생확률이 올라감

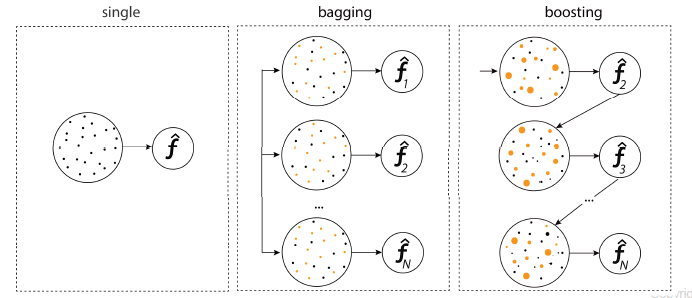

앙상블 모형

Bagging

- boostrap aggregating의 약어로 데이터를 가방(bag)에 쓸어 담아 복원 추출하여 여러 개의 표본을 만들어 이를 기반으로 각각의 모델을 개발한 후에 결과를 하나로 합쳐 하나의 모델을 만들어 내는 것

- ex) Randomforest

Boosting

-

Boosting도 Bagging과 동일하게 복원 랜덤 샘플링을 하지만, 가중치를 부여한다는 차이점

-

Bagging이 병렬로 학습하는 반면, Boosting은 순차적으로 학습시킵니다. 학습이 끝나면 나온 결과에 따라 가중치가 재분배

-

ex) AdaBoost, XGBoost, GradientBoost

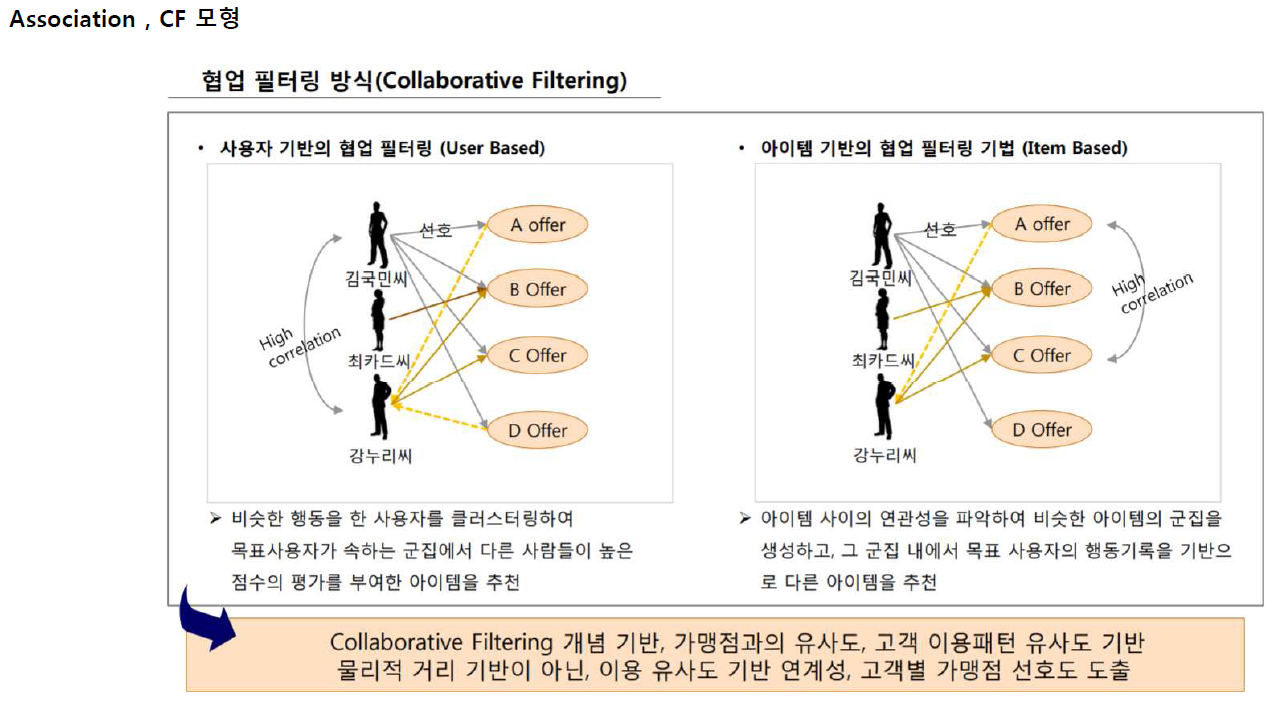

추천모형

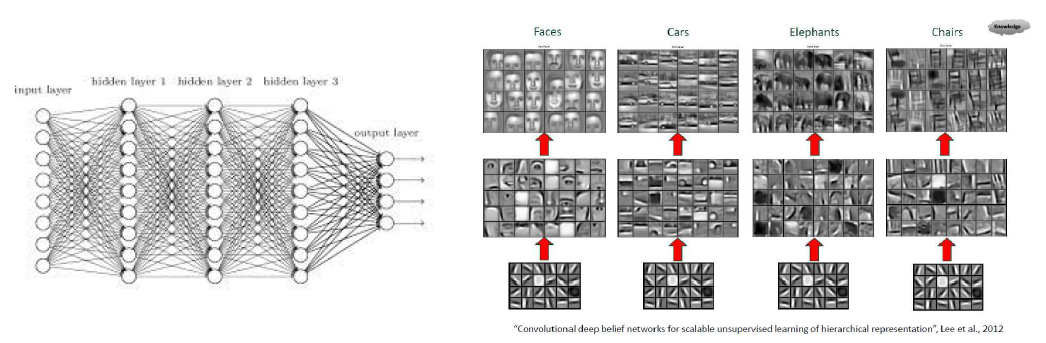

딥러닝(Deep Learning)

-

Deep Learning(딥러닝) 또는 Deep Neural Network라고 불리는 기술은 인공신경망의 발전한 형태로 볼 수 있음

-

인간의 뇌처럼 수많은 노드를 연결하여 이들의 노드 값을 훈련 시켜 데이터를 학습 시킴

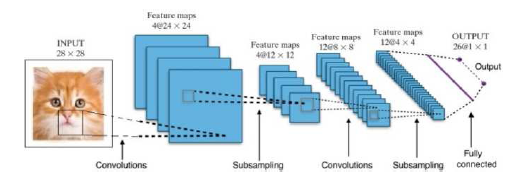

합성곱신경망(Convolutional Neural Network(CNN))

-

기존의 방법은 데이터 -> 지식의 단계로 학습

-

데이터 -> 특징(feature) -> 지식의 단계로 학습을 시킴(예를 들어 사물인식에 있어서 특징정인 선이나 색을 먼저 추출하여 판단)

순환신경망(Recurrent Neural Network(RNN))

-

시계열 데이터 분석에 사용함

-

매순간마다 인공신경망 구조를 쌓아 올린 형태