(2021) Simple Copy-Paste is a Strong Data Augmentation Method for Instance Segmentation

Paper Review

목록 보기

5/6

Abstract

- Copy-Past augmentation : 자른 객체를 랜덤하게 이미지에 붙이는 방법

- 이전에는, 주변 visual context를 반영하였지만, 본 논문은 더 simple한 방식을 제안 - 충분히 좋은 성능을 보여준다고 함

- semi-supervised learning 가능하게 함

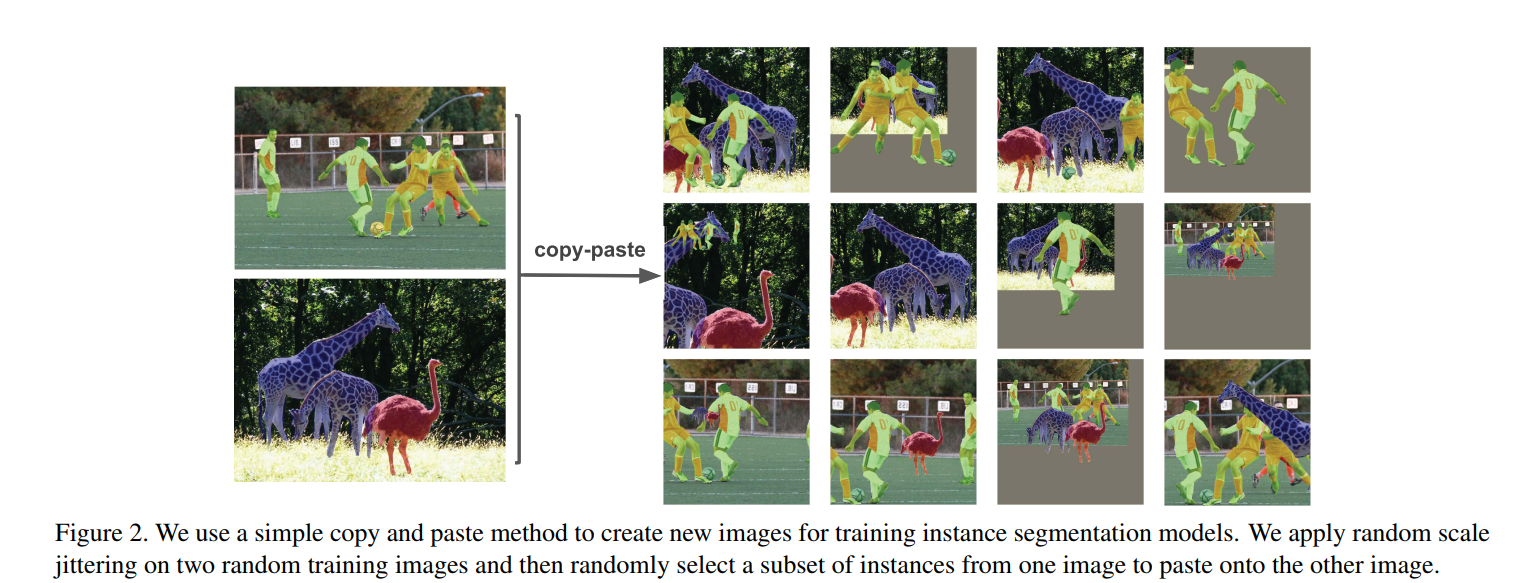

Method

- 랜덤하게 이미지 2장 선택 : src image, main image

- 각 이미지에 random jittering, random horizontal flipping 적용

- 하나의 이미지(=src image)에서 객체 부분 집합 랜덤하게 선택

- 부분 집합의 객체를 다른 이미지(= main image)에 붙이기

- GT annotation 조정 : 완전히 가려진 객체는 삭제 & 부분적으로 가려진 객체는 수정

Blending Pasted Objects

copy-paste 방식 : main image위에 paste할 객체를 붙이는 방식(=덮어 씌우는 형식)

-

: pasted image

-

: main image

-

: paste할 객체의 binary mask 부분

⇒ 즉, 객체 영역()은 pasted image() 사용하고, 그 외의 영역()에는 main image() 사용

-

pasted 객체의 윤곽을 부드럽게 하기 위해 ⇒ (=pasted 할 영역)에 Gaussian filter 적용 - “blending”

(별 성능차이는 없다고 함)

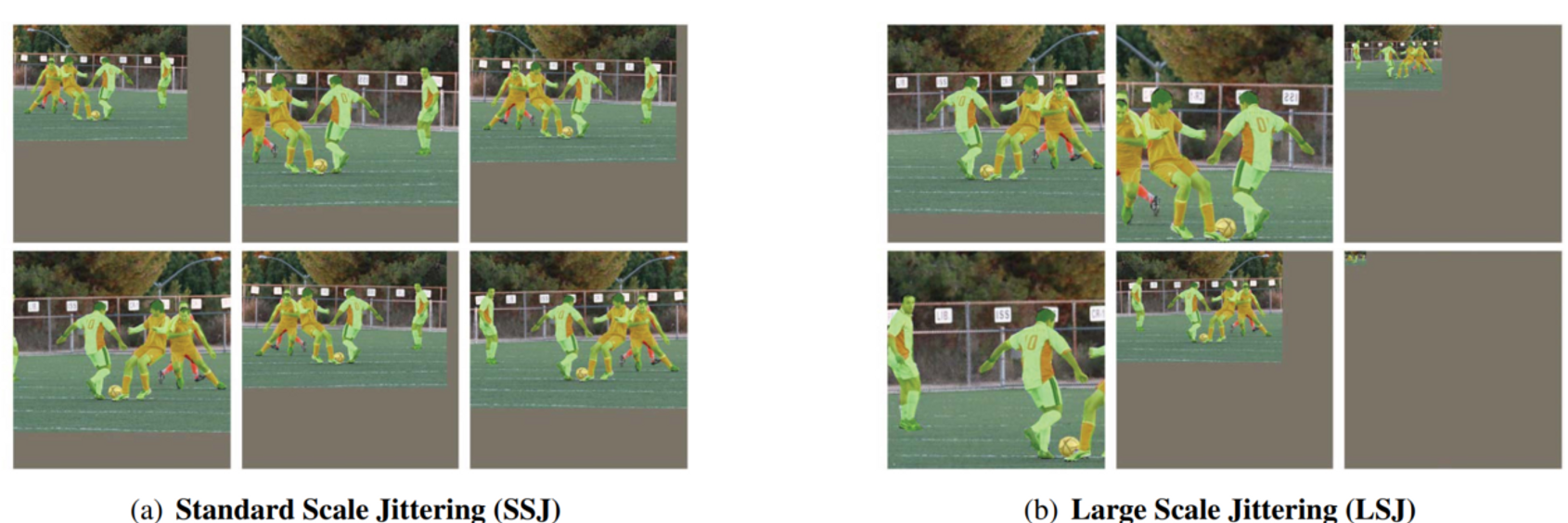

Large Scale Jittering

2가지 sclae jittering augmentation 방법 사용

1. Standard Scale Jittering (SSJ) : 원본 크기의 0.8 ~ 1.25 사이에서 resize

2. Large Scale Jittering (LSJ) : 원본 크기의 0.1 ~ 2.0 사이에서 resize

⇒ LSJ가 더 좋은 성능을 보여줌

Self-training Copy-Paste

- labeled data와 함께 unlabled images 넣어 실험

- Self-training procedure

- labeled data에 Copy-Past augmentation 적용 → supervised model 학습

- unlabeled data에 pseudo labels 생성

- pseudo labeled 이미지와 supervised labeled 이미지에 GT instances 붙임

Conclusion

- Copu-Past 데이터 증강 기법은 effective & robust

- 다루기 쉽고 학습이나 추론 시간을 늘리지 않음

- self-training에도 효과적임