- 학습 목표 :

cost 함수의 값이 최소가 되도록 하는 w와 b를 찾는 것- 방법 :

- 경사하강법 이용

- 학습 과정 (의사 코드) :

for 반복 횟수 for 모든 데이터 1. **순전파** (Forward pass) `→ predict` 2. **역전파** (Backward pass) `→ 도함수 계산` 3. `가중치 업데이트`

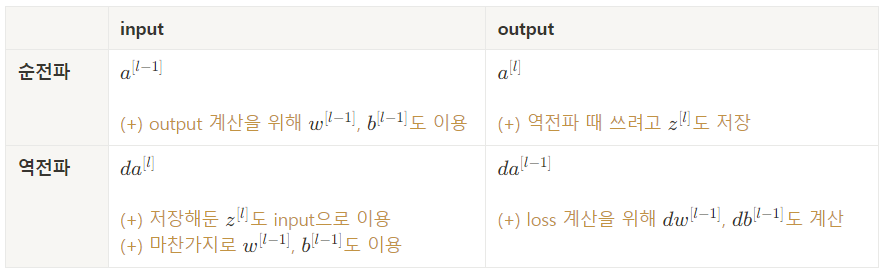

흐름

-

표 부연설명

- : level 의

- 정전파 → 계산

역전파 → 계산 (를 미분한 것)

-

순전파/역전파 구현에서

- 캐시(cache)는 순전파에서의 변수를 → 해당하는 역전파 단계에 전달한다.

- output인 말고도 , , 를 전달하면 미분값을 계산할 때 유용하기 때문이다.

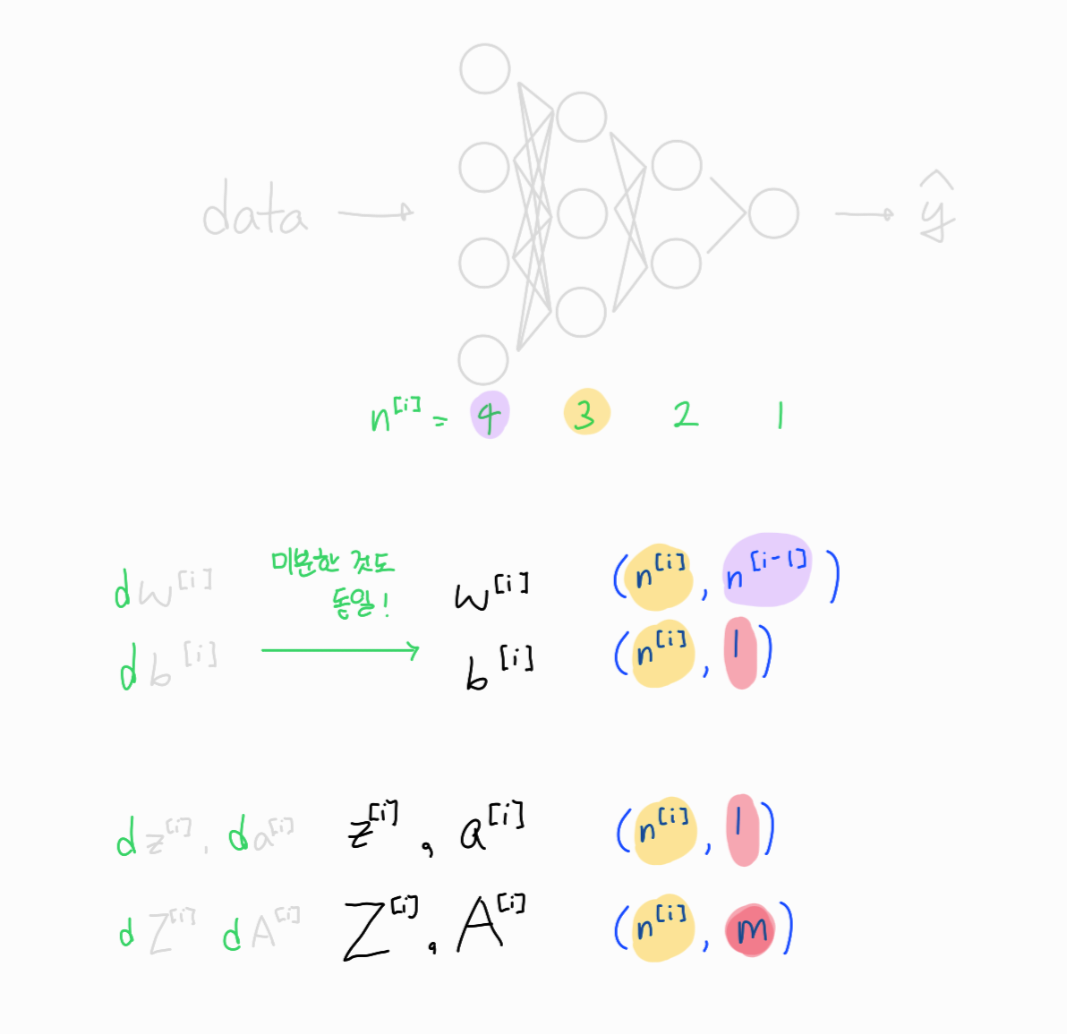

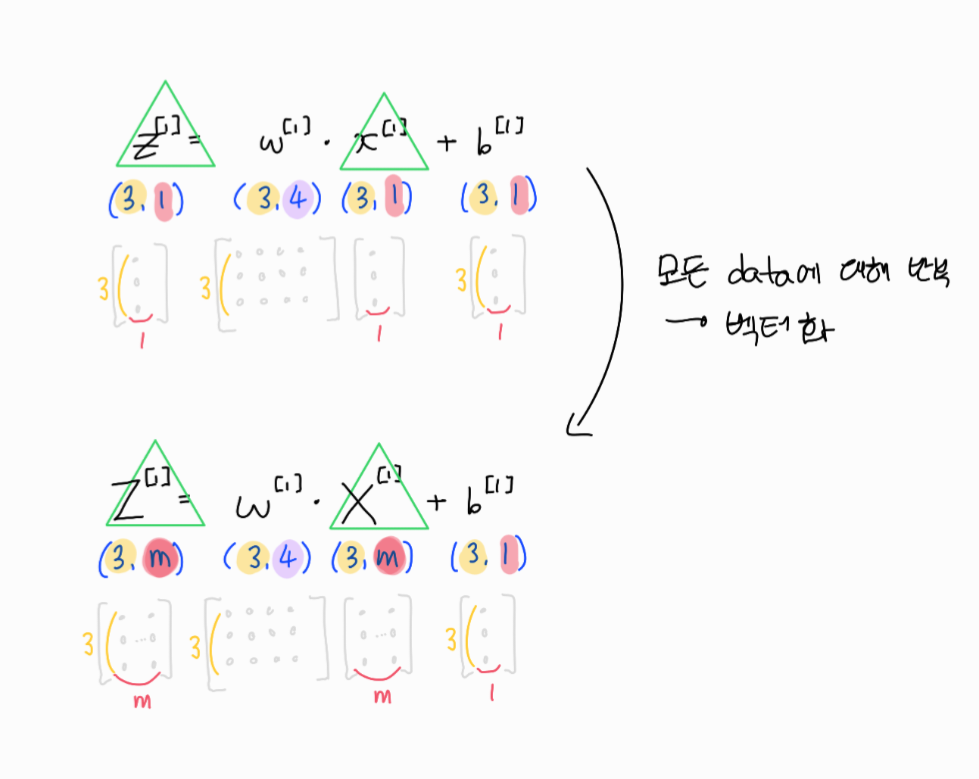

디버깅 : 행렬 shape을 확인하자

- 설명

- 벡터화

- , 는 모든 데이터에 대해 공통이므로 그대로.

- , 만 바뀜.

- 는 그대로긴 한데 으로 브로드캐스팅된 후 더해짐.