Unsupervised Semantic Segmentation by Distilling Feature Correspondences, ICLR 2022

0

다음 세미나 논문 Related Works

(다음 세미나 논문 - Unsupervised Semantic Segmentation Through Depth-Guided Feature Correlation and Sampling (CVPR, 2024))

Previous Works

- 기존의 Unsupervised Semantic Segmentation의 경우 하나의 end-to-end 방식으로 픽셀 단위 feature를 만들기에 각 픽셀 간 정보를 학습하지 못한다는 단점이 있었음

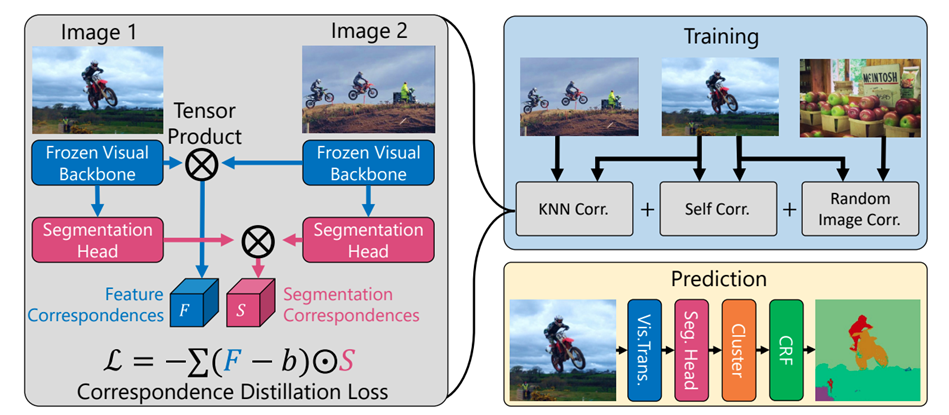

- 본 연구에서는 픽셀 간 유사도(feature correspondence)를 contrastive learning을 기반으로 증류 가능하게 만드는 Correspondence Distillation loss 제안하여 클러스터링을 효과적으로 이루어지게 함

Main contribution

- Unsupervised Semantic Segmentation을 수행하는 STEGO (Self-supervised Transformer with Energy-based Graph Optimization) 제안

Proposed Algorithm

-

Training Input으로는 여러 장의 이미지 쌍이 들어옴

-

KNN Correspondence를 통해 이미지 간 유사도를 판단함.

- 왼쪽 figure와 같이 2개의 이미지가 input으로 들어옴

- Frozen Visual Backbone(DINO)를 기반으로 Feature 추출함. 그 후 두 이미지 간 유사도 계산함

- Segmentation head로 Feature를 저차원 임베딩 벡터로 변환. 그리고 동일하게 유사도 계산함

- 유사도 계산 시, 코사인 유사도 기반 KNN 검색을 활용함. 그리고 이미지 당 5-crop 사용함

- 각각의 유사도 계산을 통해 추출된 F (feature 간 유사도 행렬), S(Segmentation 임베딩 유사도 행렬) 을 Correspondence Distillation loss를 통해 계산하여 유사한 feature는 가까이, 유사하지 않으면 멀어지게끔 학습 진행함.

-

Self Correspondence를 통해 한 이미지 내에서 pixel들 간의 correspondence 학습함

-

Random Image Correspondence를 통해 입력과 상관없는 이미지와 유사도가 멀어지게끔 학습함

-

세 가지 Correspondence를 Aggregation 하는 작업을 진행함

-

Prediction 단계에서는 Backbone인 VIT를 기반으로, Segmentation Head를 추출하고, KMeans Clustering을 진행 후, CRF를 통해 예측 결과를 보정하여 최종 결과를 도출해냄