참고: 퀀트 투자를 위한 머신러닝, 딥러닝 알고리즘 트레이닝.

과대적합을 방지하는 가장 대표적인 기법은 규제화(regularization)로, 계수가 큰 값에 도달할 수 없도록 오차에 패널티 항을 추가하는 것이다. 과대 적합이 되기가 너무 쉽기 때문에 대부분 규제화를 사용하게 된다.

나는 사실 잘 이해가 안 됐던 부분이, 크기를 규제하는게 왜 overfit을 방지하는 것인가에 대한 부분이다. 찾아봐도 잘 안 나왔는데, overfit된 모델에서는 계수가 inflate되는 경향이 있다고 한다. 따라서 regularization이 overfit을 방지해 줄 수 있게 된다고.

크게 두 가지 방법이 있다.

1. 분산을 줄이기 위해 약간의 편향을 주는 방법

2. 지나치게 많은 예측 변수를 방지하기 위해 세부사항 일부를 무시하는 것.

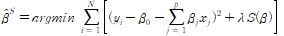

크기에 대해 패널티를 가하는 것이 수축 모델로, 다음 형태를 취한다.

여기서 lambda값을 이용해 패널키 효과의 크기를 결정한다. 위에서 S는 함수인데, 다양한 형태의 수축 모델이 있다. 가장 대표적인 것이 리지 회귀 분석과 라쏘 모델이다.

두 모델에서 모두 기억해야 되는 것은 두 모델을 모두 표준화 해야 된다는 것이다. 식만 봐도 알 수 있지만 입력의 크기에 민감하기 때문이다.

리지 회귀는(ridge) L2 규제화에 해당한다. 계수의 제곱들의 합이 S(B)이다. 이 방식은 닫힌 형식의 해가 존재해, 처음 도입때 많이 사용된 이유기도 했다. 이 패널티를 적용하면 모든 파라미터가 비례적으로 수축된다.

라쏘 회귀 방식은 모든 계수들의 절대값을 합한다. 이 경우는 폐쇄형 해가 존재하지 않는다. 대신 전체를 쉽게 계산해 주는 효율적인 알고리즘이 있다고 한다.