Introduction

Tensorflow를 사용하기 위한 기본적인 개념들을 설명한다.

텐서 (tensor)

- 최근의 모든 머신 러닝 시스템은 일반적으로 텐서를 기본 데이터 구조로 사용

텐서는 머신 러닝의 기본 구성 요소임

데이터(숫자)를 위한 컨테이너

임의의 차원 개수를 가지는 행렬의 일반화된 모습- 차원(dimension)을 종종 축(axis)이라고 부름

스칼라(0D 텐서)

- 하나의 숫자만 담고 있는 텐서

- 스칼라(scalar), 스칼라 텐서, 0차원 텐서, 0D 텐서 등으로 부름

- 넘파이의 uint8이나 float32 타입의 숫자가 스칼라 텐서에 해당

- ndim 속성을 사용하여 축 개수 확인 가능 ~ 텐서의 축 개수를 랭크(rank)라고도 부름

- 스칼라 텐서의 축 개수는 0임(ndim = = 0)

import numpy as np

x = np.array(23.7)

x

x.ndim

##결과

array(23.7)

0벡터(1D 텐서)

- 숫자의 배열

o 벡터 또는 1D 텐서라고 부름 - 참고) 3D 벡터 VS. 3D 텐서

o 3D 벡터는 하나의 축을 따라 3개의 데이터(숫자)를 가짐

o 5D 텐서는 5개의 축을 가진 텐서 (rank가 5인 텐서)

x = np.array([7, 11, 2])

x

x.ndim

##결과

array([7, 11, 2])

1핵심 속성

- 축의 개수(랭크): 예를 들어 3D 텐서에는 3개의 축이 있고, 행렬에는 2개의 축이 있음

- 넘파이 라이브러리에서는 ndim 속성에 저장되어 있음

- 크기(shape): 텐서의 각 축을 따라 얼마나 많은 차원이 있는지를 나타낸 파이썬의 튜플

(tuple) - 앞에 나온 행렬의 크기는 (4, 3)이고 3D 텐서의 크기는 (3, 3, 5)임

- 벡터의 크기는 (3,)처럼 1개의 원소로 이루어진 튜플임

- 배열 스칼라는 ()처럼 크기가 없음

- 데이터 타입(넘파이에서는 dtype에 저장됨): 텐서에 포함된 데이터의 타입

- 텐서의 타입은 float32, uint8, float64 등이 될 수 있음 (드물게 char 타입 사용)

o 텐서는 사전에 할당되어 연속된 메모리에 저장되어야 하므로 넘파이 배열은 가변 길이의 문자열을 지원하지 않음

from keras.datasets import mnist

(train_images, train_labels), (test_images, test_labes) =

mnist.load_data()

print(train_images.ndim)

print(train_images.shape)

print(train_images.dtype)

## 결과

3

(60000, 28, 28)

uint배치(batch) 데이터

- 일반적으로 데이터 텐서의 첫 번째 축(인덱스 0)은 샘플 축(sample axis)

o 샘플 차원(sample dimension)이라고도 부름 - 딥러닝 모델은 한 번에 전체 데이터셋을 처리하지 않고 작은 규모의 배치(batch)로 나눔

# 크기가 128인 배치

batch = train_images[:128]

# 다음 배치

batch = train_images[128:256]

# n번째 배치

batch = train_images[128*n: 128*(n+1)]텐서의 실제 사례

- 벡터 데이터

o (samples, features) 크기의 2D 텐서 - 시계열 데이터 또는 시퀀스(sequence) 데이터

o (samples, timesteps, features) 크기의 3D 텐서 - 이미지

o (samples, height, width, channels) 또는 (samples, channels, height, width) 크기의 4D 텐서 - 동영상

o (samples, frames, height, width, channels) 또는

(samples, frames, channels, height, width) 크기의 5D 텐서

벡터 데이터

- 데이터셋에서는 하나의 데이터 포인트가 벡터로 인코딩

- 첫 번째 축은 샘플 축이고, 두 번째 축은 특징 축(feature axis)

- 예) 사람의 나이, 우편 번호, 소득으로 구성된 인구 통계 데이터

o 각 사람은 3개의 값을 가진 벡터로 구성됨

o 10만 명이 포함된 전체 데이터세트는 (100000, 3) 크기의 텐서에 저장될 수 있음

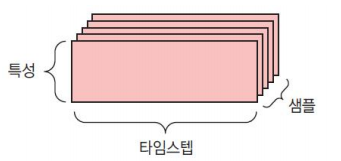

시계열 데이터 또는 시퀀스 데이터 (1)

- 시계열 데이터는 시간 축(타임스텝)을 포함하여 3D 텐서로 저장됨

- 시퀀스 데이터는 순서 축(스텝)을 포함하여 3D 텐서로 저장됨

- 각 샘플은 벡터(2D 텐서)의 시퀀스로 인코딩

시계열 데이터 또는 시퀀스 데이터 (2)

- 일반적으로 타임스텝 축은 두 번째 축(인덱스가 1인 축)을 사용

- 예) 주식 가격 데이터세트: 1분마다 현재 주식 가격과 지난 1분 동안의 최고 가격과 최소

가격 저장

o 1분마다 데이터는 3D 벡터로 인코딩됨

o 하루 동안의 거래는 (390, 3) 크기의 2D 텐서로 인코딩 가능 (하루의 거래 시간: 390분)

o 250일치의 데이터는 (250, 390, 3) 크기의 3D 텐서로 저장

• 1일치 데이터가 하나의 샘플

이미지 데이터

- 이미지는 전형적으로 높이, 너비, 채널 수의 3차원으로 이루어짐

o (MNIST 데이터세트) grayscale 이미지는 단일 채널만을 가지고 있어 2D 텐서로 저장할 수 있지만 관

례상 이미지 텐서는 3D로 저장 - 예1) 256×256 크기의 grayscale 이미지에 대한

128개의 배치: (128, 256, 256, 1) 크기 텐서 - 예2) 예1의 이미지가 컬러 이미지이고

128개의 배치: (128, 256, 256, 3) 크기 텐서

비디오 데이터

- 하나의 비디오는 프레임의 연속이고 각 프레임은 하나의 컬러 이미지임

- 프레임은 (height, width, color_depth)의 3D 텐서로 저장 Þ 프레임의 연속은

(frames, height, width, color_depth)의 4D 텐서로 저장 - 여러 비디오의 배치는 (samples, frames, height, width, color_depth)의 5D 텐서로

저장할 수 있음 - 예1) 60초 144×256 비디오 클립을 초당 4프레임으로 샘플링 ~ (240, 144, 256, 3)

- 예2) 예1의 비디오 클립을 4개 가진 배치 ~ (4, 240, 144, 256, 3) 크기의 텐서에 저장

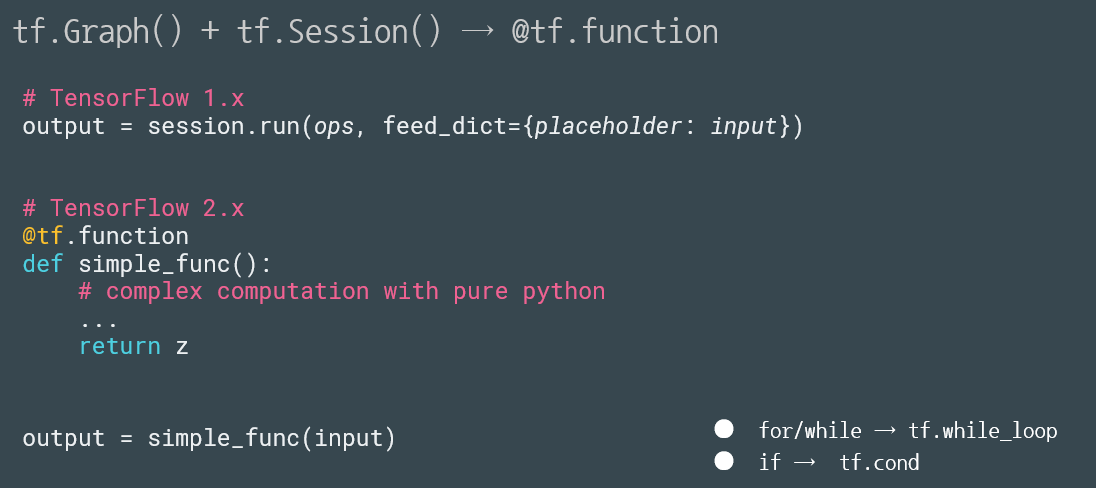

TensorFlow 2.x

- 2019.10 TensorFlow 2.0 Release

o 최신 버전: 2.4.0 (2020년 10월 기준) - Eager execution (Define by Run) ~ 일반적인 프로그래밍 방식, PyTorch의 영향

- Functions, not session

- AutoGraph ~ 속도 개선 (@tf.function)

- Keras Python API

- API Cleanup (no more globals)

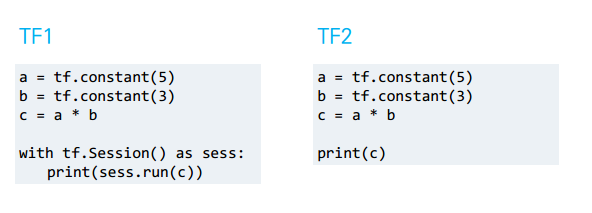

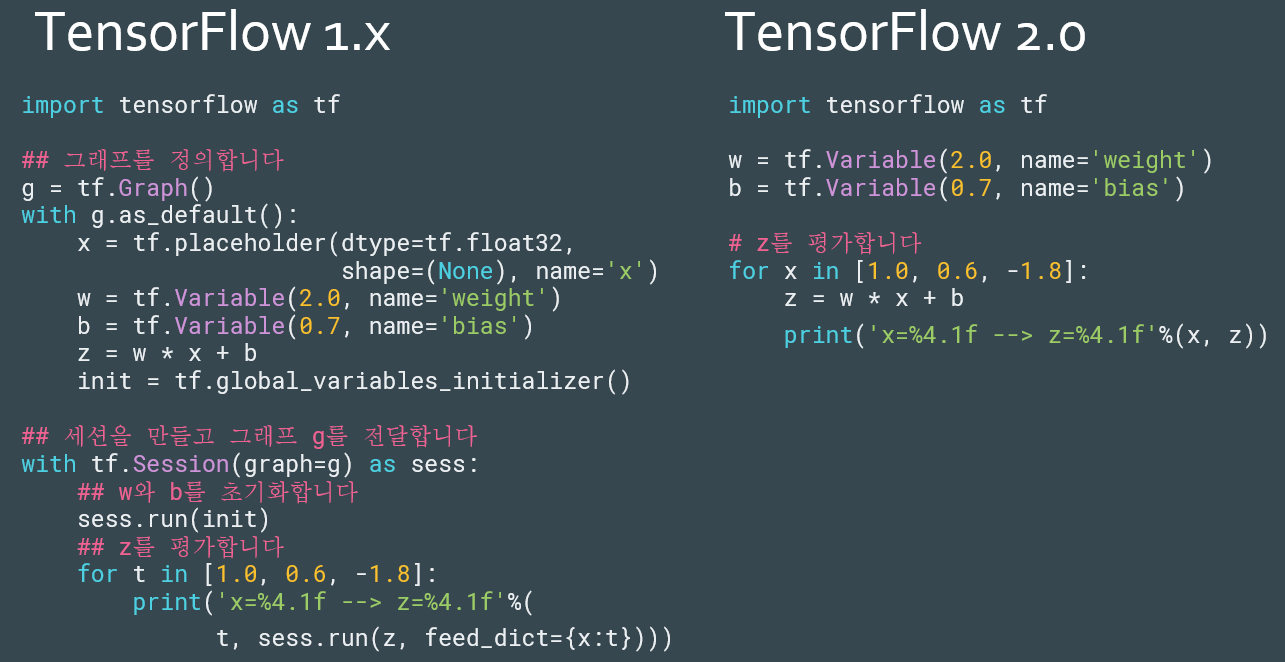

TF1 Vs TF2

- 코드의 차이

- AutoGraph