DeepLearning

1.Dropout, BatchNorm 적용 순서

부스트캠프 멘토링시간에 layer의 순서관련 이야기를 나누었다. 좋은 주제였던 것 같아 기록을 남기고자 정리해보았다. BatchNormalization: > * BatchNorm 논문에서는 conv - bn - act의 순서를 제시했지만, 현재는 bn과 activation의 순서에 크게 의의를 두지 않는 듯하다. dropout: > * dropout의 ...

2022년 3월 16일

2.Transposed Convolution shape 계산하는법

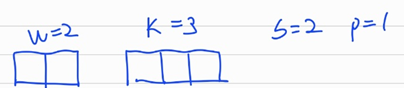

FCN에서 Transposed conv를 사용해 32배, 16배, 8배로 Upscaling해주는 연산이 어떻게 딱딱 n배로 떨어지는지 이해가 가지않아 직접 그림을 그리고 점화식(?)을 도출해 보았다.편의를 위해 1차원의 그림으로 표현하였다input의 크기 w를 2, k

2022년 4월 29일