Softmax Regression

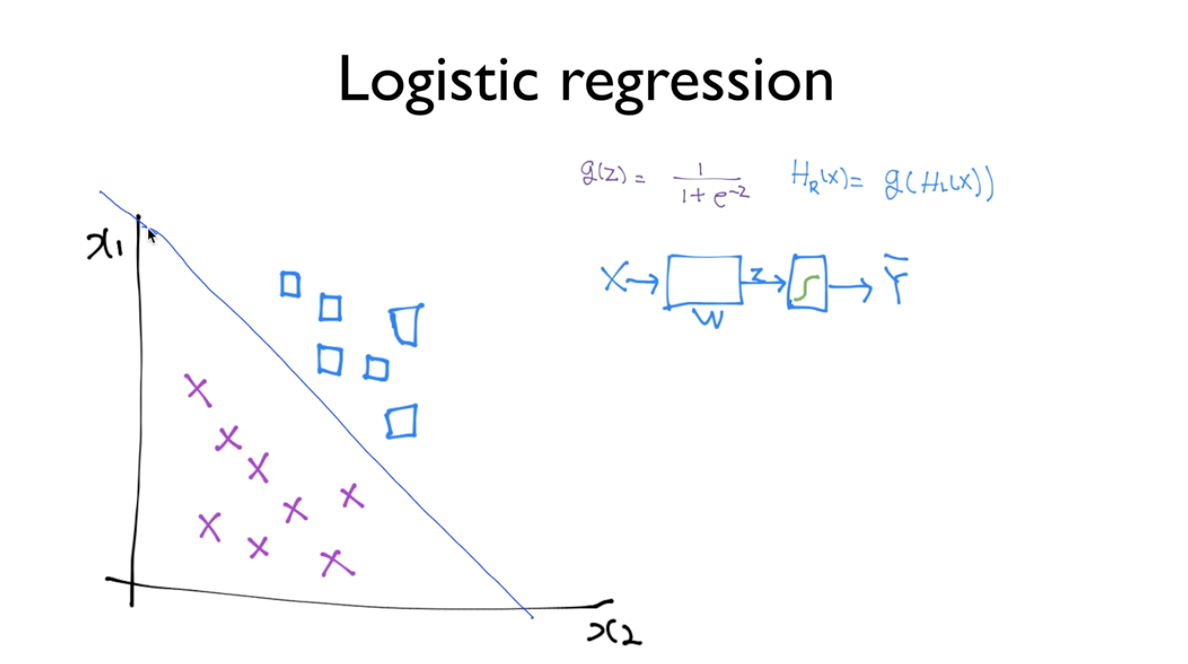

Logistic regression이란 결국은

x 와 사각형을 나누는 선을 찾는 것

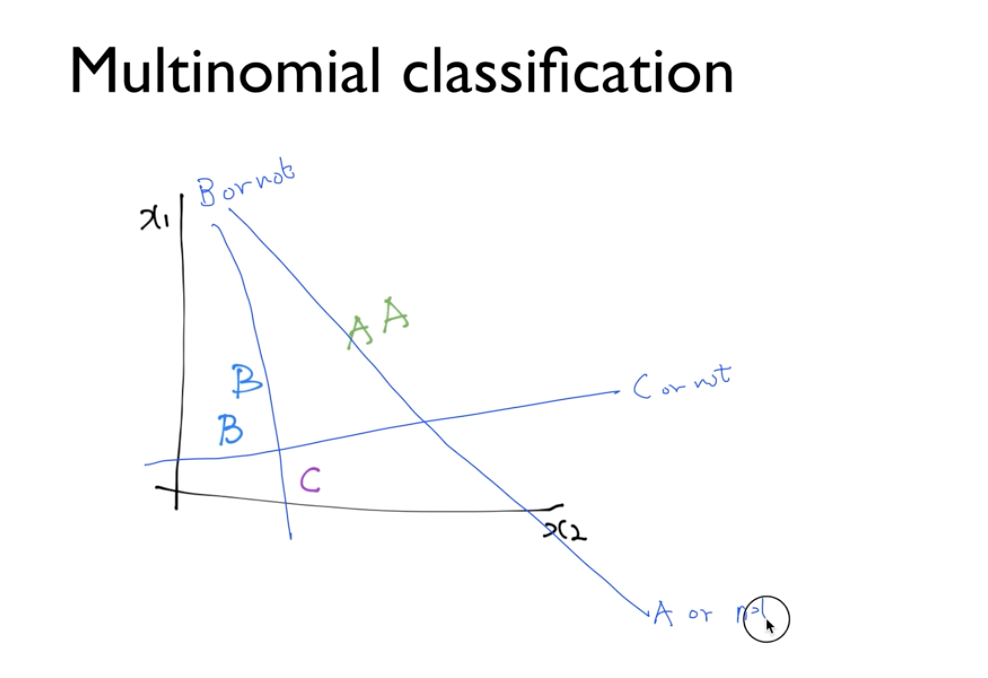

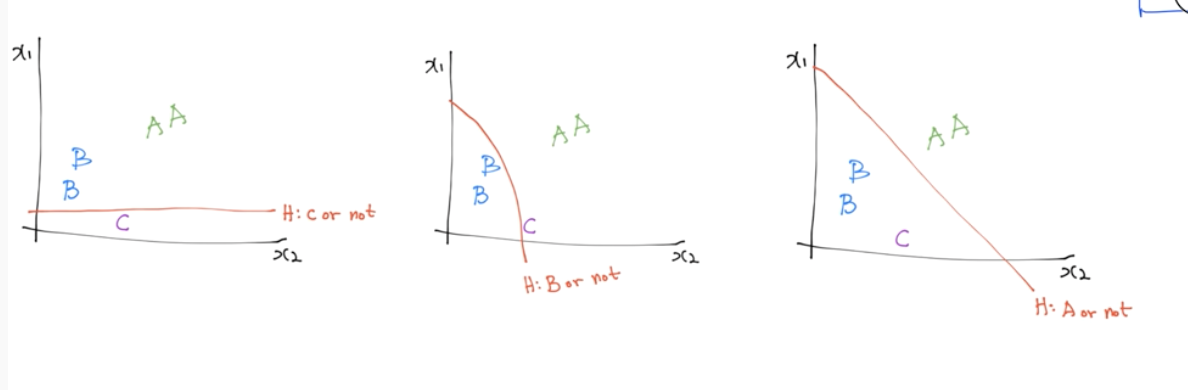

이 아이디어를 multinomial classification에 적용

binary만 가지고도 multinomial이 가능

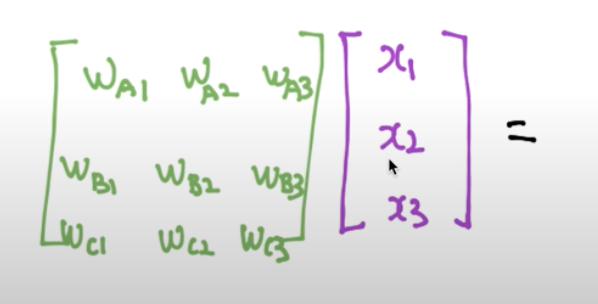

행렬로 만들면...3개의 독립된 행렬을 계산하면 된다.

하지만 그럼 계산이 복잡하니까 합쳐서 연산

세개의 독립된 classification 알고리즘이지만 한번에 계산할 수 있어서 편리

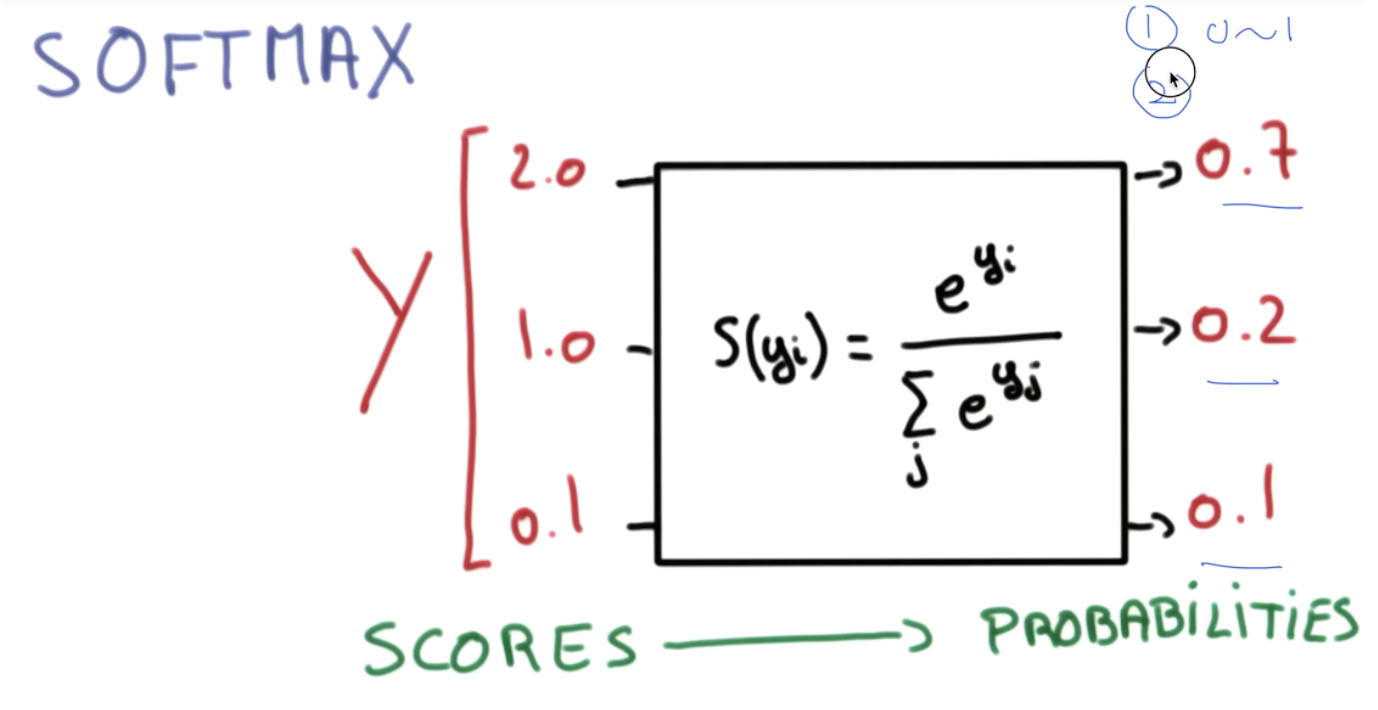

근데 저렇게 계산하면 sigmoid는 어디서 적용을 하지??

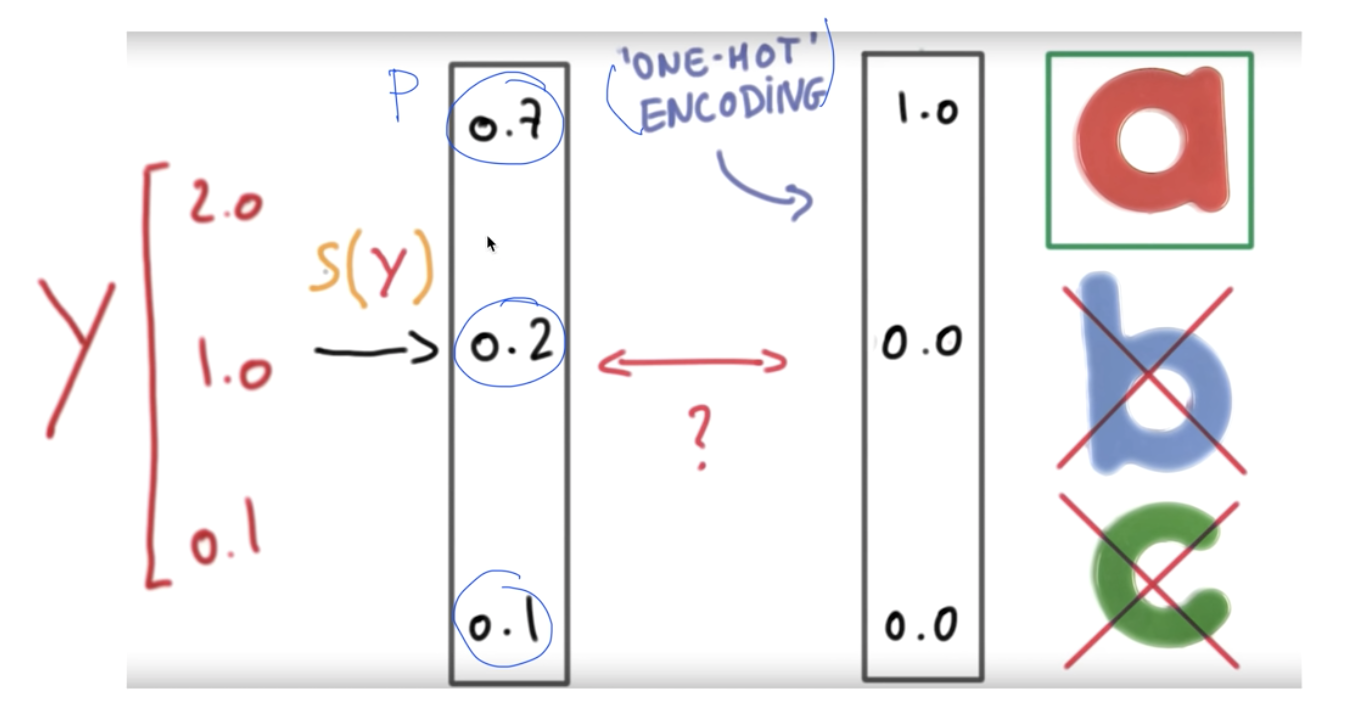

=> softmax를 적용하면 전체의 합이 1인 각각이 나올 확률로 변환할 수 있다.

가장 확률 높은 것만 나타내는 것: one-hot encoding

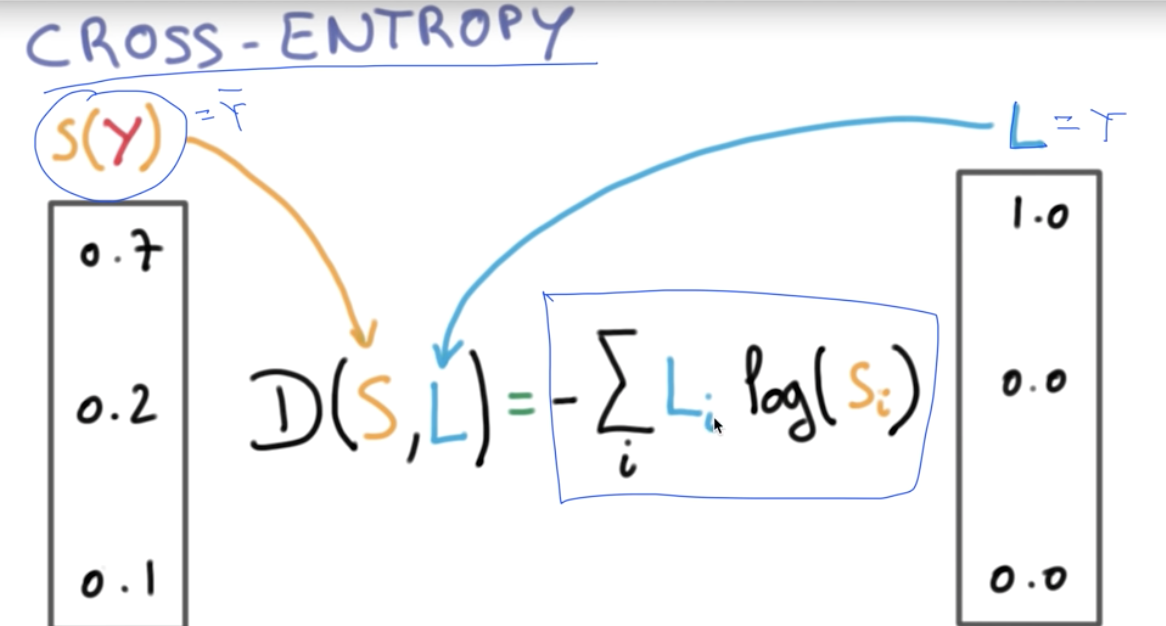

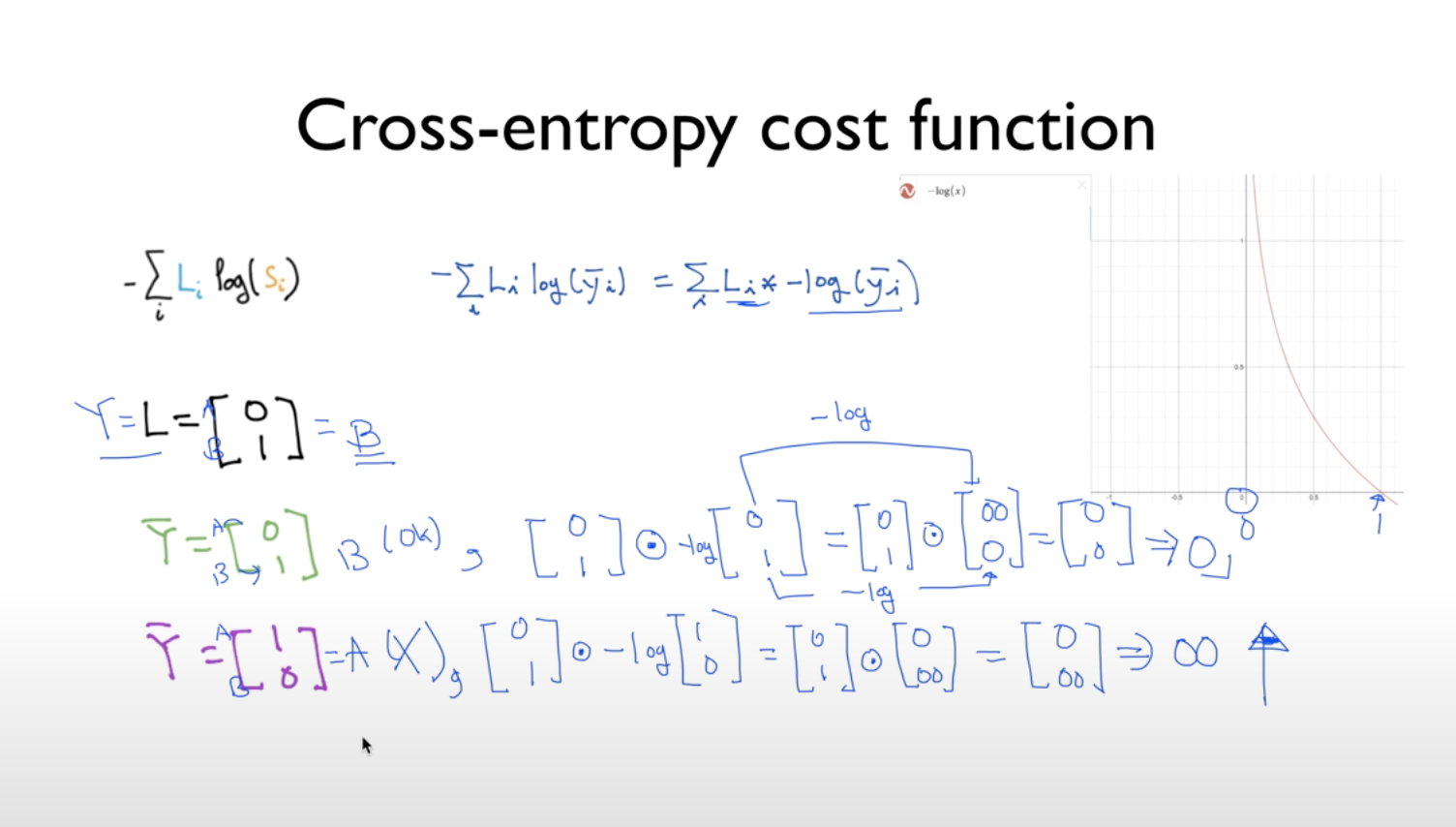

cost function

cross entropy

왜 적합할까??

예측이 맞았을 땐 굉장히 작은 값을 틀렸을 땐 굉장히 큰 값을 return한다. 고로 cost 함수로 사용할 수 있다.

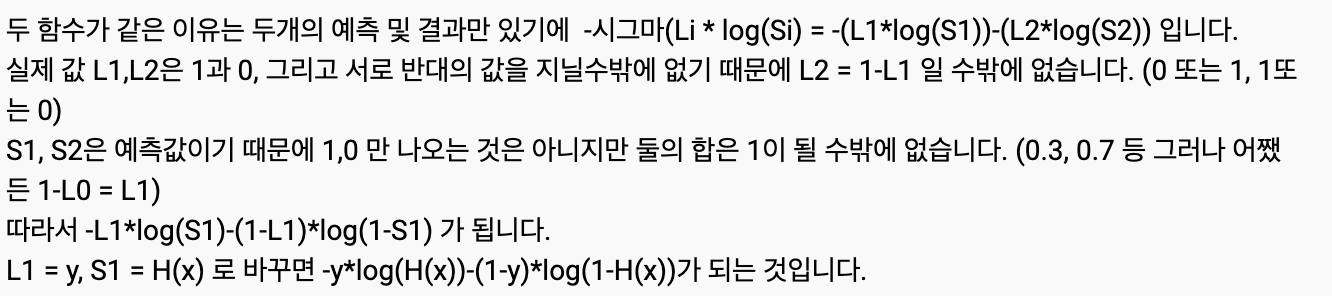

logistic cost와 cross entropy는 결국 동일하다.

동일한 이유

오늘 본 영상

https://www.youtube.com/watch?v=jMU9G5WEtBc&list=PLlMkM4tgfjnLSOjrEJN31gZATbcj_MpUm&index=14

https://www.youtube.com/watch?v=jMU9G5WEtBc&list=PLlMkM4tgfjnLSOjrEJN31gZATbcj_MpUm&index=15