1. 학습내용

LeNet

CNN을 처음으로 개발한 얀 르쿤 연구팀이 1998년에 개발한 CNN 알고리즘이다.

ReLU가 나오기 전에는 이게 가장 좋았다.

LeNet-5는 Input,

3개의 Convolution Layer(C1, C3, C5), 2개의 Subsampling Layer(S2, S4), 1개의 full-connected Layer (F6),

Output 으로 구성되어있다.

C1부터 F6까지 activation function으로 tanh을 사용한다.

AlexNet

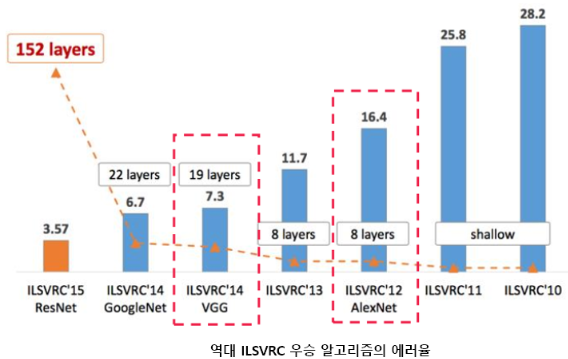

2012년에 Classification 대회에서 오차율 16.4%로 우승한 모델이다.

당시에는 굉장한 정확도였다. GPU를 쓰지 않고 병렬처리가 아닌 직렬처리를 했던 때 이다.

LeNet-5와 크게 다르지 않은데 2개의 GPU로 병렬연산을 수행하기 위해 병렬적인 구조로 설계되었다.

AlexNet은 8개의 레이어로 구성되어 있다.

5개의 Convolution Layer, 3개의 Full-Connected Layer로 구성되어 있다.

두번째, 네번째, 다섯번째 Convolution Layer들은 전 단계의 같은 채널의 특성맵들과만 연결되어 있는 반면,

세번째 컨볼루션 레이어는 전 단계의 두 채널의 특성맵들과 모두 연결되어 있다.

VGGNet

VGGNet은 옥스포드 대학의 연구팀 VGG에 의해 개발된 모델로써, 2014년 이미지넷 이미지 인식 대회에서 준우승을 한 모델이다.

여기서 말하는 VGGNet은 16개 또는 19개의 층으로 구성된 모델을 의미한다(VGG16, VGG19로 불림).

역사적으로 봤을 때 VGGNet 모델부터 시작해서 네트워크의 깊이가 확 깊어졌다.

2012년, 2013년 우승 모델들은 8개의 층으로 구성되었었다.

반면 2014년의 VGGNet(VGG19)는 19층으로 구성되었고, GoogLeNet은 22층으로 구성되었다.

그리고 2015년에는 152개의 층으로 구성된 ResNet이 제안되었다.

네트워크가 깊어질 수록 성능이 좋아진 것을 알 수 있다.

VGGNet은 사용하기 쉬운 구조와 좋은 성능 덕분에 그 대회에서 우승을 거둔 조금 더 복잡한 형태의 GoogLeNet보다 더 인기를 얻었다.

ResNet

ResNet은 마이크로소프트에서 개발한 알고리즘이다. 그것도 북경연구소의 중국인 연구진이 개발한 알고리즘이다.

층수에 있어서 ResNet은 급속도로 깊어진다. 2014년의 GoogLeNet이 22개 층으로 구성된 것에 비해, ResNet은 152개 층을 갖는다. 약 7배나 깊어졌다!

네트워크가 깊어지면서 top-5 error가 낮아진 것을 확인할 수 있다. 한마디로 성능이 좋아진 것이다.

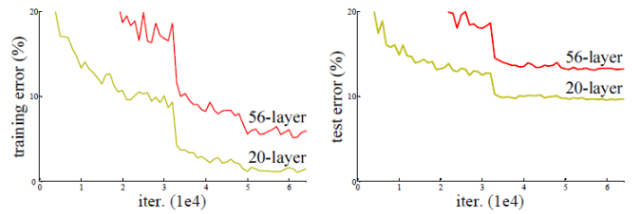

네트워크 깊이만 깊어지만 무조건 성능이 좋아질까에 대해 확인하기 위해

ResNet 논문의 저자들은 컨볼루션 층들과 fully-connected 층들로 20층의 네트워크와

56층의 네트워크를 각각 만든 다음에 성능을 테스트해보았다.

2. 학습소감

논문내용과 비교해서 확인해보면 더 좋을 것 같다.

내용의 양이 방대해서 좀 더 공부해야할 것 같다.