Deep-Learning

1.[conda] M1 가상 환경 생성, 목록 확인, 삭제

가상 환경을 설정해보자

2023년 3월 13일

2.[PyTorch] Dataset, DataLoader 직접 사용하기

학습을 시키다보면, 데이터를 어떻게 먹이는가 는 중요한 요소이다.데이터셋의 크기가 크다보니 모든 데이터를 메모리에 올리고 학습을 진행하면Out of Memory라는 무시무시한 문구를 보게 되기 때문이다.이를 위해서 데이터셋을 쪼개서 학습을 진행하는 배치 학습을 진행하고

2023년 3월 21일

3.[PyTorch] Custom Loss Function 사용하기

모델 학습 과정에서, 기존의 손실 함수가 아닌 다른 손실 함수를 사용하고 싶을 경우가 있다.이럴 때는 아래 예시와 같은 방법을 사용해보자.학습 시에 GPU를 사용하기 위해서는 모델뿐만 아니라 텐서도 GPU에 올려야한다는 것을 기억하자.

2023년 3월 21일

4.[PyTorch, KoGPT2] Fine-tuning하고 문장 생성하기(w/ full code)

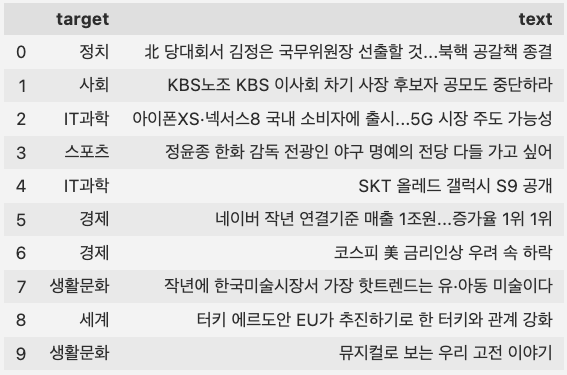

GPT2는 주어진 텍스트의 다음 단어를 잘 예측할 수 있도록 학습된 언어모델이며 문장 생성에 최적화 되어 있습니다. KoGPT2는 부족한 한국어 성능을 극복하기 위해 40GB 이상의 텍스트로 학습된 한국어 디코더 언어모델입니다.

2023년 6월 3일