2022.07.05 Tue

텐서플로를 이용한 신경망 구성

tf.keras.models.Sequential() : 모델 생성

Flatten(input_shape=(28,28) : 28x28 크기의 평면의 점으로 만들어진 사진을 784개의 일차원 직선 점 집합으로 변환

tf.keras.layers.Dense(노드 개수, activation='활성함수') : 층 생성

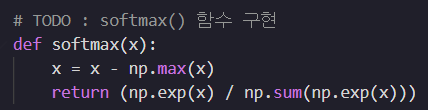

Softmax 함수

소프트맥스(Softmax)는 큰 값은 더 큰 비중을 주고, 작은 값은 더 작은 비중을 가지게 한다. 이런 특징은 지수 함수 f(x)=e^x 의 특징을 그대로 계승한다.

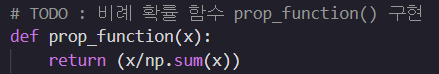

- 비례 확률 함수 prop_function() 구현하기

- softmax() 함수 구현하기

손실 함수

만들어진 신경망의 성능을 평가

<성능 표시 지표>

1. 정확도(accuracy) : 얼마나 정확하게 값을 예측하는가

2. 손실 정도(loss value) : 최종 결과에서 확률값이 얼마나 정답에 가까운지

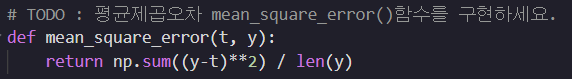

- 평균제곱오차 함수 구현하기

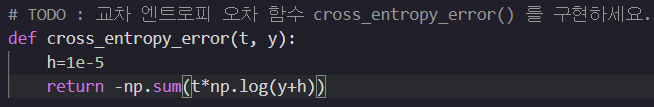

- 교차 엔트로피 오차 함수 구현하기

신경망을 이용한 선형 회귀, 이진 분류, 다중 분류

-

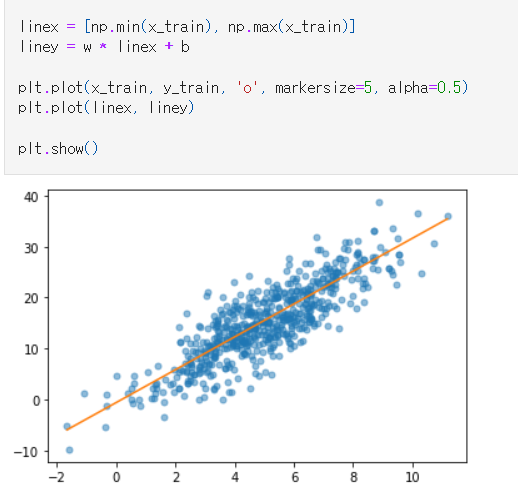

선형 회귀

회귀 분석은 프랜시스 골턴(Francis Galton)이 '평균으로의 회귀(regression to the mean)' 현상을 설명하기 위해 만든 것으로 부모와 아이의 키를 측정했을 때 일시적으로 자손 대에서 극단적인 값이 나오더라도 그다음 세대들을 거쳐 가면서 전체적으로는 평균에 가까워지는 현상을 말합니다.

평균으로 회귀하는 경향성을 본 골턴이 이를 설명하기 위해 사용한 것이 회귀 분석입니다.

-

이진 분류

대표적인 알고리즘 : 로지스틱 회귀

S자 곡선의 다른 수식으로 표현하여 사용됨

일반적으로 로지스틱 회귀는 시그모이드 함수를 활성 함수로 사용함

loss='binary_crossentropy' -> 0 또는 1로 나오게 하는 손실 함수 -

다중 분류

-다중 선형 회귀

-다중 클래스 분류 -

다중 선형 회귀를 이용한 차량 연비 예측

차량 연비 회귀 계산

정규화 : 모든 데이터 값의 범위를 0에서 1로 옮깁니다

표준화 : 평균만큼 이동한 후 표준편차로 나눠서 데이터의 중심이 표준정규분포 N(0,1)을 따르게 해줍니다

경사 하강법과 오차 역전파

- 경사 하강법

기계 학습은 학습 단계에서 최적의 매개 변수를 찾아낸다

신경망에서도 가중치(w)와 편향(b)을 담는 최적의 매개 변수를 찾아야 한다

최적의 매개 변수는 손실 함수가 최솟값이 되게 하는 값!

-> 함수의 기울기(미분값)로 알 수 있다

기울기가 크다 : 최솟값에서 멀리 떨어져 있다는 의미

기울기가 작다 : 최솟값에 근접했다는 의미

- 오차 역전파

기울기를 알때 수치미분을 사용해야하는데 시간이 오래 걸린다는 치명적인 단점!

--> 오차 역전파는 수치미분을 사용하지 않고 기울기를 구하는 알고리즘!

덧셈 노드, 곱셈 노드, 체인룰

최적화 기법

아직 완료되지 않은 연구 주제, 체계화되어 있지 않은 분야, 정답은 아무도 모른다

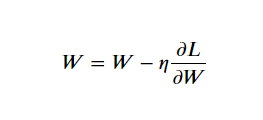

1. 경사 하강법과 하이퍼 파라미터 최적화

- 확률적 경사 하강법(SGD)-경사 하강법 수식

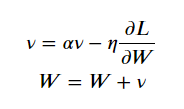

- 모멘텀(Momentum) : 운동량을 뜻하는 말로 기울기 방향으로 힘을 받아 물체가 가속되는 형상을 구현-모멘텀 수식