메모리

메모리

CPU는 '메모리'에 올라와 있는 프로그램의 명령어들을 실행할 뿐이다.

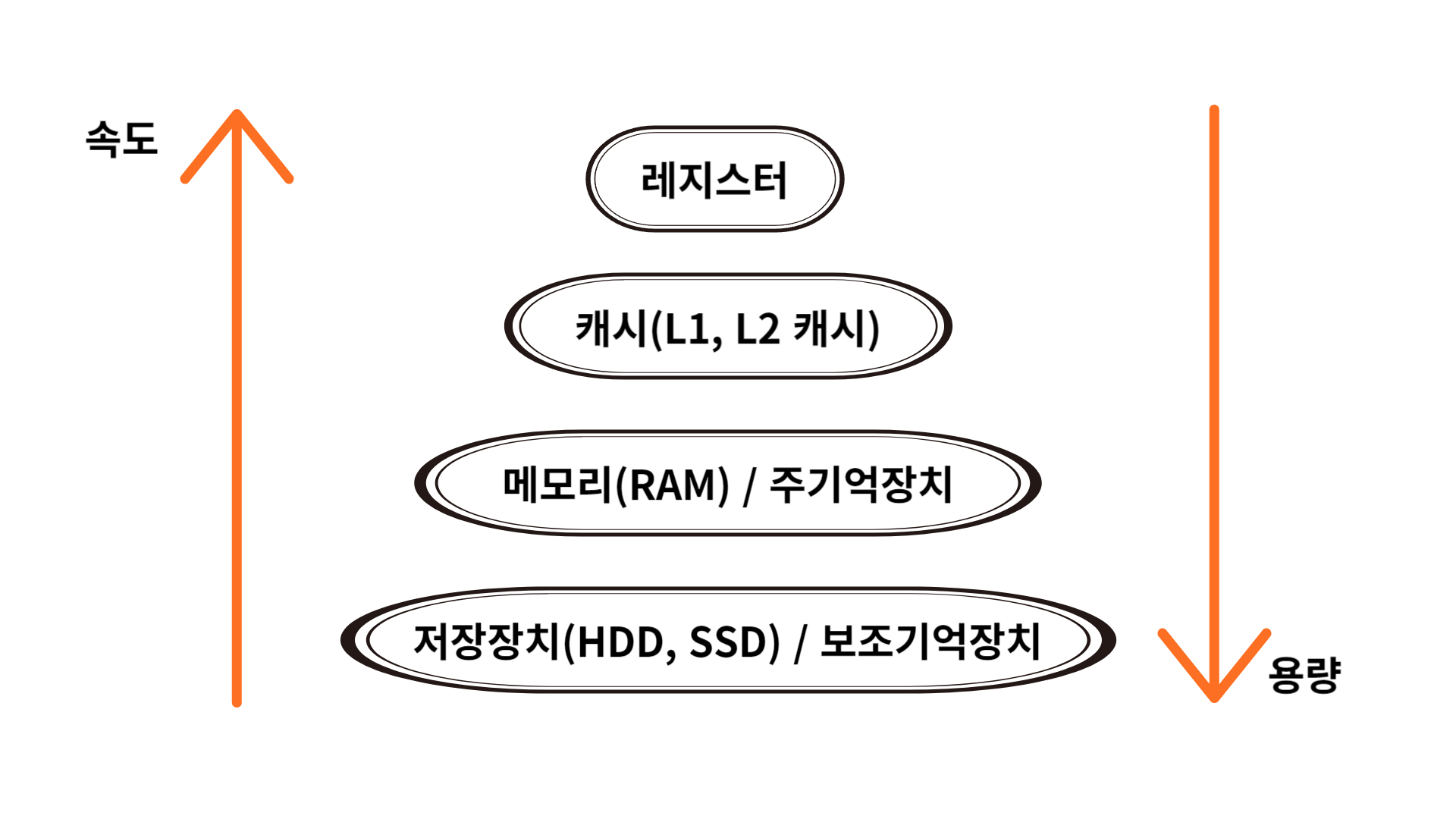

메모리 계층

메모리 계층 = 레지스터, 캐시, 메모리, 저장장치로 구성

-

레지스터 : CPU 안에 있는 작은 메모리, 휘발성, 속도가 가장 빠르고, 기억 용량이 가장 적다.

-

캐시 : L1, L2 캐시를 지칭한다. 휘발성, 속도가 빠름, 기억 용량이 적다. L3 캐시도 있다.

-

주기억장치 : RAM을 가리킨다. 휘발성, 속도는 보통, 기억 용량도 보통이다.

-

보조기억장치 : HDD, SSD를 말하며 비휘발성, 속도가 느리고, 기억 용량이 많다.

RAM은 하드디스크로부터 일정량의 데이터를 복사해서 임시로 저장하고 이를 필요 시마다 CPU에 빠르게 전달하는 역할을 한다. 계층 위로 올라갈수록 가격이 비싸지고, 용량은 작아지고, 속도는 빨라지는 특징이 있다. 이런 계층이 있는 이유는 경제성과 캐시때문이다. 16GB RAM보다 16GB SSD가 싸하다. 이러한 경제성 때문에 계층을 두어 관리한다.

일상생활에서 예로 들면, 게임을 하다가 '로딩 중'이라는 메시지가 나오면, 하드디스크 또는 인터넷에서 데이터를 읽어 RAM으로 전송하는 과정이 아직 끝나지 않았음을 의미한다.

캐시

'캐시(cache)'는 데이터를 미리 복사해 놓은 임시 저장소이자 빠른 장치와 느린 장치에서 속도 차이에 따른 병목 현상을 줄이기 위한 메모리를 말한다. 이를 통해 데이터를 접근하는 시간이 오래 걸리는 경우를 해결하고, 다시 계산하는 시간을 절약할 수 있다.

실제로 메모리와 CPU 사이의 속도 차이가 크기 때문에, 그 중간에 '레지스터 계층'을 둬서 속도 차이를 해결한다. 이렇듯 속도 차이를 해결하기 위해 계층과 계층 사이에 있는 계층을 캐싱 계층이라고 한다. 캐시 메모리와 보조기억장치 사이에 있는 주기억장치를 보조기억장치의 캐싱 계층이라고도 할 수 있다.

지역성의 원리

캐시 계층을 두는 것 말고 캐시를 직접 설정할 때는 어떻해야할까?

이럴 땐, 자주 사용하는 데이터를 기반으로 설정해야 한다. 자주 사용한다고 하는 데이터에 대한 근거는 '지역성'이다. 그리고 지역성은 '시간 지역성'과 '공간 지역성'으로 나뉜다.

let arar = Array.from({length:9}, ()=>0);

console.log(arr)

for(let i=0; i<10; i+=1){

arr[i] = i;

}

console.log(arr)시간 지역성

'시간 지역성'은 최근 사용한 데이터에 다시 접근하려는 특성을 말한다.

위의 예시 코드를 보면 for 반복문으로 이루어진 코드 안의 변수 i에 계속해서 접근이 이루어질 것이다. 데이터는 변수 i이고, 최근에 사용했기 때문에 계속 접근해서 +1이 되는 것을 알 수 있다.

공간 지역성

'공간 지역성'은 최근 접근한 데이터를 이루고 있는 공간이나 그 가까운 공간에 접근하는 특성을 말한다. 위 코드에서 공간을 나타내는 배열 arr의 각 요소들에 i가 할당되며 해당 배열에 연속적으로 접근을 알 수 있다.

캐시히트와 캐시미스

캐시에서 원하는 데이터를 찾은 것을 '캐시히트', 해당 데이터가 캐시에 없어 주메모리로 가서 데이터를 찾아오는 것을 '캐시미스'라고 한다.

캐시히트를 하게 되면, 해당 데이터를 제어장치를 거쳐 가져오게 된다. 캐시히트의 경우에는 위치도 가깝고 CPU 내부 버스를 기반으로 작동하기 때문에 빠르다.

하지만 캐시미스가 발생하게 되면, 메모리에서 가져오게 되는데, 이도 시스템 버스를 기반으로 작동하기 때문에 느리다.

캐시매핑

'캐시매핑'이란, 캐시가 히트되기 위해 매핑하는 방법을 말한다. CPU의 레시스터와 주 메모리(RAM) 간에 데이터를 주고받을 때를 기반으로 설명하면, 레지스터는 주 메모리에 비하면 굉장히 작고, 주 메모리는 크다. 따라서 작은 레지스터가 캐시 계층으로써 역할을 잘 해주려면 매핑을 어떻게 하느냐가 매우 중요하다.

- 캐시매핑 분류

1. 직접 매핑(directed mapping)

: 메모리가 1~100있고, 캐시가 1~10있다면, 1:1~10, 2:1~20,,, 이런식으로 매핑하는 것. 처리가 빠르지만 충돌 발생이 많다.

2. 연관 매핑(associative mapping)

: 순서를 일치시키지 않고 관련 있는 캐시와 메모리를 매핑. 충돌이 적지만 모든 블록을 탐색해야 해서 속도가 느리다.

3. 집합 연관 매핑(set associative mapping)

: 직접 매핑과 연관 매핑을 합쳐 놓은 것이다. 순서는 일치시키지만 집합을 둬서 저장하며, 블록화되어 있기 때문에 검색도 좀 더 효율적이다. 만약 메모리가 1~100이 있고, 캐시가 1~10이 있다면, 캐시 1~5에는 1~50의 데이터를 무작위로 저장시키고 하는 것을 말한다.

웹 브라우저의 캐시

소프트웨어적인 대표적인 캐시로, 웹 브라우저의 작은 저장소 쿠키, 로컬 스토리지, 세션 스토리지가 있다. 보통 사용자의 커스텀한 정보나 인증 모듈 관련 사항들을 웹 스라우저에 저장해서 추후 서버에 요청할 때 자신을 나타내는 아이덴티티나 중복 요청 방지를 위해 쓰인다.

쿠키

'쿠키'는 만료기한이 있는 키-값 저장소이다. same site 옵션을 strict로 설정하지 않을 경우 다른 도메인에서 요청했을 때 자동 전송되며, 4KB까지 데이터 저장이 가능하며, 만료기한을 정할 수 있다. 쿠키르 설정할 때는 document.cookie로 쿠키를 볼 수 없게 httponly 옵션을 거는 것이 중요하며, 클라이언트 또는 서버에서 만료기한 등을 정할 수 있는데 보통 서버에서 만료기한을 정한다.

로컬 스토리지

'로컬 스토리지'는 만료기한이 없는 키-값 저장소이다. 10MB까지 정할 수 있으며, 웹 브라우저를 닫아도 유지되고, 도메인 단위로 저장, 생성된다. HTML5를 지원하지 않는 웹 브라우저에서는 사용할 수 없으며, 클라이언트에서만 수정 가능하다.

세션 스토리지

'세션 스토리지'는 만료기한이 없는 키-값 저장소이다. 탭 단위로 세션 스토리지를 생성하며, 탭을 닫을 때 해당 데이터가 삭제된다. 5MB까지 저장이 가능하며, HTML5를 지원하지 않는 웹 브라우저에서는 사용할 수 없다. 클라이언트에서만 수정이 가능하다.

데이터베이스의 캐싱 계층

데이터베이스 시스템을 구축할 때도 메인 데이터베이스 위에 레디스(redis)데이터 베이스 계층을 '캐싱 계층'으로 둬서 성능을 향상시키기도 한다.

-

캐시히트일 경우 : redis롯부터 데이터를 읽어온다

-

캐시미스일 경우 : 메인 데이터베이스로부터 데이터를 가져온다.

메모리 관리

메모리 관리

운영체제의 대표적인 할 일 중 하나는 '메모리 관리'이다. 즉, 컴퓨터 내의 한정된 메모리를 극한으로 활용하는 것이다.

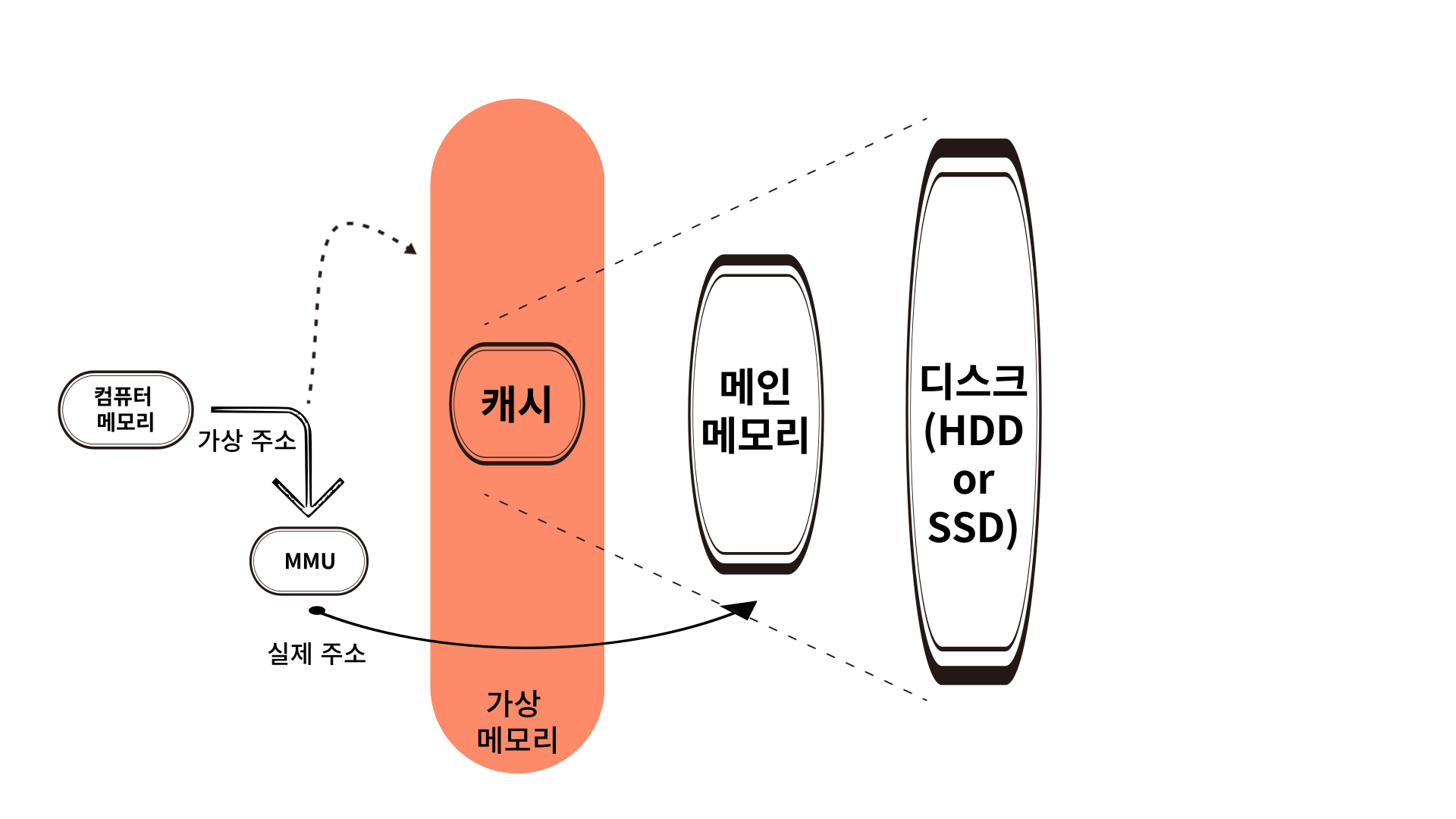

가상 메모리

가상 메모리(virtual memory)는 메모리 관리 기법의 하나로 컴퓨터가 실제로 이용 가능한 메모리 자원을 추상화하여 이를 사용하는 사용자들에게 매우 큰 메모리로 보이게 만드는 것을 말한다.

위에서 볼 수 있듯, 가상으로 주어진 주소를 가상주소(logical address)라고 하며, 실제 메모리상에 있는 주소를 실제주소(physical address)라고 한다. 가상주소는 메모리관리장치(MMU)에 의해 실제 주소로 변환되며, 이 덕에 사용자는 실제 주소를 의식할 필요 없이 프로그램을 구축할 수 있게 된다.

가상 메모리는 가상 주소와 실제 주소가 매핑되어 있고, 프로세스의 주소 정보가 들어 있는 '페이지 테이블'로 관리된다. 이때 속도 향상을 위해 TLB를 쓰게 된다.

※ TLB

: 메모리와 CPU 사이에 있는 주소 변환을 위한 캐시이다. 페이지 테이블에 있는 리스트를 보관하며, CPU가 페이지 테이블까지 가지 않도록 해 속도를 향상시킬 수 있는 캐시 계층이다.

스와핑

만약, 가상 메모리에는 존재하지만, 실제 메모리인 RAM에는 현재 없는 데이터나 코드에 접근할 경우 페이지 폴트가 발생한다. 이때, 메모리에서 당장 사용하지 않는 영역을 하드디스크로 옮기고, 하드디스크의 일부분을 마치 메모리처럼 불러와 쓰는 것을 '스와핑(swapping)'이라고 한다. 이를 통해 마치 페이지 폴트가 일어나지 않은 것처럼 만든다.

페이지 폴트

페이지 폴트(page fault)란, 프로세스의 주소 공간에는 존재하지만, 지금 이 컴퓨터의 RAM에는 없는 데이터에 접근했을 경우 발생한다. 페이지 폴트와 그로 인한 스와핑은 아래와 같은 과정으로 이루어진다.

-

CPU는 물리 메모리를 확인하여 해당 페이지가 없으면 트랩을 발생시켜 운영체제에 알린다.

-

운영체제는 CPU의 동작을 잠시 멈춘다.

-

운영체제는 페이지 테이블을 확인하여 가상 메모리에 페이지가 존재하는지 확인하고, 없으면 프로세스를 중단하고 물리 메모리에 비어있는 프레임이 있는지 찾는다. 물리 메모리에도 없다면 스와핑이 발동한다.

-

비어 있는 프레임에 해당 페이지를 로드하고, 페이지 테이블을 최신화한다.

-

중단되었던 CPU를 다시 시작한다.

※ 페이지(page)

: 가상 메모리를 사용하는 최소 크기 단위

※ 프레임(frame)

: 실제 메모리를 사용하는 최소 크기 단위

스레싱

'스레싱(thrashing)'은, 메모리의 페이지 폴트율이 높은 것을 의미하며, 이는 컴퓨터의 심각한 성능 저하를 초래한다.

스레싱은, 메모리에 너무 많은 프로세스가 동시에 올라가 스와핑이 많이 일어나서 발생한다. 페이지 폴트가 일어나면 CPU 이용률이 낮아지고, 운영체제는 오히려 "CPU가 노나?"라고 생각하여 가용성을 높이기 위해 더 많은 프로세스를 메모리에 올리게 된다. 이러한 악순환이 반복되며 스레싱이 일어나게 되는 것이다.

이를 해결하기 위해 메모리를 늘릴 수도 있고, HDD를 사용한다면 HDD를 SSD로 바꾸는 방법도 있다. 이외에 운영체제에서 이를 해결할 수 있는 방법은 '작업 세트'와 'PFF'가 있다.

작업 세트

'작업 세트(working set)'는 프로세스의 과거 사용 이력인 지역성(locality)을 통해 결정된 페이지 집합을 만들어서 미리 메모리에 로드하는 것이다.

PFF

'PFF(Page Fault Frequency)'는 페이지 폴트 빈도를 조절하는 방법으로 상한선과 하한선을 만드는 방법이다. 만약 상한선에 도달한다면 프레임을 늘리고, 하한선에 도달한다면 프레임을 줄이는 것이다.

메모리 할당

메모리에 프로그램을 할당할 때는 시작 메모리 위치, 메모리의 할당 크기를 기반으로 할당하는데, '연속 할당'과 '불연속 할당'으로 나뉜다.

연속 할당

'연속 할당'은 메모리에 연속적으로 공간을 할당하는 것을 말한다.

프로세스 A,B,C가 있다면 순차적으로 공간에 할당되는 것을 예시로 들 수 있다. 이는 메모리를 미리 나누어 관리하는 '고정 분할 방식'과, 매 시점 프로그램의 크기에 맞게 메모리를 분할하여 사용하는 '가변 분할 방식'이 있다.

- 고정 분할 방식

: '고정 분할 방식(fixed partition allocation)'은, 메모리를 미리 나누어 관리하는 방식이며, 메모리가 미리 나뉘어 있기 때문에 융통성이 없다. 또한, '내부 단편화'가 발생한다. - 가변 분할 방식

: '가변 분할 방식(variable partition allocation)'은 매 시점 프로그램의 크기에 맞게 동적으로 메모리를 나눠 사용한다. 내부 단편화는 발생하지 않고 '외부 단편화'는 발생할 수 있다. 여기에서 최초적합(first fit)', '최적적합(best fit)', '최악적합(worst fit)'이 있다.

※ 최초적합 : 위쪽이나 아래쪽부터 시작해 홀을 찾으면 바로 할당

※ 최적적합 : 프로세스의 크기 이상인 공간 중, 가장 작은 홀부터 할당

※ 최악적합 : 프로세스의 크기와 가장 많이 차이가 나는 홀에 할당

※ 내부 단편화

: 메모리를 나눈 크기보다 프로그램이 작아서 들어가지 못하는 공간이 많이 발생하는 현상

※ 외부 단편화

: 메모리를 나눈 크기보다 프로그램이 커서 들어가지 못하는 공간이 많이 발생하는 현상

※ 홀

: 할당할 수 있는 비어 있는 메모리 공간

불연속 할당

메모리를 연속적으로 할당하지 않는 불연속 할당은, 현대 운영체제가 쓰는 방법으로, 불연속 할당인 '페이징 기법'이 있다. 메모리를 동일한 크기의 페이지(보통 4KB)로 나누고, 프로그램마다 '페이지 테이블'을 두어 이를 통해 메모리에 프로그램을 할당하는 것이다. 페이징 기법말고도 있다.

- 페이징

: '페이징(paging)'은 동일한 크기의 페이지 단위로 나누어 메모리의 서로 다른 위치에 프로세스를 할당한다. 홀의 크기가 균일하지 않은 문제가 없어지지만 주소 변환이 복잡해진다. - 세그멘테이션

: '세그멘테이션(segmentation)'은, 페이지 단위가 아닌, 의미 단위인 세그먼트로 나누는 방식이다. 프로세스를 이루는 메모리는 코드 영역, 데이터 영역, 스택 영역, 힙 영역으로 이뤄지는데, 코드와 데이터로 나누거나 코드 내의 작은 함수를 세그먼트로 놓고 나눌 수도 있다. 이는 공유와 보안 측면에서 장점을 가지지만 홀 크기가 균일하지 않은 단점이 있다. - 페이지드 세그멘테이션

: '페이지드 세그멘테이션(paged segmentation)'은, 프로그램을 의미 단위인 세그먼트로 나눠, 공유나 보안 측면에 강점을 두고 임의의 길이가 아닌 동일한 크기의 페이지 단위로 나누는 것을 말한다.

페이지 교체 알고리즘

메모리는 한정되어 있어 스와핑이 많이 일어난다.스와핑은 많이 일어나지 않도록 설계되어야 한다. 이는 '페이지 교체 알고리즘을 기반'으로 스와핑이 일어난다.

오프라인 알고리즘

'오프라인 알고리즘'은 '먼 미래에 참조되는 페이지'와 '현재 할당하는 페이지'를 바꾸는 알고리즘이며, 가장 좋은 방법이다. 하지만 미래에 사용되는 프로세스를 우리가 알 방법은 없다.

즉, 사용할 수 없는 알고리즘이지만, 가장 좋은 알고리즘이기 때문에 다른 알고리즘과의 성능 비교에 대한 상한기준(upper_bound)을 제공한다.

-

FIFO(First In First Out)

: 가장 먼저 온 페이지를 교체 영역에 가장 먼저놓는 방법이다. -

LRU(Least Recentle Used)

: 참조가 가장 오래된 페이지를 바꾼다. '오래된' 것을 파악하기 위해 각 페이지마다 계수기, 스택을 두어야 하는 문제가 있다. LRU를 구현하기 위해서는 보통 '해시 테이블'과 '이중 연결 리스트', 두 개의 자료구조를 사용한다.

※ NUR

LRU에서 발전한 NUR(Not Used Recently)알고리즘이 있다.

'clock 알고리즘'이라고도 하고, 먼저 0과 1을 가진 비트를 둔다. 1은 최근에 참조되었고, 0은 참조되지 않음을 의미한다. 시계 방향으로 돌면서 0을 찾고, 0을 찾은 순간 해당 프로세스를 교체하고, 해당 부분을 1로 바꾸는 알고리즘이다.

※ LFU

LFU(Least Frequently Used)는 가장 참조 회수가 적은 페이지를 교체한다. 즉, 많이 사용되지 않은 것을 교체하는 것이다.