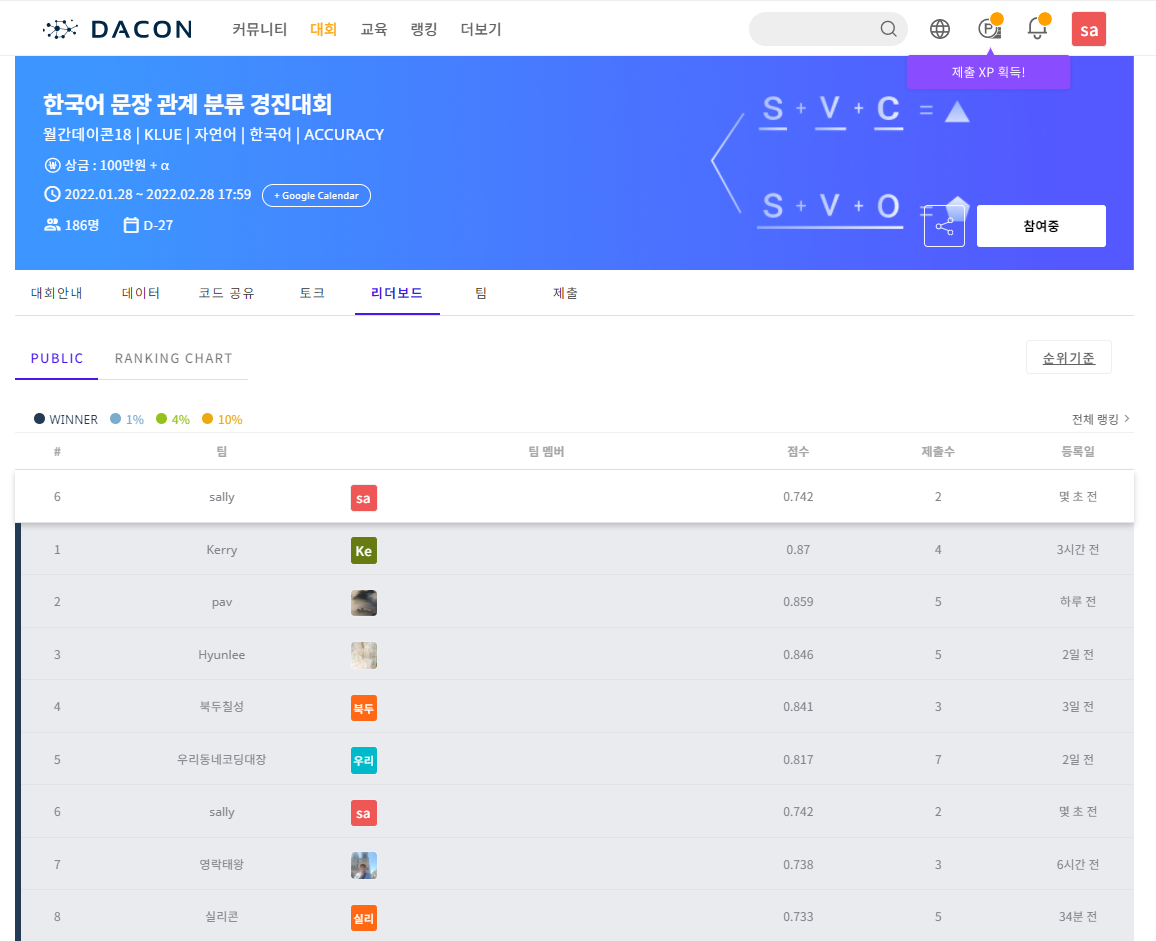

한국어 문장 관계 분류 경진대회

- Natural Language Inference Dataset 사용 (KLUE)

사용한 모델

klue/bert-base

tokenizer = BertTokenizer.from_pretrained("klue/bert-base")model.config출력 결과

model.config

BertConfig {

"_name_or_path": "klue/bert-base",

"architectures": [

"BertForMaskedLM"

],

"attention_probs_dropout_prob": 0.1,

"classifier_dropout": null,

"hidden_act": "gelu",

"hidden_dropout_prob": 0.1,

"hidden_size": 768,

"id2label": {

"0": "LABEL_0",

"1": "LABEL_1",

"2": "LABEL_2"

},

"initializer_range": 0.02,

"intermediate_size": 3072,

"label2id": {

"LABEL_0": 0,

"LABEL_1": 1,

"LABEL_2": 2

},

"layer_norm_eps": 1e-12,

"max_position_embeddings": 512,

"model_type": "bert",

"num_attention_heads": 12,

"num_hidden_layers": 12,

"pad_token_id": 0,

"position_embedding_type": "absolute",

"transformers_version": "4.16.1",

"type_vocab_size": 2,

"use_cache": true,

"vocab_size": 32000

}데이콘 첫 번재 제출

-

학습 조건

max_len = 128, epoch = 5

-> max_len = 90, epoch = 4에서 멈춤 -

모델 학습 정도

val_accuracy: 0.8263

-> val_accuracy: 0.8239 -

결과

6등으로 출발..! 🏃🏻♀️