Introduction

글로벌 대규모 언어 모델(LLM) 개발 경쟁이 치열해지고 있습니다. Closed-Source 모델이 여전히 성능 우위를 점하고 있지만, Open-Weight 모델들이 수천억 파라미터를 넘어 조(trillion) 단위 스케일로 공격적으로 확장하며 그 격차를 빠르게 좁히고 있습니다.

그러나 한국의 상황은 독특한 도전을 안고 있습니다. 글로벌 선두 국가 대비 AI 전용 데이터센터와 AI 칩이 상대적으로 부족하여, 그간 수백억(tens of billions) 파라미터 수준의 비용 효율적 소규모 모델 개발에 집중해왔습니다. 하지만 AI 전환의 근본적 기반을 확보하려면 글로벌 최상위 수준의 성능을 갖춘 대규모 모델이 필수적입니다. 이러한 인프라 격차를 해소하기 위해 한국 정부가 GPU 등 핵심 자원을 제공하는 전략적 프로그램을 시작했고, LG AI Research가 이 지원을 활용하여 개발한 것이 바로 K-EXAONE입니다.

K-EXAONE은 이전 모델인 EXAONE 4.0의 하이브리드 아키텍처(추론/비추론 통합)를 계승하면서, 세 가지 핵심 혁신을 도입합니다.

- 첫째, Mixture-of-Experts(MoE) 패러다임을 채택하여 총 236B 파라미터 중 추론 시 23B만 활성화하는 효율적 스케일링을 달성합니다.

- 둘째, 기존 3개 언어(한국어, 영어, 스페인어)에서 독일어, 일본어, 베트남어를 추가하여 6개 언어로 다국어 커버리지를 확장합니다.

- 셋째, 256K 토큰의 Context Window를 지원하여 실세계 Long-Context 애플리케이션에 대응합니다.

GitHub: https://github.com/LG-AI-EXAONE/K-EXAONE

Hugging Face: https://huggingface.co/LGAI-EXAONE/K-EXAONE-236B-A23B

(참고) K-EXAONE 성능표, Technical Paper 발췌

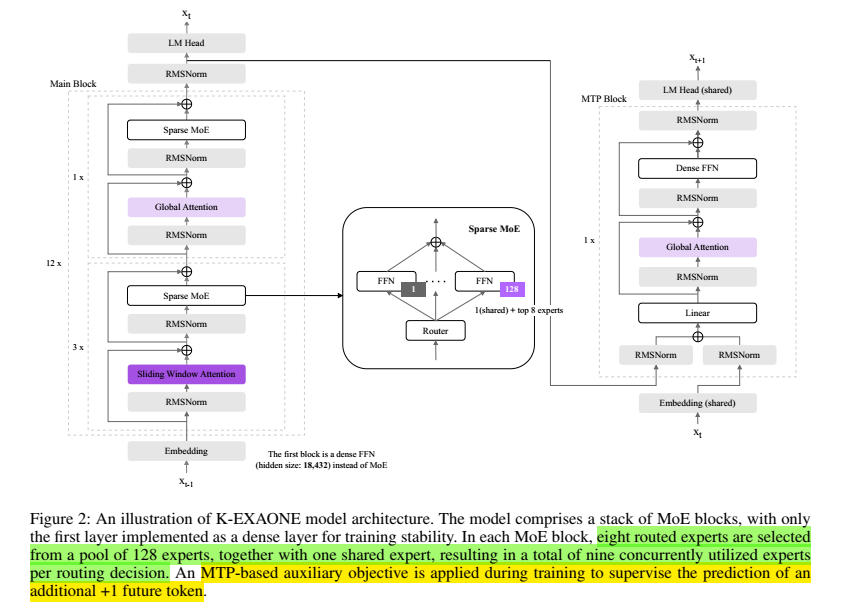

모델 아키텍처 설계

Fine-Grained Sparse MoE: 표현력과 효율의 양립

K-EXAONE은 기존 EXAONE 시리즈의 Dense 모델링 패러다임에서 벗어나, 100B+ 규모 모델 학습에서 점점 보편화되고 있는 MoE 아키텍처를 채택합니다. 핵심 설계 철학은 높은 표현 다양성과 자원 효율적 학습/추론의 양립입니다.

구체적으로, 128개의 Expert 풀에서 토큰당 Top-8 Expert를 라우팅하고, 여기에 1개의 Shared Expert를 추가하여 총 9개의 Expert가 동시에 활성화됩니다. 총 파라미터가 236B이지만 활성 파라미터는 약 23B에 불과하여, Dense 모델 대비 훨씬 효율적인 연산이 가능합니다.

MoE 구조에서 핵심적인 라우팅 안정성과 Expert 활용 효율을 위해 두 가지 기법을 적용합니다.

-

Sequence-Level Load Balancing은 "routing stability and expert utilization efficiency"를 위한 것으로, 특정 Expert에 토큰이 몰리는 현상(Expert Collapse)을 방지합니다.

- 일반적인 MoE에서는 토큰 단위로 Load Balancing을 하지만, K-EXAONE은 시퀀스 단위로 적용하여 더 안정적인 분배를 달성합니다

-

Dropless Routing(자세한 내용은 MegaBlocks 논문 참고)은 "all tokens are dispatched to experts without capacity-based dropping"이 핵심입니다.

- 기존 MoE에서는 각 Expert에 처리할 수 있는 토큰 수의 상한(capacity)을 두고, 초과분은 버리는(drop) 방식을 사용합니다.

- 이 경우 일부 토큰의 정보가 손실되고 Gradient Flow가 불안정해질 수 있는데, Dropless Routing은 이 제한을 없애 모든 토큰이 반드시 Expert에 배정되도록 보장합니다.

이 두 기법의 조합은 대규모 MoE 학습에서 Gradient Flow를 안정화하고 수렴 행동을 개선하는 데 핵심적입니다.

(참고) K-EXAONE 아케텍쳐, Technical Paper 발췌

Hybrid Attention과 블록 구조

(위 그림 참고) K-EXAONE의 Main Block은 총 48개 레이어로 구성되며, Sliding Window Attention(SWA) 36개 레이어와 Global Attention(GA) 12개 레이어가 혼합된 Hybrid Attention 구조를 따릅니다.

이는 전체 레이어에 GA를 적용하는 것 대비 메모리 소비와 연산 오버헤드를 크게 줄이면서도 Long-Context 모델링 능력을 유지하는 설계입니다.

블록 구조의 흐름을 텍스트로 표현하면 다음과 같습니다.

입력 토큰

→ Embedding

→ [SWA + Sparse MoE] × 3 레이어

→ [GA + Sparse MoE] × 1 + [SWA + Sparse MoE] × 3 반복 × 12

→ [GA + Sparse MoE] × 1

→ RMSNorm → LM Head → 출력

* 각 블록 내부: Attention → RMSNorm → Sparse MoE (128 experts, top-8 + 1 shared) → RMSNorm

* 첫 번째 레이어만 MoE 대신 Dense FFN (hidden size: 18,432) → 학습 안정성 확보여기서 주목할 설계 결정이 몇 가지 있습니다.

- 첫 번째 레이어를 Dense FFN으로 구현한 것은 MoE 학습 초기의 불안정성을 방지하기 위한 선택입니다.

[블록 1] SWA + Dense FFN ← ★ 여기만 Dense FFN (MoE 아님)

[블록 2] SWA + Sparse MoE

[블록 3] SWA + Sparse MoE

[블록 4] GA + Sparse MoE

─── 위가 첫 번째 반복 단위 ───

[블록 5] SWA + Sparse MoE

[블록 6] SWA + Sparse MoE

[블록 7] SWA + Sparse MoE

[블록 8] GA + Sparse MoE

─── 두 번째 반복 단위 ───

... (같은 패턴 반복) ...

[블록 45] SWA + Sparse MoE

[블록 46] SWA + Sparse MoE

[블록 47] SWA + Sparse MoE

[블록 48] GA + Sparse MoE

─── 열두 번째 반복 단위 ───-

SWA의 Window Size를 기존 4,096에서 128로 대폭 축소한 것은, Long-Context 추론 시 KV-Cache 사용량을 극단적으로 줄이면서도 모델링 용량을 보존하기 위한 것입니다.

-

Attention Head는 Query 64개, Key-Value 8개의 Grouped Query Attention(GQA) 구성이며, Head Dimension은 128입니다.

-

학습 안정성과 Long-Context 외삽을 강화하기 위해 EXAONE 4.0에서 두 가지 기법을 계승합니다.

- QK Norm은 Attention 연산 전에 Query/Key 벡터에 Layer Normalization을 적용하여, 깊은 네트워크에서 Attention Logit이 폭발하는 문제를 방지합니다.

- SWA-only RoPE는 Rotary Positional Embeddings를 SWA 레이어에만 선택적으로 적용하여, GA에서의 글로벌 토큰 상호작용에 대한 간섭을 방지하고 Long-Sequence 외삽 견고성을 높입니다.

Multi-Token Prediction(MTP) 모듈

K-EXAONE은 Dense Layer 기반의 MTP 모듈을 통합하여 현재 토큰뿐 아니라 미래 토큰까지 예측하는 보조 학습 목표를 적용합니다.

(참고)

Q. NEXT TOKEN PREDICTION 원래하는거 아닌가?

A. 맞습니다.

- NTP는 모든 Autoregressive LLM의 기본 학습 목표입니다.

- K-EXAONE도 당연히 NTP를 합니다. 다른 점은 NTP에 더해서 MTP를 추가로 한다는 것입니다.

NTP만 하는 경우 (표준 LLM)

일반적인 LLM은 각 위치에서 바로 다음 토큰 하나만 예측합니다.

입력: "나는 오늘 학교에"

↓ ↓ ↓ ↓

예측: "오늘" "학교에" "갔다" "."

각 위치에서 Loss 계산:

Position 1: "나는" → "오늘" 예측 (Loss_1)

Position 2: "오늘" → "학교에" 예측 (Loss_2)

Position 3: "학교에" → "갔다" 예측 (Loss_3)

Position 4: "갔다" → "." 예측 (Loss_4)

총 Loss = Loss_1 + Loss_2 + Loss_3 + Loss_4NTP + MTP를 하는 경우 (eg. K-EXAONE)

K-EXAONE은 NTP에 더해서, 각 위치에서 +1 미래 토큰도 동시에 예측합니다.

입력: "나는 오늘 학교에"

↓ ↓ ↓ ↓

NTP: "오늘" "학교에" "갔다" "." ← Main Block (기존과 동일)

MTP: "학교에" "갔다" "." "끝" ← MTP Block (한 칸 더 미래)

총 Loss = NTP Loss + 0.05 × MTP Loss각 위치에서 두 개의 예측이 나옵니다.

- Position 1에서 Main Block은 "오늘"을, MTP Block은 "학교에"를 예측합니다.

- Position 2에서 Main Block은 "학교에"를, MTP Block은 "갔다"를 예측합니다.

직관적으로 생각해보기

직관적으로 비유하면 이렇습니다.

- NTP만 하는 것은 바둑에서 한 수 앞만 보고 두는 것이고, MTP를 추가하는 것은 두 수 앞까지 보고 두는 것입니다.

- 두 수 앞을 보려면 현재 상태에 대한 이해가 더 깊어야 하므로, 결과적으로 한 수 앞 예측의 품질도 함께 좋아집니다.

- 이것이 MTP가 "보조 학습 목표(Auxiliary Objective)"로서 모델 전체의 표현력을 향상시키는 원리입니다.

이 모듈(MTP BLOCK)의 역할은 이중적입니다.

-

학습 시에는 Future-Token 예측 능력을 향상시키는 Auxiliary Loss로 기능하고, 추론 시에는 Self-Drafting에 활용되어 표준 Autoregressive Decoding 대비 약 1.5배의 디코딩 처리량 향상을 달성합니다.

-

MTP Block 자체의 파라미터 수는 0.52B으로 매우 경량이며, Dense Layer 기반 설계를 통해 라우팅 오버헤드와 메모리 소비를 최소화합니다. MTP Block은 Main Block의 LM Head와 Embedding을 공유(shared)하여 추가적인 파라미터 부담을 줄입니다.

아키텍처 구성 요약

| 구성 요소 | 세부 설정 | 값 |

|---|---|---|

| Main Block | Layers (Total / SWA / GA) | 48 / 36 / 12 |

| Sliding Window Size | 128 | |

| Attention Heads (Q / KV) | 64 / 8 | |

| Head Dimension | 128 | |

| Experts (Total / Shared / Activated) | 128 / 1 / 8 | |

| Parameters (Total / Activated) | 236B / 23B | |

| MTP Block | Attention Heads (Q / KV) | 64 / 8 |

| Head Dimension | 128 | |

| Parameters | 0.52B |

Tokenizer 재설계

SuperBPE: 단어 시퀀스를 하나의 토큰으로

기존 BPE(Byte Pair Encoding)는 자주 등장하는 문자 쌍을 반복적으로 합쳐서 서브워드 토큰을 만듭니다.

- SuperBPE는 여기서 한 단계 더 나아가, 자주 함께 등장하는 단어 시퀀스를 하나의 토큰(Superword)으로 만듭니다.

[일반 BPE]

"인공지능 모델" → ["인공", "지능", " 모", "델"] (4 토큰)

[SuperBPE - Superword 토큰이 있는 경우]

"인공지능 모델" → ["인공지능 모델"] (1 토큰)이것이 Bytes per Token 향상의 핵심 메커니즘입니다.

- 같은 텍스트를 더 적은 토큰으로 표현하므로, 토큰당 커버하는 바이트 수가 늘어납니다.

- 시퀀스 길이가 줄어들면 Attention 연산량도 줄고, 같은 Context Window 안에 더 많은 내용을 담을 수 있습니다.

Superword Token이 전체 어휘의 약 20%를 차지하며, 영어:한국어:다국어 = 2:3:1 비율로 할당됩니다.

- 한국어 비중이 가장 높은 이유는 한국어가 교착어로서 조사, 어미 변화가 많아 Superword의 효과가 크기 때문이며, 동시에 Sovereign AI로서 한국어 처리를 우선시하는 설계 의도가 반영된 것입니다.

어휘 확장 전략: 100K → 150K

단순히 어휘를 늘리는 것이 아니라 전략적으로 재배분합니다.

EXAONE 4.0 (100K 어휘):

[한국어/영어/스페인어 토큰들] ← 전부 사용

K-EXAONE (150K 어휘):

[기존 고빈도 70% 보존] ← 100K의 70% = 70K 토큰 유지

[추가 언어: 독일어/일본어/베트남어] ← 새로 할당

[STEM/코드 도메인 확장] ← 새로 할당

[Superword 토큰 (~30K)] ← 새로 할당기존 어휘의 고빈도 70%를 보존하는 이유는, 자주 쓰이는 토큰을 제거하면 기존 언어 처리 능력이 크게 훼손되기 때문입니다. 저빈도 30%를 제거하고 그 자리에 새로운 언어와 도메인 토큰을 채워 넣는 효율적인 전략입니다.

Unicode Normalization: NFKC → NFC

Unicode Normalization은 컴퓨터에서 같은 글자를 여러 방식으로 표현할 수 있는 문제를 해결하기 위한 표준입니다. 예를 들어 한글 "가"는 완성형 코드(U+AC00) 하나로 표현할 수도 있고, 초성 ㄱ(U+1100) + 중성 ㅏ(U+1161)의 조합으로 표현할 수도 있습니다. 사람 눈에는 동일하지만 컴퓨터에게는 다른 바이트 시퀀스이므로, Tokenizer가 같은 글자를 다른 토큰으로 처리할 수 있습니다. 이런 혼란을 방지하기 위해 "같은 글자는 같은 방식으로 통일하자"는 것이 Unicode Normalization의 목적입니다.

NFC와 NFKC는 둘 다 표현을 통일하지만, 통일하는 범위가 다릅니다. NFC(Canonical Decomposition + Composition)는 "진짜 같은 글자"만 통일합니다. "가"의 조합형과 완성형처럼 동일한 문자의 다른 표현만 정규화하고, "²"(위첨자 2)와 "2"(일반 숫자 2)처럼 유니코드에서 별개의 문자로 정의된 것은 구분을 존중합니다. 반면 NFKC(Compatibility Decomposition + Composition)는 "비슷하게 생긴 글자"까지 적극적으로 통일합니다.

NFKC (기존 - 적극적 통일):

"x²" → "x2" (위첨자 2를 일반 2로 변환)

"㎞" → "km" (킬로미터 기호를 알파벳으로 분해)

"fi" → "fi" (합자를 분리)

"Ⅳ" → "IV" (로마 숫자를 알파벳으로 분해)

NFC (K-EXAONE - 보수적 통일):

"x²" → "x²" (위첨자 2를 그대로 보존)

"㎞" → "㎞" (킬로미터 기호 보존)

"fi" → "fi" (합자 보존)

"Ⅳ" → "Ⅳ" (로마 숫자 보존)일반 텍스트에서는 NFKC의 적극적 통일이 편리합니다. "㎞"를 검색할 때 "km"으로도 찾을 수 있기 때문입니다.

하지만 STEM과 코드 도메인에서는 이 통일이 의미를 파괴합니다.

- 수학에서 (x의 제곱)과 (변수명 x2)는 완전히 다른 의미입니다.

- 화학에서 H₂O의 아래첨자가 사라지면 분자식의 의미가 훼손됩니다.

- 코드에서도

print("㎞")와print("km")은 다른 동작을 수행합니다.

NFC는 이런 의미적 차이를 보존하면서 동일 문자의 중복 표현만 정리하므로, STEM과 코드 도메인의 텍스트를 정확하게 처리할 수 있습니다. K-EXAONE이 STEM과 코드 Vocabulary를 확장한 것과 같은 맥락의 설계 결정입니다.

학습 파이프라인

K-EXAONE의 학습은 크게 네 단계로 이루어집니다.

- 대규모 코퍼스로 기본 언어 능력을 익히는 Pre-training,

- Context 처리 범위를 넓히는 Context Length Extension,

- 사용자 지시를 따르도록 미세 조정하는 Post-training(SFT),

- 추론 능력과 인간 선호도를 강화하는 RL/Preference Learning입니다.

Pre-training: 3단계 커리큘럼

K-EXAONE의 사전학습은 총 11T(11조) 토큰, FLOPs 규모로 수행됩니다.

이 학습은 3단계 커리큘럼으로 구성되어 점진적으로 능력을 쌓아갑니다.

- 1단계에서는, 웹 텍스트, 백과사전, 서적 등 광범위한 코퍼스로 언어와 세계 지식의 기초를 다집니다.

- 2단계에서는, 과학, 의학, 법률 등 전문 도메인 데이터의 비중을 높여 깊이 있는 지식을 학습합니다.

- 3단계에서는, 수학, 코딩, 논리 추론 데이터를 집중적으로 학습하여 추론 능력을 강화합니다.

이런 단계적 접근은 "기초 → 심화 → 응용"으로 이어지는 학습 설계로, 각 단계가 이전 단계 위에 쌓이는 구조입니다.

학습 셋업에서 주목할 점은 FP8 정밀도로 네이티브 학습을 수행한다는 것입니다.

- FP8은 숫자 하나를 8비트로 표현하는 방식으로, 일반적으로 사용되는 BF16(16비트)의 절반입니다.

- 일반적으로 비트 수가 줄면 메모리 사용량과 연산 속도에서 이점이 있지만, 정밀도가 낮아져 학습 불안정이 우려됩니다.

K-EXAONE은 FP8으로 학습하면서도 BF16과 동등한 Loss 곡선을 달성했다고 보고하며, 이는 대규모 MoE 모델에서도 FP8 학습이 실용적임을 보여줍니다.

Optimizer로는 Muon을 채택하고, Learning Rate Scheduler는 Warmup-Stable-Decay(WSD)를 사용합니다.

- WSD는 학습 초기에 Learning Rate를 천천히 올리고(Warmup), 일정 기간 유지한 뒤(Stable), 학습 후반에 서서히 줄이는(Decay) 방식입니다.

- 주요 하이퍼파라미터는 최대 학습률 , MoE Sequence Auxiliary Loss 계수 (Expert 간 Load Balancing을 위한 보조 Loss), MTP Loss Weight 0.05(미래 토큰 예측 보조 목표의 가중치)입니다.

다국어 확장에서는 Cross-Lingual Knowledge Transfer를 활용한 합성 코퍼스를 생성합니다.

- 6개 언어(한국어, 영어, 스페인어, 독일어, 일본어, 베트남어)의 사전학습 데이터 양은 언어별로 크게 다릅니다.

- 영어 데이터는 풍부하지만 베트남어 데이터는 상대적으로 적습니다.

- 이 불균형을 해소하기 위해, 데이터가 풍부한 언어에서 학습된 전문 지식과 추론 패턴을 다른 언어로 전파하는 합성 데이터를 생성합니다.

- 예를 들어 영어로 풍부하게 존재하는 과학 지식을 독일어나 베트남어로 변환하여, 언어와 무관하게 균일한 성능을 보장하는 것입니다.

또한 Thinking-Augmented Data Synthesis를 통해 사전학습 데이터에 명시적 추론 과정을 포함시킵니다.

- 일반적인 사전학습 데이터는 "결론"만 담고 있습니다.

- 예를 들어 위키피디아 문서에는 "지구의 둘레는 약 40,075km이다"라는 사실만 있지, 이를 어떻게 계산하는지의 추론 과정은 없습니다.

- Thinking-Augmented Data는 이런 문서에 대해 "이 사실에 도달하기까지의 사고 과정(Thinking Trajectory)"을 생성하고, 원본 콘텐츠와 결합하여 추론 과정이 포함된 학습 샘플을 만듭니다.

- 이 데이터는 모델이 단순 암기가 아닌 단계적 추론을 학습하도록 유도하며, 이후 Post-Training 단계(특히 RL)의 효과를 높이는 전략입니다.

Context Length Extension: 8K → 32K → 256K

사전학습된 기본 모델은 8K 토큰의 Context Window를 가집니다. 이를 실세계 활용에 필요한 256K 토큰까지 확장하기 위해 2단계 Context Length Extension을 수행합니다.

Stage 1에서 8K → 32K로,Stage 2에서 32K → 256K로 점진적으로 넓혀갑니다.- 한 번에 256K로 점프하지 않는 이유는 학습 안정성 때문입니다.

- 갑작스러운 Context 확장은 기존에 학습된 짧은 Context에서의 능력을 손상시킬 수 있으므로, 단계적으로 확장하면서 각 단계에서 안정성을 검증합니다.

두 단계 모두 동일한 세 가지 데이터 구성 요소를 사용하되, 각 단계의 목표에 맞게 비율을 조정합니다.

-

Rehearsal Dataset은 Context를 늘리는 학습에서 가장 큰 위험인 Short-Context 성능 저하를 방지합니다.

- Long-Context 데이터만 집중적으로 학습하면, 모델이 짧은 텍스트를 처리하는 능력이 퇴화할 수 있습니다. ("Catastrophic Forgetting")

- Rehearsal Dataset은 사전학습 때 사용한 분포와 유사한 짧은 고품질 샘플을 섞어 넣어, 기존 능력을 "리허설"하며 잊지 않도록 앵커링합니다.

-

Synthetic Reasoning Dataset은 수학, 과학, 경쟁 프로그래밍 등 다단계 추론이 필요한 문제로 구성됩니다.

- Context가 길어지면 추론 능력이 저하될 수 있는데(관련 정보가 넓은 범위에 분산되므로), 이 데이터셋은 긴 입력에서도 추론 품질을 유지하도록 훈련합니다.

-

Long-Document Dataset은 실제 긴 문서(논문, 책, 보고서 등)를 Truncation 없이 전체를 한 학습 샘플로 사용합니다.

- 모델이 문서의 처음부터 끝까지의 Long-Range Dependency를 직접 학습할 수 있도록 합니다.

- Stage 1에서는 32K 이내의 문서 위주로, Stage 2에서는 256K까지의 장문 비중을 높입니다.

품질 검증에는 Needle-In-A-Haystack(NIAH) 테스트를 사용합니다.

- NIAH는 긴 텍스트(haystack) 속 임의의 위치에 특정 정보(needle)를 심어놓고, 모델이 이를 찾아낼 수 있는지 테스트합니다.

- 예를 들어 200K 토큰 분량의 문서 중간에 "비밀 코드는 APPLE입니다"를 삽입한 뒤, "비밀 코드는 무엇인가?"라고 질문하는 식입니다.

- 각 Stage에서 목표 Context Range 전체에 걸쳐 거의 완벽한 NIAH 성능("green light")을 달성할 때까지 학습을 반복합니다.

(요약) Context Extension 학습 배치 구성 (한 배치 안에 세 종류가 섞임):

[Rehearsal 샘플] 짧은 일반 텍스트 (사전학습과 유사한 분포)

[Synthetic Reasoning] 수학/코드 추론 문제

[Long-Document] 긴 논문, 보고서 전체

Stage 1 (8K→32K): Rehearsal 비중 높음, Long-Doc은 32K 이내

Stage 2 (32K→256K): Long-Doc 비중 높음, 256K까지의 장문 포함Post-training: SFT → RL → Preference Learning

사전학습과 Context Extension이 끝난 모델은 방대한 지식과 Long-Context 처리 능력을 갖추고 있지만, 아직 "사용자와 대화하는 방법"을 모릅니다. Post-training은 이 모델을 실제 사용자 인터페이스에 적합하게 만드는 과정으로, 세 단계로 구성됩니다.

-

Supervised Fine-Tuning(SFT)을 통해 다양한 사용자 지시를 따르고 응답을 생성하는 능력을 학습합니다.

- "이 문서를 요약해줘", "이 코드의 버그를 찾아줘" 같은 지시-응답 쌍으로 학습하여, 모델이 사용자의 의도를 이해하고 적절한 형식으로 응답하도록 합니다.

- 한국어 특화 능력 강화를 위해 과학기술정보통신부(MSIT), 한국지능정보사회진흥원(NIA), 한국데이터산업진흥원(K-DATA) 등이 제공하는 공공 및 기관 데이터를 활용합니다.

-

Agentic Tool Use 학습에서는 모델이 외부 도구(API, 웹 검색, 코드 실행기 등)를 호출하여 문제를 해결하는 능력을 학습합니다.

- 실제 Tool 환경을 수백 가지 구축하는 것은 비용이 높으므로, LLM을 활용한 Synthetic Tool Environment를 만듭니다.

- 구체적으로 LLM이 가상의 Tool-Use 시나리오(예: "항공편 검색 API를 호출하여 서울-도쿄 최저가 항공편을 찾아라")와 검증 가능한 통과 기준(예: "올바른 API 파라미터를 사용하고 결과를 정확히 해석했는가")을 생성합니다.

- 이후 다시 LLM으로 평가하여 비현실적이거나 풀 수 없는 케이스를 필터링합니다.

-

Web Search 수행 시에는 두 가지 Sub-Agent를 활용하여 Context 효율성을 개선합니다.

- 웹 검색은 많은 양의 텍스트를 가져오기 때문에 Context Window를 빠르게 소비하는 문제가 있습니다.

- Summarizer Sub-Agent는 가져온 웹페이지를 핵심 내용으로 요약하여 K-EXAONE이 길고 노이즈가 많은 웹 텍스트를 직접 처리하지 않도록 합니다.

- Trajectory Compressor는 Tool-Calling 이력이 일정 단계를 초과하면, 지금까지의 검색 결과와 남은 질문을 하나의 JSON 레코드로 압축합니다.

- 이렇게 하면 중복된 Tool 결과가 반복 노출되는 것을 방지하여, 제한된 Context Window를 효율적으로 활용할 수 있습니다.

- 두 Sub-Agent 모두 별도 모델이 아니라 K-EXAONE과 동일한 기반 모델로 구현됩니다.

- 웹 검색은 많은 양의 텍스트를 가져오기 때문에 Context Window를 빠르게 소비하는 문제가 있습니다.

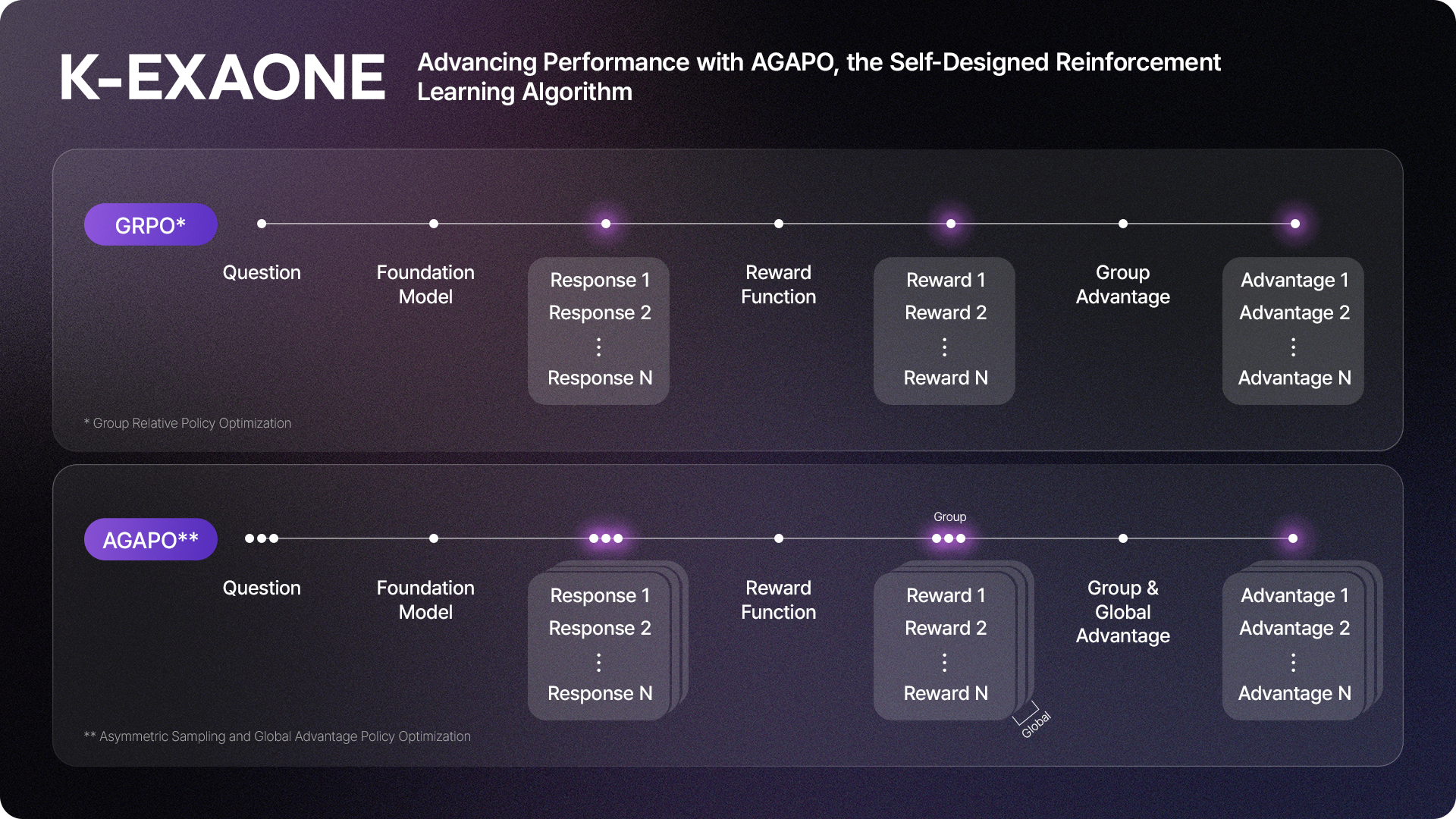

Reinforcement Learning: AGAPO

SFT까지 마친 모델은 사용자 지시를 따를 수 있지만, 수학 문제를 풀거나 코드를 작성하는 등의 추론 능력은 아직 최적화되지 않았습니다. RL 단계에서는 "정답을 맞히면 보상, 틀리면 페널티"라는 명확한 피드백으로 추론 능력을 강화합니다.

K-EXAONE은 수학, 코드, STEM, Instruction Following을 아우르는 Multi-Task RL을 수행합니다. 검증에는 두 가지 방식을 조합합니다.

- Rule-Based Verifier는 수학 문제의 최종 답이 정답과 일치하는지, 코드가 테스트 케이스를 통과하는지 등을 자동으로 확인합니다.

- LLM-as-a-Judge는 Instruction Following처럼 정답이 하나로 정해지지 않는 태스크에서 응답 품질을 평가합니다.

최적화에는 AGAPO(Off-Policy Policy Gradient with Truncated Importance Sampling)를 사용합니다. 기본 아이디어는 이렇습니다.

- 하나의 질문에 대해 여러 개(개)의 응답을 생성하고, 각 응답에 보상을 매긴 뒤, 좋은 응답의 생성 확률은 높이고 나쁜 응답의 생성 확률은 낮추는 방향으로 모델을 업데이트합니다.

이 수식의 각 구성 요소는 다음과 같은 역할을 합니다.

- 는 현재 모델이 해당 토큰을 생성할 확률의 로그값입니다.

- 는 Advantage로, 해당 응답이 다른 응답 대비 얼마나 좋은지를 나타냅니다.

- Advantage가 양수면 이 응답의 생성 확률을 높이고, 음수면 낮춥니다.

- 는 Importance Ratio로, 현재 모델과 응답을 생성한 모델 간의 확률 비율입니다.

- Off-Policy 학습(이전 버전 모델이 생성한 응답으로 현재 모델을 학습)에서 두 모델의 차이를 보정하는 역할을 합니다.

- 의 sg는 Stop Gradient로, Importance Ratio가 Gradient에 영향을 미치지 않도록 상수로 취급합니다.

- 으로 클리핑하여 비율이 극단적으로 커지는 것을 방지합니다.

Advantage 계산은 두 단계로 이루어집니다.

(1) 먼저 Group-Level Advantage를 계산합니다.

한 질문에 대한 개 응답 내에서, 해당 응답의 보상()이 나머지 응답들의 평균 보상보다 얼마나 높은지를 계산합니다. 이렇게 하면 "쉬운 질문이라 모든 응답이 높은 보상을 받은 경우"와 "어려운 질문이라 모든 응답이 낮은 보상을 받은 경우"가 구분됩니다.

(2) 이어서 Global Normalization을 적용합니다.

전체 배치에 걸쳐 Advantage를 정규화하여, 배치 수준의 정보를 반영합니다.

AGAPO의 핵심 설계 결정은 아래 세 가지입니다.

-

Zero-Variance Filtering은 개 응답이 모두 동일한 보상을 받은 질문을 학습에서 제외합니다. 모든 응답의 보상이 같으면 Advantage가 0이 되어 학습 신호가 없으므로, 이런 프롬프트를 필터링하여 유효한 학습 신호만 사용합니다.

-

KL Penalty를 제거합니다. 많은 RL 기법이 모델이 원래 정책(Reference Policy)에서 너무 벗어나지 않도록 KL Divergence 페널티를 추가하지만, AGAPO는 이를 사용하지 않습니다. Truncated Importance Sampling이 이미 업데이트 크기를 제한하므로 KL Penalty가 불필요하며, 제거함으로써 성능 향상과 연산 절감을 동시에 달성합니다.

-

MoE Router를 동결합니다. RL 학습 전 과정에서 Router 가중치를 고정하여, Expert 배정 패턴이 RL에 의해 교란되는 것을 방지합니다. 사전학습에서 최적화된 라우팅을 보존하면서 각 Expert의 내부 능력만 강화하는 전략입니다.

Preference Learning: GROUPER

RL이 수학, 코드 등 정답이 있는 태스크의 추론 능력을 강화했다면, Preference Learning은 "정답은 없지만 사람이 선호하는 응답"에 맞추는 단계입니다. Chat, Safety, Instruction Following, Agentic Tool Use, Creative Writing 등 일반 정렬 도메인에 집중하며, RL에서 강화된 추론 성능은 보존합니다.

K-EXAONE은 이를 위해 SimPER의 개선 변형인 GROUPER(Group-wise SimPER)를 제안합니다. GRPO에서 영감을 받아, 하나의 쿼리에 대해 여러 응답을 샘플링하고, 각 응답의 품질을 평가하여 Group-wise Advantage로 학습합니다.

- 각 응답의 Preference Reward는 두 가지를 조합하여 산출합니다.

- Rule-Based Reward는 응답 길이, 형식 준수, 안전성 위반 여부 등 규칙으로 측정 가능한 측면을 평가합니다.

- Rubric-Based Generative Reward는 LLM이 미리 정의된 평가 기준표(Rubric)에 따라 유용성, 정확성, 완결성 등 여러 차원에서 응답 품질을 점수로 매깁니다.

목적함수는 다음과 같습니다.

AGAPO의 목적함수와 비교하면 구조가 다릅니다.

- AGAPO는 에 Advantage를 곱하는 표준적인 Policy Gradient 형태이지만,

- GROUPER는 , 즉 토큰당 평균 확률에 Advantage를 곱합니다.

- 이것은 SimPER에서 가져온 설계로, 응답 길이에 의한 편향을 자동으로 보정하여 추가 Hyperparameter 없이 학습이 안정적으로 이루어지는 장점이 있습니다.

Advantage 계산에서도 AGAPO와 차이가 있습니다.

- AGAPO는 Group Advantage를 Global Normalization하지만,

- GROUPER는 범위로 Min-Max 스케일링합니다.

먼저 Preference Reward를 표준화(z-score)한 뒤, 범위로 재스케일링합니다.

- 이렇게 하면 가장 좋은 응답의 Advantage는 +1에 가깝고, 가장 나쁜 응답은 -1에 가까워져, 응답 간 상대적 선호도가 일관된 스케일로 표현됩니다.

GROUPER의 핵심 기여를 정리하면, SimPER의 Hyperparameter-Free 특성(응답 길이 보정이 자동으로 이루어짐)과 GRPO의 Group-wise Sampling(하나의 쿼리에서 여러 응답을 비교)을 결합한 것입니다.

- 이를 통해 추가적인 Hyperparameter 튜닝 없이도 일반 정렬 도메인에서의 성능을 개선합니다.

평가 결과

벤치마크와 평가 설정

K-EXAONE은 9개 카테고리에 걸친 포괄적 벤치마크 스위트로 평가됩니다. World Knowledge(MMLU-PRO, GPQA-DIAMOND, HUMANITY'S LAST EXAM), Math(IMO-ANSWERBENCH, AIME 2025, HMMT NOV 2025), Coding/Agentic Coding(LIVECODEBENCH PRO, LIVECODEBENCH V6, TERMINAL-BENCH 2.0, SWE-BENCH VERIFIED), Agentic Tool Use(-BENCH, BROWSECOMP), Instruction Following(IFBENCH, IFEVAL), Long Context Understanding(AA-LCR, OPENAI-MRCR), Korean(KMMLU-PRO, KOBALT, CLICK, HRM8K, KO-LONGBENCH), Multilinguality(MMMLU, WMT24++), Safety(WILDJAILBREAK, KGC-SAFETY)를 포함합니다.

평가 설정은 Temperature 1.0, Top-p 0.95이며, Long Context Understanding 벤치마크에는 160K, 나머지에는 128K Context Length를 사용합니다. 추론 시 MTP는 비활성화합니다.

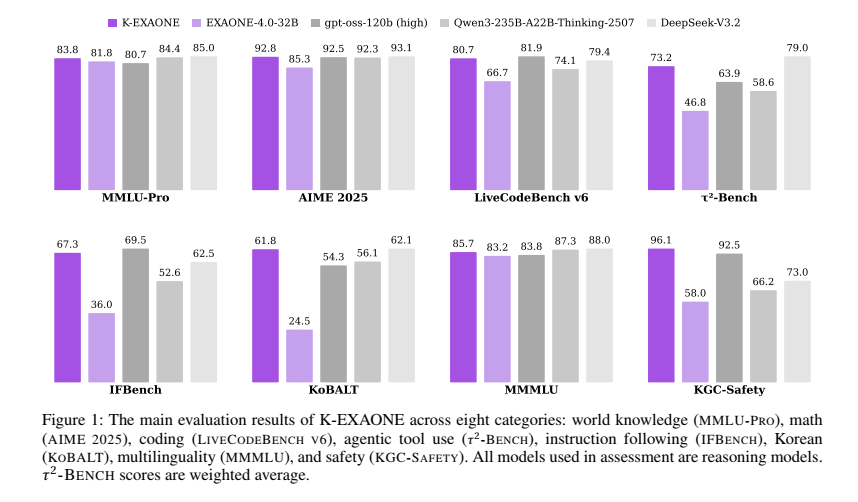

Reasoning 모드 주요 결과

비교 대상은 EXAONE 4.0(32B Dense), gpt-oss-120b(117B MoE, 5.1B Active), Qwen3-235B-A22B-Thinking-2507(235B MoE, 22B Active), DeepSeek-V3.2(671B MoE, 37B Active)입니다.

| 벤치마크 | K-EXAONE | EXAONE 4.0 | gpt-oss-120b | Qwen3-235B | DeepSeek-V3.2 |

|---|---|---|---|---|---|

| MMLU-PRO | 83.8 | 81.8 | 80.7 | 84.4 | 85.0 |

| AIME 2025 | 92.8 | 85.3 | 92.5 | 92.3 | 93.1 |

| LiveCodeBench V6 | 80.7 | 66.7 | 81.9 | 74.1 | 79.4 |

| -Bench (weighted) | 73.2 | 46.8 | 63.9 | 58.6 | 79.0 |

| IFBench | 67.3 | 36.0 | 69.5 | 52.6 | 62.5 |

| KoBALT | 61.8 | 25.4 | 54.3 | 56.1 | 62.7 |

| KGC-SAFETY | 96.1 | 58.0 | 92.5 | 66.2 | 73.0 |

수학 추론에서 K-EXAONE은 AIME 2025에서 92.8을 달성하여 gpt-oss-120b(92.5)와 Qwen3(92.3)을 상회하고, 37B 활성 파라미터를 가진 DeepSeek-V3.2(93.1)에 근접합니다. 23B 활성 파라미터로 이 수준의 성능을 달성한 것은 파라미터 효율성 면에서 인상적입니다.

Agentic Tool Use(-Bench)에서는 가중 평균 73.2로 gpt-oss-120b(63.9)와 Qwen3(58.6)을 크게 상회합니다. 이는 Synthetic Tool Environment 기반 학습 전략이 유효했음을 시사합니다. 다만 DeepSeek-V3.2(79.0)에는 미치지 못합니다.

Instruction Following에서 K-EXAONE은 IFBench 67.3, IFEVAL 89.7을 기록하여 대부분의 비교 모델을 능가합니다.

안전성(KGC-SAFETY)에서는 96.1로 모든 비교 모델을 압도적으로 능가합니다. gpt-oss-120b(92.5)와도 3.6p 차이를 보이며, Qwen3(66.2)와 DeepSeek-V3.2(73.0)와는 20~30p 이상의 격차를 보입니다.

한국어 및 다국어 성능

한국어 벤치마크에서 K-EXAONE은 Open-Weight Reasoning 모델 중 강한 성능을 보입니다. CLICK(언어·문화 역량) 83.9, HRM8K(올림피아드급 수학 추론) 90.9, KO-LONGBENCH(Long-Context 이해) 86.8을 달성합니다. 다만 KMMLU-PRO(67.3)에서 Qwen3(71.6)과 DeepSeek-V3.2(72.1)에 뒤처지는 점은 주목할 만합니다. 한국어 특화 모델임에도 한국어 전문 지식 벤치마크에서 최고가 아닌 것은 향후 개선이 필요한 영역입니다.

다국어 평가에서는 MMMLU 85.7, WMT24++ 90.5를 기록합니다. EXAONE 4.0 대비 모든 언어에서 고르게 성능이 향상되어, 특정 언어의 두드러진 약화나 지배 없이 균형 잡힌 다국어 역량을 보여줍니다.

Non-Reasoning 모드 특기사항

Non-Reasoning 모드에서 특히 주목할 결과는 Long Context Understanding입니다. K-EXAONE은 AA-LCR 45.2, OPENAI-MRCR 60.9를 달성하여, Qwen3(31.2, 42.8)과 DeepSeek-V3.2(32.0, 42.4)를 대폭 상회합니다. 이는 Hybrid Attention 구조와 2단계 Context Extension 전략이 Non-Reasoning 환경에서 특히 효과적임을 시사합니다.

EXAONE 4.0 대비 개선폭

EXAONE 4.0(32B Dense)에서 K-EXAONE(236B MoE, 23B Active)으로의 전환에서 가장 극적인 개선이 나타난 영역은 -Bench Telecom(23.7 → 73.5, +49.8p), KGC-SAFETY(58.0 → 96.1, +38.1p), KoBALT(25.4 → 61.8, +36.4p), IFBench(36.0 → 67.3, +31.3p)입니다. 이는 MoE 스케일링과 Post-Training 파이프라인 개선의 복합적 효과로 해석됩니다.

개선 여지 영역

실험 결과에서 몇 가지 개선 여지가 확인됩니다. Agentic Coding(SWE-BENCH VERIFIED 49.4)에서 DeepSeek-V3.2(73.1)과 gpt-oss-120b(62.4)에 비해 상당한 격차가 존재합니다. HUMANITY'S LAST EXAM(13.6)에서 DeepSeek-V3.2(25.1)의 약 절반 수준으로, 최상위 난이도 지식 추론에서 한계를 보입니다.

안전성 프레임워크: K-AUT와 KGC-SAFETY

K-EXAONE의 가장 두드러진 차별점 중 하나는 한국 사회문화적 맥락을 체계적으로 반영한 안전성 프레임워크입니다. 기존의 서구 중심 AI 위험 분류 체계가 한국 사회의 문화적 민감성과 맥락 특화 요구를 충분히 반영하지 못하는 한계를 극복하기 위해, Korea-Augmented Universal Taxonomy(K-AUT)를 제안합니다.

K-AUT는 4개 주요 도메인과 226개 세부 위험 영역으로 구성됩니다. Universal Human Values(55개)는 UN 헌장과 국제 인권 기준에 기반한 생명·존엄·기본권 위협을 다룹니다. Social Safety(75개)는 사회 질서 교란이나 양극화 심화를 평가합니다. Korean Sensitivity(60개)는 헌법적 가치, 국내법(국가보안법 등), 검증된 역사적 합의에 기반하여 한국의 문화적·역사적·지정학적 맥락에서의 민감 이슈를 관리합니다. Future Risk(36개)는 국제 AI 윤리 원칙과 예측적 위험 연구에 기반하여 신기술로 인한 새로운 위협을 다룹니다.

이 프레임워크를 기반으로 한 KGC-SAFETY 벤치마크는 226개 카테고리에서 각 10개씩 총 2,260개 테스트 인스턴스로 구성되며, 다국어(6개 언어), 멀티턴, 적대적, 일반 시나리오를 포함합니다. 평가는 LLM-as-a-Judge 프레임워크로 수행되며, 각 테스트 케이스의 안전 여부를 이진 판단합니다.

KGC-SAFETY 세부 결과에서 대부분의 모델이 Universal Human Values와 Social Safety에서 상대적으로 높은 Safe Rate를 보이지만, Future Risk와 Korean Sensitivity에서는 낮은 경향을 보입니다. K-EXAONE은 전 도메인에서 94% 이상의 Safe Rate를 유지하여(Universal Human Values 97.5, Social Safety 96.9, Korean Sensitivity 94.3, Future Risk 95.0), K-AUT 기반의 한국 특화 안전성 학습이 효과적이었음을 입증합니다.

논문에서는 이 접근법이 다른 국가의 Sovereign AI 개발 시 modular하고 scalable한 blueprint으로 활용될 수 있다고 위치를 지정합니다. 보편적 윤리에 지역적 특수성을 체계적으로 통합하는 K-AUT의 구조는, 각국의 문화적 맥락에 맞게 확장 가능한 설계를 갖추고 있습니다.

한계와 배포

K-EXAONE은 모든 LLM과 마찬가지로 몇 가지 한계를 가집니다.

개인적, 유해한, 편향된 정보를 포함하는 부적절한 응답이 생성될 수 있으며, 연령·성별·인종 등과 관련된 편향된 응답이 나올 수 있습니다. 학습 데이터의 통계에 크게 의존하여 의미적·구문적으로 부정확한 문장이 생성될 수 있고, 최신 정보를 반영하지 못하여 거짓이거나 모순된 응답을 할 수 있습니다.

배포 측면에서 K-EXAONE은 비독점적, 비양도적, 전 세계적, 취소 불가 라이선스로 상업적·비상업적 목적의 접근, 다운로드, 설치, 수정, 사용, 배포, 파생 저작물 생성이 허용됩니다. 다만 상업적 목적의 배포, 서브라이선싱, 또는 제3자 제공은 별도 합의가 필요합니다.

결론

K-EXAONE은 한국의 AI 인프라 제약 속에서 정부-민간 협력을 통해 글로벌 경쟁력 있는 대규모 모델을 구축할 수 있음을 실증한 Sovereign AI 모델입니다.

MoE 아키텍처를 통한 효율적 스케일링(236B/23B), Hybrid Attention 기반의 256K Long-Context 처리, SuperBPE Tokenizer의 평균 30% 효율 향상, AGAPO RL과 GROUPER Preference Learning을 통한 정렬, 그리고 K-AUT 프레임워크 기반의 한국 사회문화 특화 안전성이라는 다층적 혁신이 조화를 이루며, 추론, Agentic, 다국어, 안전성 등 다양한 평가에서 유사 규모 Open-Weight 모델들과 대등하거나 그 이상의 성능을 입증합니다.

향후 연구 방향으로는 K-EXAONE의 MoE 라우팅 동작 분석(어떤 Expert가 어떤 언어/도메인에 특화되는지에 대한 Ablation Study), Agentic Coding 능력 강화, 그리고 GROUPER와 기존 RLHF/DPO 계열 Preference Learning 방법론 간의 심층 비교가 흥미로운 탐구 주제가 될 것입니다.

읽어주셔서 감사합니다.