*20210914 11시 줌 강의, 업로드 동의를 받았습니다.

경사하강법을 배우는 이유

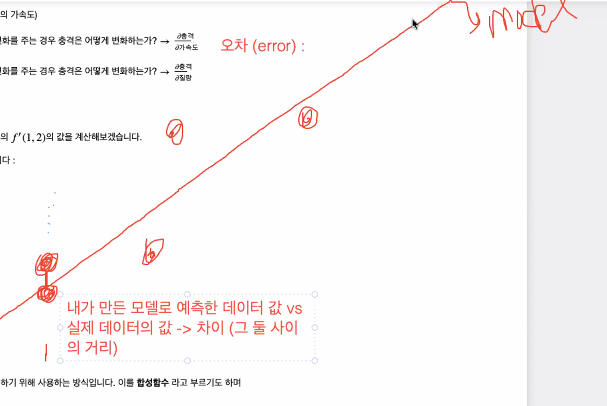

오차 (error):

용어(차이를 작게)

에러를 최소화 시키고 싶다 ->

gradient descent(경사하강법)를 사용하는 이유

에러-cost function

error=cost=distance 같은 언어

cost function>최소화>최적화(optimization)

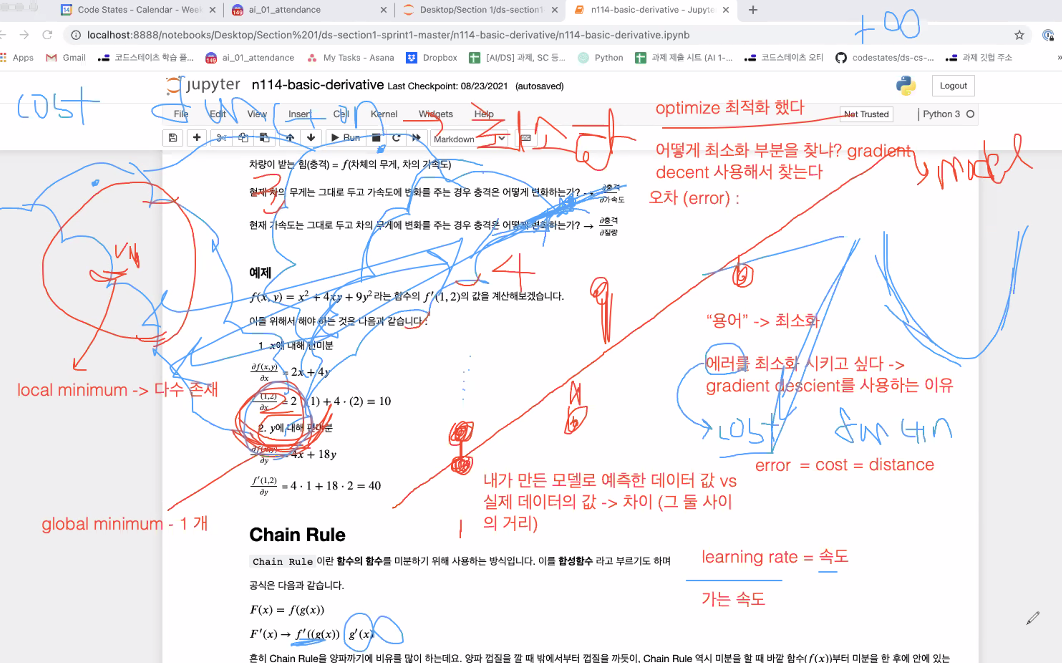

방법: gradient descent 사용

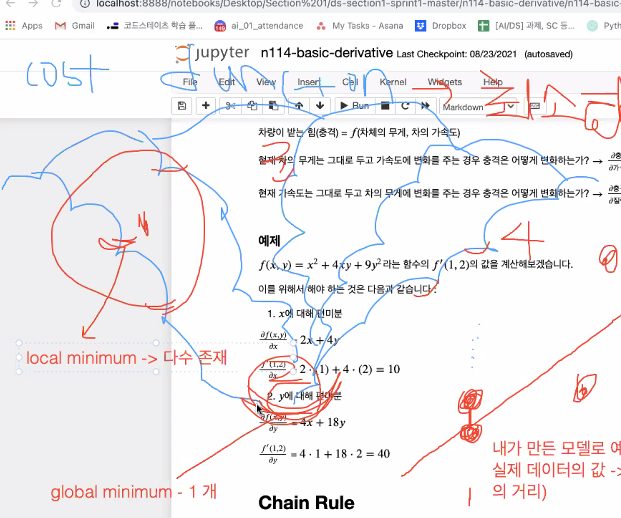

local minimun: 시야의 한계

자신은 global 찾았다고 생각해도 local인 경우가 많아서 최적화가 어렵다.

Q(동기분 질문):처음부터 global minimum을 찾을 수 없는 이유는?

A: 과정을 봐야한다. 시작점이 랜덤하다.

기울기를 따라서 내가 갈 수 있는 대로 간다.

산을 내려간다고 생각하면 가장 이지 웨이로 가게 된다. 계속 방향을 틀어서 간다. 이게 경사 하강법이다.

- learning rate=속도

가는 속도가 너무 빠르면 튕겨나가고 너무 느리면 한없이 가는 것. 그래서 최적화된 minimum으로 간다고 생각하야함.

비행기에서 눈을 감고 그랜드 캐니언에 뛰어 내리는데 최대한 밑으로 내려가는게 목표다.

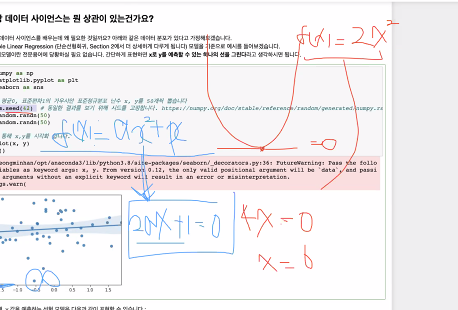

기울기=0이다를 찾는 것이다.

경사 하강법 : 경사가 되게 다양한데 거기서 내가 어떻게 경사를 찾아서 가느냐..

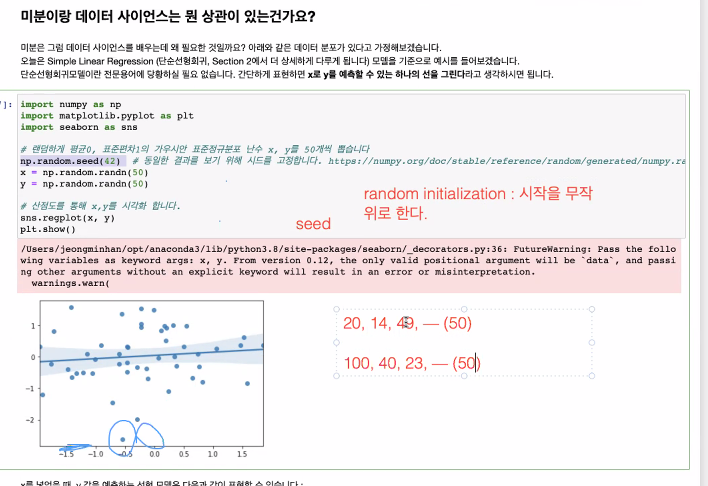

random initialization

비행기에 내려서 산으로 하강을 하는데 시작점이 랜덤하다고 아까 설명한 것.

-> 똑같은 모델인데도 할 때 마다 시작점이 다르니까 결과값이 달라짐.

-> 결과값을 같이하고 싶으면 시작점을 같게 함.

ex) seed(시작점) 가 4다 이런식으로.

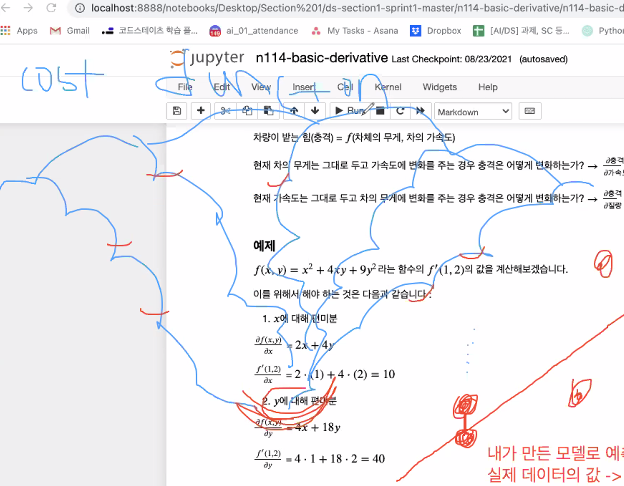

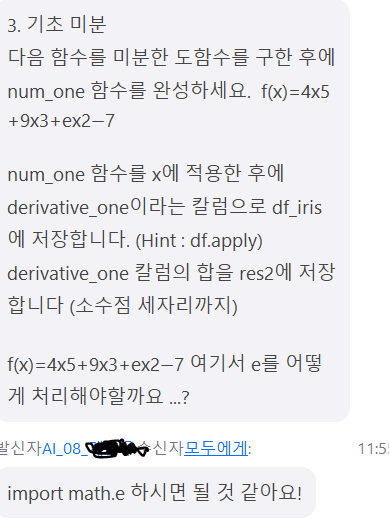

미분

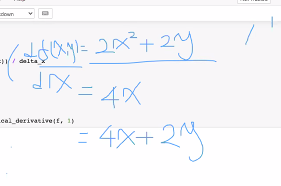

Q: 무엇이 맞냐

A: 4x +2y (x로 편미분) 2y는 상수 처리

seed

ex) 나는 시드를 42로 심었다.

(질문)

Q: 오늘 과제에 주어진 machine learning model의 error function ( ε )이 다음과 같을 때 error function을 최소화 하는 최적의 parameter들을 구하세요 라는 문제가 있던데, 문제가 이해가 안갑니다. 파라미터를 구하라는게 어떤걸 말하는지 모르겠습니다.

(서로 general 디스코드에서 답은 알려주지 말되, 서로 도와가면서 해야 성장한다.!!)

개린이님, 깔끔한 정리 감사합니다:) 화이팅!