Generative model 2

Is an autoencoder a generative model?

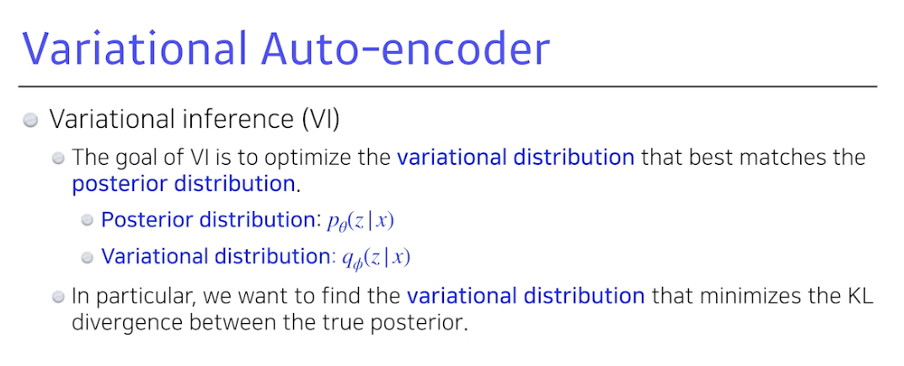

Variational inference(VI)

Posterior distribution

: observation이 주어졌을 때 내가 관심 있어 하는 random variable의 확률분포

Given이 뒤집힌 P(x|z)는 likelihood라고 부른다.

Z는 latent vector

Variational distribution:

Posterior는 계산하기가 너무 힘들다 -> 그래서 얘를 최적으로 학습할 수 있는 어떤 것으로 근사 하겠다는게 목적이고 근사하는 분포가 Variational distribution이다.

이를 찾는 과정을 VI 라고 한다.

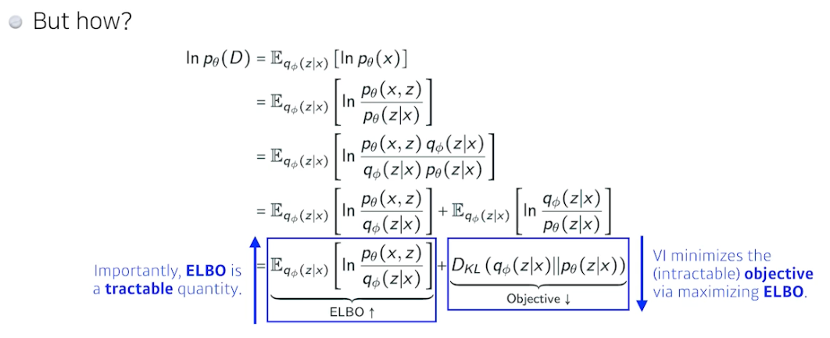

But

내가 posterior 이 뭔지도 모르는데 posterior distribution에 근사하는 무언가를 찾는다는 것은 어불성설이다.

이것을 가능하게 하는 트릭이 elbo 트릭이다.

KL Divergence 를 줄이는 것이 목적인데 이것이 불가능이기때문에 ELBO 를 maximizing 하는 것으로 대체하자.

-> 이것이 바로 VI 이다.

= Sandwich Method

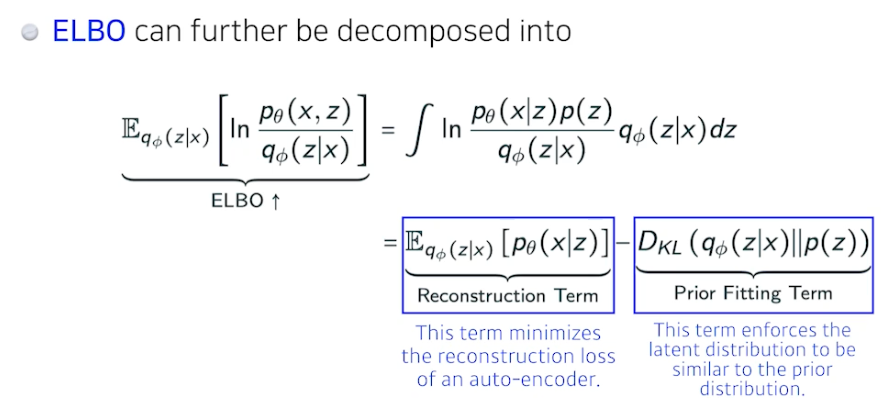

ELBO =

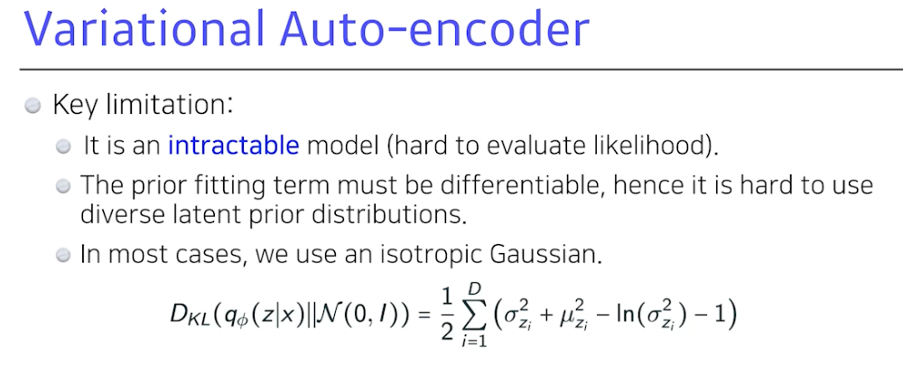

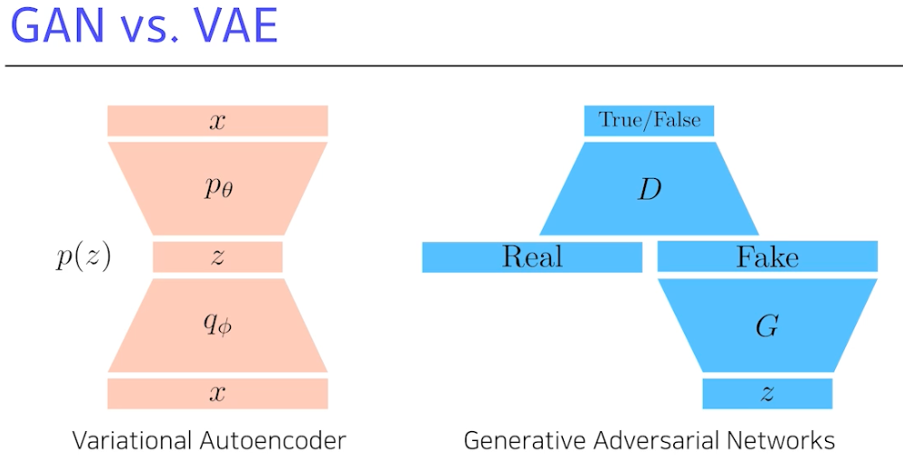

VA-encoder의 한계

가우시안이 KL divergence 를 구할 수 있는 많지 않은 경우 이기 때문에 가우시안을 활용한다.

하지만 많은 경우에 Prior d 로 가우시안을 활용하고 싶지 않을 때가 있다.

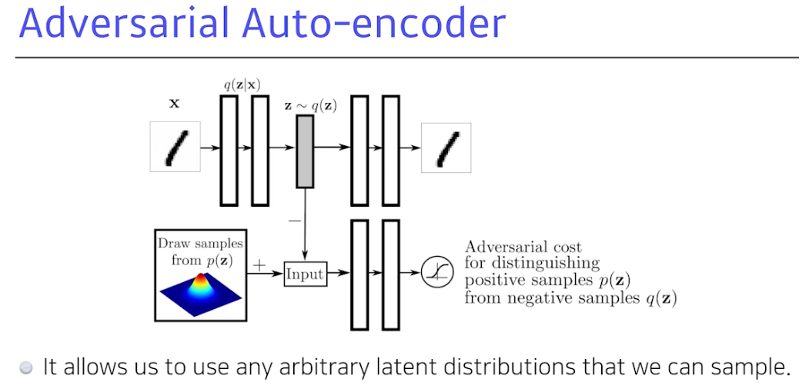

KL divergence 의 Prior Fitting Term 을 GAN objective로 바꿔준 것

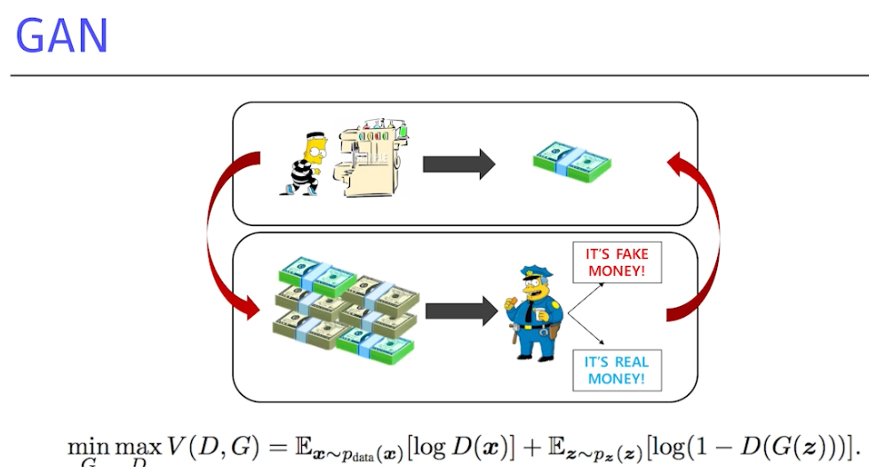

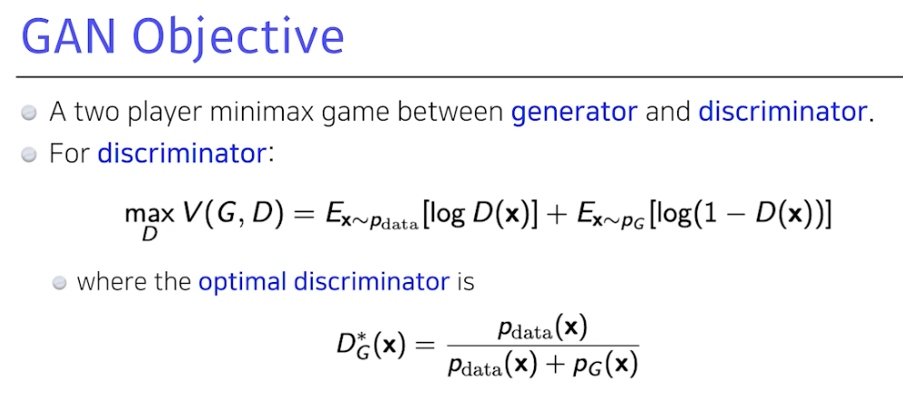

Discriminator와 generator의 경쟁. 궁극적으로는 generator의 성능을 높이는게 목적

Discriminator도 generator를 따라서 같이 좋아지기 때문에 좋다.

D*(x)가 높을수록 True, 낮으면 False

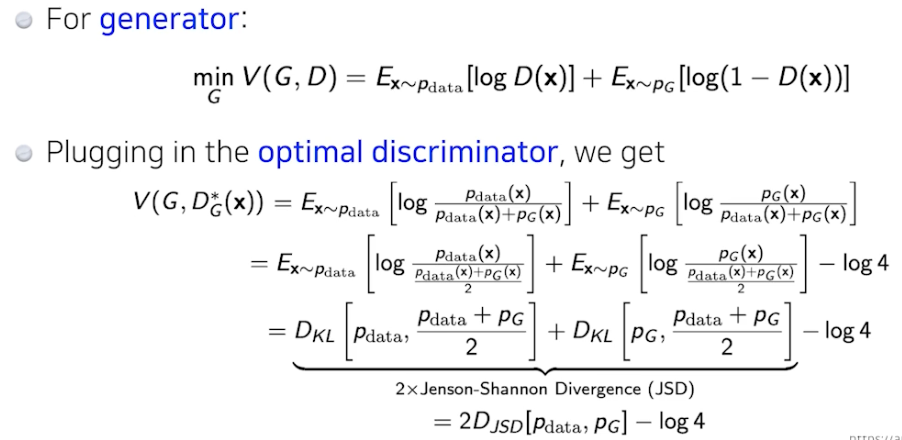

DCGAN

CNN 활용

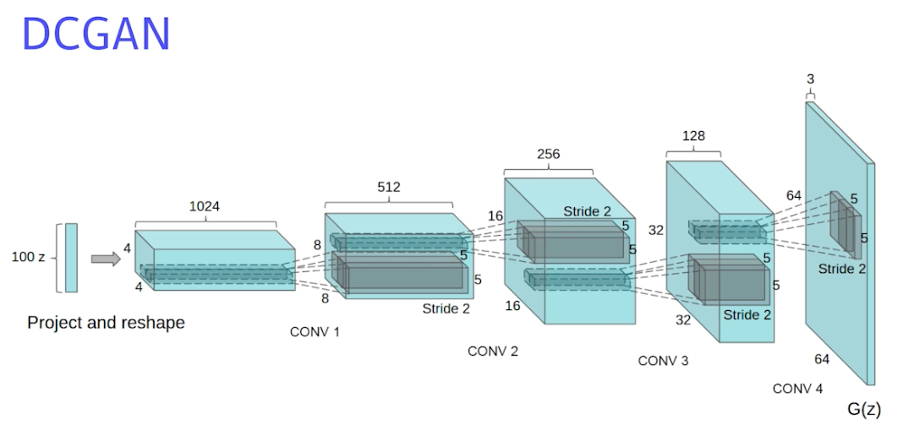

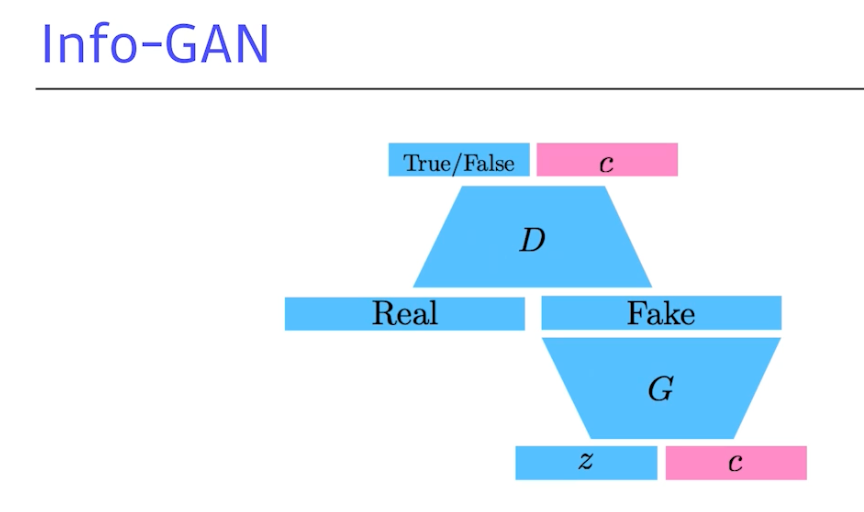

Info-GAN

클래스를 원핫벡터중 하나로 주며 이를 통해 학습할 때 어디에 집중 해야 하는지를 알려줌

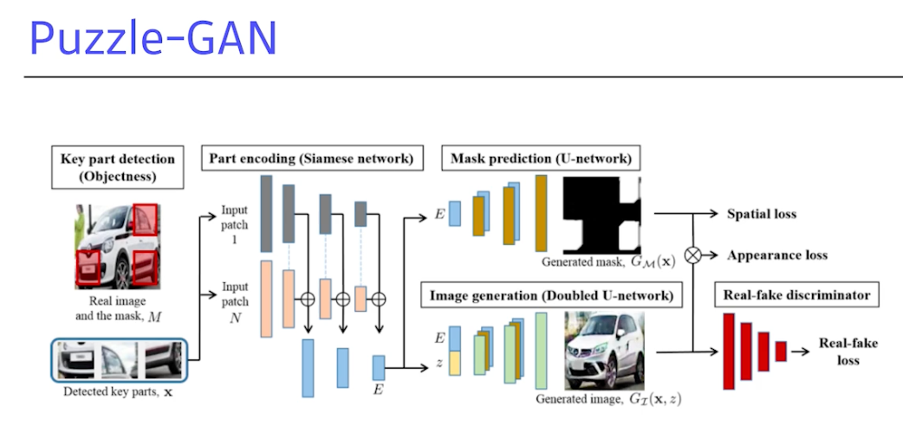

서브패치들을 넣어서 원래 이미지를 복원하는 방법

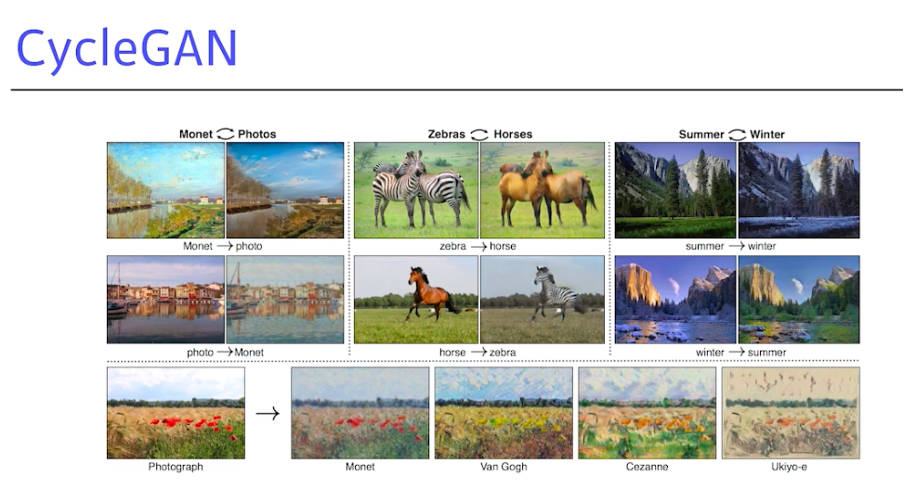

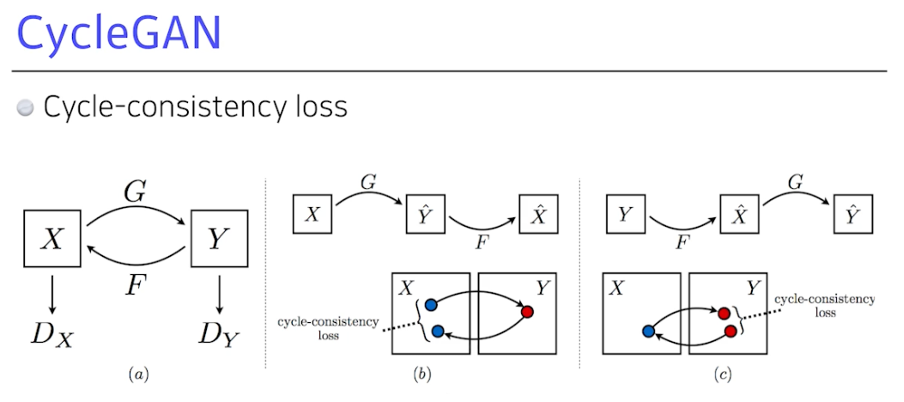

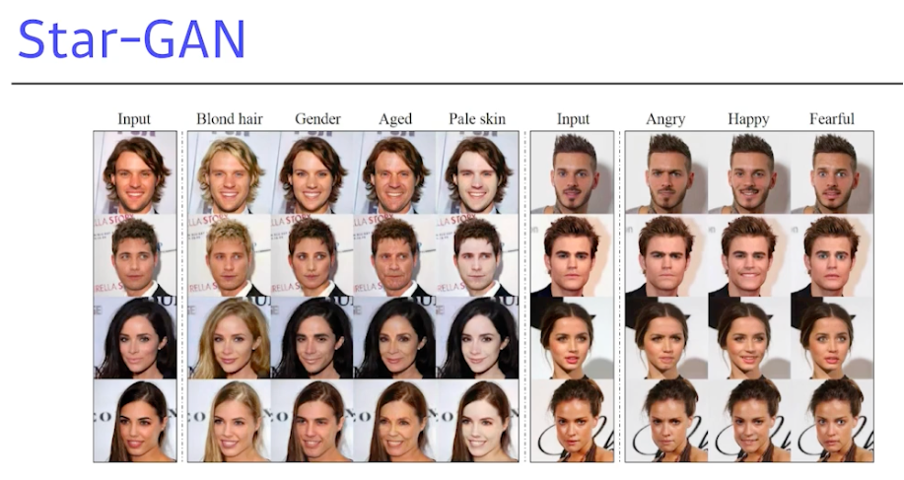

이미지 사이의 도메인을 변경한다.

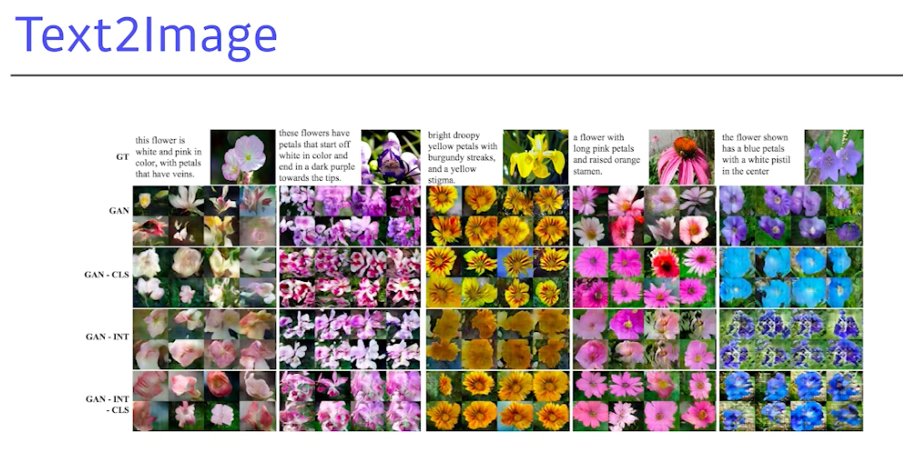

이미지를 컨트롤