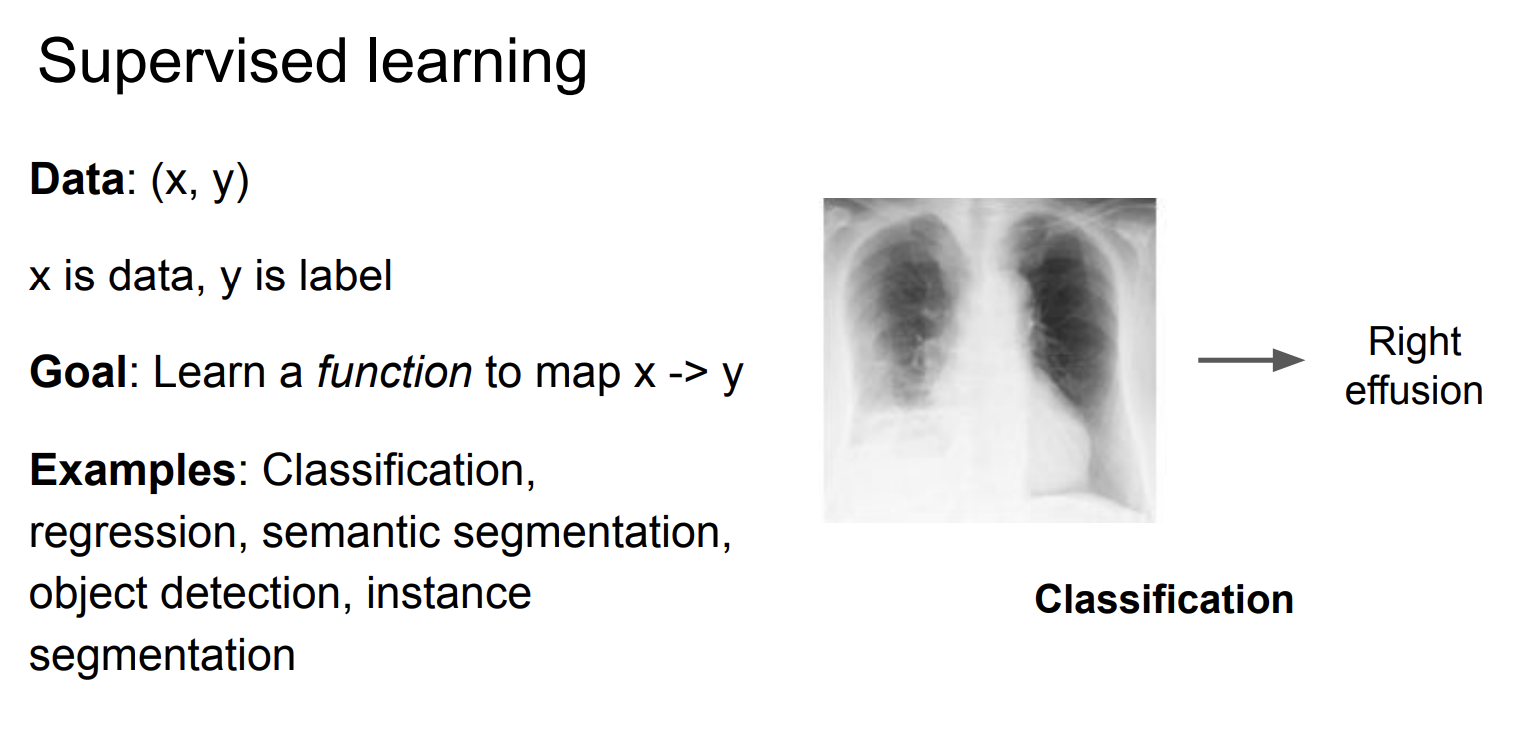

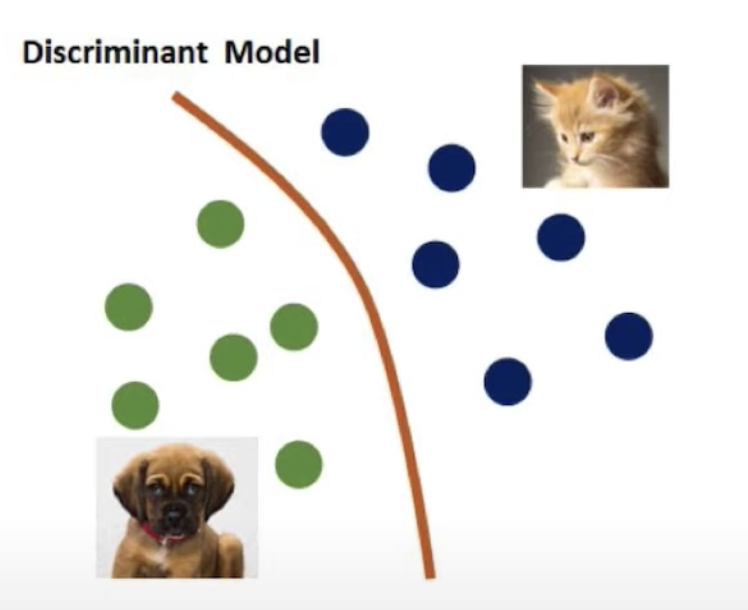

Supervised Learning

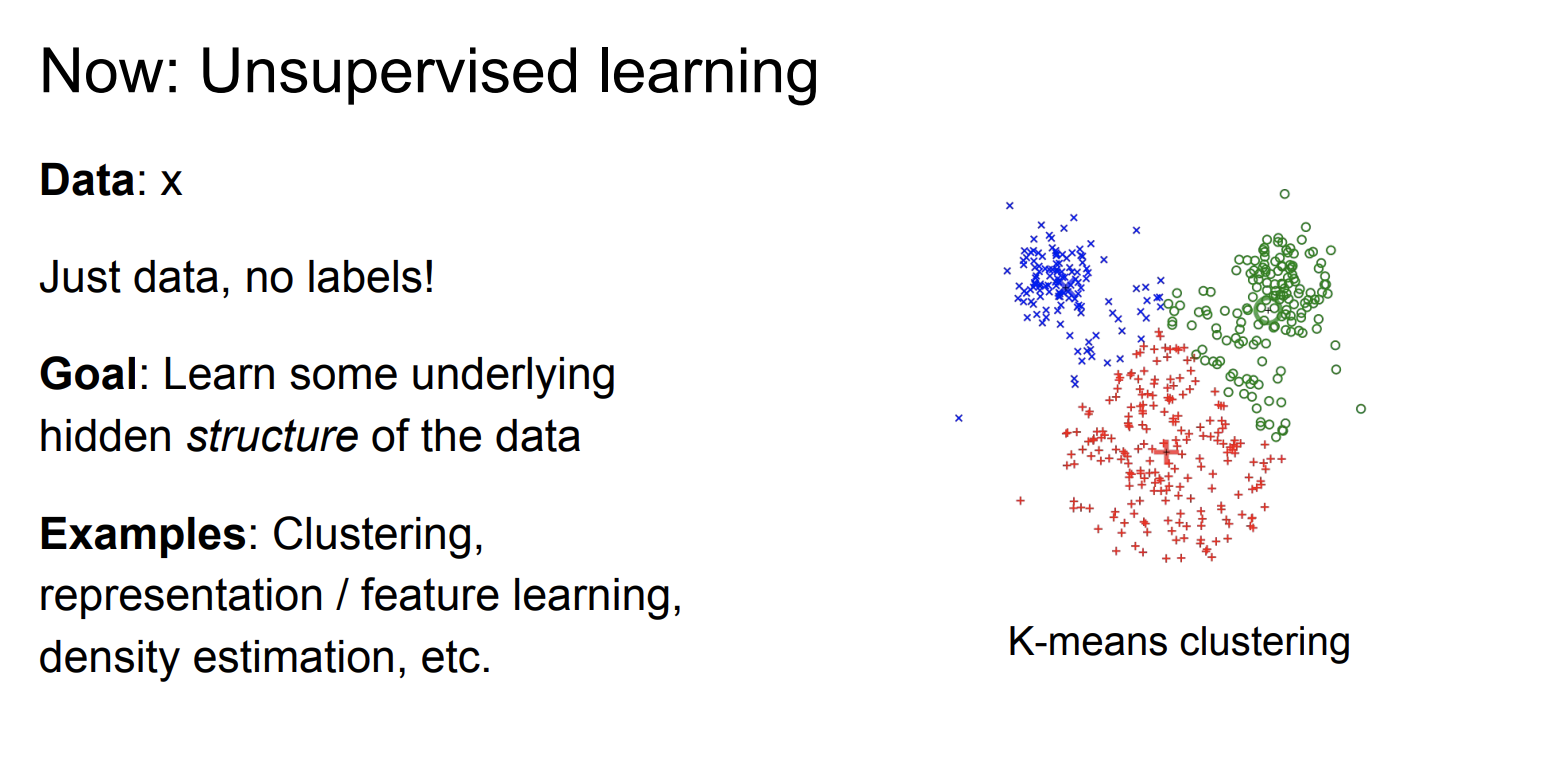

Unsupervised Learning

*K-means clustering

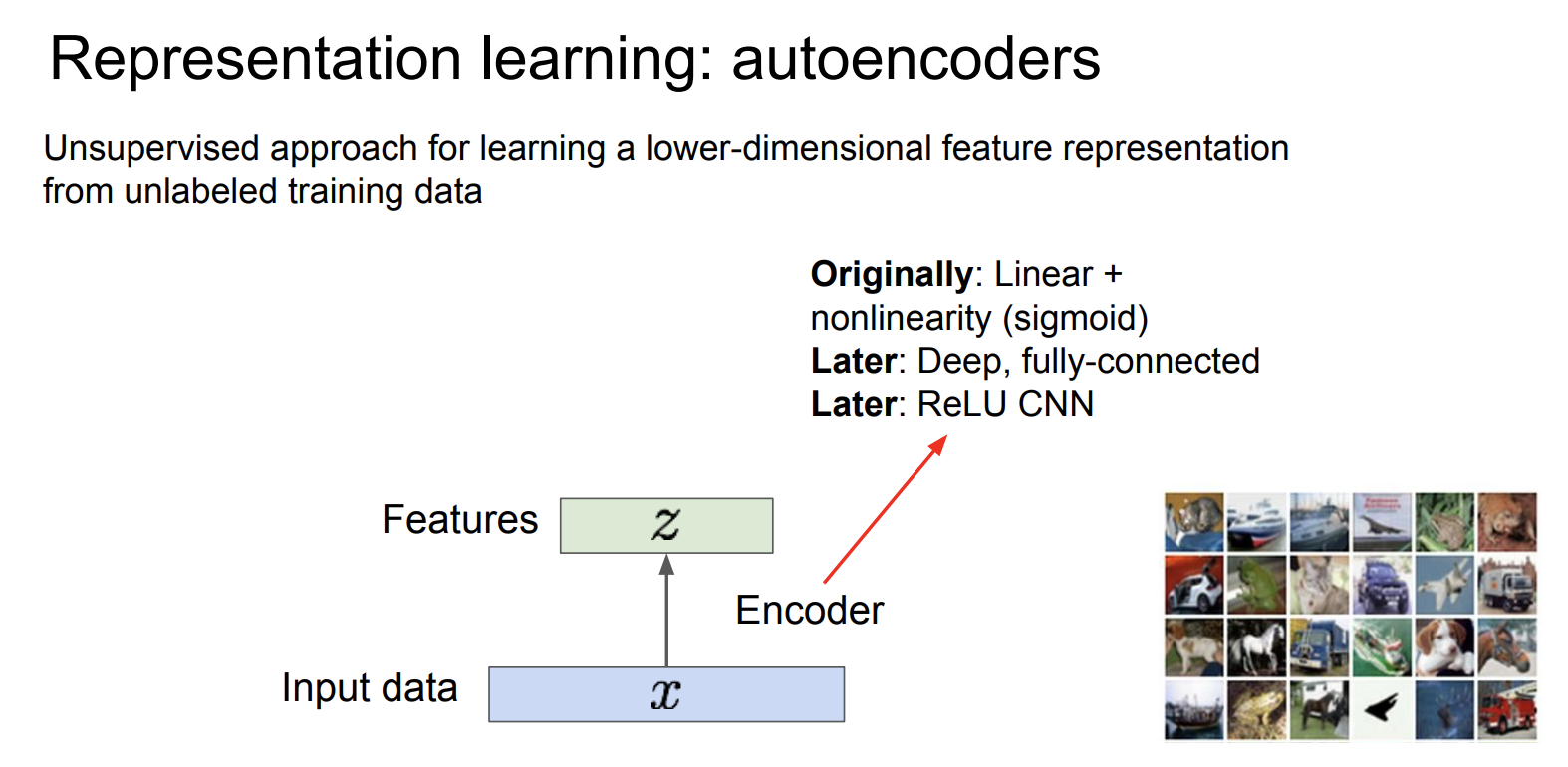

유사한 특성, data point - K, Unsupervised representation learning: AutoEncoders

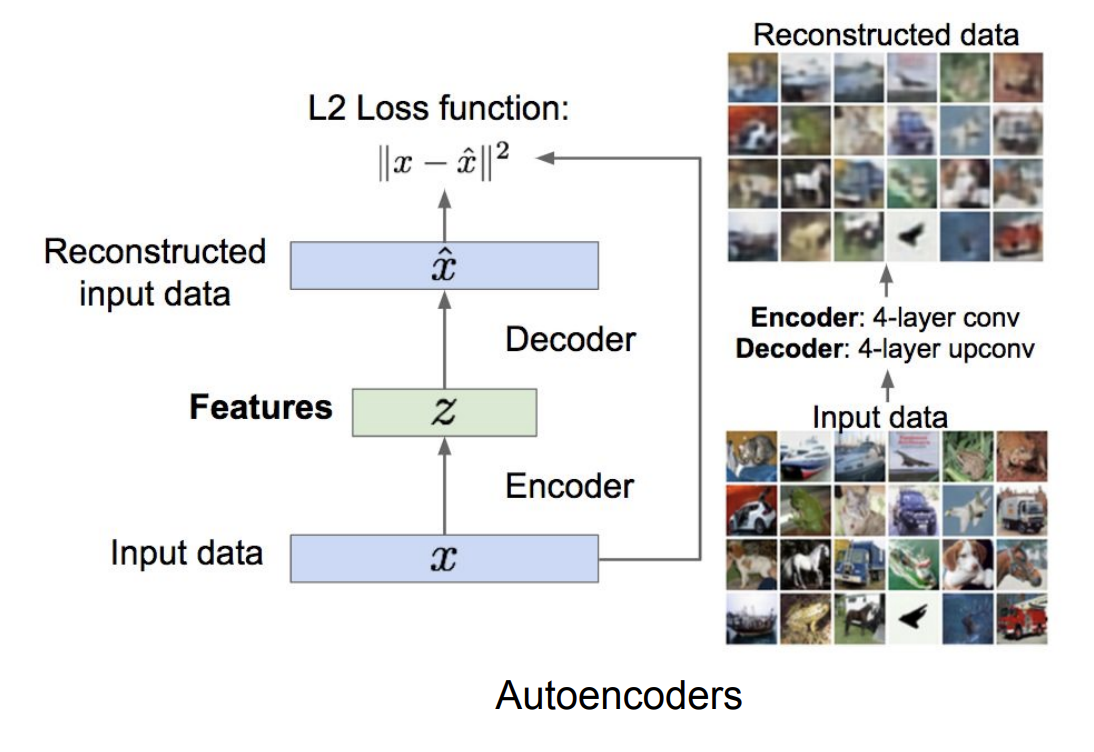

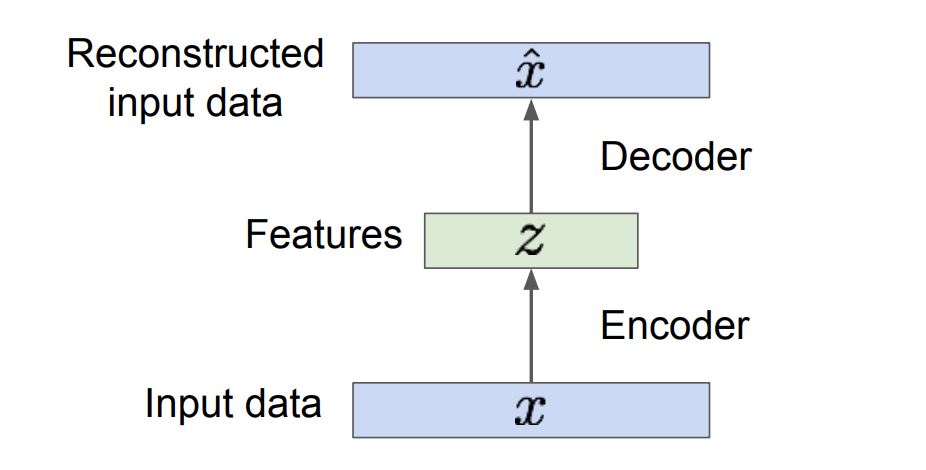

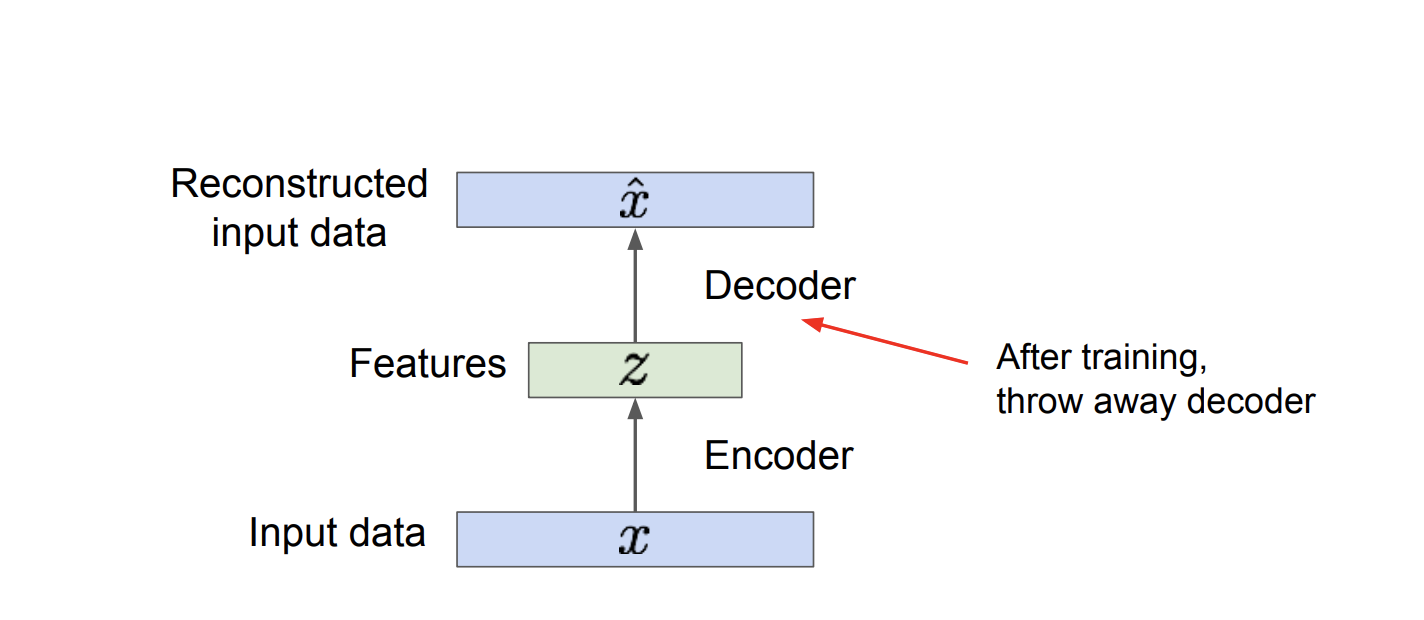

autoencoder = encoder + decoder

입력 데이터를 낮은 차원의 잠재 공간 표현으로 매핑하고, 디코더로 이 표현에서 데이터를 재구성한다.

unsupervised learning과 dimension reducton에 사용됨.

feature Z는 보통 X보다 작다.(차원축소 때문에)

Q) 왜 차원축소를 하나?

A) 데이터 안의 의미있는 다양한 요소를 찾을 수 있다.Benefit

1. Feature compression

2. Noise reduction

3. Improve generalization

4. Visualization

5. Data Compression

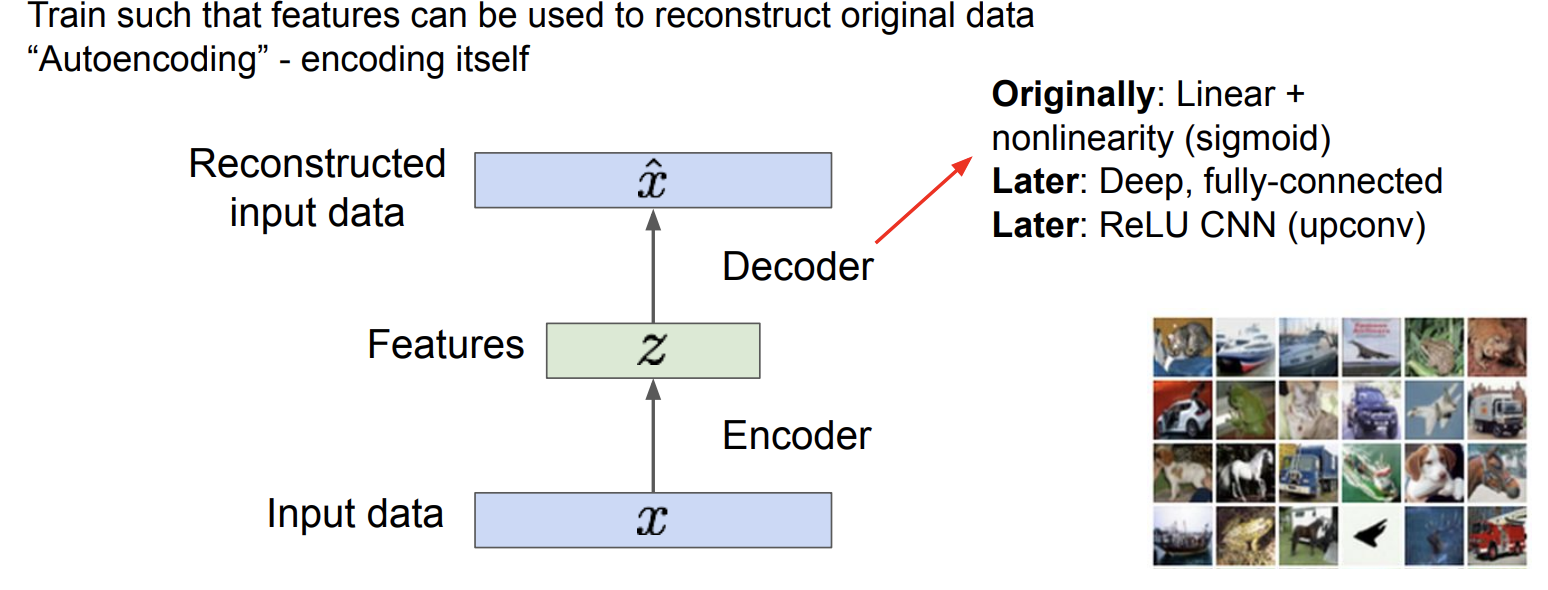

How to learn this feature representation?

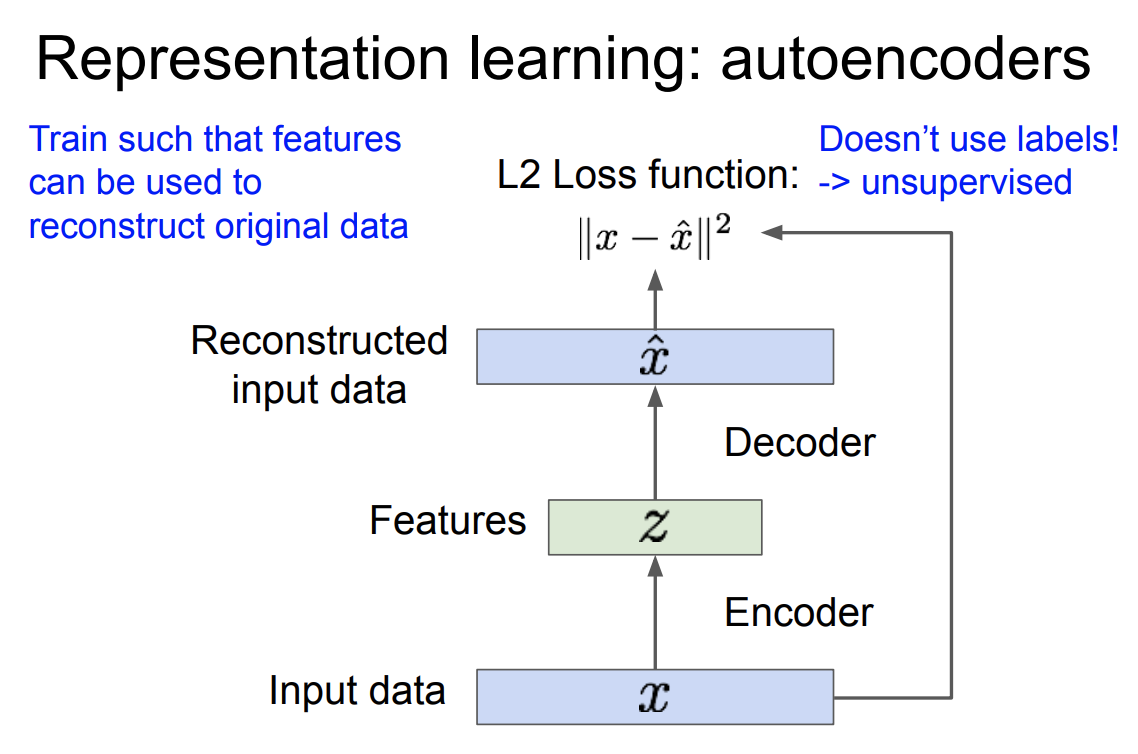

특성을 사용하여 원본데이터를 재구성할 수 있도록 훈련한다.

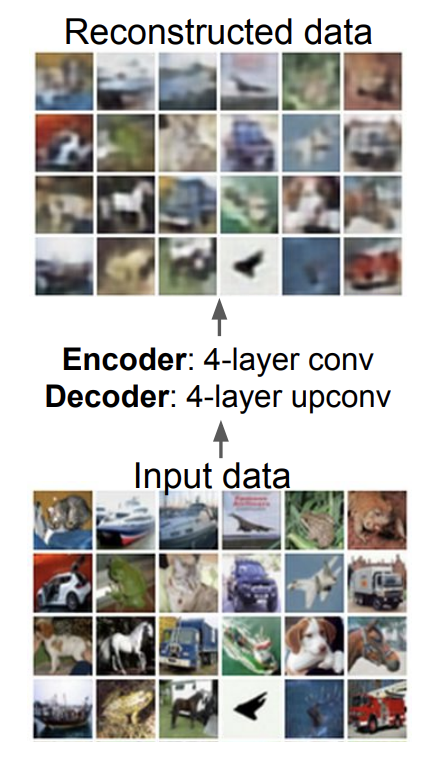

아래의 그림과 같이 재구성된다.

일단 여기까지 학습

AutoEncoder는 Input data를 얼마나 잘 '복원'했는가를 평가한다.

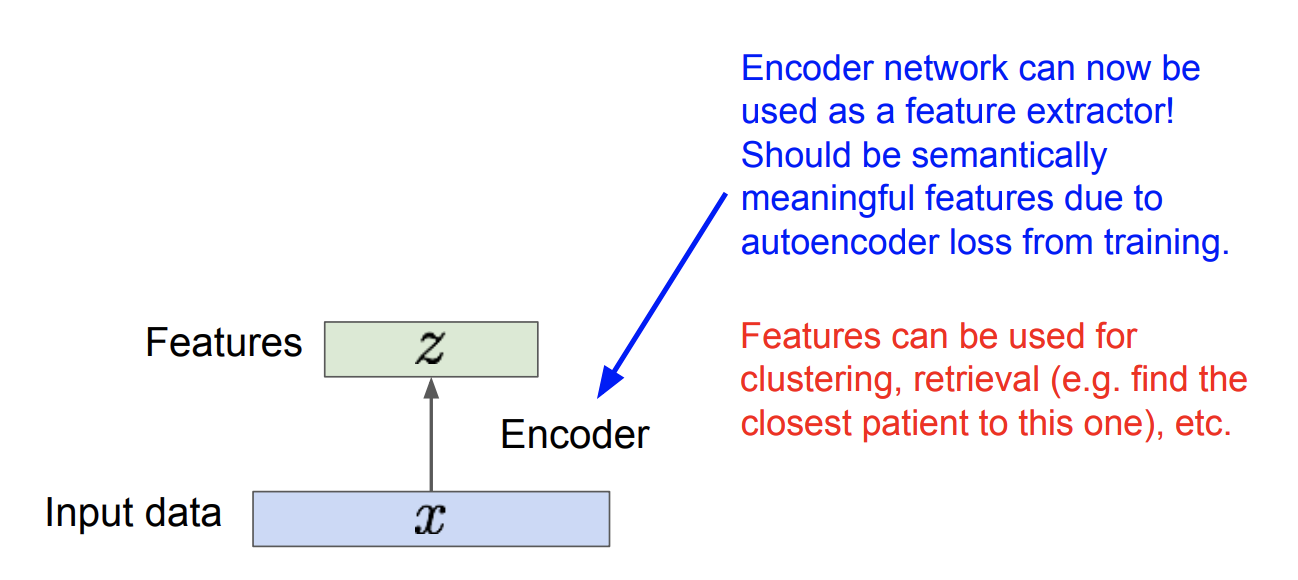

하지만 우리가 원하는 것은 '복원'이 아님.학습 후 디코더를 버린다.

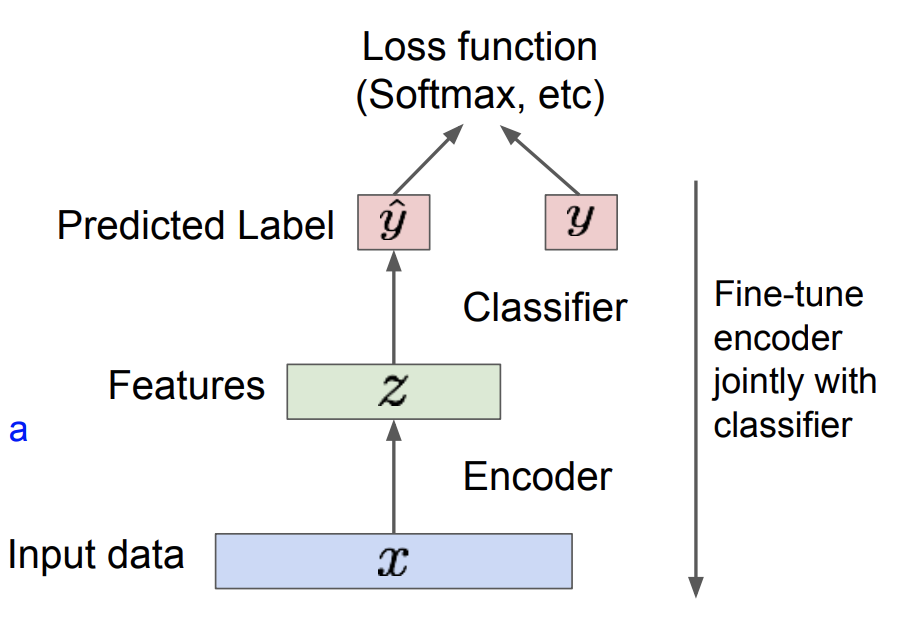

그 다음 feature extractor로 사용되는 encoder

so.

AutoEncoder는 Input data를 얼마나 잘 '복원'했는가를 평가한다.

하지만 우리가 원하는 것은 '복원'이 아님.

그럴싸한 값을 원하는 것이다.그래서 AutoEncoder를 probability하게 만들자.

Probabilistic version: Variational AutoEncoder

(확률적 모델링과 딥러닝을 결합한 신경망 아키텍처로, 생성 모델의 한 유형)

VAE는 잠재 변수와 확률 분포를 사용하여 데이터의 생성 및 잠재 구조를 학습하는 데 사용됩니다.

이러한 확률적 접근은 일반적인 오토인코더와 달리 데이터를 더 효과적으로 모델링하고 데이터 생성에 사용할 수 있게 해줍니다.

VAE는 다양한 응용 분야에서 사용되며, 주로 생성, 이미지 변형, 데이터 생성, 밀도 추정 및 잠재 공간에서의 보간 작업에 활용됩니다.VAE는 생성모델

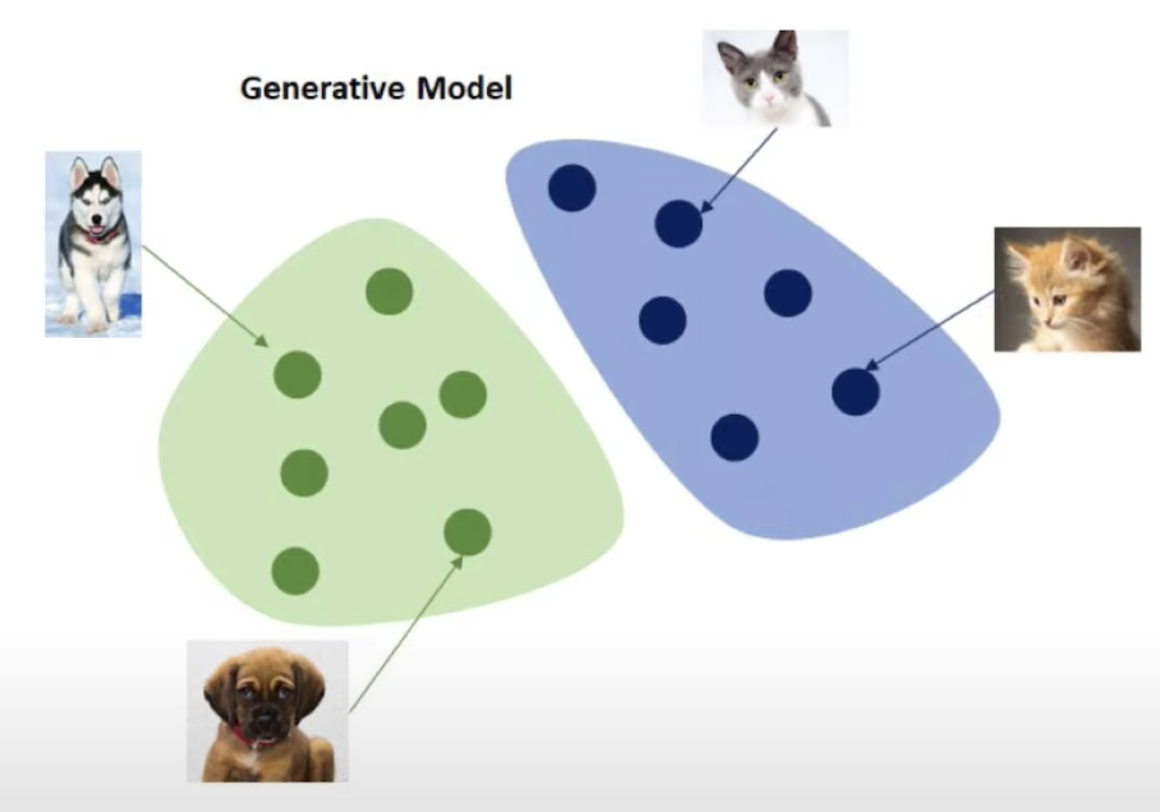

'생성'이란 단순히 Data Instance를 생성하는 것이 아님.

Training data의 distribution을 근사하는 특성을 말한다.

VAE구조는 encoder, decoder구조를

다음과 같이 만든다.

그래서 VAE는 데이터의 분포를 학습하므로 새로운 데이터로(합성) 생성하는데 사용할 수 있다.