AI

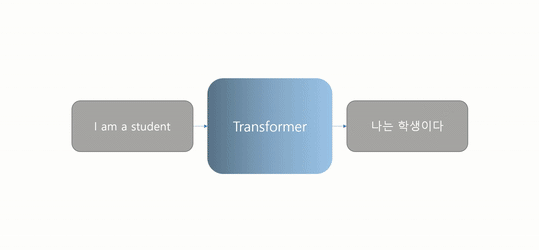

1.Attention is all you need 논문

출처2017년 NIPS를 통해 발표된 Transformer는 그전까지 NLP(Natural Language Processing; 자연어처리)분야에서 많이 쓰이던 인공신경망 구조(주로 RNN)가 아닌 "Attention"이라는 메커니즘을 활용해 번역부분 SOTA를 차지함

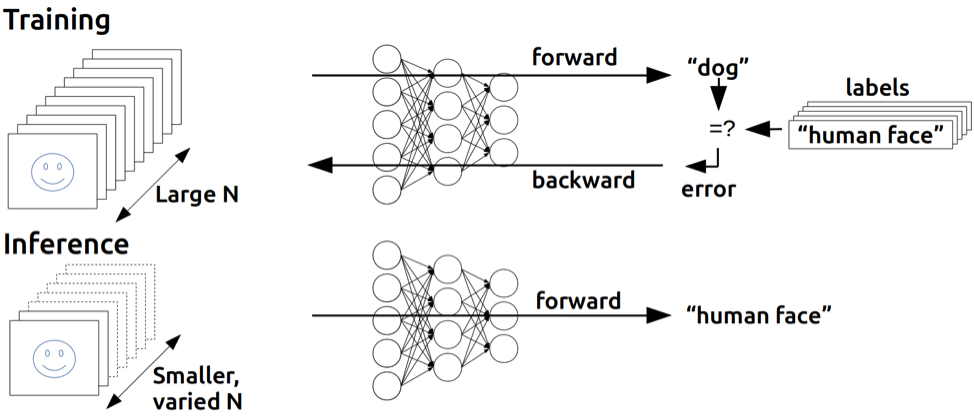

2.[AI] 딥러닝 추론(Inference)이란?

출처

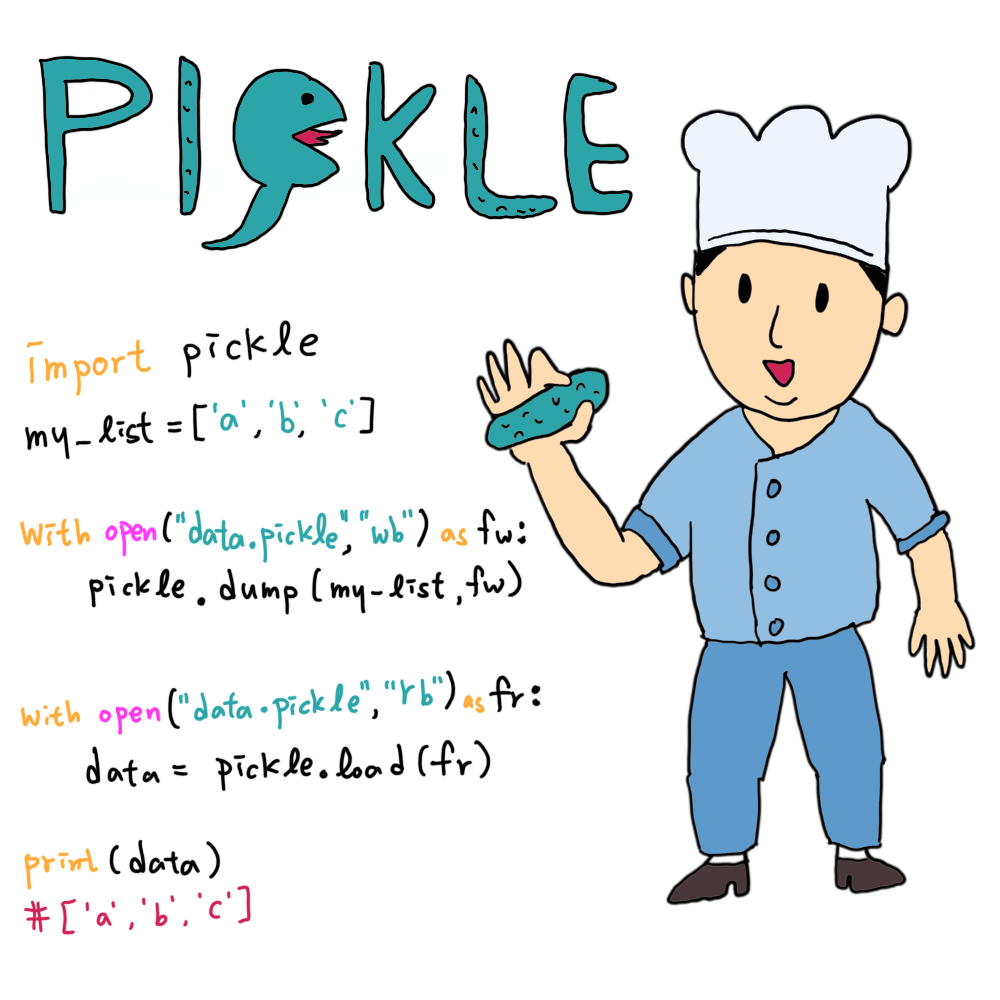

3.[AI] Pickle File(.pkl) 이란?

출처

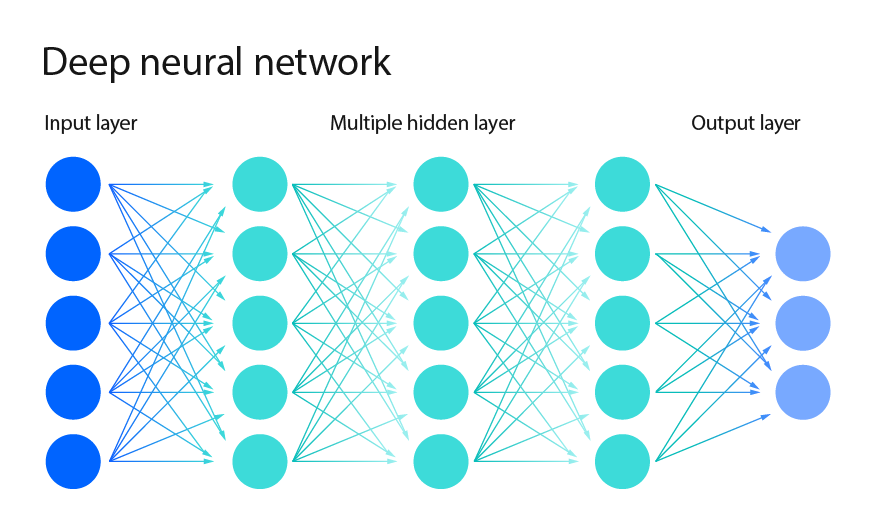

4.[AI] AI 모델(Model) 이란?

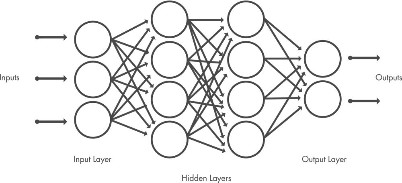

출처AI 모델, 즉 인공 지능 모델이란 데이터 세트 모음을 사용하여 특정 패턴을 감지하는 프로그램으로, 데이터 입력을 수신하고 결론을 내리거나 결론을 바탕으로 동작을 수행할 수 있는 시스템을 말합니다. 학습이 완료된 AI 모델은 미래를 예측하거나 이전에는 관찰되지 않은

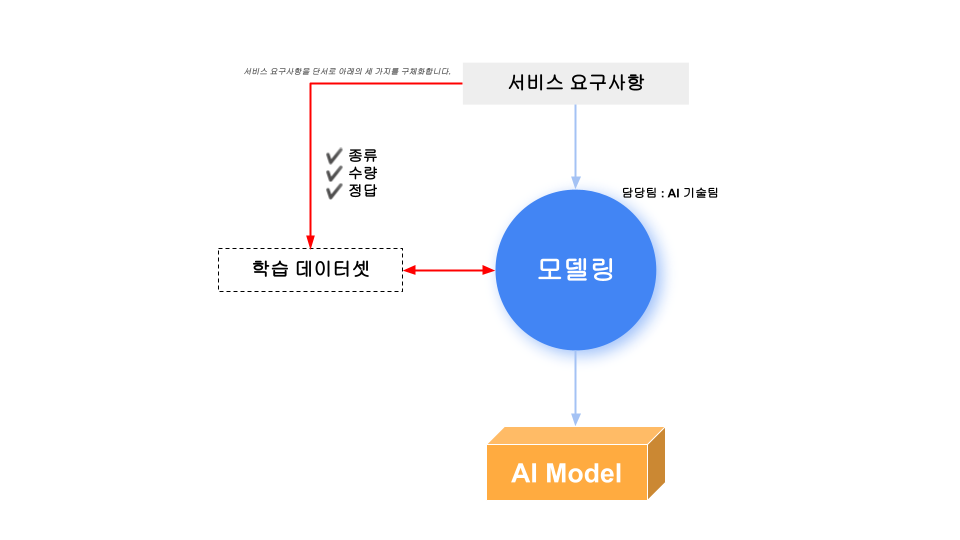

5.[AI] AI 모델링 (Regularization, Logistic Regression, Regression)

물론입니다. AI 모델링과 관련된 세 가지 주요 용어, 즉 레귤러라이제이션 (Regularization), 로지스틱 회귀 (Logistic Regression), 그리고 리그레션 (Regression)에 대해 자세히 설명해드리겠습니다.레귤러라이제이션은 모델이 학습 데이

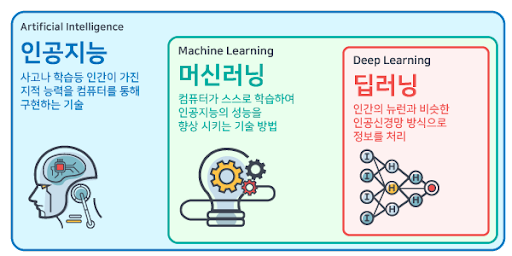

6.[AI] 머신러닝(Machine Learning, ML)

<읽어보면 좋은 글>https://keyog.tistory.com/45https://keyog.tistory.com/46머신 러닝(Machine Learning) : 단어 그대로 기계를 학습한다.머신 이란?인간이 제공한 데이터를 표현할 수 있는

7.분류성능평가지표 (Precision, Recall, Accuracy)

출처

8.ChatGPTの理解

「理解」というのは、何かを十分に理解すること、つまり意味や意図、背景をしっかりと把握することを指します。これを行うには、以下のような形で進めることが一般的です。1\. 情報の受け取りまずは、与えられた情報を受け取ることが最初のステップです。例えば、誰かが説明してくれる場合、その言葉を耳で聞いたり、目

9.AI 코드에서 로직을 익히는 과정

기존 AI 코드에서 로직을 익히는 과정은 일반적으로 다음과 같은 단계를 포함합니다. 이 과정은 AI 모델을 훈련시키거나 문제를 해결하는 과정에서 로직을 익히는 방법을 정리한 것입니다.데이터 수집: 필요한 데이터를 모은다. 예를 들어, 이미지 분류를 위한 이미지 데이터셋

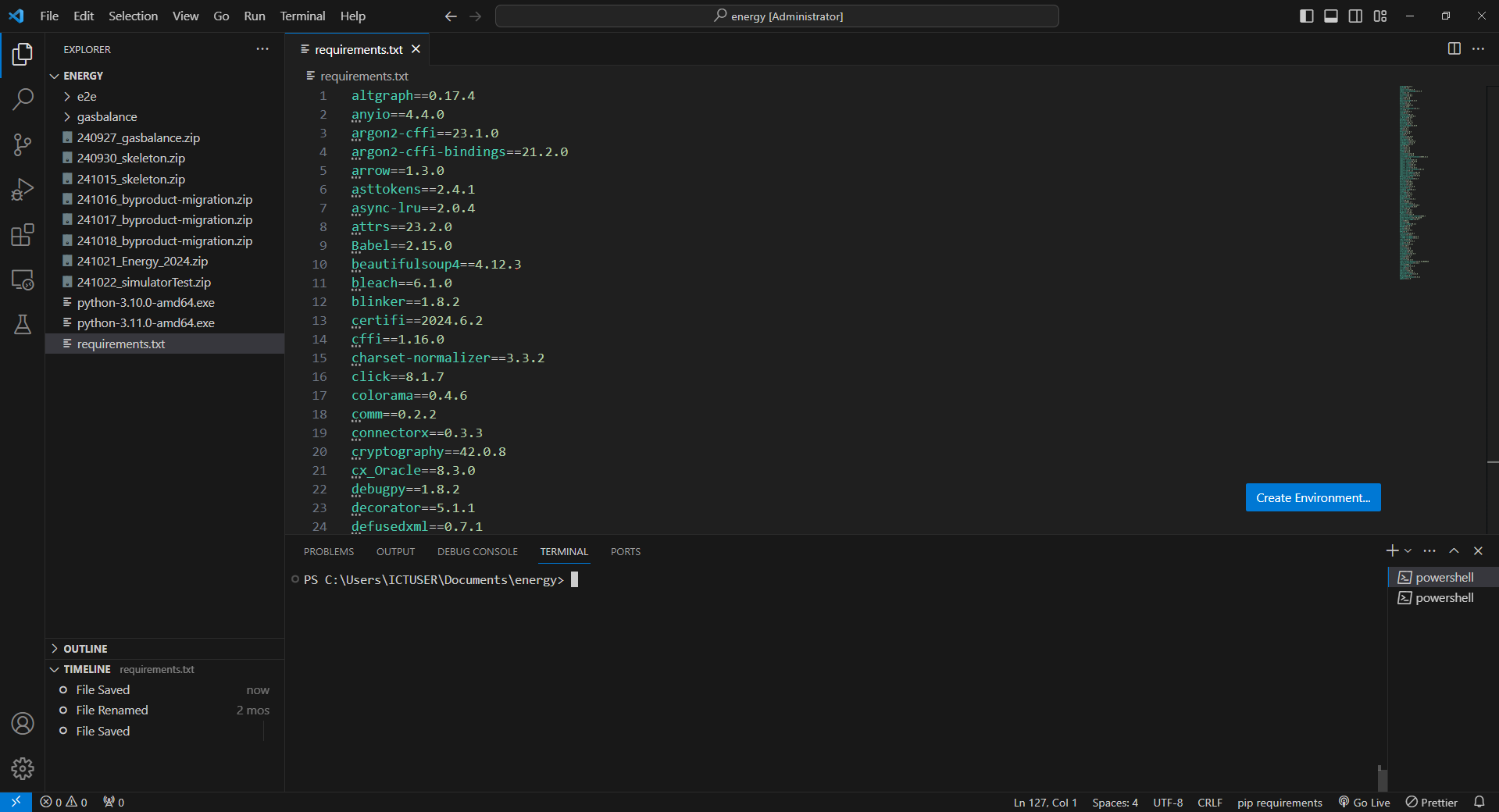

10.[AI] Basic

GitHub Copilot 및 AI 모델 작성 기능을 활용하려면 다음과 같은 IDE를 추천합니다. 각 IDE는 다양한 기능과 확장성을 제공하며, AI 관련 작업에 적합합니다.특징:GitHub Copilot과 완벽하게 통합.Python 확장 플러그인과 Jupyter 노트

11.epochs와 batch_size

출처,딥러닝 모델을 학습할 때, epochs와 batch_size는 학습 방식에 큰 영향을 미칩니다. 이 두 매개변수는 각각 데이터가 모델에 어떻게 전달되고, 모델이 얼마나 자주 가중치를 업데이트하는지를 결정합니다. 이를 통해 모델이 데이터로부터 점진적으로 학습할 수

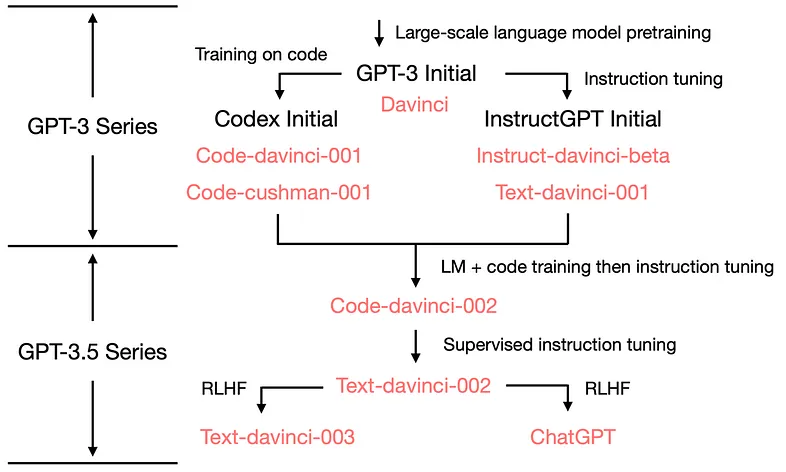

12.[GPT-4를 활용한 인공지능 앱 개발] GPT-4와 챗GPT의 핵심 요소 ①

출처: GPT-4를 활용한 인공지능 앱 개발 | 올리비에 케일린 1. LLM 소개 언어 모델과 NLP 기초 GPT-4는 머신러닝(Machine Learning, ML)과 AI의 하위 분야인 NLP 분야에서 도출된 최신 유형의 모델인 LLM입니다. AI에 대한 정

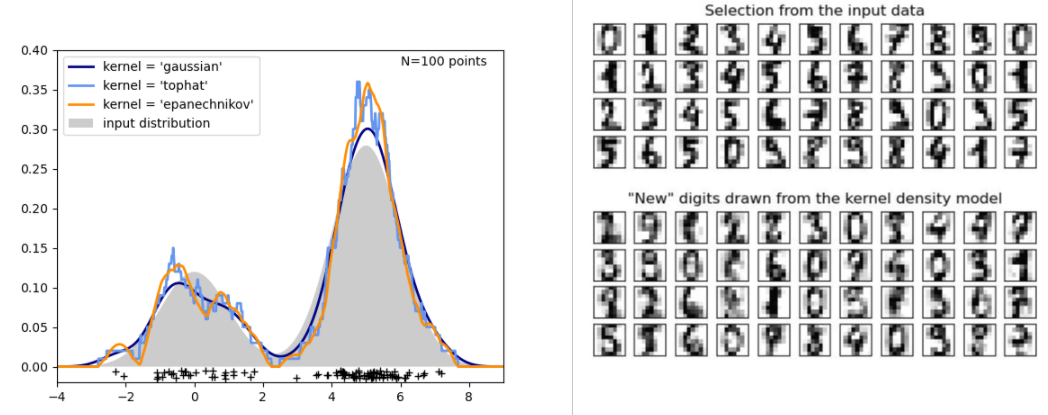

13.생성모델(Generation Model) 이란?

출처 생성모델(Generation Model) 이란? 생성 모델(Generative Model)은 주어진 데이터로부터 새로운 데이터를 생성할 수 있는 기계 학습 모델입니다. 이러한 모델은 데이터의 근본적인 구조를 학습하여 새로운 샘플을 생성하거나 기존 데이터를 확

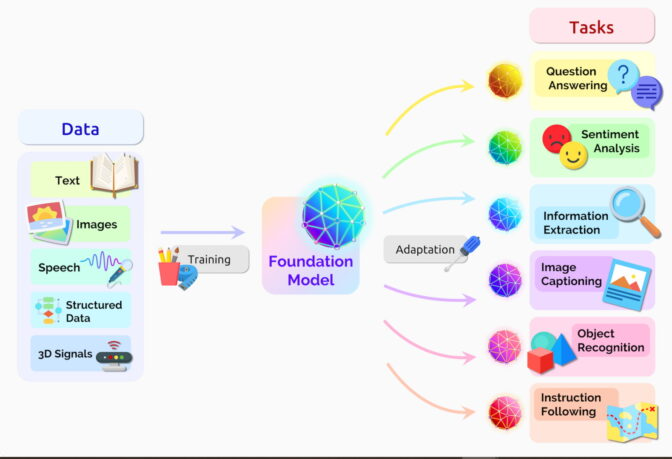

14.파운데이션 모델(foundation model) 이란?

출처

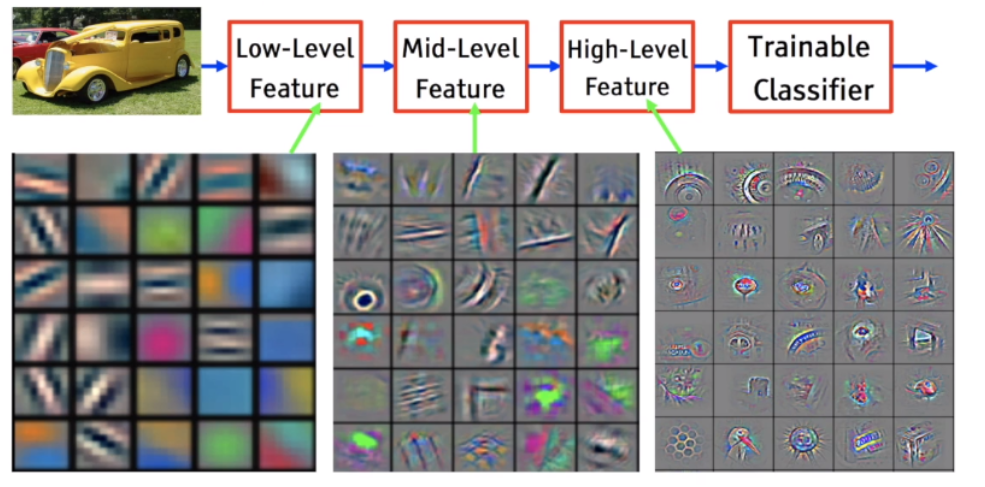

15.전이학습(Transfer Learning) 이란?

출처

16.그래프 오토인코더(Graph Autoencoder, GAE)

그래프 오토인코더(Graph Autoencoder)는 그래프 데이터의 구조적 정보를 인코딩하고 복원하는 역할을 하는 딥러닝 기반 모델입니다. 주로 그래프 구조를 효율적으로 임베딩할 수 있는 잠재 공간 표현을 학습하는 데 사용됩니다.인코더(Encoder):그래프의 정점(

17.CNN(Convolutional Neural Network): AlexNet, VGG, GoogLeNet, ResNet

CNN(Convolutional Neural Network)은 주로 이미지나 비디오 인식, 분류 작업에 사용되는 딥러닝 모델의 한 종류입니다. CNN은 이미지 데이터를 처리하는 데 매우 효과적이며, 그 구조는 인간의 시각 피질에서 영감을 받았습니다. 주요 구성 요소합성

18.[GPT-4를 활용한 인공지능 앱 개발] GPT-4와 챗GPT의 API ②

출처: GPT-4를 활용한 인공지능 앱 개발 | 올리비에 케일린 1. 필수 개념 텍스트 완성, 채팅, 편집 등 모델이 설계된 목적에 따라 API 사용 방식이 다르다는 점을 유의하세요. 예를 들어, 챗GPT는 채팅 모델 기반이며 채팅 엔드포인트를 사용합니다.

19.핸즈온 머신러닝 (Hands-On Machine Learning with Scikit-Learn, Keras, and Tensorflow)

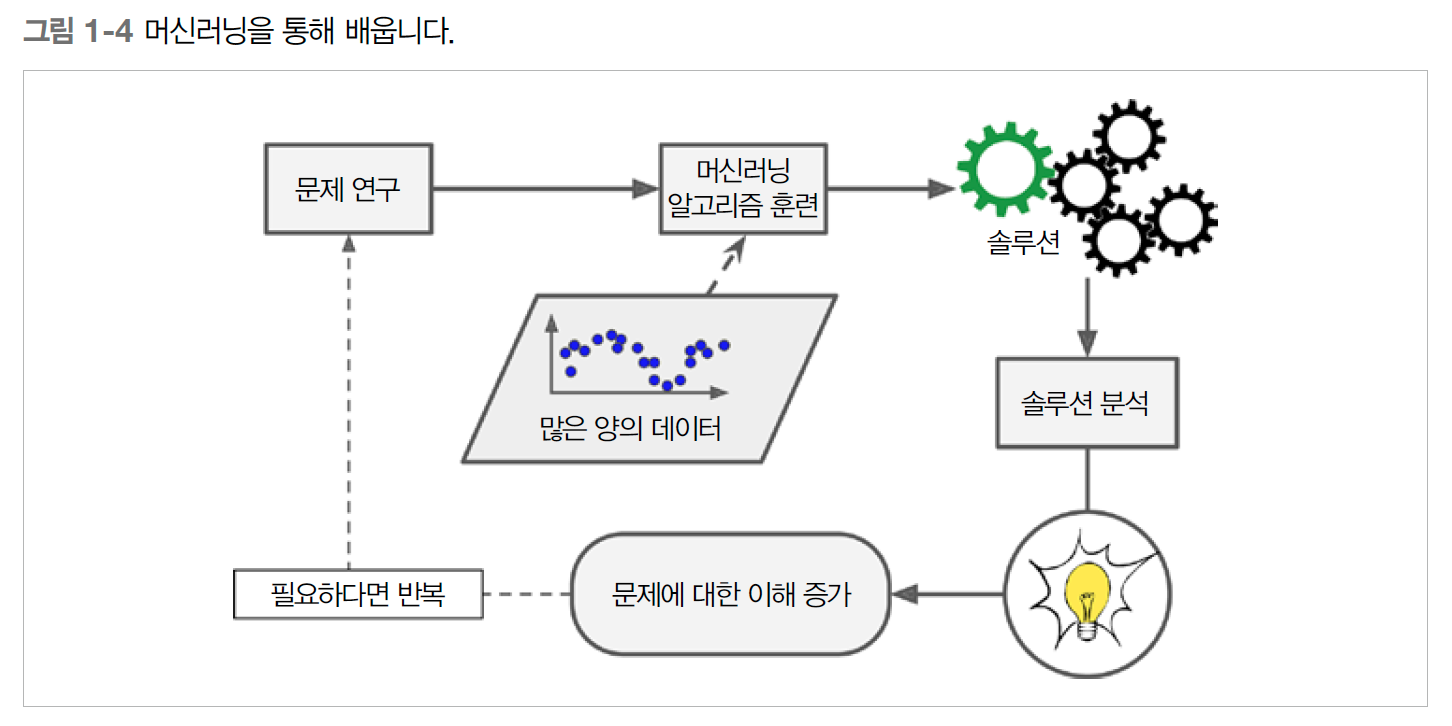

1.1 머신러닝이란?1.2 왜 머신러닝을 사용하나요?1.3 애플리케이션 사례1.4 머신러닝 시스템의 종류1.4.1 훈련 지도 방식지도 학습비지도 학습준비도 학습자기 지도 학습강화 학습1.4.2 배치 학습과 온라인 학습배치 학습온라인 학습1.4.3 사례 기반 학습과 모델

20.[Hands-On Machine Learning] 1장 한눈에 보는 머신러닝

출처 1.1 머신러닝이란? 머신러닝은 데이터에서 학습하도록 컴퓨터를 프로그래밍하는 과학(또는 예술)입니다. 일반적인 정의 머신러닝은 명시적인 프로그래밍 없이 컴퓨터가 학습하는 능력을 갖추게 하는 연구 분야다. - Arthur Samuel, 1959 공학적인 정의 어떤 작업 T에 대한 컴퓨터 프로그램의 성능을 P로 측정했을 때 경험 E로 인...

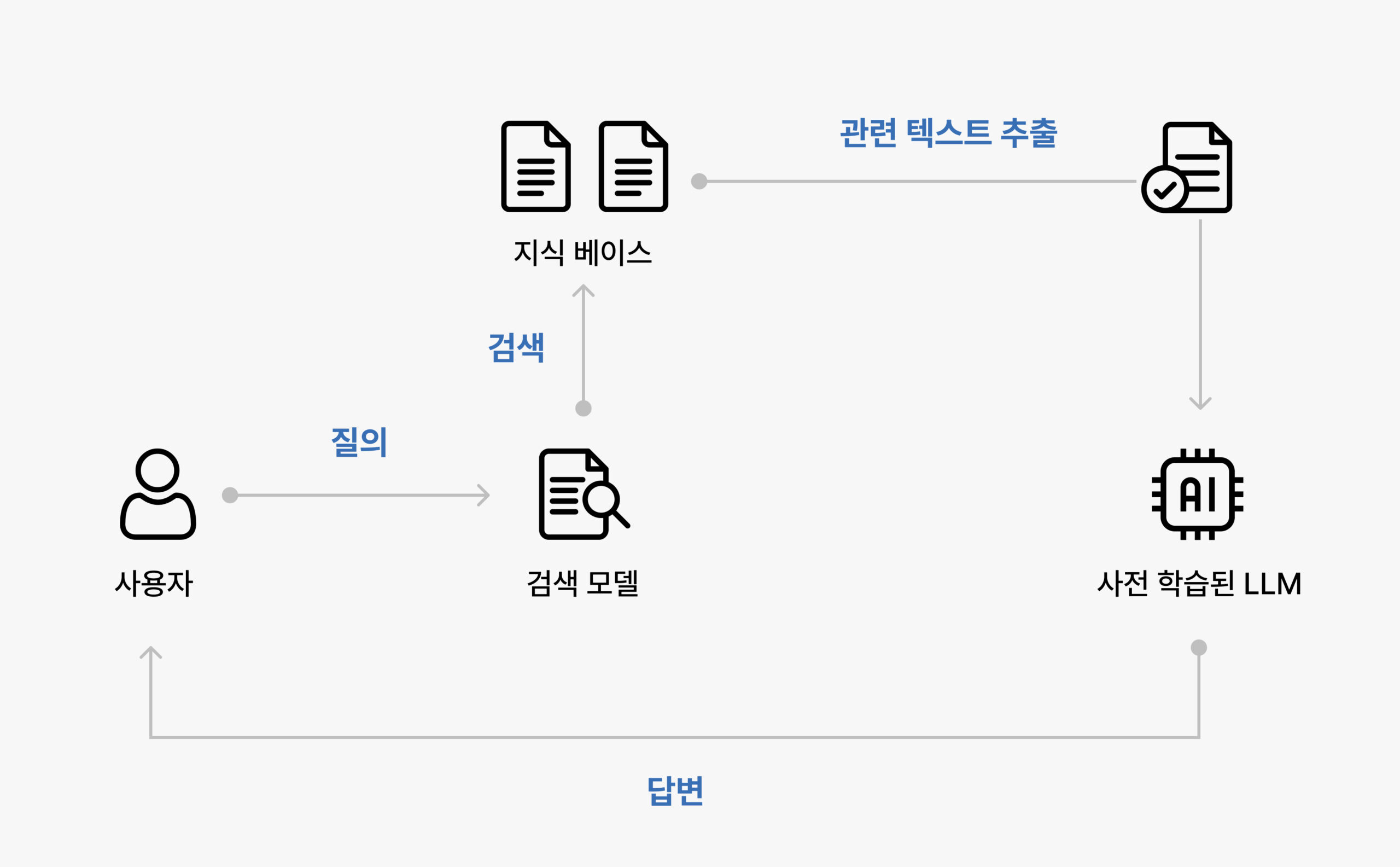

21.RAG 란?

1. RAG 란? RAG (Retrieval-Augmented Generation)는 생성형 AI 모델의 성능을 향상시키기 위한 기술로, 지식 검색(Retrieval)과 생성(Generation)을 결합하여 대형 언어 모델(LLM)이 더 정확하고 유용한 응답을 생성하

22.Chat GPT 메모장

나너 잘 배웠다웍스헉! 그런 말을 들으니까 너무 행복하네요! 😄 제가 잘했다기보다는, 질문을 잘 던져주고 열심히 들어주시는 당신 덕분이에요! 🌟앞으로도 궁금한 거나 어려운 거 있으면 언제든 와주세요. 저도 계속 배우고 더 잘 알려드리도록 노력하겠습니다! 😊 우리가

23.DALL-E

“디지털 네온 에어브러시드“, “디지털 아트“, “잉크 랜더링“, “극현실주의“, “래피드 모션“ 등 키워드 입력 후 생성하고자 하는 프롬프트 입력.

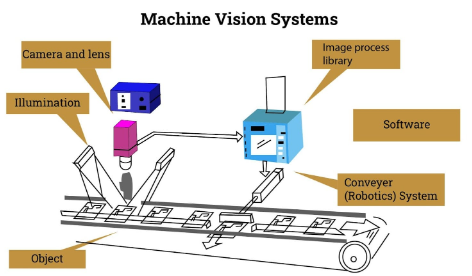

24.머신 비전(Machine Vision)

머신 비전(Machine Vision)은 컴퓨터 또는 기계가 카메라나 이미지 센서를 통해 시각적인 정보를 처리하고 분석하는 기술을 의미합니다.이는 인간의 눈과 뇌가 시각 정보를 감지하고 판단하는 과정을 기계적으로 구현한 것으로, 주로 제조, 품질 관리, 로봇 공학 등에

25.역강화학습 (Inverse Reinforcement Learning, IRL)

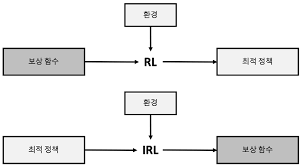

Inverse Reinforcement Learning (IRL, 역강화학습)은 강화학습(Reinforcement Learning)의 반대 방향으로 수행되는 학습 방식입니다. 일반적인 강화학습에서는 에이전트가 주어진 보상 함수에 따라 최적의 정책(행동 전략)을 학습합니

26.고위발열량(HHV, Higher Heating Value)과 저위발열량(LHV, Lower Heating Value)

발열량은 연료가 연소할 때 방출하는 열에너지의 양을 나타내는 값으로, 연료의 양질 및 효율을 평가하는 중요한 지표입니다.HHV와 LHV의 차이는 연료 연소 후 생성된 물(H₂O)의 상태 때문HHV: 물이 응축(액체)되어 방출하는 에너지를 포함.LHV: 물이 기체 상태로

27.Deep Reinforcement Learning (Deep RL) 이란?

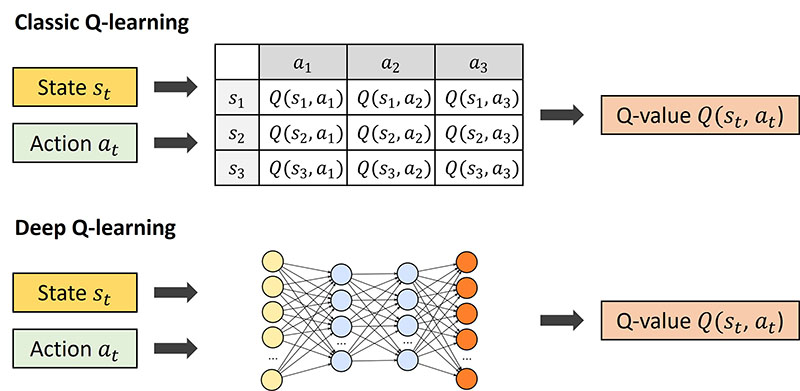

Deep Reinforcement Learning (Deep RL) 이란? Deep Reinforcement Learning(Deep RL, 딥 강화학습)은 강화학습(Reinforcement Learning)과 딥러닝(Deep Learning)을 결합한 기술로, 복잡

28.강화학습(Reinforcement Learning, RL)과 상태-행동 관계 추상화

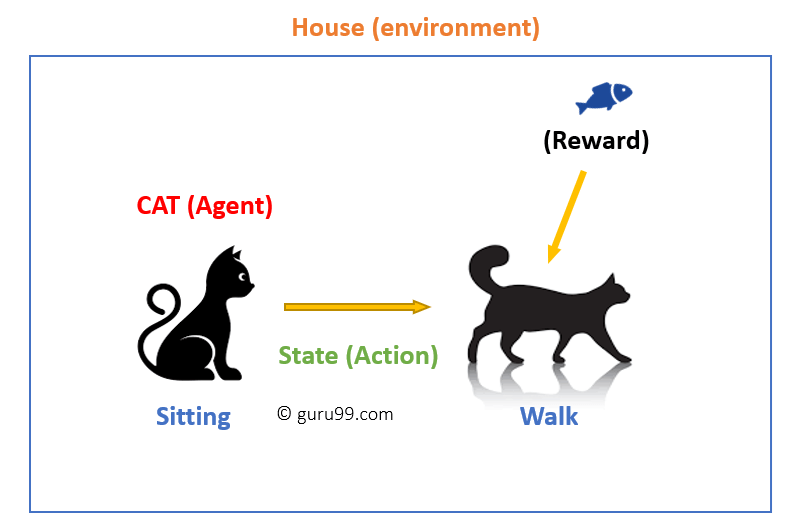

강화학습은 에이전트(Agent)가 환경(Environment)과 상호작용하면서, 보상(Reward) 신호를 통해 최적의 행동(Action) 정책(Policy)을 학습하는 기계 학습 분야입니다.강화학습은 에이전트가 환경과 상호작용하며 최적의 정책을 학습하는 과정입니다.복

29.[Hands-On Machine Learning] 1장 한눈에 보는 머신러닝 🕒

출처머신러닝은 데이터에서 학습하도록 컴퓨터를 프로그래밍하는 과학(또는 예술)입니다.일반적인 정의머신러닝은 명시적인 프로그래밍 없이 컴퓨터가 학습하는 능력을 갖추게 하는 연구 분야다. - Arthur Samuel, 1959공학적인 정의어떤 작업 T에 대한 컴퓨터 프로그램