경사 하강법과 친해지기

0. 학습 참고자료

- 밑바닥부터 시작하는 딥러닝 1편

- Deep Learning Fundamental

- Hands-on Machine Learning

1. GD

핸즈온 머신러닝에서 설명하는 내용이 와닿았는데 산에서 길을 잃었을 때 안전하게 하산하기 위해서 우리는 경사가 낮아지는 방향으로 나아가는 것처럼 딥러닝에서도 마찬가지로 예측값을 평가하는 손실함수의 값이 작아지는 방향으로 학습을 반복하여 개선하는 방법을 경사 하강법이라고 한다

- 반복한다는 부분을 의식해서 보는 것이 이후의 딥러닝 학습과정을 이해하는데 도움이 된다

- 손실함수는 비용함수로도 불리지만 책마다 표현이 조금씩 다르다

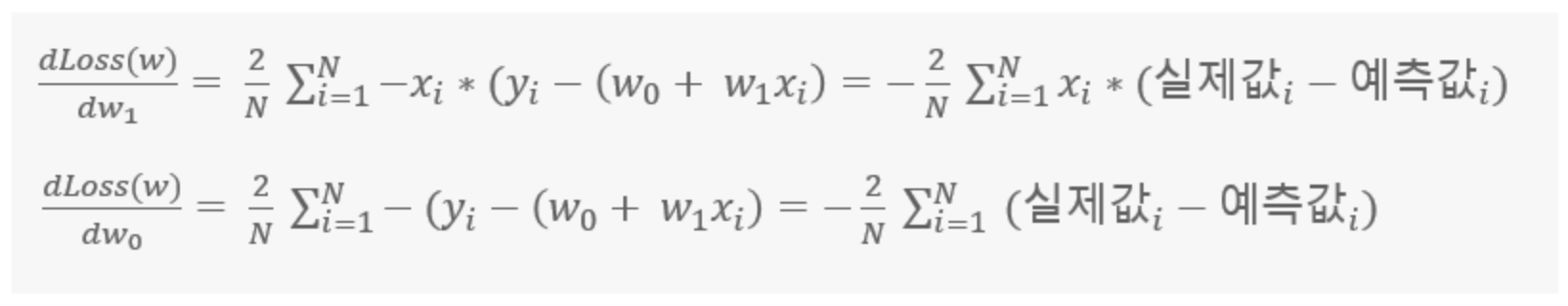

2. 경사법 표현식에서 편미분

- 밑바닥 딥러닝에서 설명하는 내용을 가져와보면 사실은 "경사법"이 더 맞는 표현이다. 하지만 일반적으로 "경사 하강법"으로 불릴 때가 더 많아서 경사 하강법으로 부른다

- 중요한 것은 실제값과 예측값의 차이를 줄여나가는 것

3. Learning rate(학습률)

보통 에타(𝜂)로 표현하고 한 번의 학습으로 얼마만큼 학습해야 하는지 즉, 매개변수 값을 얼마나 갱신하느냐를 정해준다

- 일반적으로 0.01이나 0.001 등으로 정해진 값을 쓴다

- 학습률이 너무 크거나 작으면 학습이 제대로 이뤄지지 않는다