로지스틱 회귀 (Logistic Regression)

- 정의

- 주로 Binary Classification 문제에 사용되는, 통계학적인 머신러닝 알고리즘

- 입력 변수의 Linear Combination 을 로지스틱 함수에 적용하여 확률을 계산하고, 이를 기반으로 Binary Classification를 수행

- Linear Combination : 주어진 변수들을 상수와 가중치의 곱으로 더한 것

- Binary Classification : 0 or 1로 분류

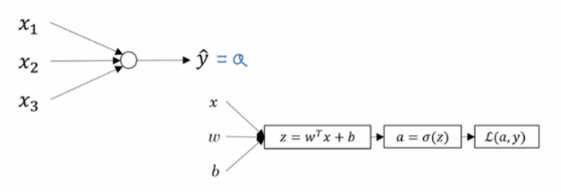

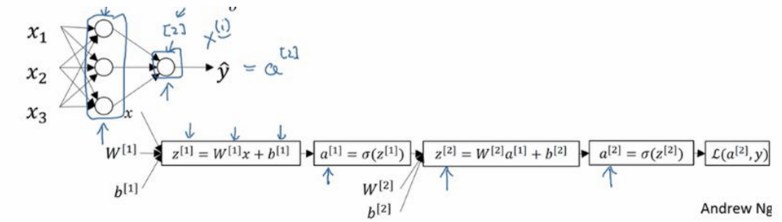

- 그림 ex)

- 로지스틱 회귀

- 신경망 모델 (여러 층이 있음.)

- 로지스틱 회귀

- 선형 회귀 (Linear Regression)

- 예측을 위한 직선(선형 방정식)을 학습

-

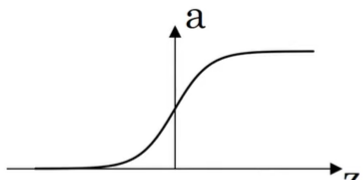

sigmoid 함수

- 정의

- Logistic Regression + Binary Classification에서 ŷ는

y=1일 확률을 의미 → 따라서 결과값을 0~1로 바꿔주기 위해 sigmoid를 씌움

- 정의

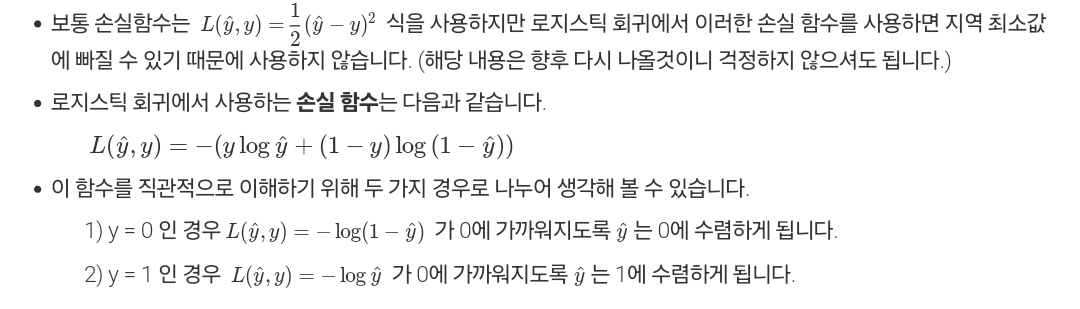

- 오차 계산하기

- Loss 함수 : 한 입력 data에서의 오차

- 구체적인 수식

- 구체적인 수식

- Cost 함수 : 전체 입력 data에서의 오차

- Loss 함수의 평균

- Loss 함수의 평균

- Loss 함수 : 한 입력 data에서의 오차